本文讲解如何使用机器学习和深度学习来检测机械振动数据中的异常,属于异常检测领域,这玩意在工业中用的更多,因为工业中毕竟还是正常样本远多于故障样本(异常样本)。

运行环境为MATLAB R2021B.

第三方面包多官网下载如下

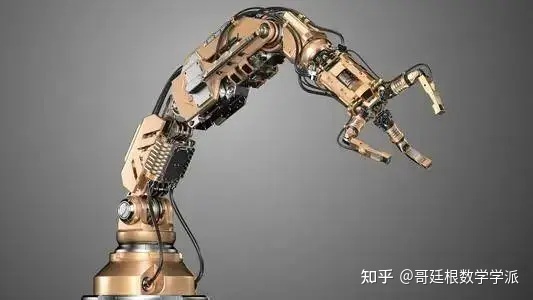

数据集

数据集包含来自工业机械臂的三轴振动测量值, 在计划维护之前和维护之后采集数据。 假定在定期维护后采集的数据代表机器的正常运行状况,维护前的数据代表正常或异常情况。 每轴的数据存储在单独的列中,每个文件包含 7000 个测量值。

trainData = 40×4 table

| ch1 | ch2 | ch3 | label | |

|---|---|---|---|---|

| 1 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 2 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 3 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 4 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 5 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 6 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 7 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 8 | 70000×1 double | 70000×1 double | 70000×1 double | Before |

| 9 | 70000×1 double |

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1129

1129

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?