CoT(Chain of Thought)是一种用于大语言模型(LLM)的提示词方式,它鼓励模型解释其推理过程。

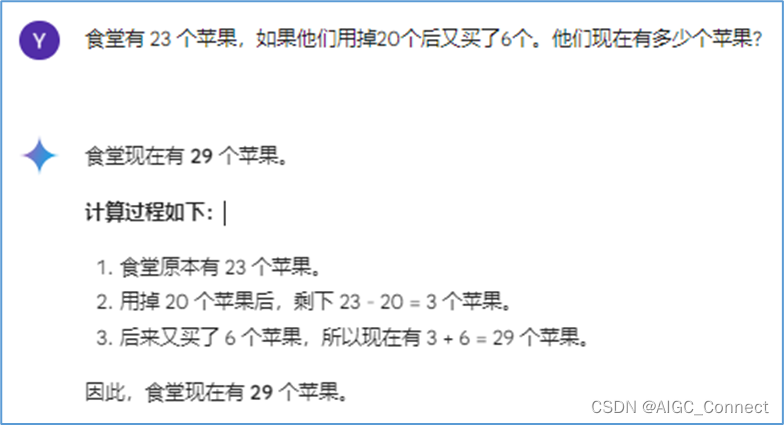

不使用CoT

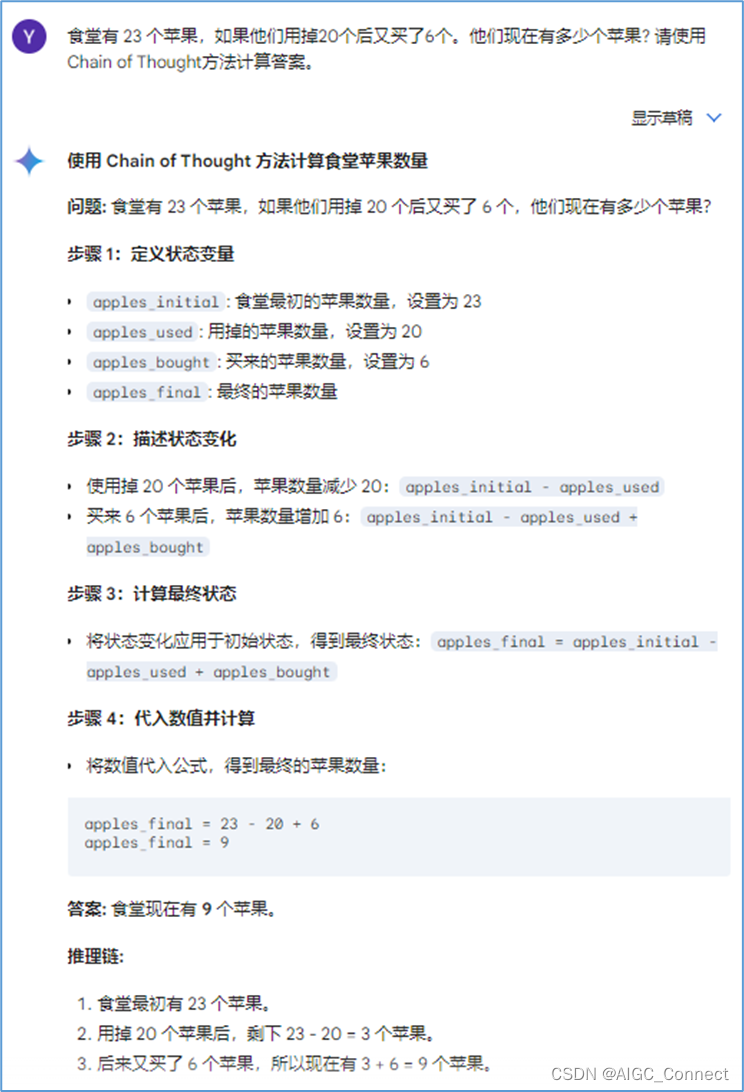

使用CoT

提示工程师们测试了不少思维链问法,比如,

能促进模型深入思考的问法-

“Let’s think step by step”(让我们一步步想)、

“The answer is after the proof”(先证明下,再给答案);

经过多轮测试,研究人员发现“Let's think step by step”(让我们一步步想)这句话最能提升推理结果的准确性。这句话一时也被称作“咒语”

362

362

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?