目录

DINO论文

链接:https://arxiv.org/pdf/2104.14294

Abstract

总结贡献点如下:

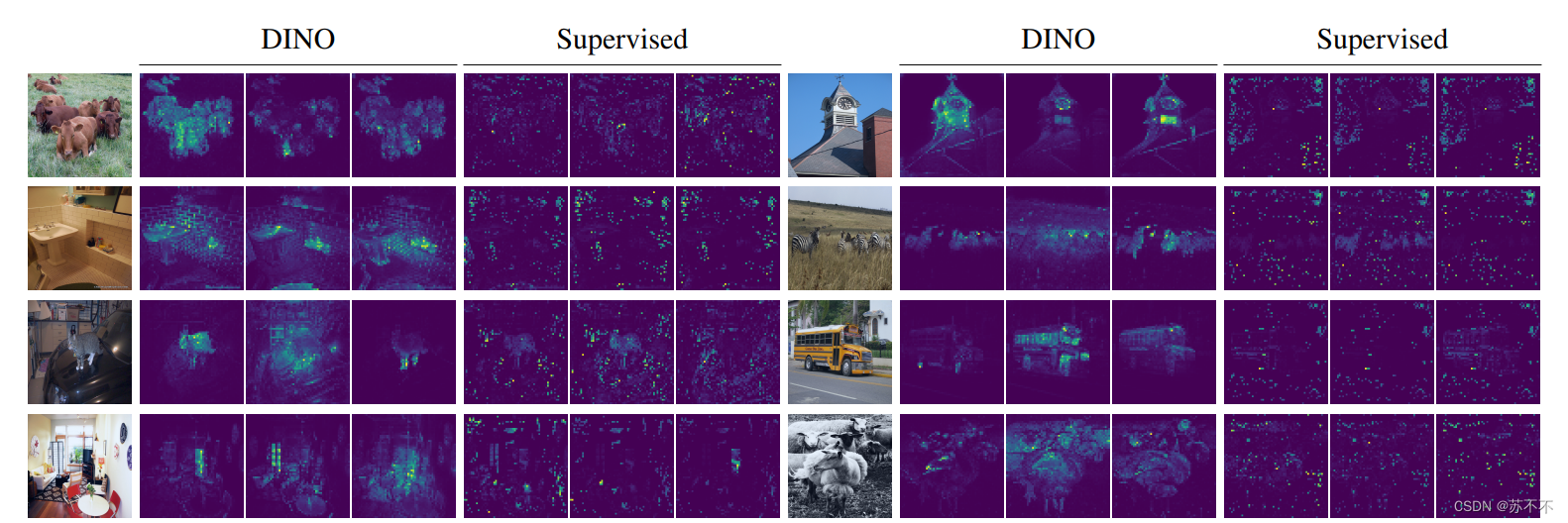

- 发现自监督的ViT可以呈现图像的语义分割信息,这一点在监督ViT和CNN中都没有被发现。(具体可以看下文中的图片示意,but我还不知道可视化的是哪一层)

- 上述的语义分割特征在图像类间有良好的区分度(体现在通过一个KNN就可以达到很高的分类准确率,所以用于算图像相似度、以图搜图的话可能是个好的choice)

DINO的名字来自于 self-distillation with no labels (所以我认为读音应该是 /di nəʊ/,如果有其他官方的发音欢迎评论区更正 OHO!)

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1759

1759

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?