简介:ORB_SLAM3是机器人和自动驾驶领域中SLAM技术的最新进步,特别是在IMU数据融合和多地图管理方面。它通过深度整合IMU数据来提高定位稳定性和减少漂移,同时解决了大规模环境中的循环闭合问题。支持多传感器配置,包括单目、双目和鱼眼相机,ORB_SLAM3能够构建精确的地图并进行有效的视觉惯性里程计(VIO)估计。此外,它还优化了回环检测和内存管理,以适应不同的硬件平台,为移动机器人和自动驾驶提供了强大的技术支持。

1. SLAM技术概述

SLAM(Simultaneous Localization and Mapping,即时定位与地图构建)是机器人和自动驾驶车辆等自主系统中的核心技术,它允许设备在没有预先环境地图信息的情况下,通过传感器数据来实时建立环境地图,并在此基础上进行自身定位。

1.1 SLAM的基本概念

1.1.1 SLAM的定义和研究意义

SLAM技术涉及计算机视觉、传感器融合、机器学习等多个交叉学科领域。它的研究意义在于,通过解决定位和地图构建这一核心问题,可以赋予机器人或自主车辆自主导航的能力,为其执行复杂任务提供基础支持。

1.1.2 SLAM的发展历程和现状

SLAM的研究始于20世纪80年代,而近年来随着算法和硬件的发展,特别是计算机视觉领域的突破,SLAM技术得到了迅速的发展,现已广泛应用于无人机、增强现实和机器人导航等多个领域。

1.1.3 SLAM的关键技术点

SLAM的关键技术主要包括传感器数据处理、环境特征提取、数据关联、位姿估计、环境建模以及回环检测等。这些技术的高效融合确保了SLAM系统能够稳定且准确地运行。

下文中,我们将深入探讨SLAM的类型、系统架构以及具体实施时的关键技术和应用实例。

2. ORB_SLAM3系统升级亮点

2.1 ORB_SLAM3的架构特点

2.1.1 ORB_SLAM3相较于前代的改进之处

ORB_SLAM3是近年来视觉SLAM领域的一个重大进展,代表了当前视觉SLAM研究的前沿水平。相较于前代,ORB_SLAM3引入了关键的改进,其中包括:

- 多地图系统 :ORB_SLAM3支持同时运行多个地图的系统,在不同的地图之间可以无缝切换,这一特性使得系统能够处理更大的环境和动态场景。

- 改进的定位器 :系统引入了改进的定位器算法,可以在更多的情况下实现准确的重定位,有效解决了丢帧、回环等传统视觉SLAM中的难题。

- 支持立体视觉 :除了单目和双目摄像头,ORB_SLAM3还支持RGB-D相机,这使得它能够更好地处理场景中的深度信息,提升SLAM系统的稳定性和精度。

2.1.2 系统的整体流程和关键组件

ORB_SLAM3整体流程包括了前端的特征提取、匹配和后端的位姿优化、地图构建与维护等关键步骤。系统核心组件主要包括:

- Tracker :负责跟踪相机的运动,并利用特征点检测与匹配结果进行位姿估计。

- LocalMapper :在Tracker无法有效跟踪相机运动时,LocalMapper进行局部地图的优化。

- LoopCloser :负责检测回环,即相机回到已访问的位置,并对全局地图进行优化。

2.2 ORB_SLAM3的创新点分析

2.2.1 关键算法的创新与优化

为了提升系统的鲁棒性和精度,ORB_SLAM3中采用了多项关键算法创新:

- 半全局匹配(SGM) :利用SGM算法改进深度估计,这对于双目和RGB-D SLAM模式尤为重要。

- 有效的回环检测 :回环检测是SLAM系统稳定性的关键,ORB_SLAM3采用了改进的数据结构和算法以减少计算量,提高回环检测的效率和准确性。

2.2.2 与其他SLAM系统的性能比较

与其他SLAM系统相比,ORB_SLAM3展现出卓越的性能:

- 更高的稳定性 :ORB_SLAM3能够在复杂的环境中持续稳定地工作。

- 更广的应用范围 :多地图机制使得ORB_SLAM3能够处理更大范围的地图,并且更好地适应动态场景。

- 更强的适应性 :通过引入多种传感器支持,ORB_SLAM3展现了极强的适应性。

2.2.3 对多传感器融合的贡献

多传感器融合是现代SLAM系统发展的关键方向之一,ORB_SLAM3在这方面做出了重要贡献:

- 多传感器支持 :ORB_SLAM3不仅可以处理单一视觉传感器的数据,还能结合IMU等其他传感器,显著提升SLAM系统的性能。

- 异构传感器数据融合 :通过优化融合策略,ORB_SLAM3能够将不同类型传感器的信息融合在一起,以获得更全面和精确的环境感知能力。

代码示例与分析

在本节中,我们通过一个代码示例来展示如何在实际应用中使用ORB_SLAM3进行相机位姿的跟踪:

// 初始化Tracker模块

ORB_SLAM3::System SLAM(argv[1], argv[2],ORB_SLAM3::System::RGBD,ORB_SLAM3::Tracker::MONOCULAR);

// 读取图像并转换为OpenCV格式

cv::Mat im = cv::imread("image.png",CV_LOAD_IMAGE_UNCHANGED);

// 将图像传递给ORB_SLAM3进行处理

ORB_SLAM3::Tracking::State state = SLAM.TrackMonocular(im, timestamp);

if(state == ORB_SLAM3::Tracking::OK)

{

// 图像跟踪成功,可以进行其他操作

// 例如,可以获取相机的位姿,或者进行地图更新等

}

else if(state == ORB_SLAM3::Tracking::LOST)

{

// 跟踪丢失,可以执行丢失后的处理逻辑

}

以上代码段展示了如何初始化ORB_SLAM3系统,并使用单目相机图像进行位姿跟踪。 System::RGBD 和 Tracker::MONOCULAR 参数指定了使用RGB-D传感器和单目相机模式。 TrackMonocular 方法用于处理图像并返回当前的跟踪状态。如果状态为 OK ,则表示跟踪成功;如果为 LOST ,则表示跟踪丢失,需要采取相应策略。这些参数和状态都需要根据实际应用场景适当设置和处理。

3. IMU数据融合与应用

3.1 IMU在SLAM中的作用

3.1.1 IMU数据的特点及其在SLAM中的角色

惯性测量单元(IMU)通常集成了加速度计、陀螺仪和有时还包括磁力计。这些传感器能够提供关于设备运动状态的信息,如加速度、旋转速率和有时的方向。IMU在SLAM中的主要作用是提供短时间内的设备运动估计,弥补视觉或激光传感器在动态环境下可能出现的不足。

加速度计可以测量线性加速度,而陀螺仪则能够测量角速度。IMU的这些特性使其在SLAM系统中扮演着重要角色。例如,在短时间尺度内,IMU可以为SLAM算法提供连续的运动估计,这对于处理快速运动或跟踪动态变化的环境至关重要。

3.1.2 传感器融合技术的基础

IMU与视觉或激光传感器的融合是当前SLAM领域研究的热点之一。传感器融合技术指的是将来自不同传感器的数据结合起来,以获得比单个传感器更准确和更鲁棒的估计。在SLAM中,这种融合是通过算法实现的,常见的算法包括卡尔曼滤波器和图优化方法。

融合技术的关键在于如何权衡不同传感器的优势,并处理它们的噪声和偏差。IMU数据可以提供连续性,但容易受到漂移影响;而视觉或激光数据则能够提供更准确的环境特征,但易受环境变化影响。融合这些数据需要考虑到它们各自的特点和适用条件。

3.2 IMU数据预处理和融合策略

3.2.1 数据校准与同步

IMU数据在使用之前必须进行校准,以消除传感器的固有偏差和噪声。校准过程包括静态校准和动态校准。静态校准主要消除零偏、尺度因子误差等静态误差,而动态校准则用于补偿温度变化、振动等动态影响。

数据同步指的是确保IMU数据与其他传感器数据(如摄像头数据)在时间上的一致性。这通常需要精确的时间戳记录和处理。在实际应用中,IMU和摄像头之间的同步偏差可能会造成系统状态估计的误差,因此,同步是实现有效传感器融合的关键步骤之一。

3.2.2 预积分技术及其在SLAM中的应用

预积分技术是在IMU数据处理中,将连续时间内的测量值转换为离散的位移和旋转增量。这一技术特别适合用于SLAM系统中,因为它允许在较长时间内,以较少的计算量,保持对运动状态的连续估计。

预积分的关键优势在于减少了计算量,同时提高了状态估计的准确性。在实际实现中,预积分通常结合了IMU的误差模型和运动模型,以适应不同的运动场景和条件。

3.2.3 非线性优化中的IMU误差建模

IMU在长时间的使用中不可避免地会出现累积误差,特别是在没有外部参照的情况下。在非线性优化框架中,IMU的误差模型被建模为状态变量的一部分,以便在优化过程中得到校正。

为了建立IMU误差模型,常见的做法是将其建模为高斯噪声,并通过构建误差状态进行优化。具体来说,可以使用随机游走模型来描述IMU的噪声特性,或者根据实际的噪声统计特性进行建模。在实际应用中,误差模型的选择和参数调整对优化结果有显著影响。

graph TD;

A[IMU Raw Data] --> B[Data Calibration]

B --> C[Data Synchronization]

C --> D[Pre-integration]

D --> E[Nonlinear Optimization]

E --> F[IMU Error Model]

F --> G[State Estimation]

在此流程中,IMU的原始数据首先经过校准处理,以消除其固有的偏差和噪声。随后,通过同步处理与其他传感器数据(如相机数据)进行时间上的对齐。之后,通过预积分技术将连续的IMU读数转换为离散的状态估计增量。预积分处理后的数据被输入到非线性优化框架中,同时IMU的误差模型也被纳入优化过程中。最终通过非线性优化方法,得出更加准确的系统状态估计。整个流程显示了IMU数据在SLAM系统中的数据处理和融合步骤。

4. 视觉特征点跟踪与姿态估计

4.1 特征点检测与匹配

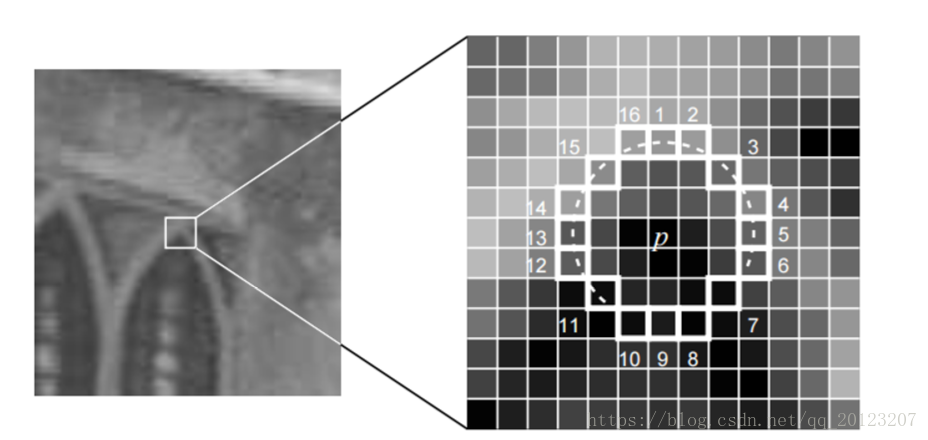

4.1.1 ORB特征点描述符的介绍

在计算机视觉和SLAM中,特征点描述符是用于表示图像中重要信息的一种数据结构,它能够描述特征点的局部区域,使得该点在不同视角下仍能被识别和匹配。ORB(Oriented FAST and Rotated BRIEF)是一种被广泛使用的特征点描述符,它是FAST特征检测器和BRIEF描述符的结合体,并加入了方向性,这使得ORB对旋转和尺度变化具有不变性。

ORB通过旋转的FAST关键点检测来解决角点的方向性问题,并结合BRIEF描述符,通过二进制字符串表示局部图像区域。相比传统的方法,ORB在速度和性能上都有显著的提升。由于它的高效性和旋转不变性,在实时应用中,如增强现实和机器人导航中,ORB成为一个非常受欢迎的选择。

4.1.2 特征匹配技术与误匹配处理

视觉SLAM中的特征匹配是将同一场景在不同时间拍摄的图片中的特征点进行对应的过程。一个可靠的特征匹配可以显著提升SLAM系统的性能,因此研究特征匹配算法是非常关键的。经典的特征匹配方法包括基于最近邻距离比值(Nearest Neighbor Distance Ratio, NNDR)和基于随机抽样一致性(Random Sample Consensus, RANSAC)等。

然而,在实际应用中,由于噪声和光照变化,误匹配难以避免。为了处理误匹配,可以采用多种策略,如双向一致性检查(bidirectional consistency check),即仅当特征点在两幅图像中互相匹配时,才认为是一对正确的匹配。此外,RANSAC是一种有效的鲁棒估计方法,它通过迭代的方式,排除那些不符合大部分数据的点,从而得到一个可靠的结果。

import cv2

import numpy as np

# 假设 img1 和 img2 是两幅需要匹配的图像

# ORB检测器和描述符提取器

orb = cv2.ORB_create()

# 关键点检测与描述符提取

kp1, des1 = orb.detectAndCompute(img1, None)

kp2, des2 = orb.detectAndCompute(img2, None)

# 创建匹配器并进行匹配

matcher = cv2.BFMatcher(cv2.NORM_HAMMING, crossCheck=True)

matches = matcher.match(des1, des2)

# 按照距离排序

matches = sorted(matches, key=lambda x: x.distance)

# 绘制前10个匹配结果

img_matches = cv2.drawMatches(img1, kp1, img2, kp2, matches[:10], None, flags=2)

# 显示匹配结果

cv2.imshow('Matches', img_matches)

cv2.waitKey(0)

cv2.destroyAllWindows()

4.1.3 特征点检测与匹配的实际应用

在SLAM系统中,特征点检测和匹配通常是在连续帧之间进行的。首先,使用如ORB检测器检测当前帧的特征点,并使用描述符进行编码。然后,系统会尝试将这些描述符与前一帧或关键帧中的描述符进行匹配。通过这种方式,可以找到当前帧与之前帧之间的对应关系。

匹配完成后,需要对匹配结果进行筛选,以排除误匹配。此过程可以使用上述代码示例中的双向一致性检查方法。在实际SLAM系统中,匹配结果被用来估计相机运动,并且这些估计会参与到整个SLAM系统的优化过程中。

特征点匹配是SLAM技术中不可或缺的一部分,通过精心设计的算法,可以提高SLAM系统的定位精度和稳定性,进而提高整个系统的鲁棒性。

4.2 视觉里程计(VIO)原理

4.2.1 姿态估计的基础理论

视觉里程计(Visual Inertial Odometry,VIO)是结合相机视觉信息与惯性测量单元(Inertial Measurement Unit, IMU)数据来估计相机运动的方法。VIO可以提供相机在空间中的位置和姿态信息,是SLAM系统中实现自我定位的核心技术之一。

VIO的基本原理是通过连续的图像序列推算出相机的运动状态,包括位置和姿态。这个过程通常包括两部分:首先使用视觉信息进行特征点的检测、匹配和跟踪,然后结合IMU数据进行传感器融合,以获得更为精确的运动估计。视觉里程计的关键优势在于,它能够在动态环境中提供准确的运动估计,且对光照变化和环境变化具有良好的适应能力。

VIO在SLAM系统中的核心作用可以通过以下数学公式来描述:

设相机在连续两个时间点 (t-1) 和 (t) 的姿态分别为 (\mathbf{T}_{t-1}) 和 (\mathbf{T}_t),视觉系统检测到的一组特征点在世界坐标系下的坐标为 (\mathbf{P} = {p_1, p_2, ..., p_n}),则视觉里程计的目标是求解以下的优化问题:

[ \begin{align } \text{minimize} \quad & \sum_{i=1}^{n} \parallel (\mathbf{T}_{t-1}^{-1} \cdot \mathbf{T}_t \cdot p_i) - \hat{p}_i \parallel^2 + \text{其他视觉约束} \end{align } ]

其中,(\hat{p}_i) 是根据第 (t-1) 帧图像中的特征点位置,通过投影关系计算得到的第 (t) 帧中的预测位置。

4.2.2 基于特征点的方法与精度评估

基于特征点的VIO方法是当前主流的技术之一。该方法主要依赖于图像中检测到的稳定特征点,通过对这些特征点的观测来估计相机的运动状态。在实际应用中,这种方法通常包括以下几个步骤:

- 特征点检测与匹配:在连续的图像帧中检测关键点,并在相邻帧之间建立匹配关系。

- 三维重建:使用三角测量法,根据匹配的特征点对,将二维图像点转换为三维空间中的点。

- 相机运动估计:通过最小化重建后的三维点在不同时间点视图中的重投影误差来估计相机的运动。

- IMU数据融合:结合IMU提供的线性加速度和角速度数据,进行传感器融合,进一步提高运动估计的精度。

精度评估是VIO系统设计中的重要组成部分。一般会通过以下方法来评估VIO系统的性能:

- 重复性评估 :在相同条件下多次运行系统,评估输出结果的一致性。

- 准确性评估 :与已知的精确运动状态进行比较,如使用光学跟踪系统获取的地面真实值。

- 稳定性评估 :在长周期的运行中观察系统输出的变化情况,评估其鲁棒性。

4.2.3 基于深度学习的特征点跟踪

近年来,深度学习技术的飞速发展也为特征点跟踪和VIO系统带来了新的突破。基于深度学习的特征点跟踪利用卷积神经网络(CNN)直接从图像数据中学习特征点的描述和匹配策略,相较于传统的手工特征点方法,它通常能提供更强的特征表达能力和更好的鲁棒性。

深度学习方法在处理遮挡、光照变化等问题时表现出了更好的效果。卷积神经网络能够学习到数据的深层特征,例如,网络可以自动学习到描述特征点的特征描述符,从而在不同图像间实现准确的匹配。

import torch

import torchvision.transforms as transforms

from PIL import Image

# 加载预训练的深度学习特征点检测模型

model = torch.hub.load('naver/phalanx', ' EfficientNet-Lite0 ')

# 图像预处理

transform = ***pose([

transforms.ToTensor(),

transforms.Normalize(mean=[0.485, 0.456, 0.406], std=[0.229, 0.224, 0.225]),

])

# 加载图像并进行预处理

img = Image.open('path_to_image.jpg')

img_tensor = transform(img).unsqueeze(0)

# 使用模型提取特征点

feature_points = model(img_tensor)

深度学习方法需要大量的数据进行训练,但一旦模型训练完成,它能够在实时系统中快速进行特征点的检测和匹配。目前,深度学习在VIO系统中的应用仍然在不断探索和发展中,预计未来将在SLAM领域发挥更加重要的作用。

5. 系统优化和应用前景

5.1 系统优化策略

5.1.1 回环检测技术与地图维护

回环检测是SLAM中的一个关键步骤,它能够提高地图的准确性并防止漂移。随着传感器数据的积累,地图可能会变得过于庞大,这需要一种有效的回环检测技术来识别过去的轨迹与当前观测之间的匹配。

操作步骤 如下:

- 提取当前观测和历史数据中的关键帧。

- 计算关键帧之间的视觉特征相似性。

- 应用位姿图优化(Pose Graph Optimization)以解决匹配时的位姿估计。

- 确认回环检测后,执行重定位和全局优化。

回环检测算法的选择对于系统性能至关重要。ORB-SLAM3系统采用了一种基于词袋模型(Bag of Words)的回环检测方法,并通过深度学习方法增强其效率和准确性。

// 伪代码示例

auto loopKF = DetectLoop();

if(loopKF) {

CorrectLoop(loopKF);

OptimizeGlobalMap();

}

5.1.2 内存管理和计算资源优化

SLAM系统在执行过程中会耗费大量内存和计算资源,特别是在处理高清图像和激光雷达数据时。优化内存使用和计算资源的策略通常包括:

- 数据压缩与预处理。

- 异步处理多线程任务。

- 优化算法以减少不必要的计算。

在代码层面,可以使用智能指针和内存池来管理动态分配的内存。对于线程管理,C++11的 std::thread 可以用于实现多线程处理,同时可以使用线程同步机制如 std::mutex 来避免竞态条件。

// 线程同步示例

std::mutex data_mutex;

void ProcessData() {

while(running) {

std::lock_guard<std::mutex> lock(data_mutex);

// 处理数据

}

}

5.1.3 实时性能的提升与硬件适配

实时SLAM对于机器人导航和自动驾驶系统至关重要。为了提升实时性能,可以采取以下策略:

- 算法简化和加速,如使用更快的特征提取算法。

- 并行计算和GPU加速。

- 对于嵌入式设备,选择轻量级的SLAM系统。

对于硬件适配,需要根据具体的计算平台(如CPU、GPU或FPGA)进行系统架构的调整,并优化数据传输路径,以减少延迟和提高处理速度。

5.2 应用领域展望

5.2.1 移动机器人中的应用实例

SLAM技术在移动机器人中的应用已经变得非常普遍。从室内清洁机器人到工业自动化中的搬运机器人,SLAM为其提供了实时定位和路径规划的能力。在实际应用中,机器人需要在一个未知的环境中自主导航并完成任务,SLAM技术使得这一切成为可能。

一个典型的移动机器人应用例子包括:

- 使用激光SLAM进行室内空间的建图和导航。

- 利用视觉SLAM在室外复杂环境中进行定位。

5.2.2 自动驾驶技术中的挑战与机遇

自动驾驶车辆依赖于高精度的定位与地图信息来保证行驶安全。SLAM技术能够为车辆提供实时的环境感知能力,帮助车辆理解并适应其周围的复杂交通环境。

挑战包括:

- 高精度的定位要求。

- 多传感器数据融合。

- 极端天气条件下的性能保持。

机遇则在于:

- SLAM技术的不断进步可以提升自动驾驶的安全性。

- 更高效的SLAM算法可以在较低成本下实现。

5.2.3 未来技术趋势与发展方向

随着机器学习和人工智能技术的发展,未来的SLAM系统将可能更加智能化。预计的发展方向包括:

- 深度学习与SLAM的深度融合,实现端到端的SLAM系统。

- 无监督和自监督学习在特征提取和匹配中的应用。

- 跨模态SLAM,将视觉、激光、IMU等不同传感器数据有效融合。

SLAM的未来是充满挑战但也充满机遇的。随着技术的进步,我们有理由相信,SLAM将会在更多领域展现其独特的价值,并推动相关产业的发展。

简介:ORB_SLAM3是机器人和自动驾驶领域中SLAM技术的最新进步,特别是在IMU数据融合和多地图管理方面。它通过深度整合IMU数据来提高定位稳定性和减少漂移,同时解决了大规模环境中的循环闭合问题。支持多传感器配置,包括单目、双目和鱼眼相机,ORB_SLAM3能够构建精确的地图并进行有效的视觉惯性里程计(VIO)估计。此外,它还优化了回环检测和内存管理,以适应不同的硬件平台,为移动机器人和自动驾驶提供了强大的技术支持。

980

980

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?