论文地址:https://arxiv.org/abs/1905.11946

代码地址:https://githeb.com/TensorFlow/tpu/tree/master/Models/Offical/Efficientnet

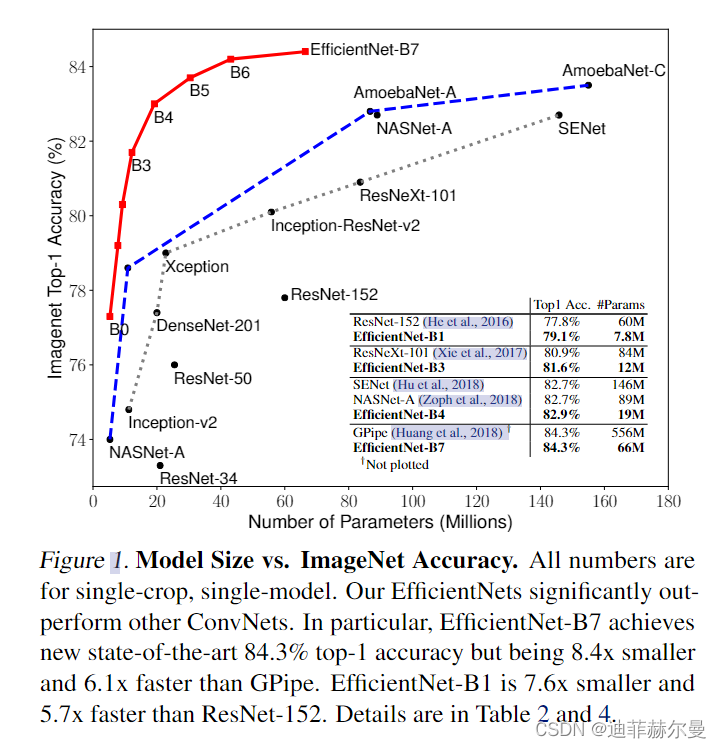

卷积神经网络(ConvNet)通常是在固定的资源预算下开发的,如果有更多的资源可用,则会扩大规模以获得更好的精度。在本文中,我们系统地研究了模型缩放,发现仔细平衡网络深度、宽度和分辨率可以带来更好的性能。基于这一观察结果,我们提出了一种新的缩放方法,该方法使用一个简单而高效的复合系数来统一缩放所有维度的深度/宽度/分辨率。我们演示了该方法在扩展移动网和ResNet上的有效性。更进一步,我们使用神经结构搜索来设计一个新的基线网络,并将其放大以获得一系列称为EfficientNets的模型,这些模型获得了比以前的ConvNets更高的精度和效率。特别是,我们的EfficientNet-B7在ImageNet上达到了最先进的84.3%的TOP-1准确率,同时比现有最好的ConvNet小8.4倍,推理速度快6.1倍。我们的EfficientNets在CIFAR-100(91.7%)、Flowers(98.8%)和其他3个迁移学习数据集上的迁移效果也很好,达到了最先进的准确率,参数减少了一个数量级。源代码在https://githeb.com/TensorFlow/tpu/tree/master/Models/Offical/Efficientnet

订阅专栏 解锁全文

订阅专栏 解锁全文

8794

8794

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?