深度学习模型常常使⽤丢弃法(dropout) 来应对过拟合问题。

图一

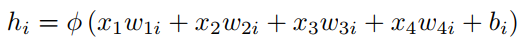

如上图所示,输⼊个数为4,隐藏单元个数为5,且隐藏单元hi(i = 1…5)的计算表达式为:

这⾥ϕ是激活函数, x1,x2,x3, x4是输⼊,隐藏单元i的权重参数为w1i,…, w4i,偏差参数为bi。

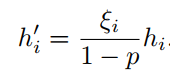

当对该隐藏层使⽤丢弃法时,该层的隐藏单元将有⼀定概率被丢弃掉。设丢弃概率为p,那么有p的概率hi会被清零,有1 − p的概率hi会除以1 − p做拉伸。丢弃概率是丢弃法的超参数。具体来说,设随机变量ξi为0和1的概率分别为p和1 − p。使⽤丢弃法时我们计算新的隐藏单元h′ i

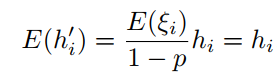

由于E(ξi) = 1 − p,因此

即丢弃法不改变其输⼊的期望值。

让我们对图一中的隐藏层使⽤丢弃法,⼀种可能的结果:h2和h5被清零,这时输出值的计算不再依赖h2和h5,在反向传播时,与这两个隐藏单元相关的权重的梯度均为0。

由于在训练中隐藏层神经元的丢弃是随机的,即h1,h2,h3,h4, h5都有可能被清零,输出层的计算⽆法过度依赖h1,h2,h3,h4, h5中的任⼀个。

那么每一个神经元的输入的权重值就会较为的平均,即给每一个权重都增加一些值,会产生收缩权重的平方范数的效果,从而完成预防过拟合的效果,这与正则化的效果类似。dropout的功能类似于L2正则化,与L2正则化不同的是,被应用的方式不同,dropout也会有所不同,甚至更适用于不同的输入范围。

在测试模型时,我们为了得到更加确定性的结果,⼀般不使⽤丢弃法。

参考:

1.2020-5-22 吴恩达-改善深层NN-w1 深度学习的实用层面(1.7 理解 Dropout–压缩权重/分层设置keep-prob)

2.《动手学深度学习》

3万+

3万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?