创新:

1.引入一个信息上界和一个互信息最小化正则项,鼓励每个模态的解纠缠表示用于SOD ; 2.运用非对称的特征提取器 ; 3.引入多模态的变分自编码器作为随机预测精细化的技术

引言:

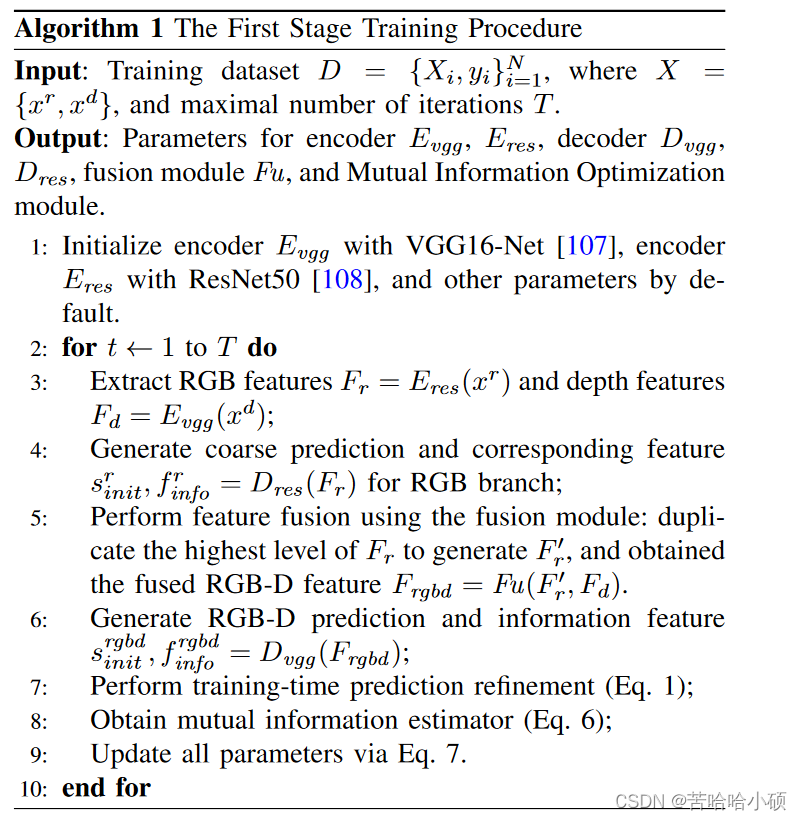

1.初始化训练估计-----VGG16、Resnet50配合解码器去生成初始化预测 ; 2.以互信息最小化作为正则化器的渐进预测精化-----首先使用基于最小生成树的在线预测精华技术--树能量损失从而获得结构精化预测;3.第二阶段预测精细化通过多模态变分自编码器---然后,为了充分挖掘多模态数据对弱监督学习任务的贡献,我们提出了基于互信息正则化的多模态互信息最小化,实现了去纠缠表示学习,以充分挖掘每个模态对RGB - D显著性检测的贡献。

相关工作:

1.针对所包含的噪声信息,提出对潜在噪声进行深度校准,并引入交叉参考模块将校准后的深度与RGB特征进行融合

2.用深度图的几何先验构建深度分解模块过滤RGB图像中的噪声

3.在相同的目标下,备选策略通常涉及一个辅助的深度估计模块或通过自监督学习的精化模块来实现几何信息的更好利用

4.图像监督提供粗略的前景定位,突出目标的判别性区域,涂鸦监督则更加精确且稀疏

5.Mutlimodal Mutual Information :互信息(Mutual Information)是度量两个事件集合之间的相关性(mutual dependence)。互信息是点间互信息(PMI)的期望值。互信息最常用的单位是bit。

6.考虑使用弱监督,预测精化在弱监督模型中被广泛采用,无论在训练还是后期处理中都进行了运用

提出的方法:

1.非对称的特征提取器架构,通过一个简单的编码器来提取输入数据对的特征并生成我们的初始预测。---》通过树能量损失和基于注意力的融合模块在训练过程中进一步细化初始预测---》互信息上界进行互信息最小化---》多模态变分自编码器的预测精化策略

2.Prediction refinement:由于涂鸦的笔记非常稀疏,直接用涂鸦的GT作为监督信号训练不足以恢复图像的结构信息,因此使用具有高维特征的输入RGB图像进行自监督学习来优化预测。将图像和特征转化为无向图

3.mutual information optimization:模态之间的交互式很重要,VGG更加关注细节,Res更加关注更多的目标区域。

2072

2072

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?