前言

目前大模型应用在这两年非常火热,常规下软体在使用的过程中直接利用API会非常的方便与便捷,并且结合对于平台的智能库等方式,能实现非常多的功能和使用。但在部分相对独立的环境中需要进行使用,则需要进行本地化的部署和安装,同时在未来可能对个人的垂类模型也会有一定的发展,对于公司与个人都值得去了解一下大模型的安装与使用。

预计学习内容如下:

- Ollama安装与基础使用

- 大模型可视化界面研究

- 大模型应用中RAG的使用

- 大模型应用中模型的微调

- 结合实际生产接口的开放

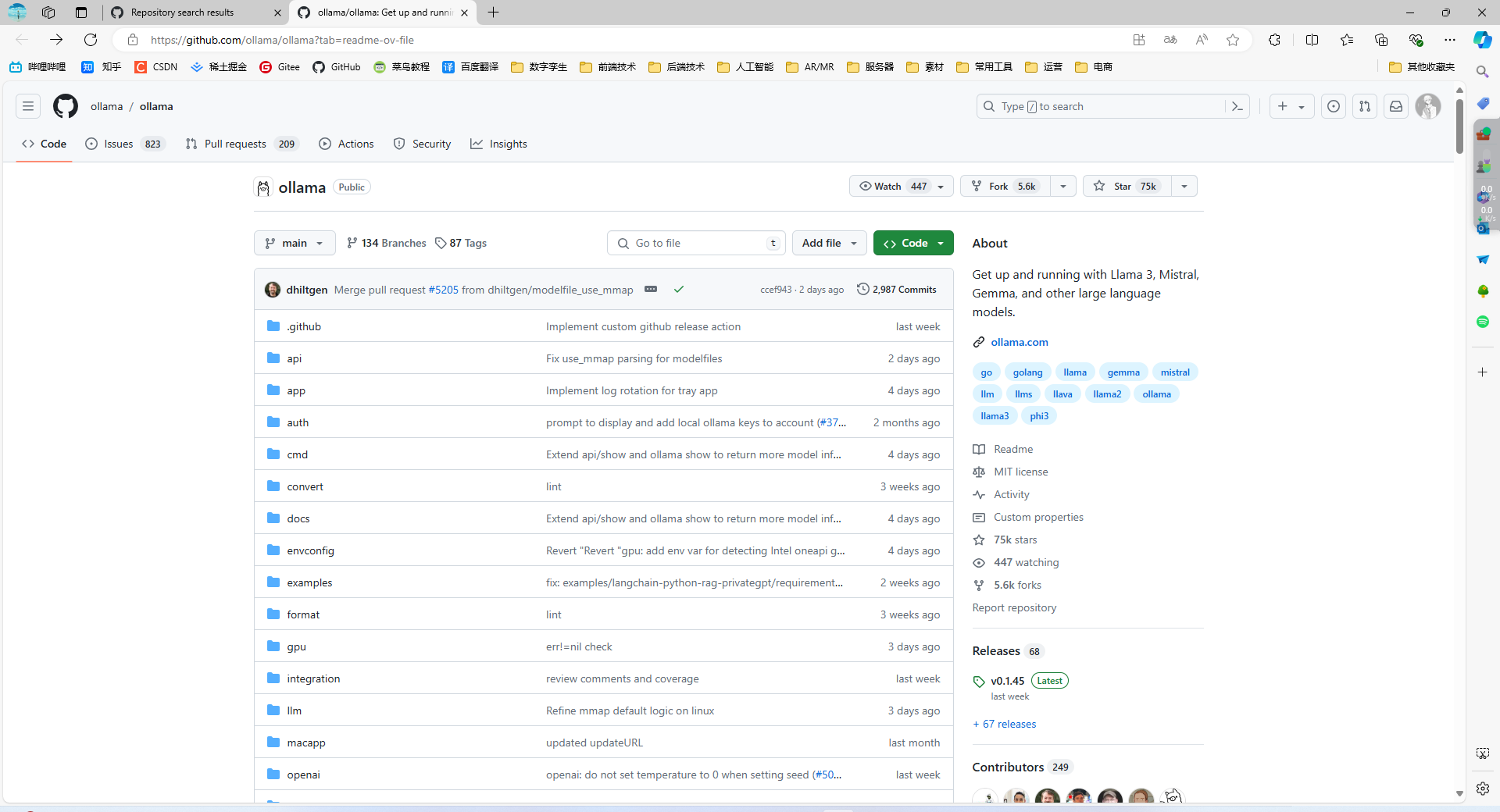

项目地址

官网地址:https://github.com/ollama/ollama?tab=readme-ov-file

环境安装

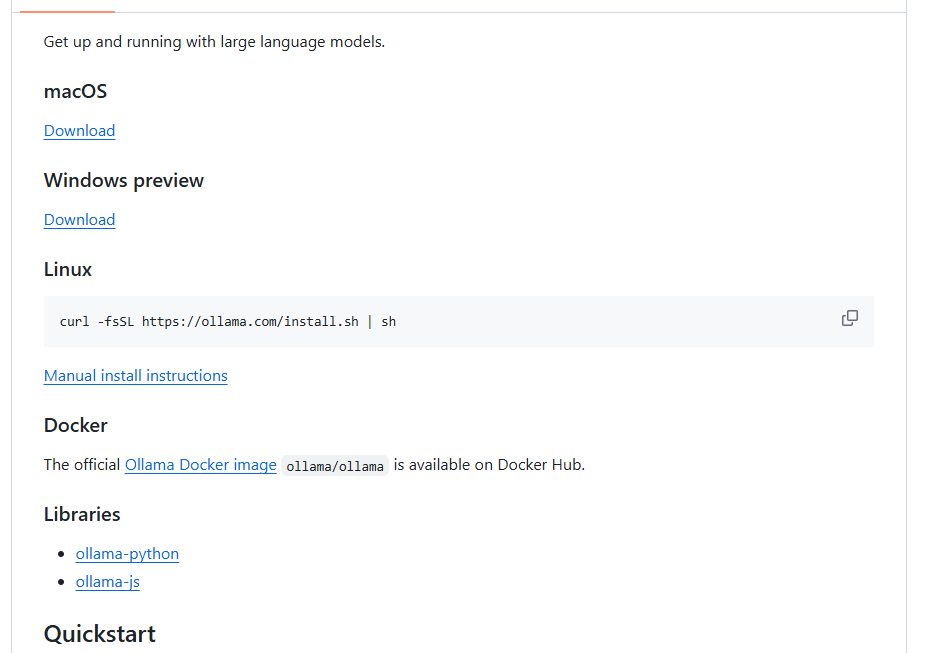

随着各式各样的内容发展,平台也进行了针对不同系统的安装包

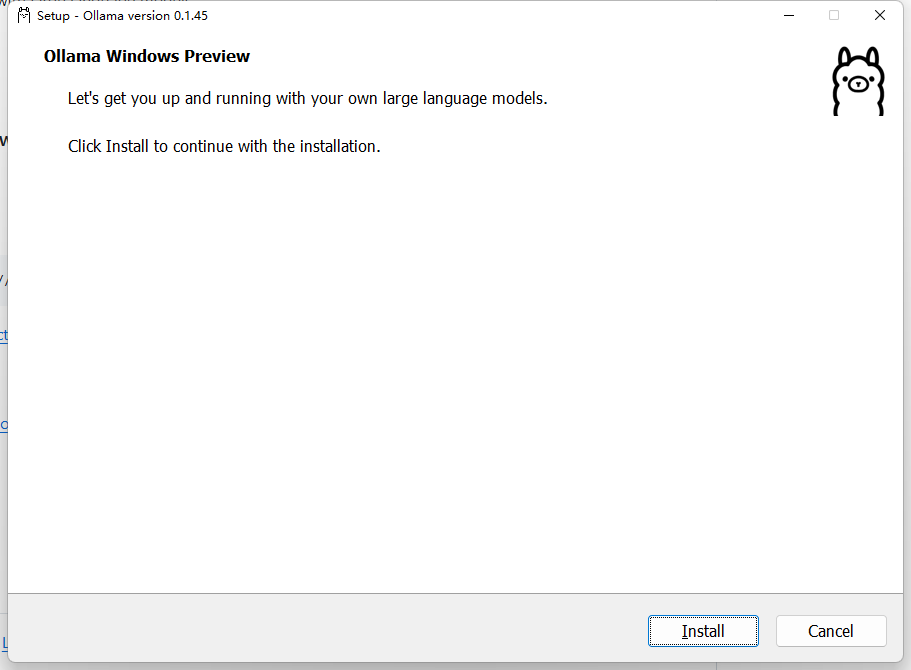

如果使用Docker进行部署是常见的方式,如果寻求方便的方式,可以直接下载对应的包,如Windows与macos系统

下载包默认会走向C盘,如果建议的朋友可以考虑使用docker或者使用工程的方式进行安装

说实话安装完后的图标还有点小可爱,哈哈哈。不懂后续作者是否会对这类内容进一步进行开发或者与其他项目尝试结合。

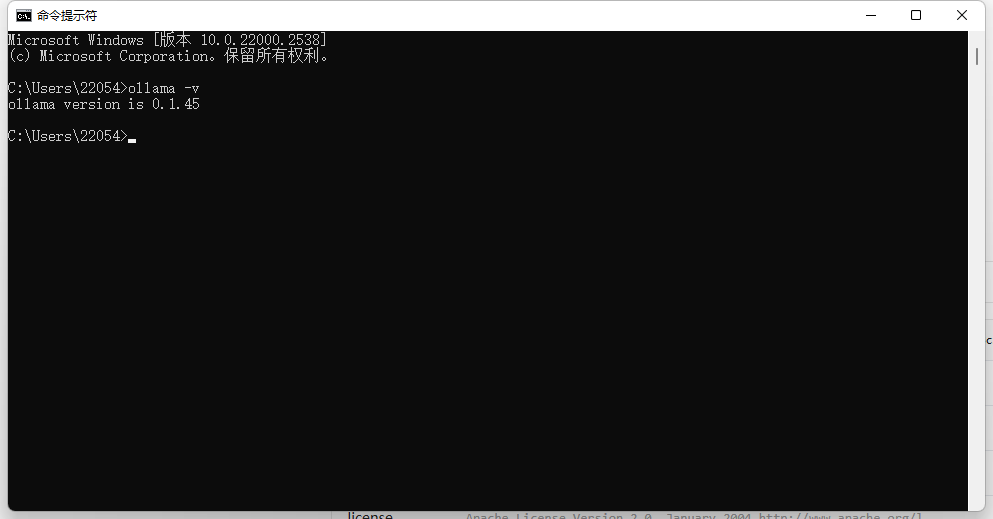

可用命令行进行版本与安装查看,执行如下脚本

ollama -v

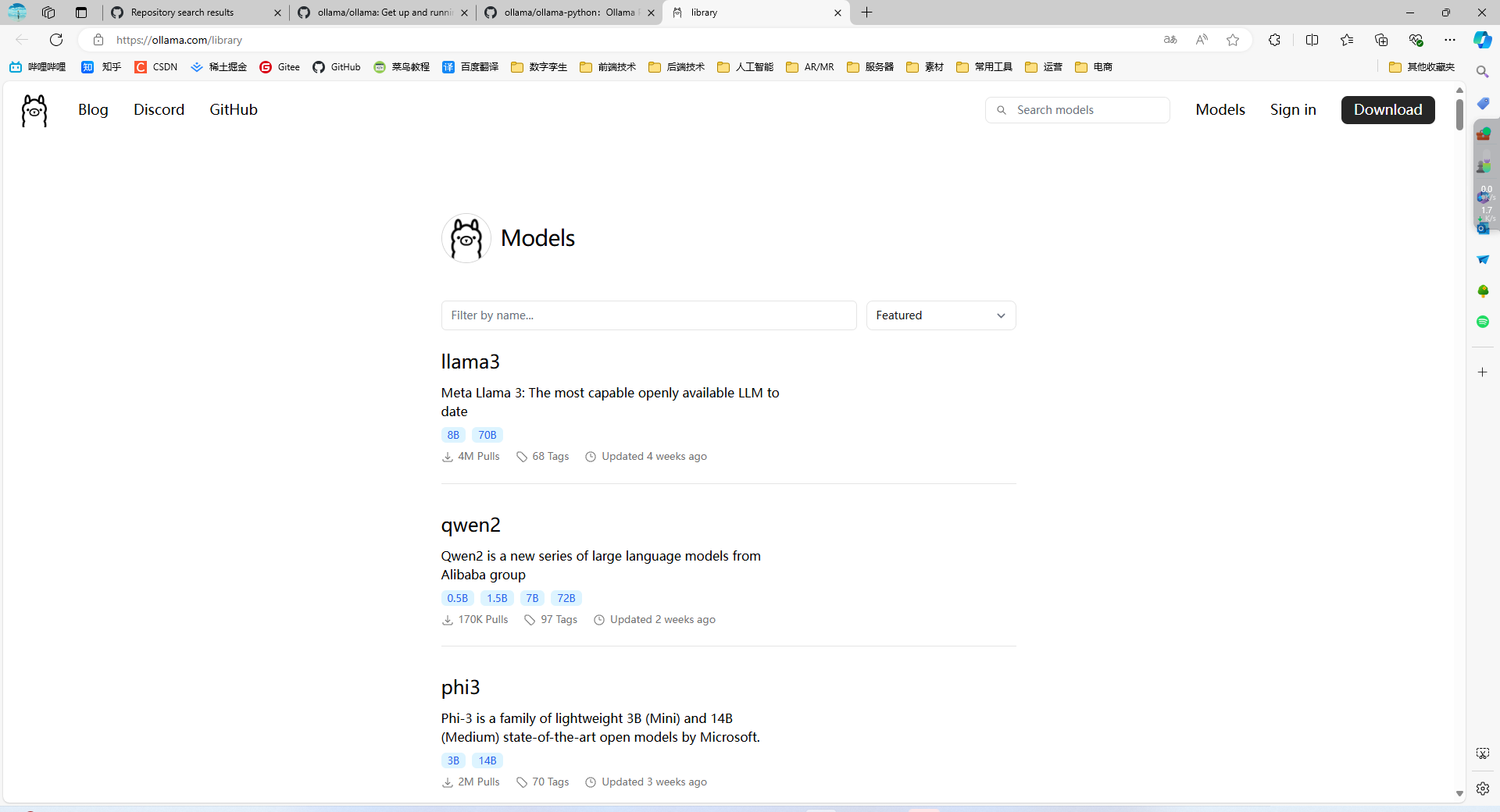

模型下载

安装完后,可根据自身电脑环境与需求,进行模型的下载与挑选。

地址:https://ollama.com/library

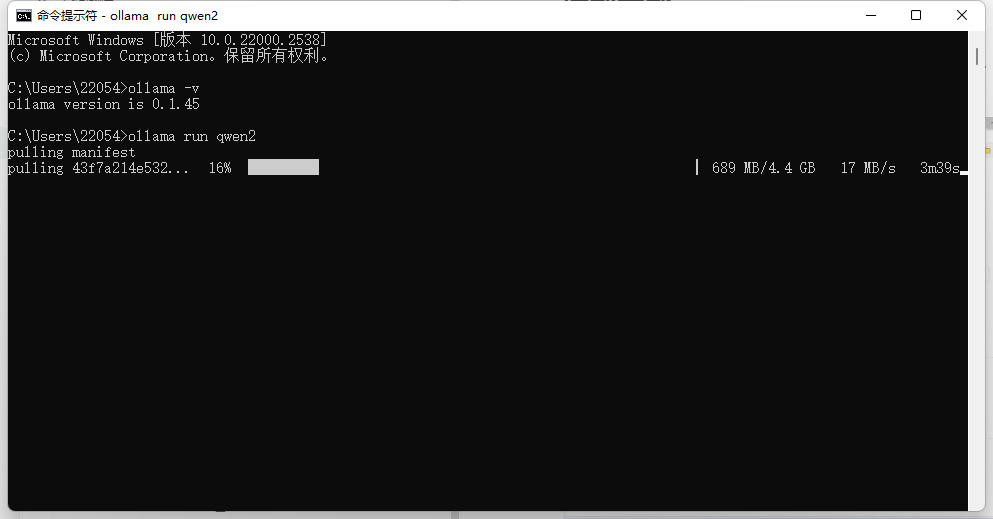

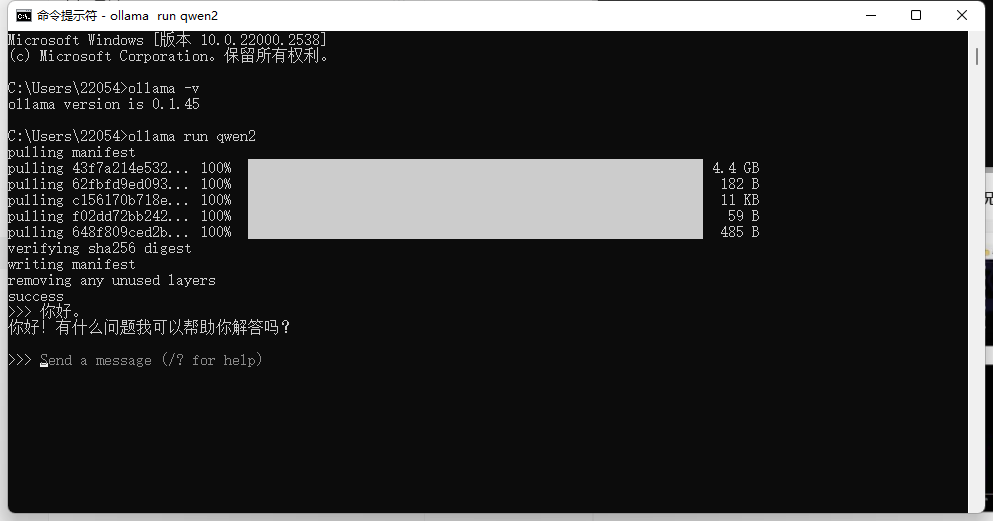

这边以最近比较火的qwen2进行测试,执行如下脚本

ollama run qwen2

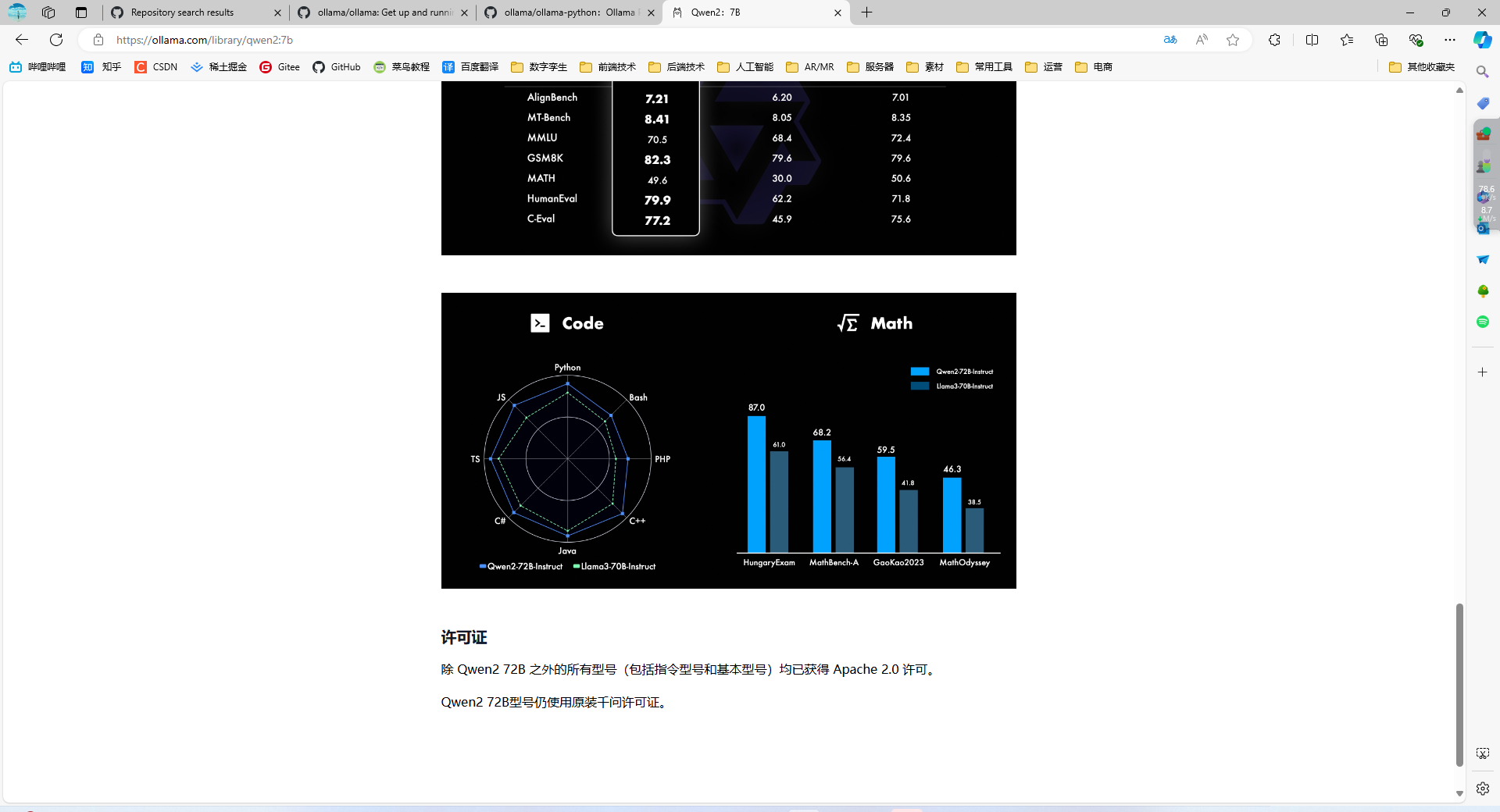

对于部分平台或者公司使用,可以在详情中了解一下授权情况

使用

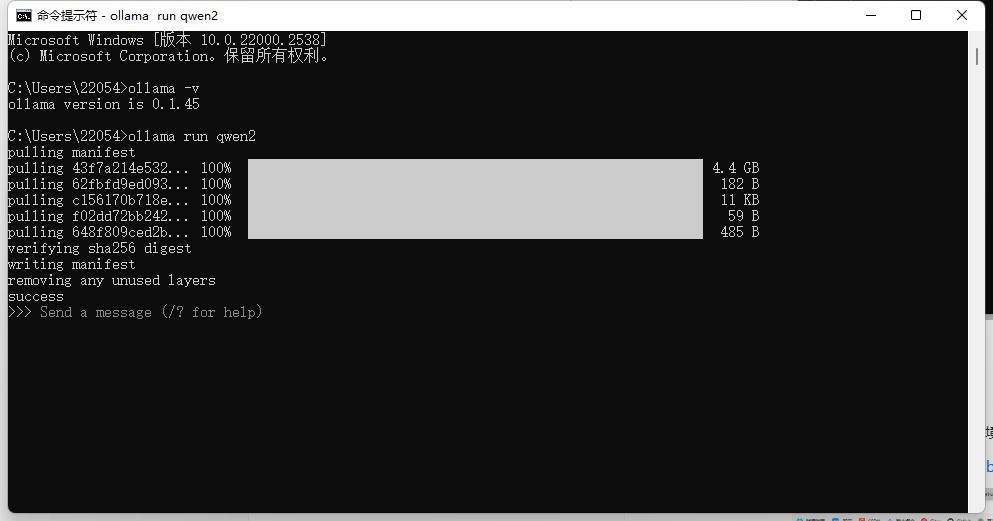

窗口聊天

qwen2 为自己选中的模型

ollama run qwen2

使用CTRL+D可以退出当前对话

接口使用

在真正的使用过程中,可能还是使用python/js或者其他的方式进行操作的相对多一些,这边只是一个示例。

python操作参考:https://github.com/ollama/ollama-python

js操作参考:https://github.com/ollama/ollama-js

curl http://localhost:11434/api/generate -d '{

"model": "qwen2",

"prompt":"你好"

}'

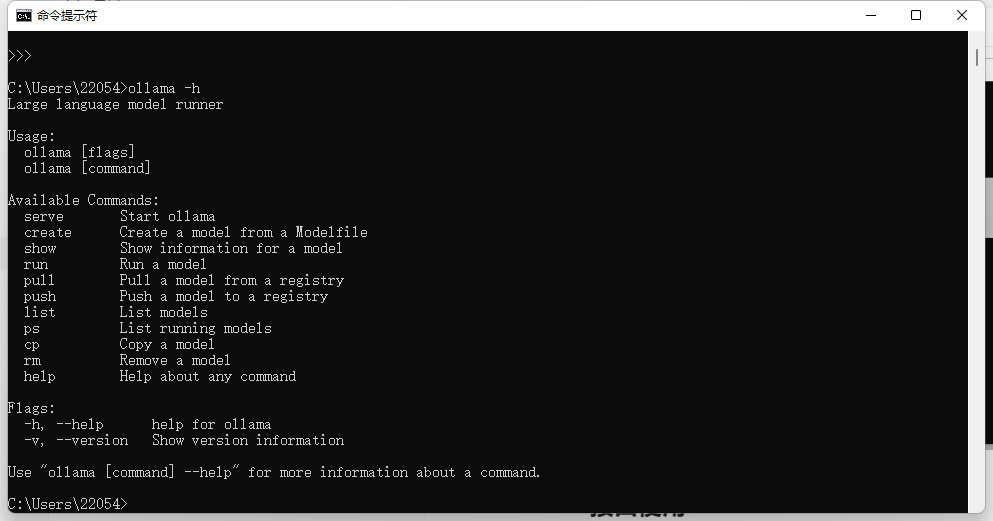

其余

ollama -h

小结

这部分内容相对简单,主要是了解和开始对大模型应用进行一些简单的尝试,当然在现在的使用环境下,无论使用国产的大模型体验还是国外的大模型体验,大部分家庭中的电脑推理体验是不如公司给出的体验,但在未来垂类和定制的模型是值得去细化了解的,与AI绘图,AI歌曲一样,期待未来会有着许多新的应用呈现。

1265

1265

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?