A FREQUENCY PERSPECTIVE OF ADVERSARIAL ROBUSTNESS

这是非常新的一篇文章。来自University of Maryland和Facebook AI Research。

摘要

本文最核心的观点就是:

对抗样本是高频噪声,这一个观点是一个误解。

本文的分析表明,对抗样本既不是高频,也不是低频,而是依赖于数据集。

预备知识

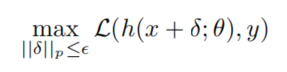

首先本文是说明了一下DCT变换,以及对抗样本的基本公式。

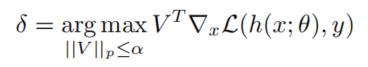

懒得打公式就直接截图了。

DCT

对抗样本表示

就是为了寻找一个扰动

δ

\delta

δ

V

T

V^T

VT表示的最速下降方向

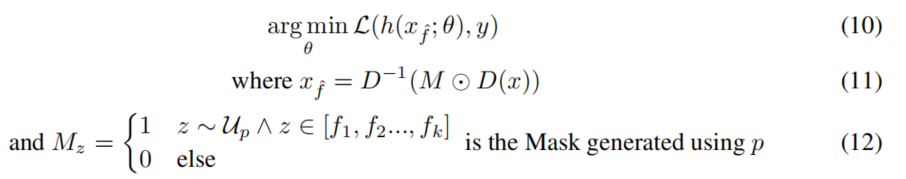

为了进行频域的分析,本文提出了DCT-PGD,

这个的做法其实就是将获得的梯度方向进行DCT变换,然后使用M做哈达玛积,可以使用一个S,筛选想要的频率,从而限制添加的扰动噪声所属于的频率带。然后做DCT逆变换。

在频域中对抗样本的性质

看图。(a)是在不同数据中,扰动梯度的DCT系数的均值。上一排是正常训练,下一排是对抗训练。

可以看出不同数据集的平均扰动,在频域上游明显差异。在cifar-10,正常训练时扰动是集中在高频。TinyImageNet和ImageNet则是集中在低频区域。但是随着对抗训练,所有的扰动都转移,倾向于集中在低频区域。

因为扰动的DCT内容与数据集高度依赖,因此不能够仅基于训练就对抗性样本的频率性质进行一般性的讨论。

对抗训练将模型的扰动高频信号平移到低频信号,并不准确。

为了验证这种现象只与数据集有关,在其他架构和不同大小的图像和不同的攻击方式进行实验。

测量频率分量的重要性

本文通过限制扰动的频率

f

f

f的区域,在不同频率区域的时候的对抗样本攻击成功率作为频率分量重要性的度量指标。

可以看出对于不同的数据集,不同区间频域分量的贡献度,并没有呈现出规律。

在训练时频率分量的重要性

这一做法,是在训练阶段就去除图像的一部分频域分量。

可以从以往的论文得知,0-15的频率分量对模型的影响更大。这种行为是可以预期的。毕竟学过数字图像就懂。

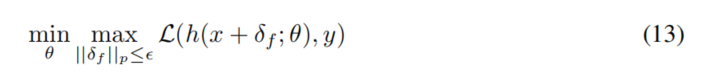

基于频域扰动的对抗训练

为了分析频域对抗扰动的鲁棒性,使用特定频率段的扰动,进行对抗训练。

下图为训练使用频率和攻击频域的准确率热图。

不同频率分量对抗训练对模型鲁棒性的贡献

怎么说呢。

PGD是一种对抗攻击。也就是多步迭代的FGSM。

不同频率分段的对抗训练对模型的鲁棒性和原始clean 准确率的影响不同。

然后是

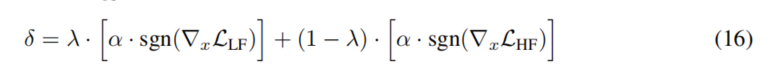

使用一个超参KaTeX parse error: Undefined control sequence: \lamba at position 1: \̲l̲a̲m̲b̲a̲控制对抗训练使用的频率值

LH是低频,HF就是高频。

结论

本文从频域的角度来分析了对抗样本的鲁棒性,表面了对抗样本不仅仅是一种高频现象。

本文有非常多的实验部分,没什么理论分析,就是描述一种现象。深度学习,是这样的。

说明了,对抗样本的噪声扰动的组成频率只与数据集相关。

实验看看就行,核心观点就是:

对抗扰动只与数据集有关。

3130

3130

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?