目录

一、线性模型与回归

线性模型一般形式:

![]()

其中x=(x1, x2, ..., xd)是由d维属性描述的样本,其中 xi是 x 在 第 i 个属性上的取值。

向量形式可记为:

其中w=(w1, w2, ..., wd)为待求解系数给定数据集 D={(x1, y1), (x2, y2), ..., (xm, ym)} 其中xi=(xi1, xi2, ..., xid), yi

R

R

举个简单的例子来说明,西瓜好坏的判定因素,x1,x2,x3…就可以分别用来指代,西瓜的色泽、根蒂和敲声,而w1、w2、w3…分别为其所对应的系数,系数越大说明该属性越重要。

二、多元线性回归问题

给定数据集:

通过属性的线性组合来进行预测的函数,

这样我们的在上面的公式就可以化成下面这个公式:

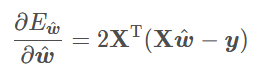

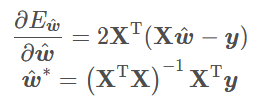

对于这里我们求取极值只需求一次导数,并令该导数为0计算极值点w

上式可得

的闭解/解析解。

的闭解/解析解。

三、Logistic回归

1.基于Logistic回归和Sigmoid函数的分类

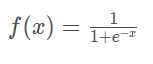

我们要做的是二值型输出分类器,即有0和1。将因变量可能属于的两个类分别称为负向类和正向类,其中 0 表示负向类,1 表示正向类。Sigmoid函数公式:

为了实现Logistic回归分类器,我们可以将每个属性乘上一个回归系数,再把所有结果之相加,将这个综合代入Sigmoid函数中,得到值域为[0,1]。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

958

958

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?