这篇论文的标题是《DGMamba: Domain Generalization via Generalized State Space Model》,作者是Shaocong Long, Qianyu Zhou, Xiangtai Li, Xuequan Lu, Chenhao Ying, Yuan Luo, Lizhuang Ma, 和 Shuicheng Yan。论文主要研究的是域泛化(Domain Generalization, DG)问题,旨在解决不同场景中的分布偏移问题。现有的方法主要基于卷积神经网络(CNNs)或视觉变换器(ViTs),但这些方法存在接收场有限或计算复杂度过高的问题。而Mamba作为一种新兴的状态空间模型(SSM),具有优越的线性复杂性和全局接收场。然而,Mamba在处理分布偏移问题时存在隐藏状态问题和不适当的扫描机制,难以直接应用于DG。

关键点和主要贡献:

-

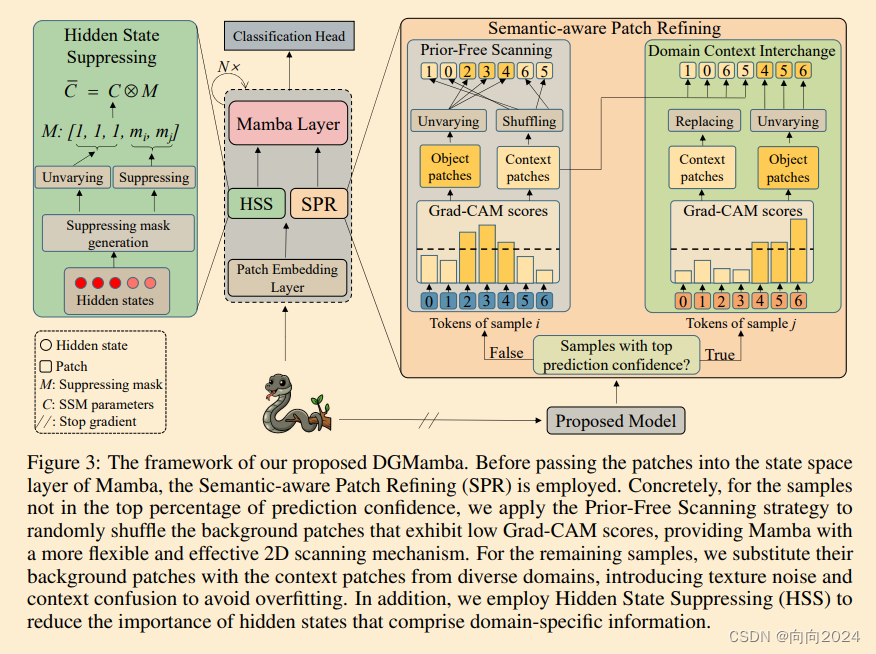

DGMamba框架:提出了一个新的DG框架,名为DGMamba,它在保持全局接收场和高效线性复杂性的同时,具有很强的泛化能力,能够适应未见过的领域。

-

核心组件:DGMamba包含两个核心组件:隐藏状态抑制(Hidden State Suppressing, HSS)和语义感知补丁细化(Semantic-aware Patch Refining, SPR)。HSS旨在减少输出预测中与领域特定特征相关的隐藏状态的影响,而SPR则鼓励模型更多地关注对象而非上下文。

-

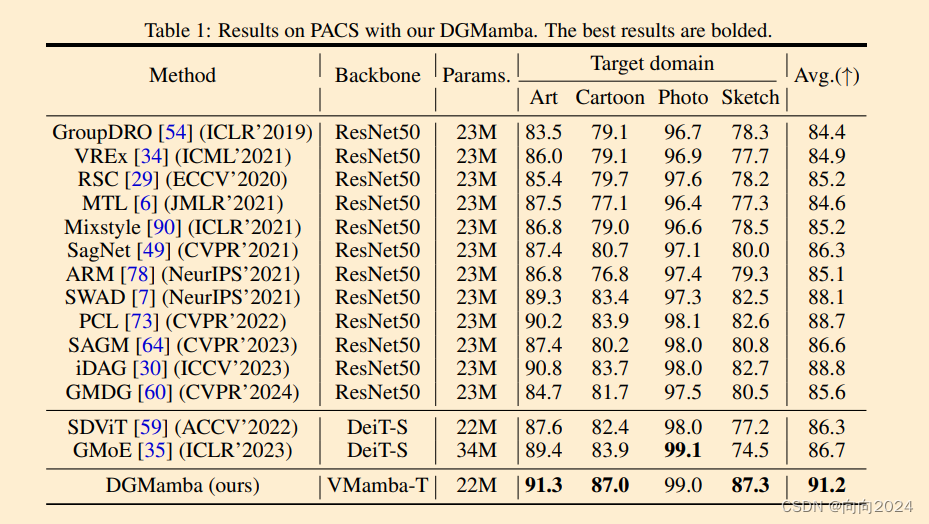

实验验证:在四个常用的DG基准数据集上进行了广泛的实验,证明了DGMamba在性能上超越了现有的最先进模型。代码将在GitHub上公开。

具体方法和技术:

-

隐藏状态抑制(HSS):通过识别并抑制那些包含领域特定信息的隐藏状态,来减少这些信息对模型泛化性能的负面影响。

-

语义感知补丁细化(SPR):包括两个设计:无先验扫描(PriorFree Scanning, PFS)和领域上下文交换(Domain Context Interchange, DCI)。PFS旨在通过随机洗牌图像中的非语义补丁,创建更灵活有效的图像序列。DCI通过在领域间融合补丁来引入局部纹理噪声和上下文混淆,从而增强模型对领域不变特征的学习。

总结:

DGMamba通过结合HSS和SPR,有效地提高了模型对未见领域数据的泛化能力。实验结果表明,DGMamba在多个DG基准数据集上都取得了显著的性能提升,证明了其在解决分布偏移问题上的有效性和优越性。此外,DGMamba的线性复杂性和全局接收场特性使其在实际应用中具有潜在的优势。未来的工作可能会探索如何利用特征提示或领域提示来进一步指导基于SSM的模型学习更强大的表示,以及在高结构任务中深入研究Mamba架构以解决分布偏移问题。

1702

1702

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?