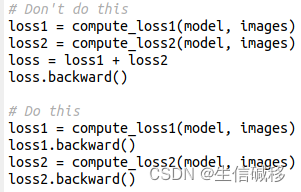

有个简单的PyTorch技巧能让GPU内存使用减半(或者将批次大小翻倍)。

如图所示,与其累加所有损失后再计算反向传播,不如对每个损失分别计算反向传播,这样可以释放计算图,并且最后的结果是一样的。

限制:这个方法只在你有多个损失,且计算图互不干扰时有效。

好处:损失越多,节省的内存就越多。

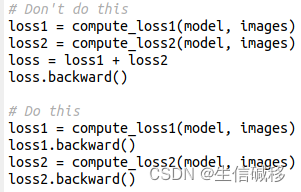

有个简单的PyTorch技巧能让GPU内存使用减半(或者将批次大小翻倍)。

如图所示,与其累加所有损失后再计算反向传播,不如对每个损失分别计算反向传播,这样可以释放计算图,并且最后的结果是一样的。

限制:这个方法只在你有多个损失,且计算图互不干扰时有效。

好处:损失越多,节省的内存就越多。

5491

5491

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?