基础作业 (结营必做)

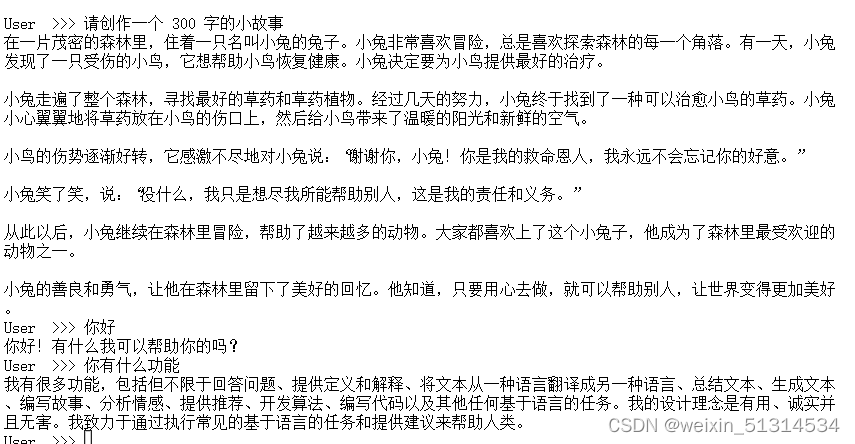

- 使用 InternLM2-Chat-1.8B 模型生成 300 字的小故事(需截图)

进阶作业:

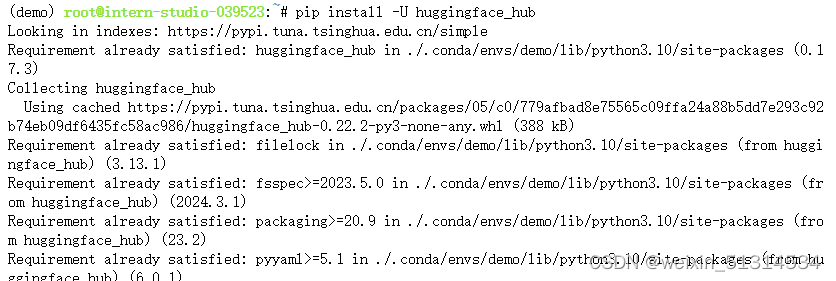

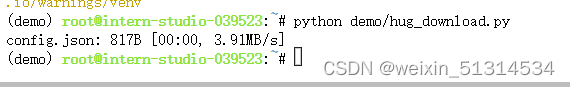

熟悉huggingface下载功能,使用huggingface_hub python包,下载InternLM2-Chat-7B的config.json文件到本地(需截图下载过程)

使用 Hugging Face 官方提供的 huggingface-cli 命令行工具。安装依赖:

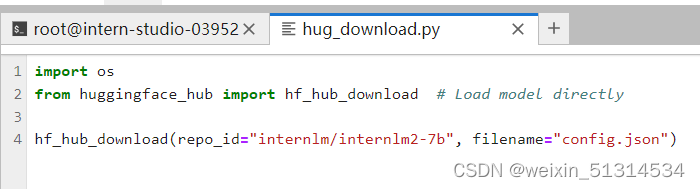

然后新建 python 文件,填入以下代码,运行即可。

以下内容将展示使用 huggingface_hub 下载模型中的部分文件

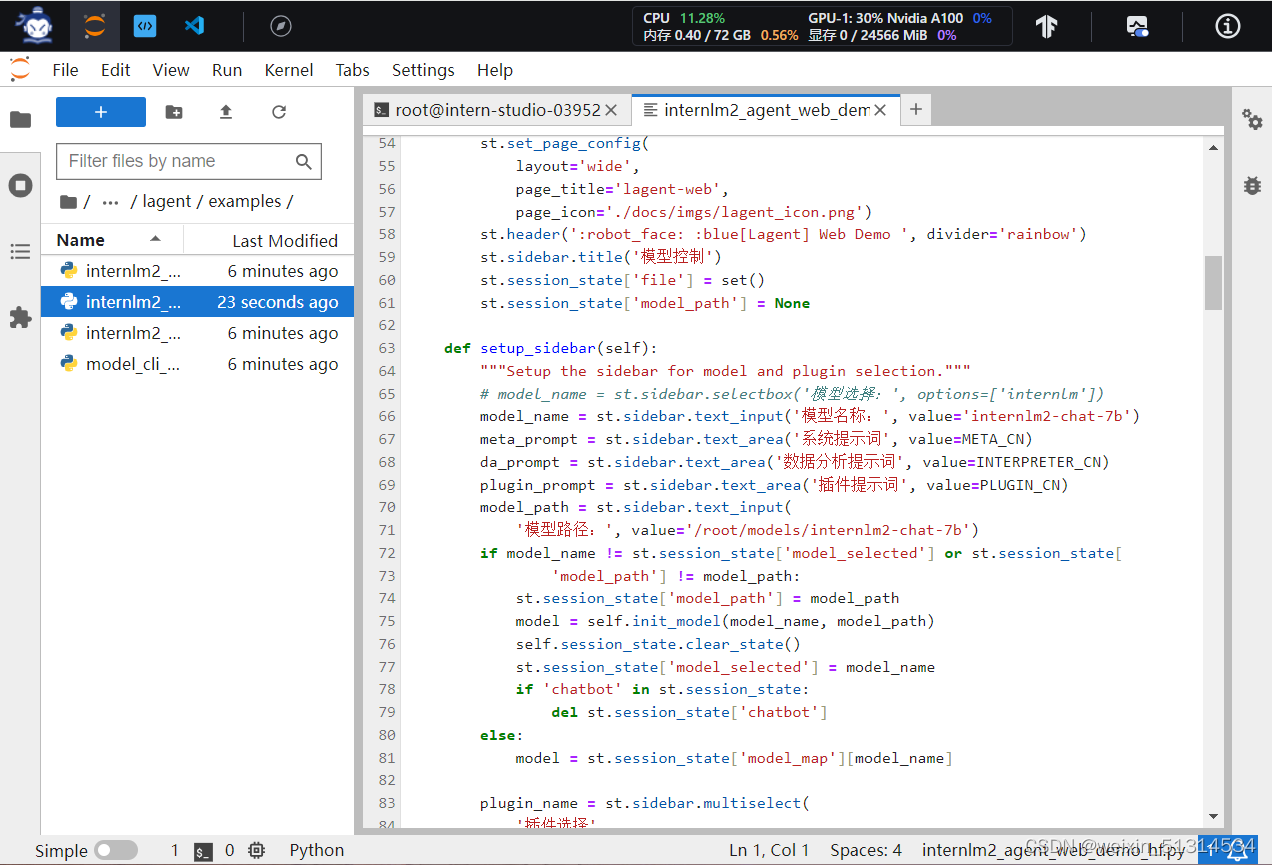

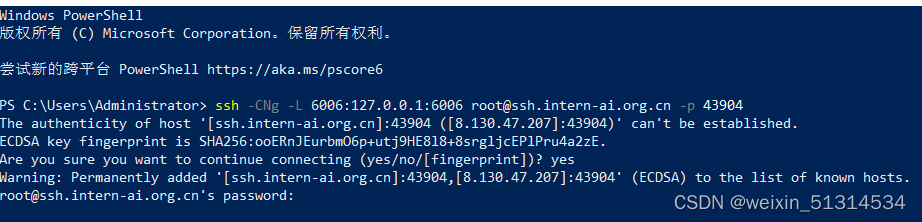

完成 Lagent 工具调用 数据分析 Demo 部署(需截图)

4.1 初步介绍 Lagent 相关知识

Lagent 是一个轻量级、开源的基于大语言模型的智能体(agent)框架,支持用户快速地将一个大语言模型转变为多种类型的智能体,并提供了一些典型工具为大语言模型赋能。

Lagent 的特性总结如下:

- 流式输出:提供 stream_chat 接口作流式输出,本地就能演示酷炫的流式 Demo。

- 接口统一,设计全面升级,提升拓展性,包括:

- Model : 不论是 OpenAI API, Transformers 还是推理加速框架 LMDeploy 一网打尽,模型切换可以游刃有余;

- Action: 简单的继承和装饰,即可打造自己个人的工具集,不论 InternLM 还是 GPT 均可适配;

- Agent:与 Model 的输入接口保持一致,模型到智能体的蜕变只需一步,便捷各种 agent 的探索实现;

- 文档全面升级,API 文档全覆盖。

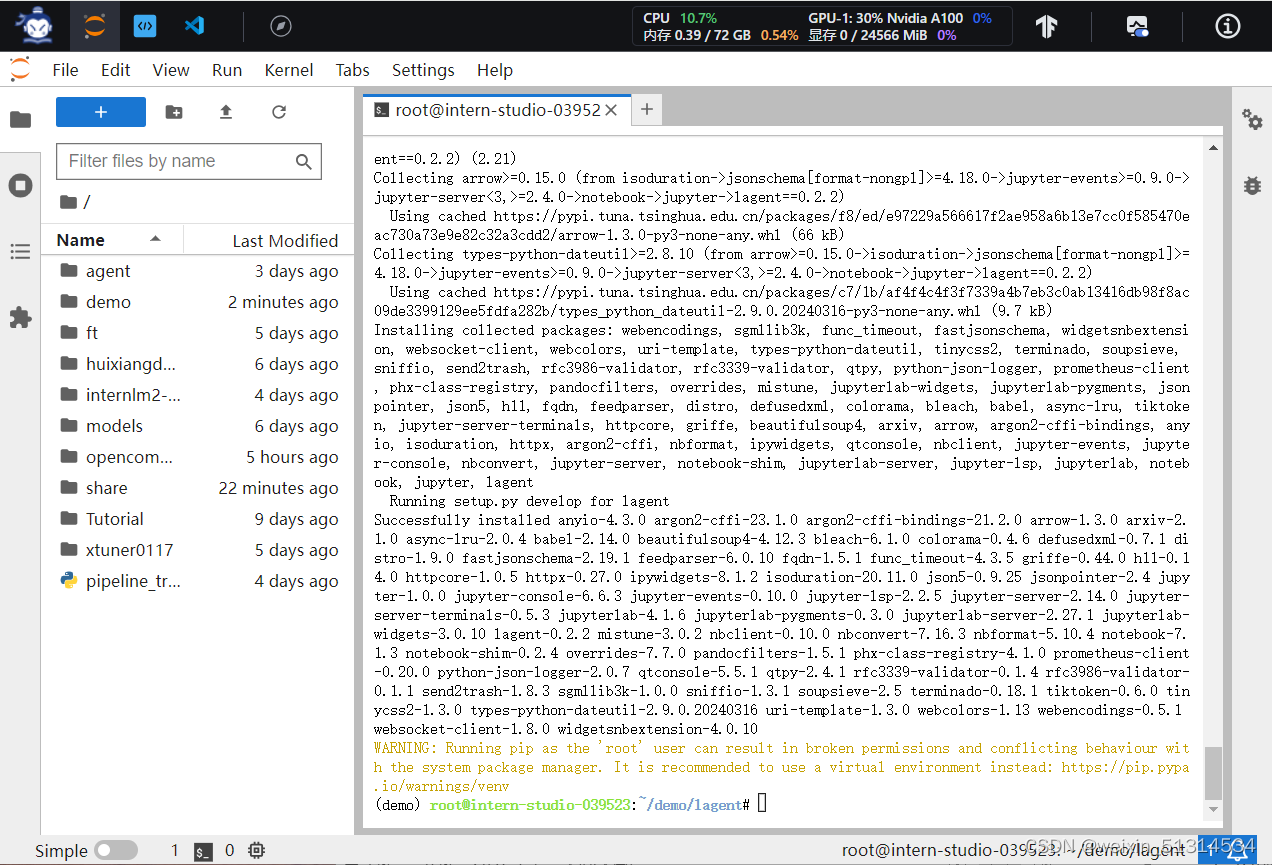

4.2 配置基础环境

使用 git 命令下载 Lagent 相关的代码库,运行效果如图:

4.3 使用 Lagent 运行 InternLM2-Chat-7B 模型为内核的智能体

Intern Studio 在 share 文件中预留了实践章节所需要的所有基础模型,包括 InternLM2-Chat-7b 、InternLM2-Chat-1.8b 等等。我们可以在后期任务中使用 share 文档中包含的资源,但是在本章节,为了能让大家了解各类平台使用方法,还是推荐同学们按照提示步骤进行实验。

1818

1818

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?