一、PyTorch是什么?

1.开源机器学习框架

2.两大优势:支持GPU加速的张量(Tensor,类似于NumPy的array)运算,基于tape-based autograd3系统建立深度神经网络

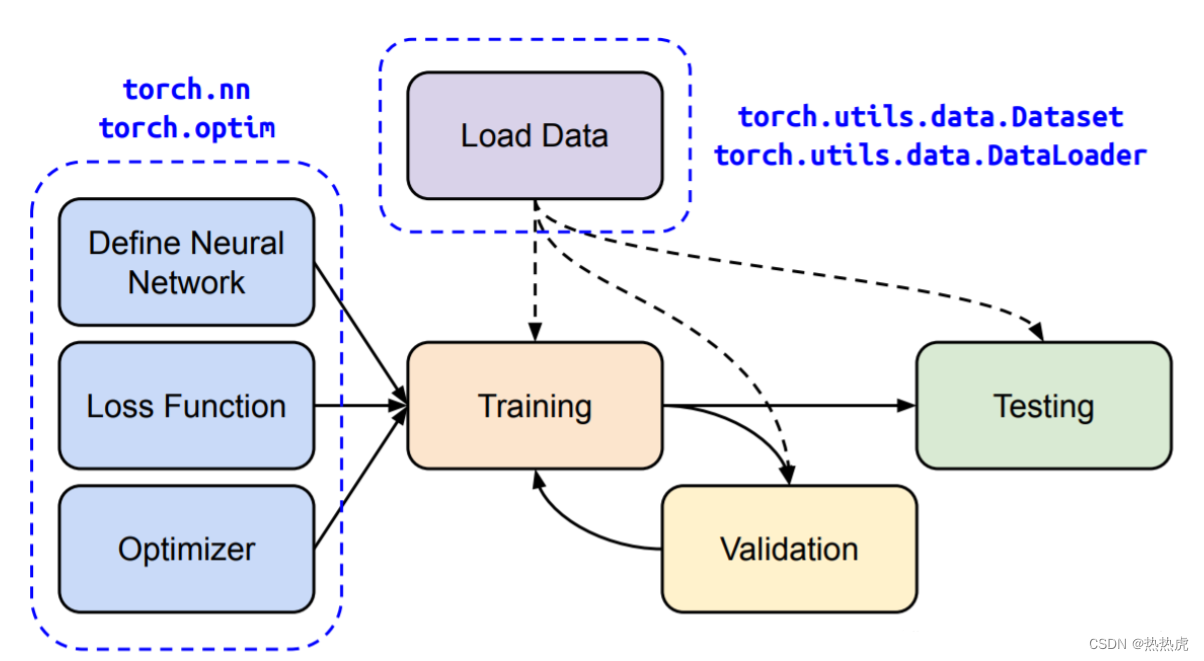

二、Training

在训练的时候还需要时不时停下来做模型验证(数据集分为训练集、验证集和测试集),然后再training,重复多次,一直做到某个程度才可以testing。

在测试之前就要把资料准备好为给module,准备资料就需要写好dataset和dataloader。

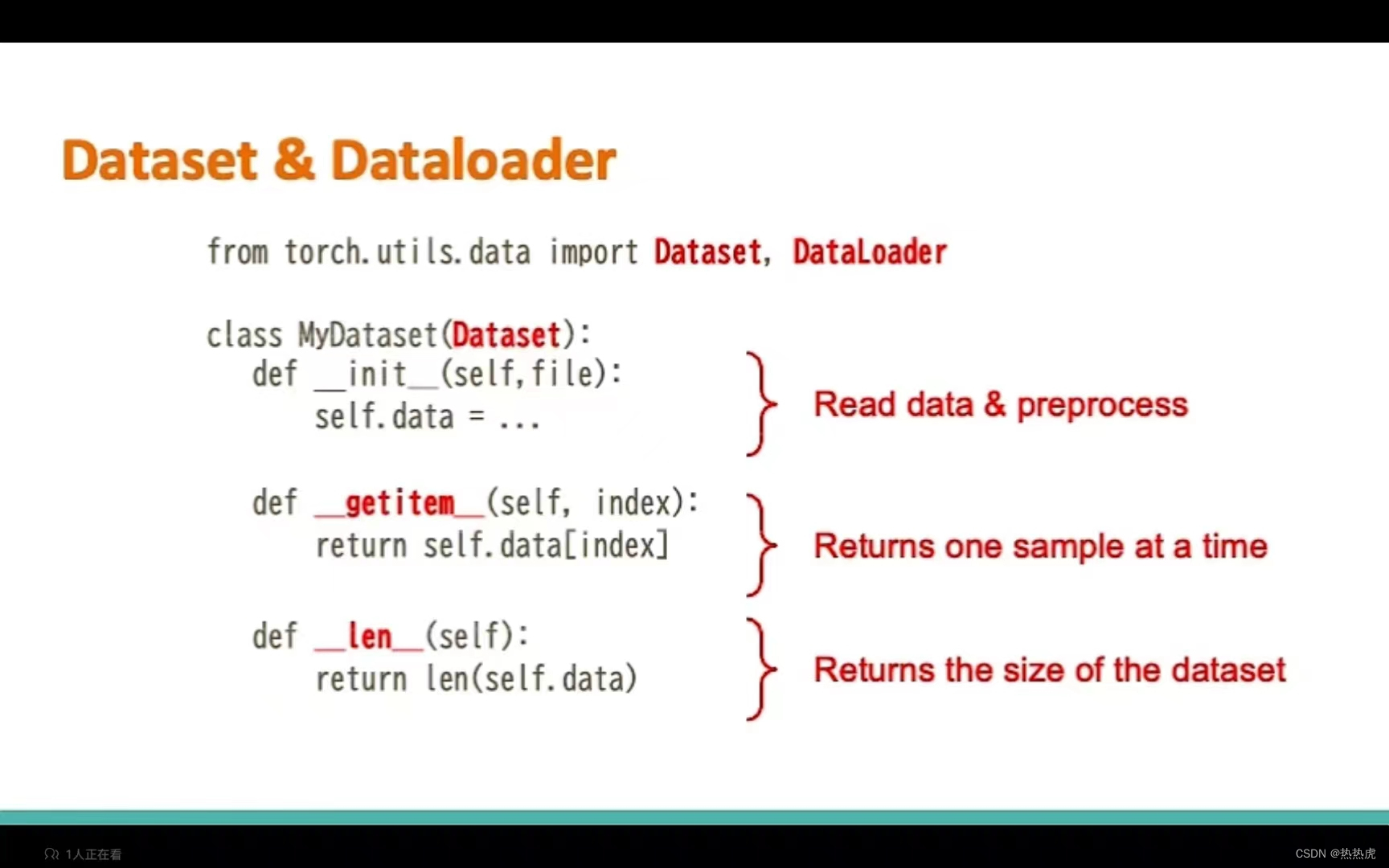

dataset:存储数据样本和预期值

dataloader:帮助将数据加载到模型中进行训练。

第一个function是把数据读进来并且进行预处理

第二个function是把已经读进来的data把其中的一笔资料回传回去,一次返回一个样本

第三个function是返回数据集的大小

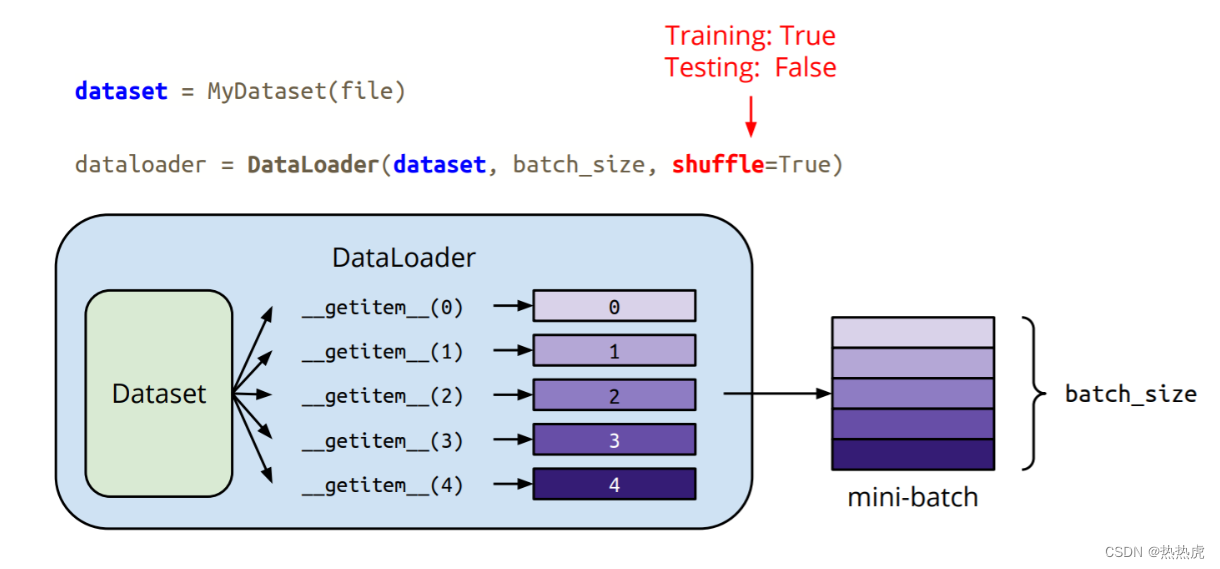

在读进dataset的时候,把它丢到dataloader中,设置长度是5,不shuffle data,否则每次结果都不一样。dataloader会依序把dataset里的data都拿出来,把得到的这5笔资料合起来得到一个batch(批次,用来指代一组输入样本同时输入模型进行训练或推断的数据集合)

三、Tensors

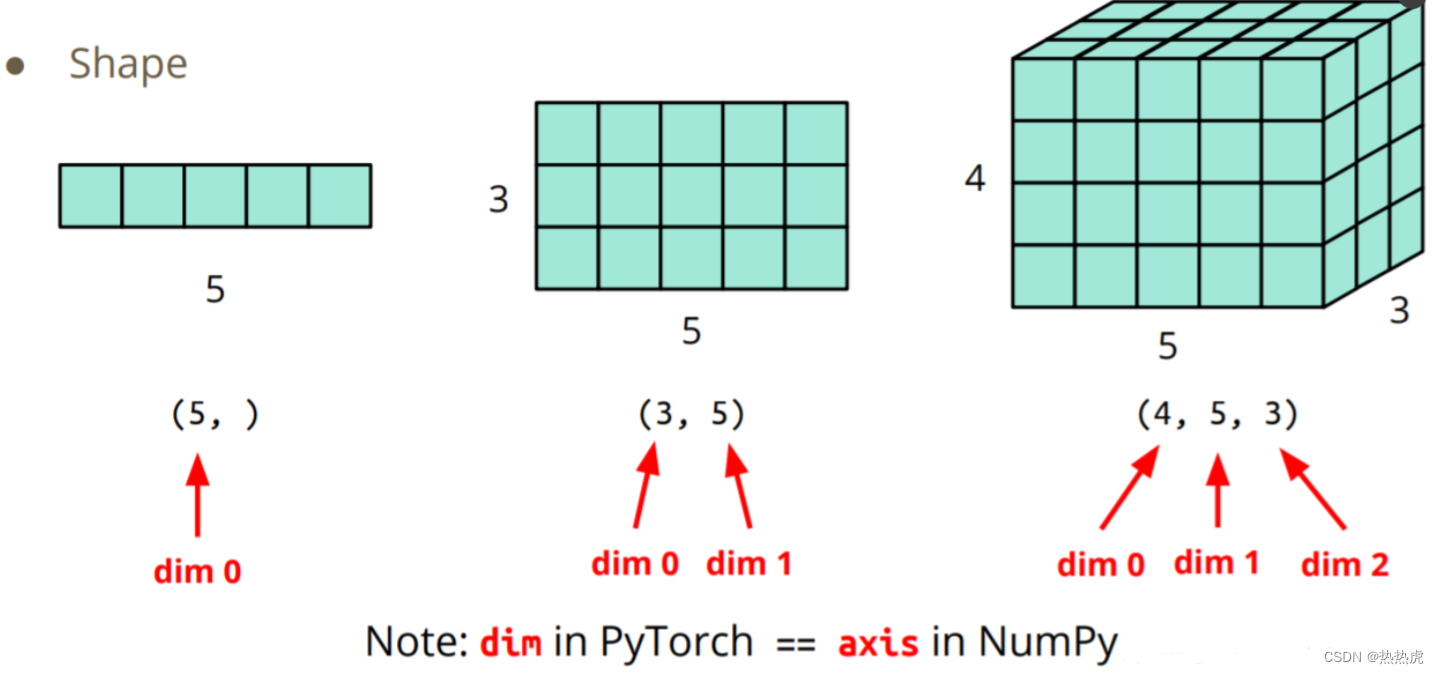

资料读进来后存储在机器上的形式就是tensors。

(张量tensors是多维数组的推广,是向量(一维数组)、矩阵(二维数组)等的高维形式。在神经网络和深度学习中,所有的数据都表示为张量,包括输入数据、权重、偏置、激活值等都以张量的形式存储和处理。)

它的维度如果是声音,就是一维的。如果是黑白照片就是二维的,如果是rgb的图片就是三维的。

四、creat tensors

有很多种方法可以产生tensors

可以把一个已经存在的list或者Numpy array转成一个tensor

或者指定一个大小去产生一个内容全是0或1的tensor

五、tensor的常见操作

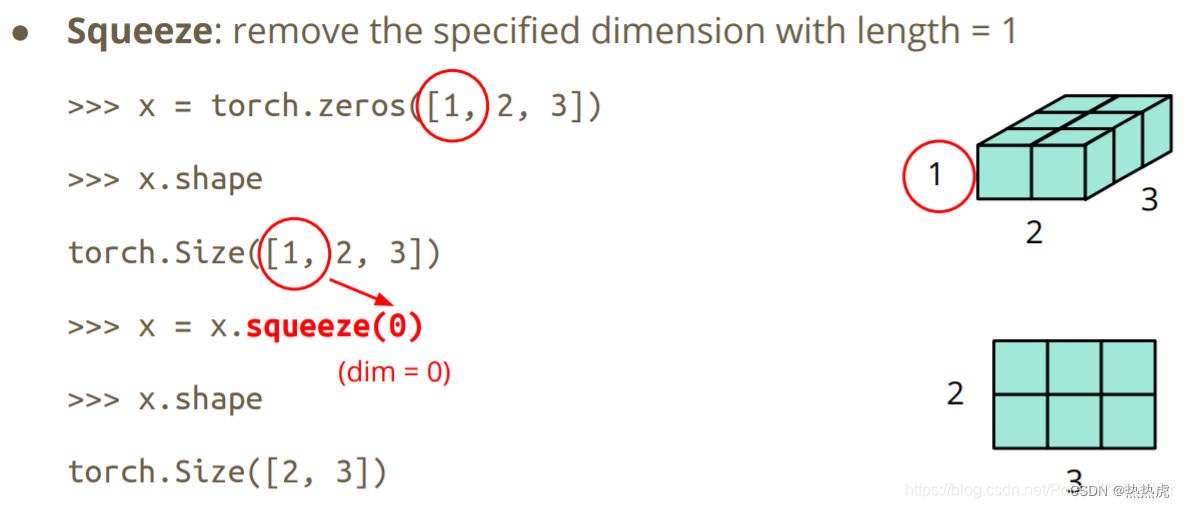

1.squeeze() 把长度为1的维度去掉

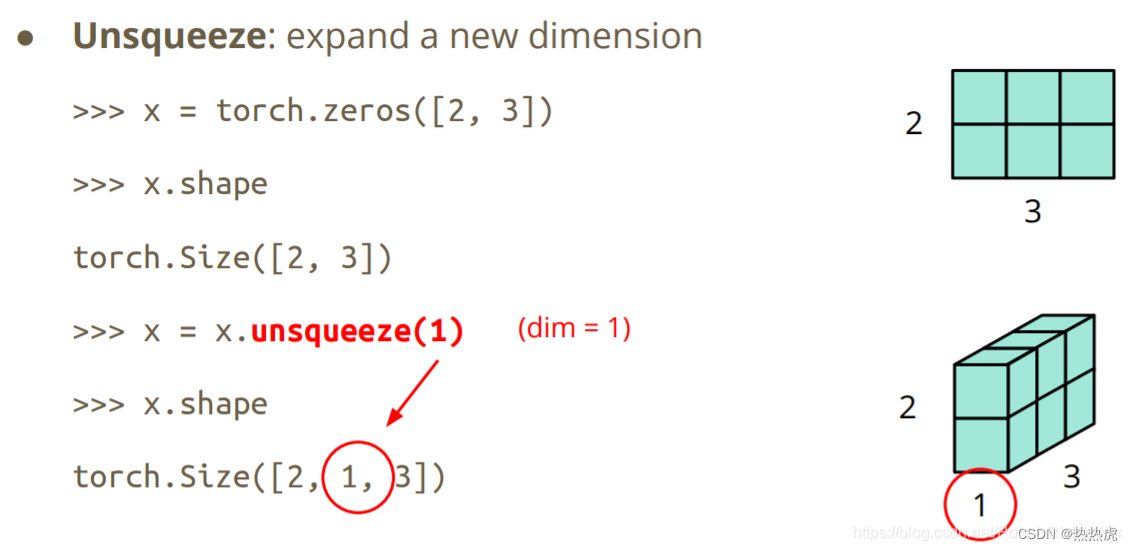

2.unsqueeze() 新增长度为1的一个维度

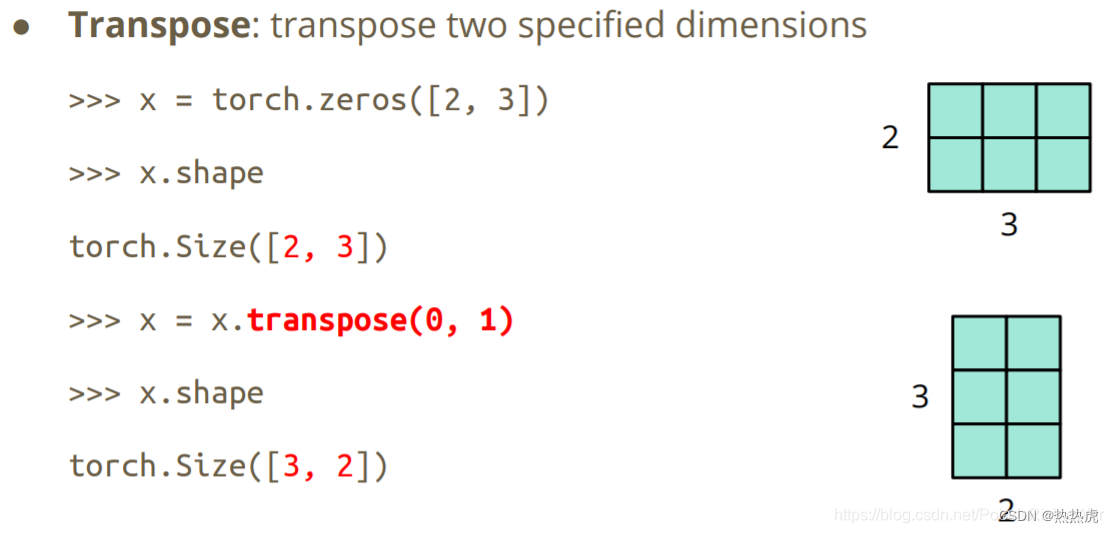

3.transpose() 转置

4.cat() 串接

六、Tensors-Device

tensor默认是在cpu上运算,但是如果要加快运算速度的话就要移动到适当装置上。pytorch提供.to方法来指定要在哪个上面运算。如果要在GPU上运算就要使用x=x.to(‘cuda’)

七、如何利用tensor来计算梯度?

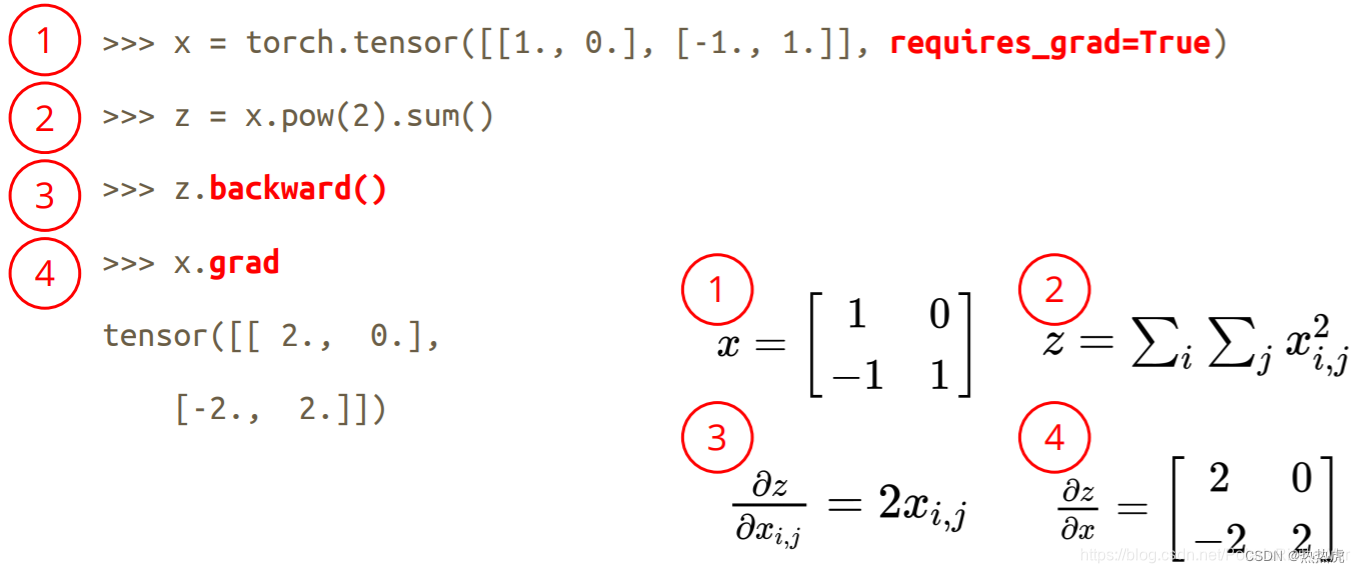

pytorch有一个特点是它可以自动算微分,比如现在有一个2*2的矩阵x

之后创造一个z来把x的每一项平方再加起来,把z做微分,使用式子3,要查看结果就是式子4

PyTorch Tutorial(introduction+documentation)李宏毅机器学习笔记

于 2024-06-11 21:16:16 首次发布

1626

1626

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?