目录

引言

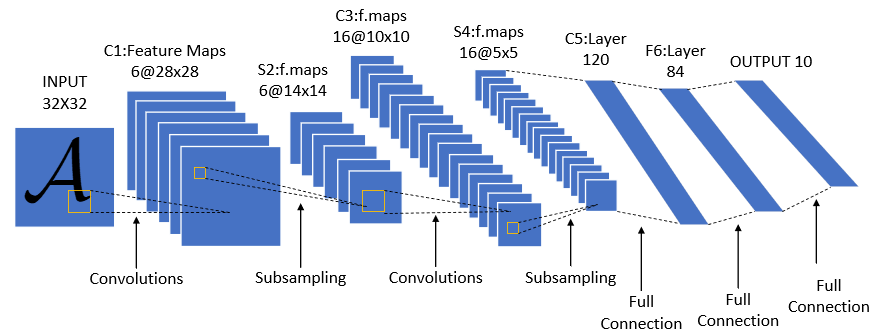

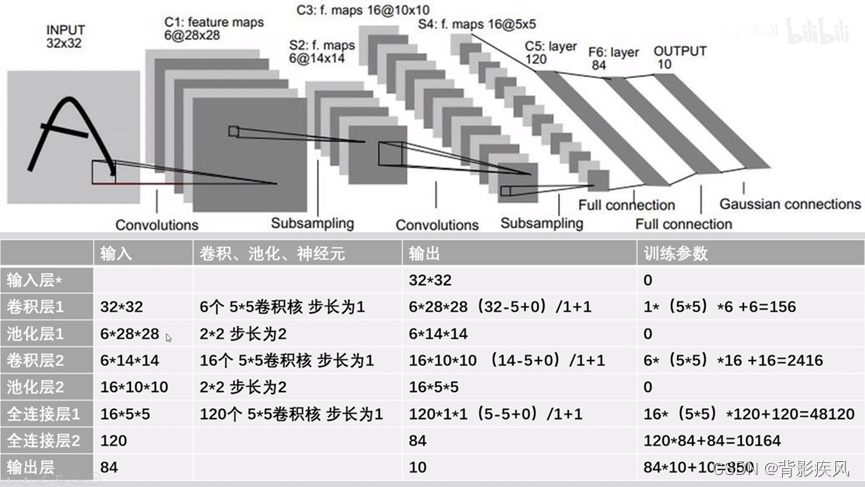

LeNet-5是Yann Lecun 提出的一种经典的卷积神经网络,是现代卷积神经网络的起源之一;本文将从LeNet的结构和参数上来介绍LeNet-5结构。

结构概述

上图是LeNet-5的经典结构,它一共有七层(不包含输入层),分别是两个卷积层,两个池化层,3个全连接层(其中最后一个全连接层为输出层)

结构分析

首先输入是一个32x32的图片,通过六个5x5x1的卷积核对其进行卷积,产生6幅28x28的卷积特征图,然后这6幅特征图又经过2x2的池化提取,变成6幅14x14的特征图,这样第一个卷积+池化的操作就完成了(C1+S2)

之后又对这6幅14x14的特征图使用16个5x5x6的卷积核进行卷积,产生16幅10x10的卷积特征图,然后这16幅特征图又经过2x2的池化提取,变成16幅5x5的特征图。

很多同学可能不能理解5x5x6的卷积核是怎么回事,这里我要说明一下,所谓卷积核不一定就是二维的一个矩阵,它也是一个三维的卷积核,每个5x5x6的卷积核实际执行的操作是同时对6幅特征图进行卷积操作,每幅特征图对应一个5x5x1的卷积核,最后6幅图卷积的结果再加在一起,等效于一个5x5x6的卷积核的卷积结果。

继续分析,池化后的16幅5x5的特征图还会经过一次卷积,即120个5x5x16的卷积核对16幅5x5的特征图进行卷积,得到120幅1x1的特征图;我们称这层也叫全连接层,因为每个神经元都与前面的16幅特征图相连,其实实质上这算一次卷积操作。

之后就是一个120输入84输出的全连接层和一个84输入10输出的输出层(使用softmax激活)

训练参数分析

我们知道,只有全连接层和卷积层需要进行参数的训练,池化层和输入层是不需要训练参数的。

第一层卷积: 6x5x5(6个5x5矩阵) + 6(每个卷积核还有一个偏置项)

第二层卷积:16x5x5x6(16个5x5x6的卷积核)+16(每个卷积核还有一个偏置项)

第三层卷积(第一全连接层):120x5x5x16(120个5x5x16的卷积核)+120(每个卷积核还有一个偏置项)

第二全连接层:120x84+84

第三全连接层(输出层):84x10 + 10

从这个分析我们可以看出,其实大部分的训练参数还是集中在全连接层上。

623

623

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?