紧接配置好pytoch环境,具体的使用基础yolo模型,完成这步之后就可以用自己的数据训练模型和修改模型。

作者的做法是将yolo算法的ultralytics包在本地使用,不需要频繁的在github上拉取,更适合拆拿的牛马研究生使用。

1.准备工作

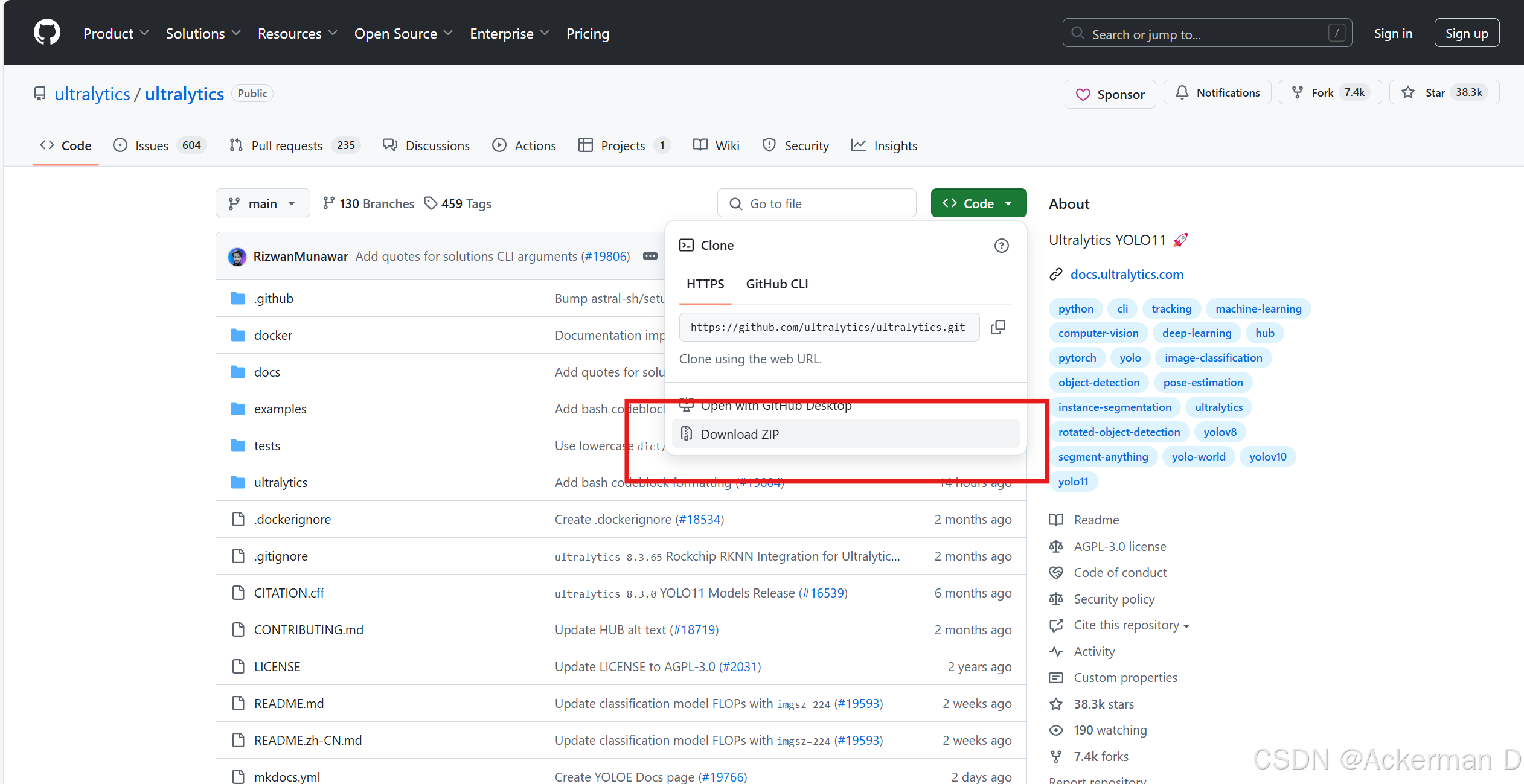

进入GitHub - ultralytics/ultralytics: Ultralytics YOLO11 🚀,该网站为ultralytics的官方给出的github链接(另外给出ultralytics的主页链接方便学习:Ultralytics | 革新视觉人工智能世界),按照下面图片下载yolo的压缩包,自行解压。

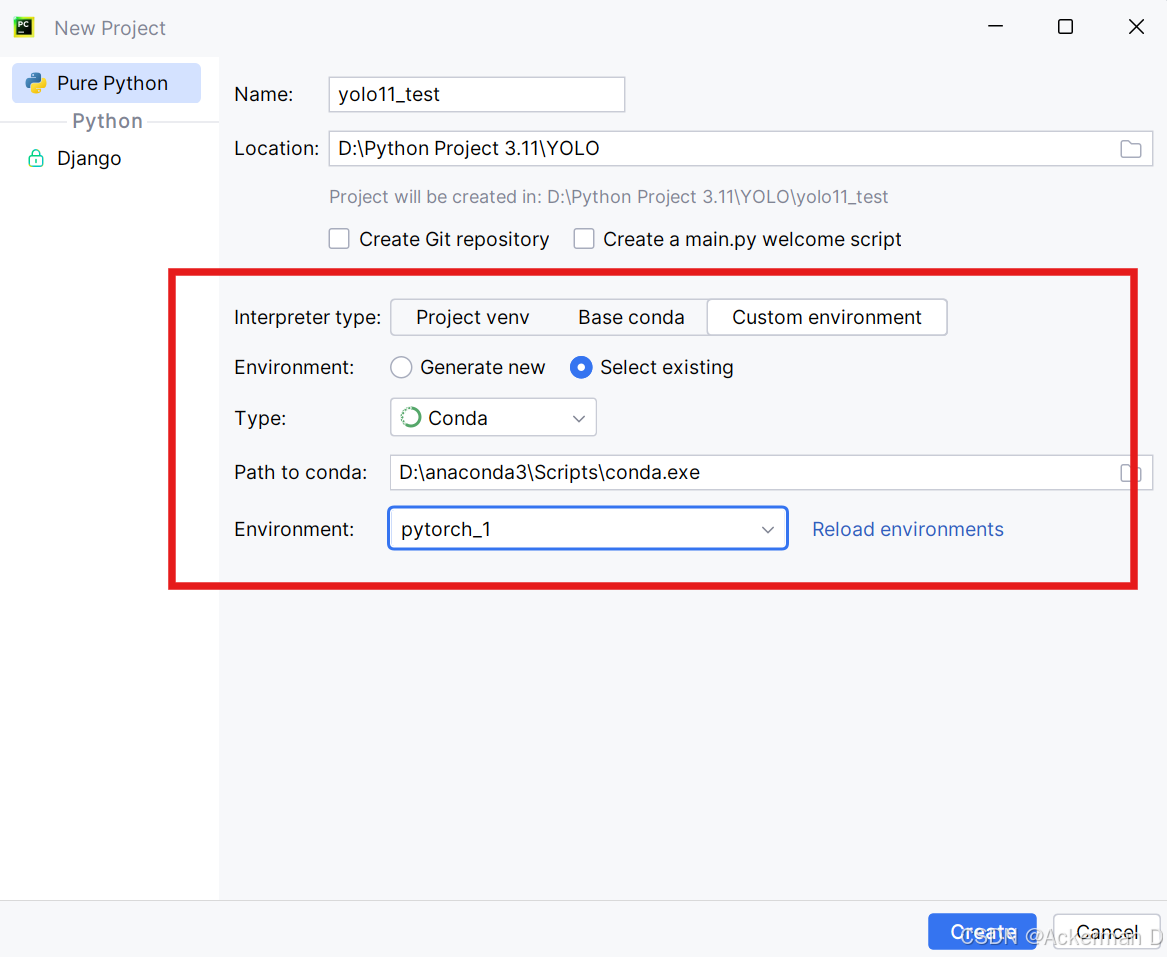

创建python项目,按照下面红框中选中的内容进行选择,custom enviroment(自定义的环境)->select existing(选择现存环境)->选择Conda->最后选择自己配置好的pytorch环境。

2.开始项目

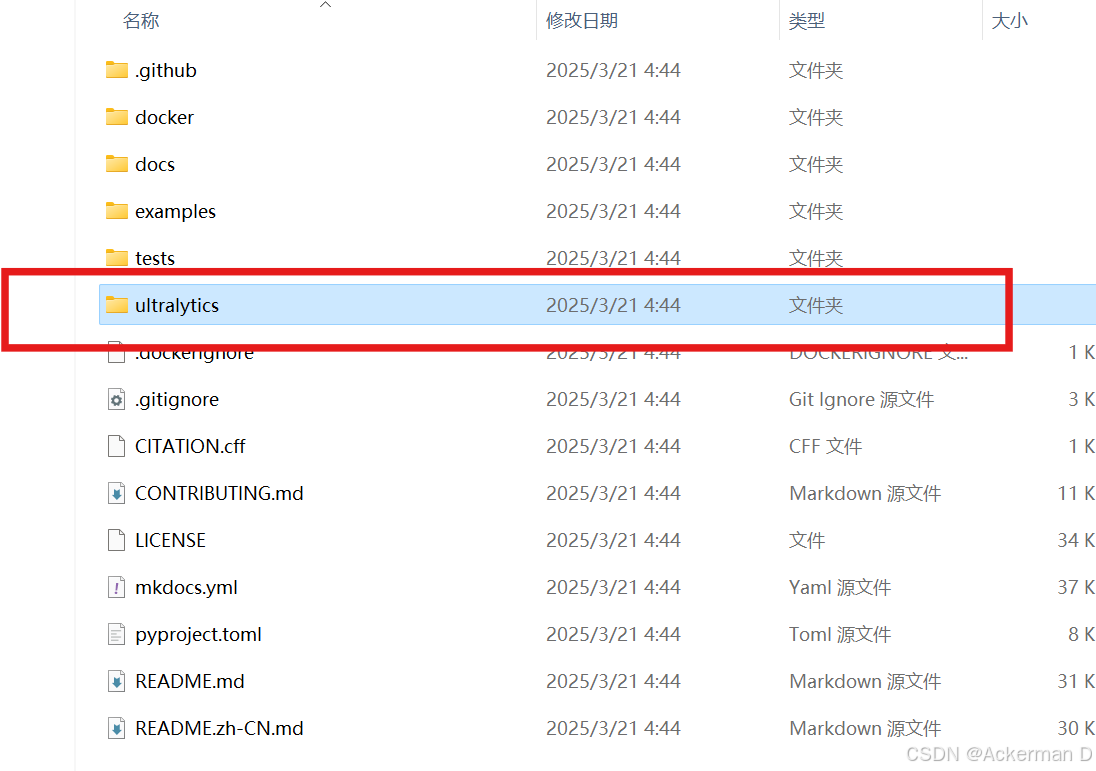

将yolo压缩包中的ultralytics文件复制,粘贴到自己项目的根目录下,这个文件包含了我们需要的模型

检查:在项目的根目录下创建.py文件,输入如下代码检测pytorch环境是否可用、ultralytics包是否是引用自根目录下的ultralytics包:

import torch

import ultralytics

print(torch.cuda.is_available()) #检查torch环境

print(ultralytics.__file__) #检查ultralytics包是否是自己复制过来的包若输出True和自己项目根目录下的ultralytics\__init__.py则证明成功。

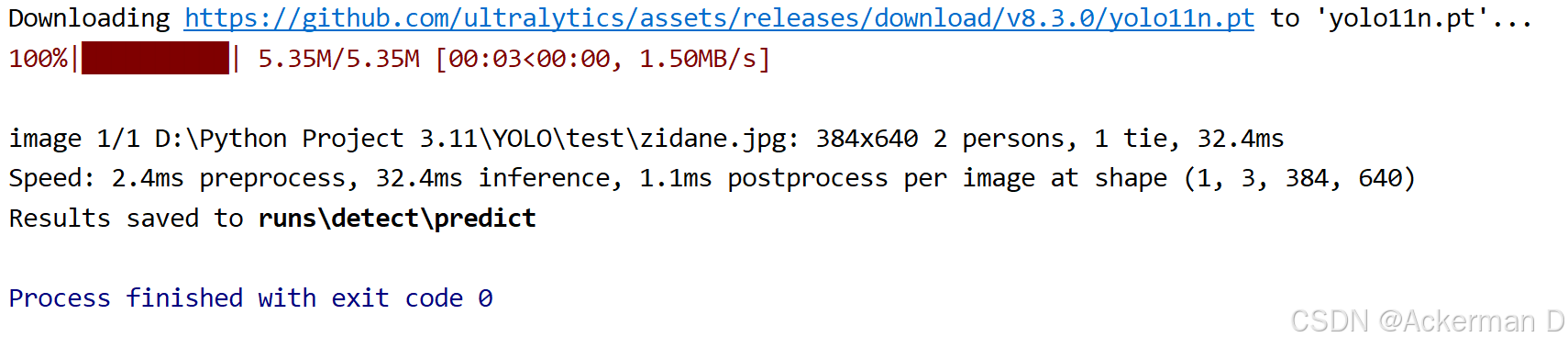

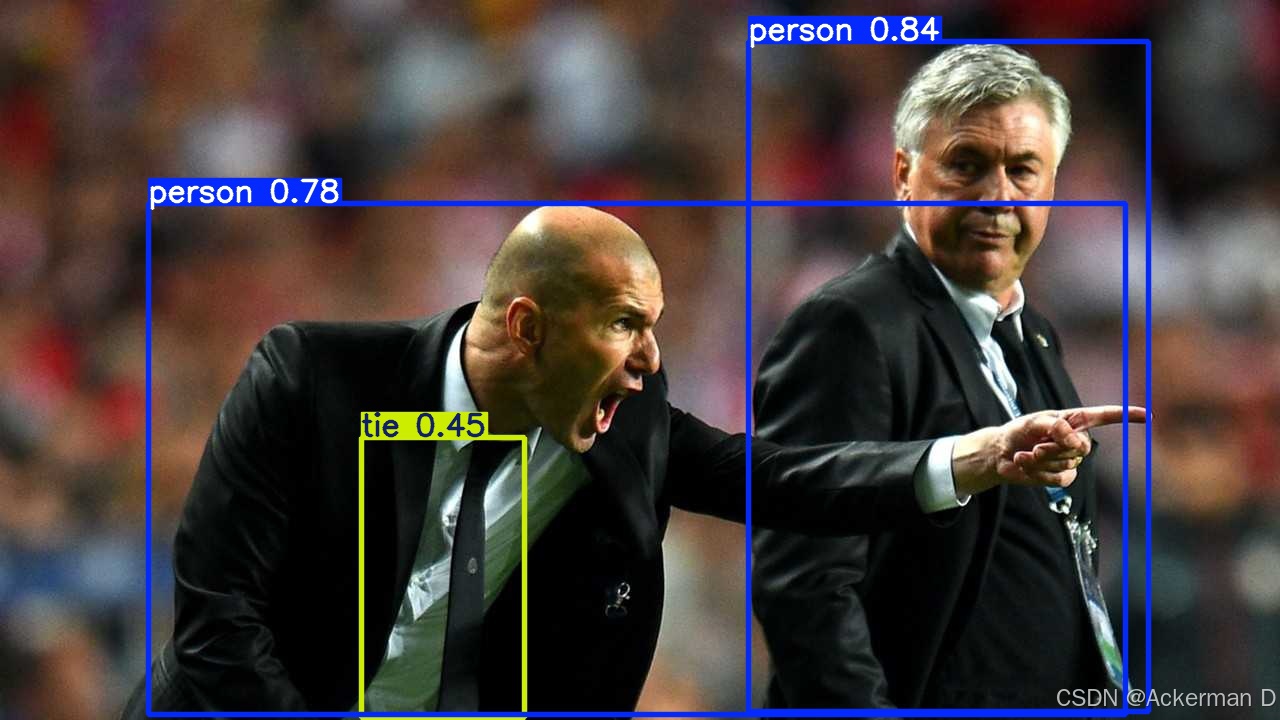

开始使用模型,在python文件中输入下面代码,运行完成控制台的显示如下,会自动下载yolo11n.pt文件,并且将识别的图片保存在runs\detect\predict文件下(后续的训练生成的模型等等均保存在该目录下):

from ultralytics import YOLO

model = YOLO('yolo11n.pt') #使用官方的yolo11n基础模型,运行后会自动下载

#并在根目录下生成yolo11n.pt文件

model('zidane.jpg',show=True,save=True) #用模型识别经典的齐达内照片,并保存

3.总结

这样做的好处是,只要配置好环境,在官网下载好最新的utralytics包并保证留了备份后,可以灵活的自己修改模型,并且项目也是完全是自己的东西。

7392

7392

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?