在网上的很多资料对分类树和回归树解释存在着一些混淆。这里对其做一点整理。

前提

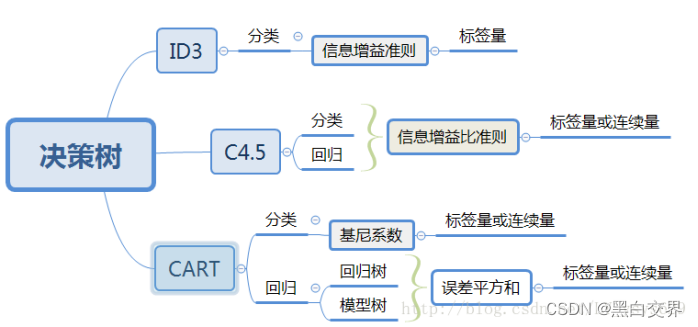

首先,我们讲分类树和回归树的区别时,一般都是指使用cart算法的决策树的分类下。这也是考察的比较多的点。因此,这里所说的分类树和回归树都可以说是cart树的一种,其分类如下:

(图片来源于分类与回归树(CART) - Allegro - 博客园 (cnblogs.com))

这里,两者的区别在于:

分类树

1. 分类树使用基尼指数作为分支的依据,即当前节点的混乱程度(不了解基尼指数计算的最好参考书本,没有书本的可以看基尼指数的计算_基尼指数计算-CSDN博客),我们选择gini增益最小的特征划分节点。

2. 分类树输出的是样本的类别,即离散值,由对应叶子节点的类别决定。

(经典案例:泰坦尼克号幸存者预测)

回归树

1. 回归树使用误差平方和(MSE)作为分支依据,每次分支时选择划分后子集MSE之和最小的特征进行划分。

2. 回归树输出的是一个实数,即连续值,由对应叶子节点的目标值均值作为预测值。

(经典案例:房价预测)

2877

2877

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?