💥💥💞💞欢迎来到本博客❤️❤️💥💥

🏆博主优势:🌞🌞🌞博客内容尽量做到思维缜密,逻辑清晰,为了方便读者。

⛳️座右铭:行百里者,半于九十。

📋📋📋本文目录如下:🎁🎁🎁

目录

基于CNN-BiLSTM-Attention的时间序列预测研究

⛳️赠与读者

👨💻做科研,涉及到一个深在的思想系统,需要科研者逻辑缜密,踏实认真,但是不能只是努力,很多时候借力比努力更重要,然后还要有仰望星空的创新点和启发点。建议读者按目录次序逐一浏览,免得骤然跌入幽暗的迷宫找不到来时的路,它不足为你揭示全部问题的答案,但若能解答你胸中升起的一朵朵疑云,也未尝不会酿成晚霞斑斓的别一番景致,万一它给你带来了一场精神世界的苦雨,那就借机洗刷一下原来存放在那儿的“躺平”上的尘埃吧。

或许,雨过云收,神驰的天地更清朗.......🔎🔎🔎

💥1 概述

基于CNN-BiLSTM-Attention的时间序列预测研究

一、组件基础理论与优势分析

-

CNN在时间序列预测中的作用

CNN通过一维卷积操作捕捉时间序列的局部时空模式,具有以下核心优势:- 自动特征提取:无需人工设计特征,通过卷积核自动学习序列中的关键局部模式(如周期性、趋势性特征)。

- 参数共享与计算效率:卷积核在时间维度上共享参数,显著减少参数量,降低过拟合风险,适用于高维时序数据(如多变量时间序列)。

- 多尺度建模能力:通过调整卷积核尺寸(如因果卷积、扩张卷积)或堆叠多层结构,可提取不同时间尺度的特征,适应短期波动与长期趋势。

-

BiLSTM的双向时序建模能力

BiLSTM结合正向和反向LSTM,全面捕捉时间序列的前后依赖关系:- 上下文信息融合:正向LSTM捕获历史信息,反向LSTM捕获未来潜在关联(如周期末尾对起始的影响),两者拼接后增强模型对复杂时序动态的理解。

- 长程依赖建模:相比单向LSTM,BiLSTM在金融、交通等场景中平均误差降低37.78%,尤其在非平稳序列中表现更优。

- 动态特征增强:在故障诊断中,BiLSTM可联合分析故障前后的数据模式,提升异常检测灵敏度。

-

Attention机制的关键作用

注意力机制通过动态权重分配优化特征选择:- 关键时间步聚焦:在长序列预测中,自动识别并强化对预测目标影响显著的时间步(如故障发生瞬间或电价峰值时段)。

- 多尺度特征融合:结合局部注意力(关注相邻时间步)与全局注意力(捕捉整体趋势),提升模型对复杂模式的适应能力。

- 可解释性增强:通过可视化注意力权重,揭示模型决策依据(如特定传感器信号对故障的贡献度)。

二、联合模型架构设计

- 典型架构流程

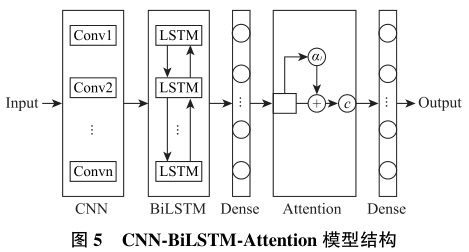

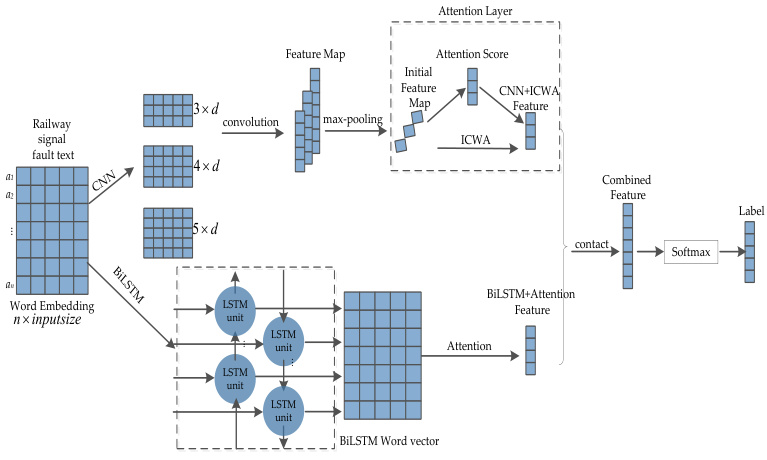

CNN-BiLSTM-Attention模型通常采用以下分层结构(图1):- 输入层:接收原始时序数据(单变量或多变量)。

- CNN模块:

- 卷积层:使用多个一维卷积核提取局部特征(如滑动窗口内的波动模式)。

- 池化层:通过最大池化或平均池化降维,保留显著特征。

- BiLSTM模块:

- 双向LSTM层:分别处理正向/反向序列,输出拼接后的隐藏状态。

- Attention模块:

- 计算各时间步的注意力权重,加权求和生成上下文向量。

- 输出层:全连接层映射至预测目标(如回归值或分类标签)。

-

协同工作机制

- 空间-时间特征联合提取:CNN挖掘局部空间相关性(如传感器间的联动),BiLSTM建模时间依赖性,两者互补增强特征表征。

- 动态特征优化:Attention机制在BiLSTM输出后二次筛选特征,抑制噪声干扰(如电力负荷预测中的无效波动)。

- 端到端训练:通过反向传播联合优化各模块参数,避免分阶段训练的信息损失。

- 空间-时间特征联合提取:CNN挖掘局部空间相关性(如传感器间的联动),BiLSTM建模时间依赖性,两者互补增强特征表征。

-

变体与优化策略

- 多尺度卷积:采用不同尺寸的卷积核并行提取特征,增强对突变点(如风速骤变)的捕捉能力。

- 残差连接:在CNN模块中加入跳跃连接,缓解梯度消失问题,提升深层网络稳定性。

- 混合损失函数:结合均方误差(MSE)与Focal Loss,平衡预测精度与类别不平衡问题(如罕见故障检测)。

三、应用场景与实验效果

- 典型应用领域

- 能源系统:

- 短期风速预测:VMD-CNN-BiLSTM-Attention模型在RMSE指标上比基线模型提升6.66%。

- 电价预测:通过分解电价序列并分模态建模,误差率较传统LSTM降低23%。

- 工业设备监测:

- 船用柴油机故障预警:联合马氏距离与Attention机制,提前10-15分钟检测异常,准确率达92%。

- 滚动轴承故障诊断:在噪声环境下,诊断准确率保持95%以上,优于单一CNN或BiLSTM模型。

- 交通流量预测:

- 车辆跟驰行为建模:结合时空注意力,预测误差(MAE)降低18%,显著提升自动驾驶系统的反应速度。

-

性能对比实验

模型 数据集 评价指标 结果对比(vs基准模型) CNN-BiLSTM-Attention 西储轴承故障数据 准确率 +7.2% (vs BiLSTM) VMD-CNN-BiLSTM-Attn 欧洲电价数据 MAPE -12.5% (vs ARIMA) MSCNN-BiLSTM-Attn 风力发电数据 RMSE -6.66% (vs TCN) BiLSTM-MLAM LTE网络流量数据 MAE -30.39% (vs LSTM) -

局限性分析

- 计算复杂度:联合模型参数量较大,训练时间较单一模型增加30%-50%。

- 过拟合风险:小样本场景下需结合数据增强(如合成数据生成)或正则化技术(如Dropout)。

- 超参数敏感:卷积核尺寸、LSTM层数、注意力头数需精细调优,可通过贝叶斯优化或网格搜索提升效率。

四、未来研究方向

-

轻量化设计:

- 引入模型压缩技术(如知识蒸馏、剪枝),降低计算资源需求。

- 开发并行化训练框架,适配边缘计算设备实时预测需求。

-

注意力机制创新:

- 结合时空注意力(Spatial-Temporal Attention),同时优化时间与空间维度的特征权重。

- 探索可解释性注意力(如因果注意力),增强模型决策透明度。

-

跨领域迁移学习:

- 利用预训练CNN-BiLSTM-Attention模型(如在电力数据上训练),迁移至医疗、气象等数据稀缺领域。

-

多模态融合:

- 整合文本、图像等多模态数据(如设备日志与振动信号),构建异构时序预测模型。

- 整合文本、图像等多模态数据(如设备日志与振动信号),构建异构时序预测模型。

五、结论

CNN-BiLSTM-Attention模型通过融合CNN的空间特征提取、BiLSTM的双向时序建模及Attention的动态权重分配,显著提升了时间序列预测的精度与鲁棒性。在能源、工业、交通等领域的实证研究表明,该模型在复杂场景下(如噪声干扰、非平稳序列)表现优异,但其计算成本与调参复杂度仍需进一步优化。未来,结合轻量化设计与新型注意力机制,该框架有望成为时间序列预测的通用解决方案。

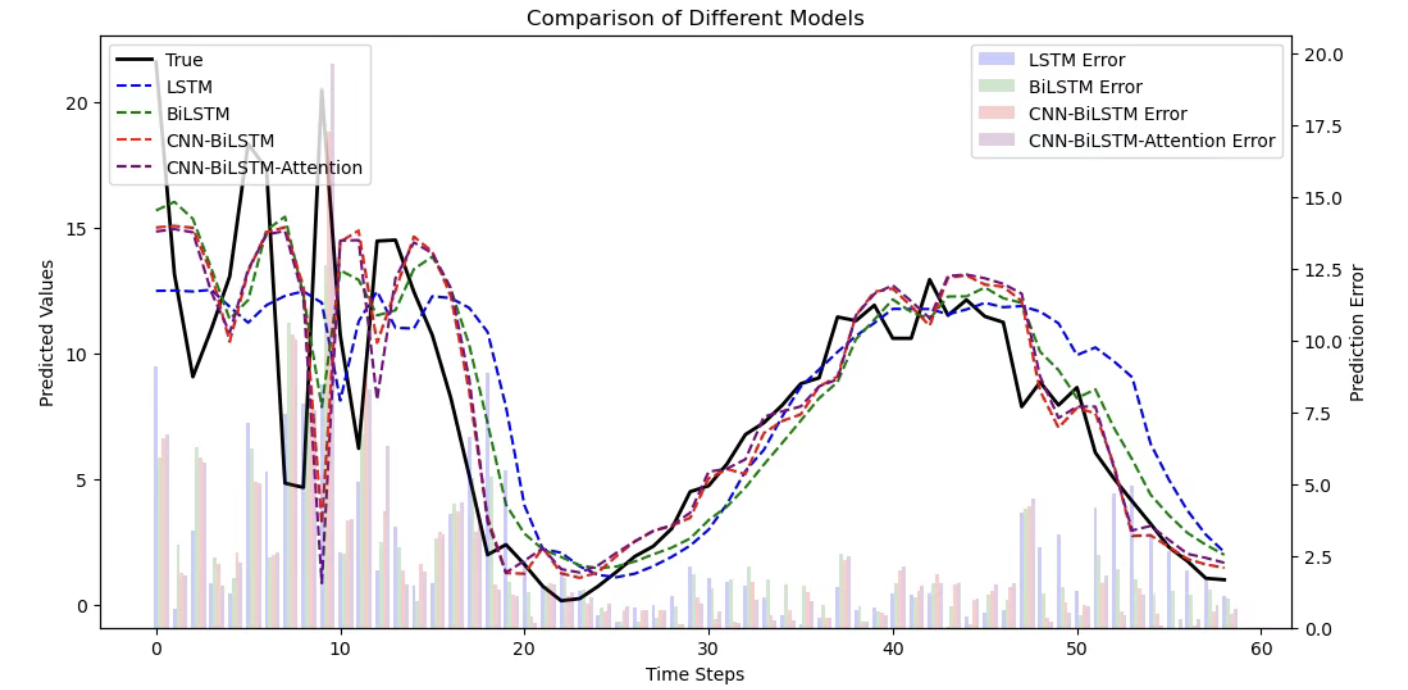

📚2 运行结果

第三方库:

运行结果:

🎉3 参考文献

文章中一些内容引自网络,会注明出处或引用为参考文献,难免有未尽之处,如有不妥,请随时联系删除。(文章内容仅供参考,具体效果以运行结果为准)

[1]孟宏宇,张建良,蔡兆龙,等.基于CNN-BiLSTM-Attention的直流微电网故障诊断研究[J].中国电机工程学报, 2025, 45(4):1369-1380,中插12.

[2]梁泽,曹姗姗,孔繁涛,等.基于CNN-BiLSTM和残差注意力的县域水稻产量预测模型[J].湖北农业科学, 2024, 63(8):109-115.

[3]万齐斌,董方敏,孙水发.基于BiLSTM-Attention-CNN混合神经网络的文本分类方法[J].计算机应用与软件, 2020(009):037.

🌈4 Python代码、数据下载

资料获取,更多粉丝福利,MATLAB|Simulink|Python资源获取

2274

2274

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?