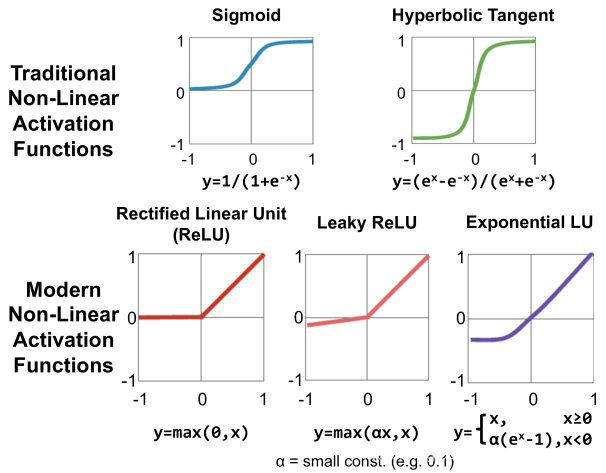

Sigmod(Logistic)

y

=

1

1

+

e

x

y=\frac{1}{1+e^x}

y=1+ex1

归一化将输入标准化到均值为0,方差为1的标准正态分布上,取值范围

(

0

,

1

)

(0,1)

(0,1)

Tanh(Hyperbolic Tangent )

y

=

e

x

−

e

(

−

x

)

e

x

−

e

(

−

x

)

y=\frac{e^x-e^(-x)}{e^x-e^(-x)}

y=ex−e(−x)ex−e(−x)

双曲正切函数,相比于Sigmod,其输出中心到了0点(相当于Sigmod平移拉伸),取值范围

(

−

1

,

1

)

(-1,1)

(−1,1)

ReLU(Rectified Linear Unit)

y

=

max

(

0

,

x

)

y=\max(0,x)

y=max(0,x)

分段斜坡函数,只取正值,取值范围

(

0

,

∞

)

(0,∞)

(0,∞)

Leaky ReLU

y

=

max

(

α

x

,

x

)

y=\max(\alpha x,x)

y=max(αx,x)

α

\alpha

α一般取很小,0.01、0.1之类的。可扩大ReLU的取值范围

(

−

∞

,

∞

)

(-∞,∞)

(−∞,∞)

ELU(Exponential Linear Unit):

y

=

{

x

,

x

≥

0

α

(

e

x

−

1

)

,

x

<

0

y=\left\{ \begin{aligned} x, x≥0\\ \alpha(e^x-1), x<0 \end{aligned} \right.

y={x,x≥0α(ex−1),x<0

小于0的部分用指数计算,接近自然梯度

SoftMax

S

i

=

e

i

∑

j

e

j

S_i=\frac{e^i}{\sum_je^j}

Si=∑jejei

适用于多分类问题,取值范围

(

0

,

1

)

(0,1)

(0,1),相比于argmax保留了较小分数部分的概率

图片来源:http://t.csdnimg.cn/ZbuW2

701

701

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?