亮点:

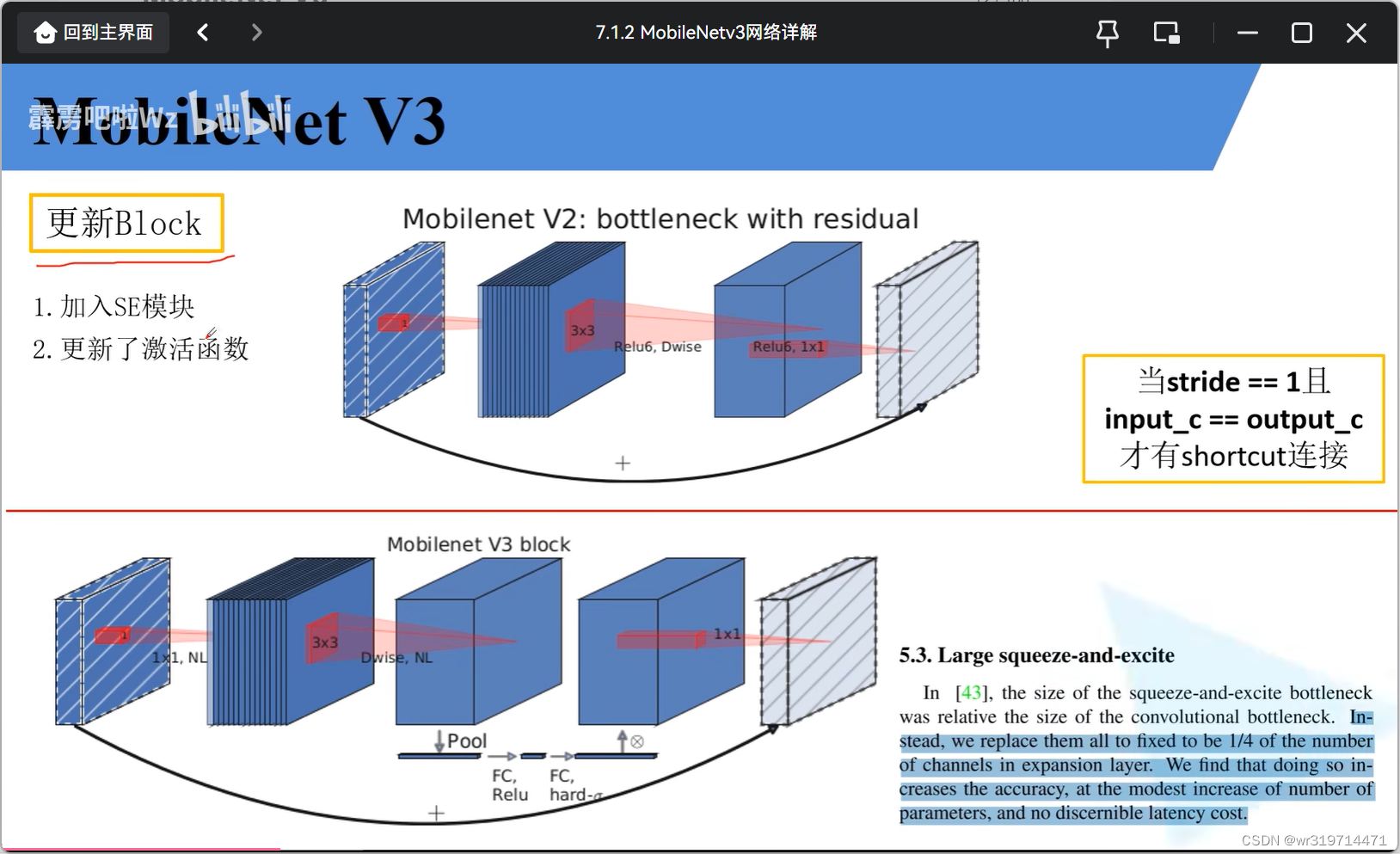

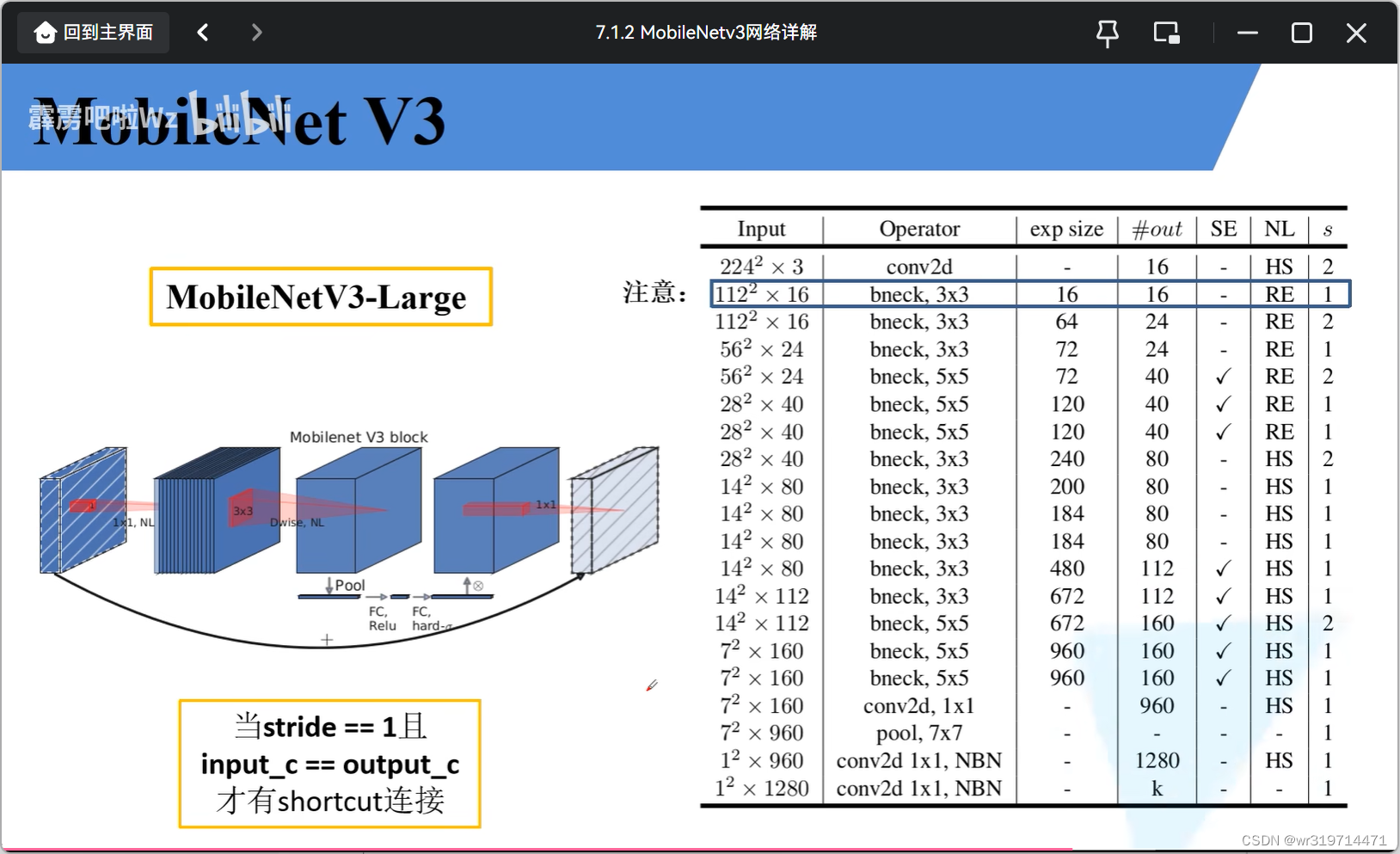

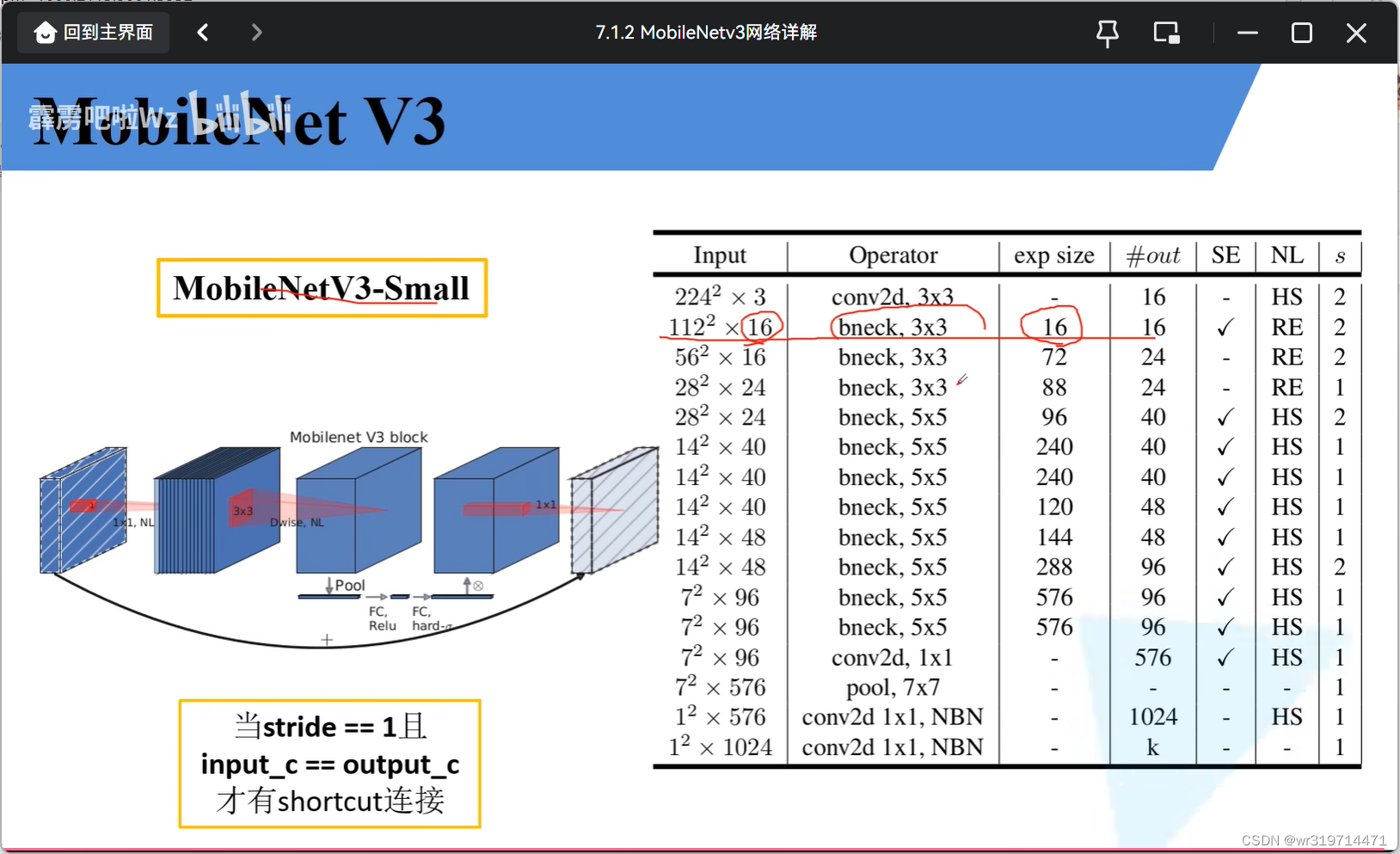

更新了Block

使用NAS搜索参数

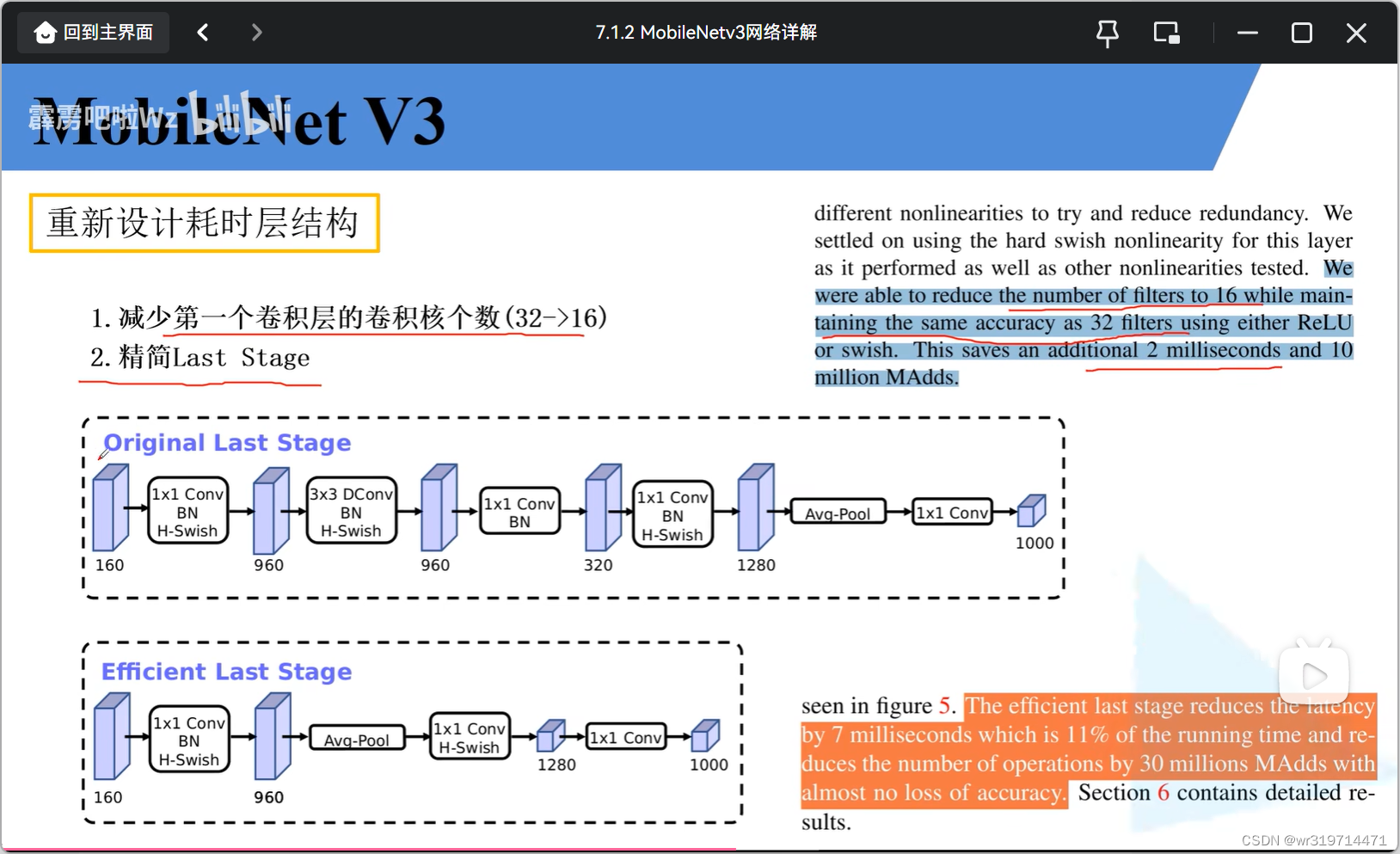

重新设计耗时层结构

1.新的block

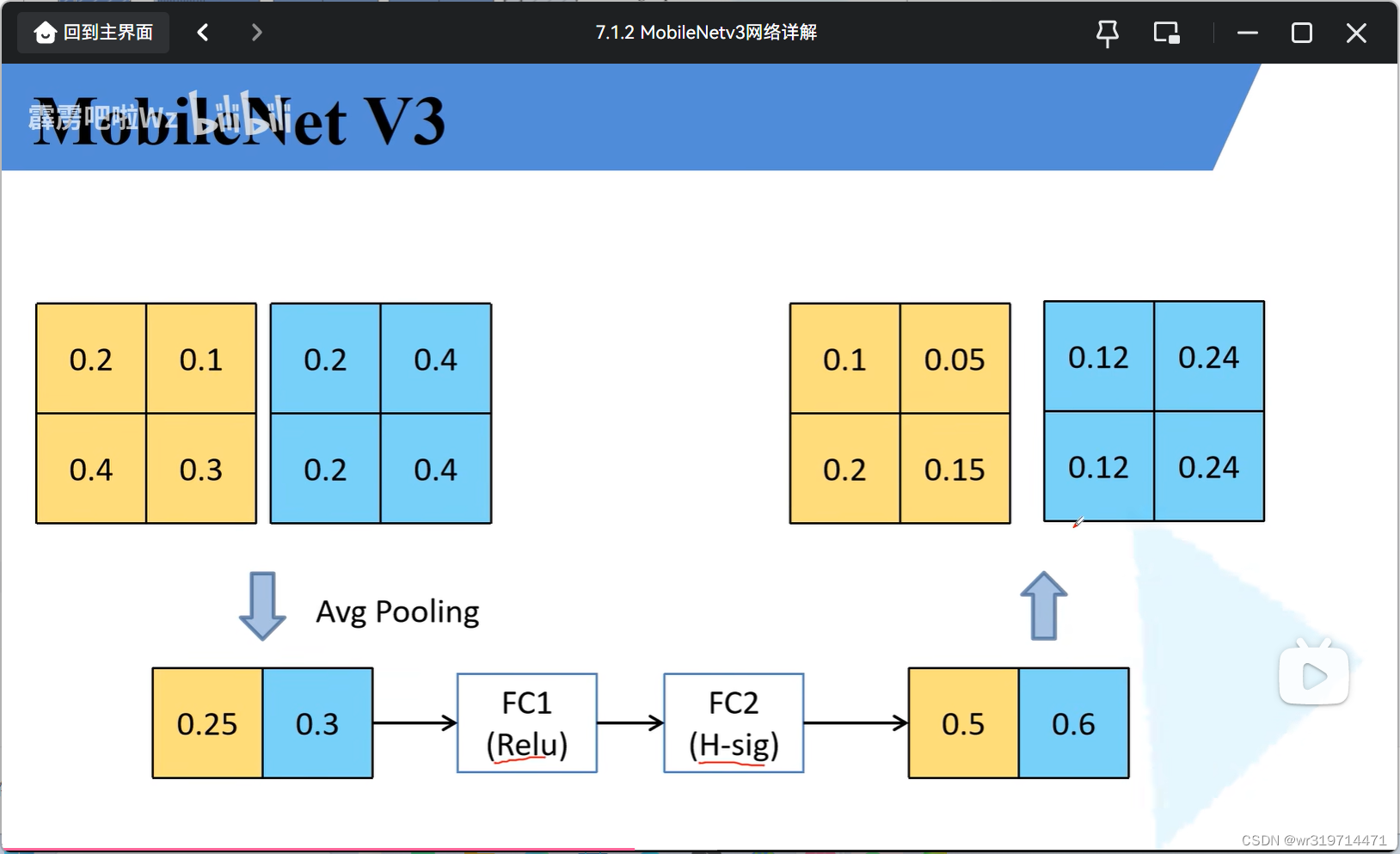

a. 最显眼的部分就是加入了注意力机制(SE模块)

对得到的矩阵的每一个channel进行池化处理,channel有多少,得到的一维向量就有多少个元素

然后通过两个全连接层得到输出的向量

##第一个全连接层的节点个数等于特征矩阵channel的四分之一

##第一个全连接层的节点个数等于特征矩阵channel

输出的向量可以理解为对特征矩阵的每一个channel分析出了一个权重关系(重要的channel权重比较大)

将得到的权重与各自的channel相乘,便得到了结果

b.更新了激活函数

nl是非线性激活函数的意思,由于不同层中所使用的激活函数不一样,所以没有明确标出

降维的部分没有使用激活函数(也可以说使用了线性激活函数)

2.重新设计耗时层结构

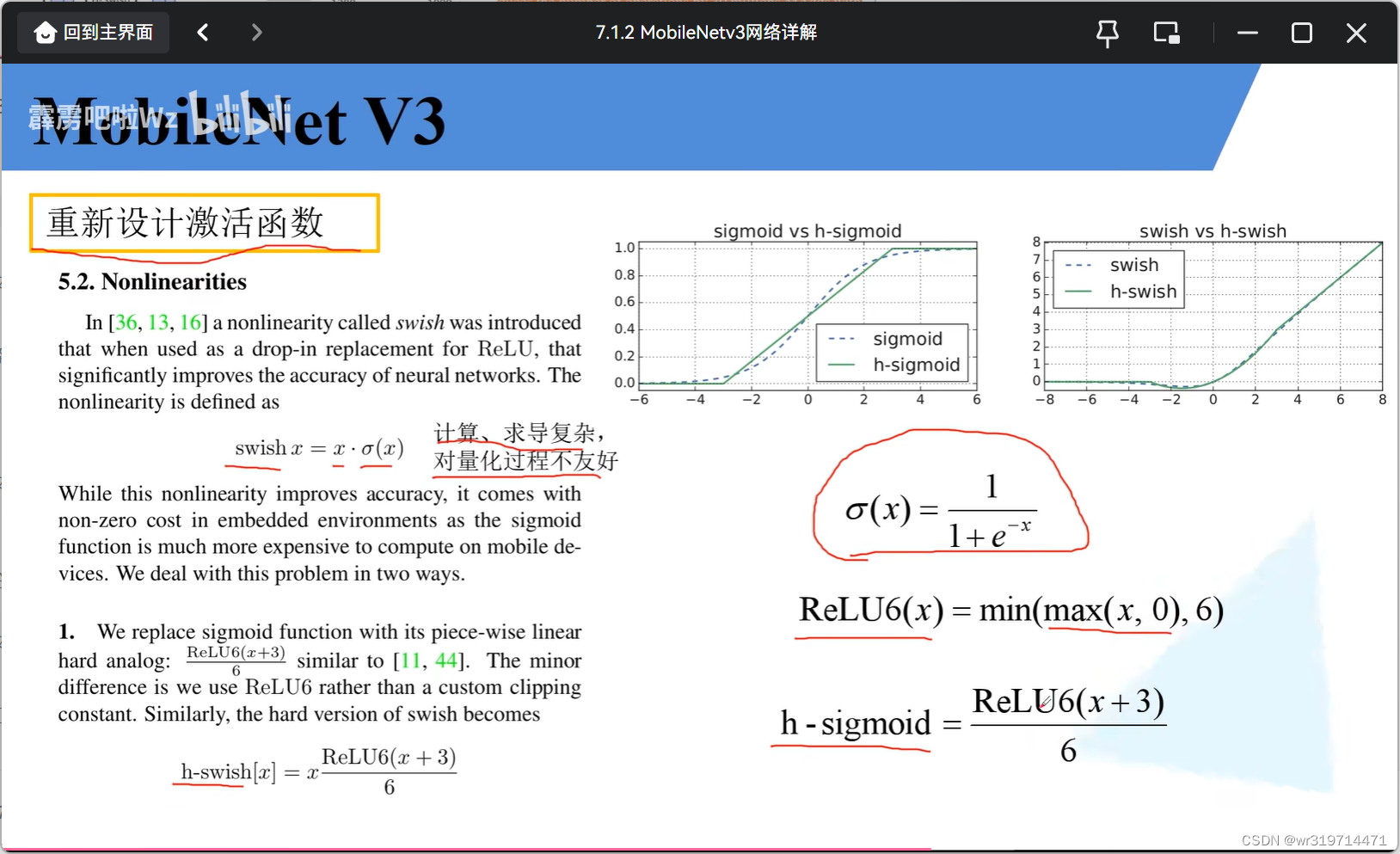

3.重新设计激活函数

HS:h-swish激活函数

RE:relu结构

s:dw卷积的步距

bneck就是图中左侧结构 3*3是dw卷积核的大小

exp_size是通过第一个卷积层升到多少维

最后两层的NBN是不适用bn结构,和全连接层作用差不多

##第一个bneck没有使用第一个卷积层,因为没有升维

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?