卷积神经网络CNN

关于技术:

1、感受野:就是下一层中每个神经元并不会与前一层的所有神经元有联系,只是与其中的一部分相连,这就大大降低了网络结构中的参数(每条连接就意味着这一个参数)。而且可以认为这种局部的连接是对前一层信息的局部提取。

2、权值共享:如果在感受野范围内连接构成了一组参数,那么次一层的神经元每个都对应一组参数,虽然通过感受野大大降低了参数,但参数的个数还是明显有点多。权值共享就是该层所有的神经元共享一组参数,那么就相当于对上一层的神经元做了卷积。对其各个部分都做了相应的局部信息提取。如此通过多层的局部提取可以构成全局信息。

3、池化:局部感受野的一组参数智能提取一种局部信息,为了能够提取更多的信息,需要这样的参数有多个才能形成更好的特征量对输入信息进行描述。这样的一组参数称之为卷积核。多个卷积核对输入信息进行特征描述后会使得特征信息过多,对之后的网络层处理带来压力。为此设计的池化技术,对同一个区域所提取出来的特征信息进行加权,降低信息量并获取该处的最强特征表达,同时也可以减小图像的规模。因为特征图的规模变小了,会造成信息丢失的风险,因此常常通过增加特征图的深度来弥补。

关于结构

卷积神经网络,顾名思义也是一种神经网络,那么就和传统的神经网络有着类似的结构,即由多层神经元层连接而成。但与传统的神经元的连接方式又有着一些区别。卷积神经网络的结构一般由输入层+卷积层1+池化层1+卷积层2+池化层2+...+卷积层n+池化层n+分类层。

卷积层:

<关于卷积核>

卷积核就是用来提取图像特征的,常用的卷积核的大小一般都说是n x n , 但这样的卷积核对应的权重大小为 nxnxd, 其中d可以为上一层的特征图的深度或者自己选择的深度。特别是在卷积层使用多个卷积核后会增加特征图的深度,之后卷积层或者池化层的深度都有变化。

<卷积运算>

用卷积的权重矩阵[nxnxd]与输入的多通道特征图相应的位置作内积,然后相加求和即为所求新特征图对应位置的值。

<运算后特征图的大小>

卷积过程后特征图的大小与输入图像的大小W(指二维mxn,不算通道),卷积核的大小F[nxn]、卷积核滑动的步长S[stribe]、零填充P[zero-padding]都有关。那么输出大小的计算方式为:(W-F+2P)/S +1.

池化层:

在卷积神经网络中,常常在连续卷积层中间隔插入池化层。池化操作可以减小数据量,从而减小参数,降低计算,因此防止过拟合。其操作的对象是图像的各个通道即各个特征图,只会改变特征图的大小,并不改变特征图的数目。常用的操作时max操作。池化层没有参数!!!也一般不会使用zero-padding。

关于最后一层:

如果是一个二分类,可以接一个logistic regression,如果是个多分类,可以接一个softmax regression。

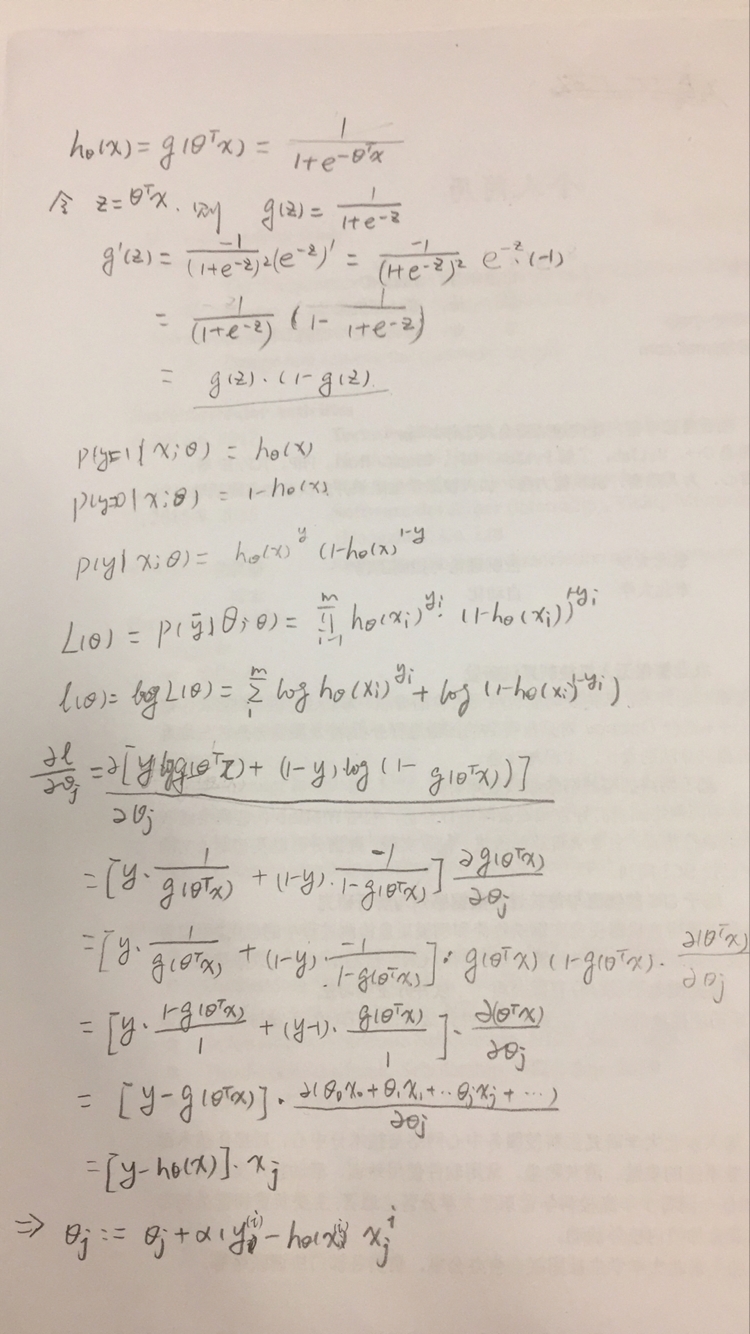

<logistic regression>

<softmax regression>

训练:

<反向传播算法>

防止过拟合:

<权重衰减weight decay>

L1,L2正则化。L1较L2能够获得更稀疏的参数,但L1零点不可导。在损失函数中,weight decay是放在正则项(regularization)前面的一个系数,正则项一般指示模型的复杂度,所以weight decay的作用是调节模型复杂度对损失函数的影响,若weight decay很大,则复杂的模型损失函数的值也就大。

<数据增强data argumentation>

1)收集更多数据 2)对已有数据进行crop,flip,加光照等操作 3)利用生成模型(比如GAN)生成一些数据。

<提前终止>

提前停止其实是另一种正则化方法,就是在训练集和验证集上,一次迭代之后计算各自的错误率,当在验证集上的错误率最小,在没开始增大之前停止训练,因为如果接着训练,训练集上的错误率一般是会继续减小的,但验证集上的错误率会上升,这就说明模型的泛化能力开始变差了,出现过拟合问题,及时停止能获得泛化更好的模型。

<droupt out>

在每次训练过程中随机将部分神经元的权重置为0,即让一些神经元失效,这样可以缩减参数量,避免过拟合。

经典的卷积网络:

LeNet

AlexNet

ZF Net

GoogleNet

VGG Net

ResNet

2183

2183

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?