StableDiffusion默认生成的图片分辨率为512*512,“只可远观,不可近赏”来形容怕是再合适不过了。好不容易抽到了一张自己心仪的图,但苦于颜色暗淡,分辨率低下,有什么办法能在原画的基础上,让它的细节更丰富吗?答案是肯定且简单的。

原始图

一、高分辨率修复(Hires.fix)

使用方法:

1、勾选高分辨率修复,输入放大倍数;

2、调整数据(高分迭代步数、重绘幅度)

2.1高分迭代步数:是StableDiffusion等图像生成模型中的一个关键参数,控制生成过程中的迭代次数。更多的迭代步数通常会带来更高的图像质量和细节,但同时也会增加生成时间。一般来说,较少的迭代步数(如50到100)生成速度快但图像细节可能不足;较多的迭代步数(如150到300或更多)生成速度慢但图像细节更丰富。

(上图设置为150,出图生成时间明显变长)

2.2

重绘幅度:用于控制图像重绘的程度。它决定了在从噪声图像生成最终图像时,模型对输入提示词的依赖程度。重绘幅度的值通常在0到1之间:

0:表示没有重绘,即保持原始图像不变。

1:表示完全重绘,即生成的图像完全依赖于提示词,不参考原始图像。

当调整到0.9时,生成了一张跟原图完全不沾边的图,可见该数值对原图的影响非常大。

3、选择放大算法;

有一种说法是无脑选择 R-ESRGAN 4x+ 算法就好,如果是二次元就选择 R-ESRGAN 4x+

Anime6B,但就我个人体会来说似乎影响不大,如果有多余时间可以几种算法都尝试。

画面都显得有些灰暗,颜色并不鲜艳,可以通过勾选模型旁边地外挂VAE模型,效果提升明显。

二、图生图

1、调整重绘尺寸;效果与将图片发送到后期处理效果看不出区别。

2、脚本-SD放大。

使用方法:

1、在脚本下拉菜单中选择SD upscale;

2、在放大倍数中填入合适的数字。

3、在分块重叠像素宽度中保持默认值64即可,或者其他值X。

4、在重绘尺寸栏中,将步骤3中填入的数值加上原有的值,得出一个新值填入其中。例如原始图片尺寸为512512,扩大成原来的两倍即1024,再加上重叠像素值64,最终填入10881088。

5、可以根据需要需要对CFG Scale值和重绘幅度值进行调整。

**这么做的原因在于,该功能实现的原理是放大的原理把原图切成若干份,各自生成后再拼接成一张更大的图,而这多出来的像素就是用来重合时做缓冲使用。

**

可以看出明显的拼接痕迹

三、Tiled Diffusion + Tiled VAE

在StableDiffusionUI上的操作很容易,只需要勾选这两个框、调整放大倍数,其他保持默认也可以实现放大功能。

以下是它们的工作原理:

Tiled

Diffusion****通过将图像分割成较小的块,每个块单独进行处理,然后将处理后的块重新拼接成完整的高分辨率图像。这种方法的关键步骤包括:

-

图像分割:将原始图像分割成多个重叠的较小块。重叠部分可以帮助在拼接时避免明显的边缘或接缝。

-

块处理:对每个块单独进行扩散过程,即逐步去噪和细化图像。每个块可以独立处理,这样可以避免处理整个图像时的高内存占用。

-

图像重建:将处理后的块重新拼接成完整的图像。重叠部分的像素可以通过加权平均或无缝拼接算法处理,确保块之间的过渡平滑自然。

Tiled VAE****也采用分块处理的方式,将图像分割成较小的块,每个块单独进行编码和解码。具体步骤包括:

-

图像分割:将原始图像分割成较小的块,块的大小可以根据具体需求进行调整。

-

块编码:使用VAE对每个块进行编码,将高维图像数据压缩成低维潜在向量。

-

块解码:将潜在向量解码回高分辨率图像块。解码后的图像块可能会进行一些细化处理,以提高图像质量。

-

图像重建:将解码后的图像块重新拼接成完整的图像,同样需要处理块之间的过渡部分,以确保拼接效果自然。

以下是使用Tiled Diffusion和Tiled VAE对图像进行放大和修复的具体步骤:

-

准备图像:加载需要放大和修复的原始图像。

-

设置块大小:选择合适的块大小,通常根据图像分辨率和可用的计算资源进行选择。

-

图像分割:将原始图像分割成指定大小的块,确保块之间有一定的重叠区域。

-

处理每个块:

-

对于Tiled Diffusion,逐步去噪和细化每个块。

-

对于Tiled VAE,先对每个块进行编码,再进行解码和细化。

-

图像重建:将处理后的块拼接回原始图像,处理重叠区域以确保图像的平滑过渡。

如有侵权,请联系删除。

但由于AIGC刚刚爆火,网上相关内容的文章博客五花八门、良莠不齐。要么杂乱、零散、碎片化,看着看着就衔接不上了,要么内容质量太浅,学不到干货。

这里分享给大家一份Adobe大神整理的《AIGC全家桶学习笔记》,相信大家会对AIGC有着更深入、更系统的理解。

有需要的朋友,可以长按下方二维码,免费领取!

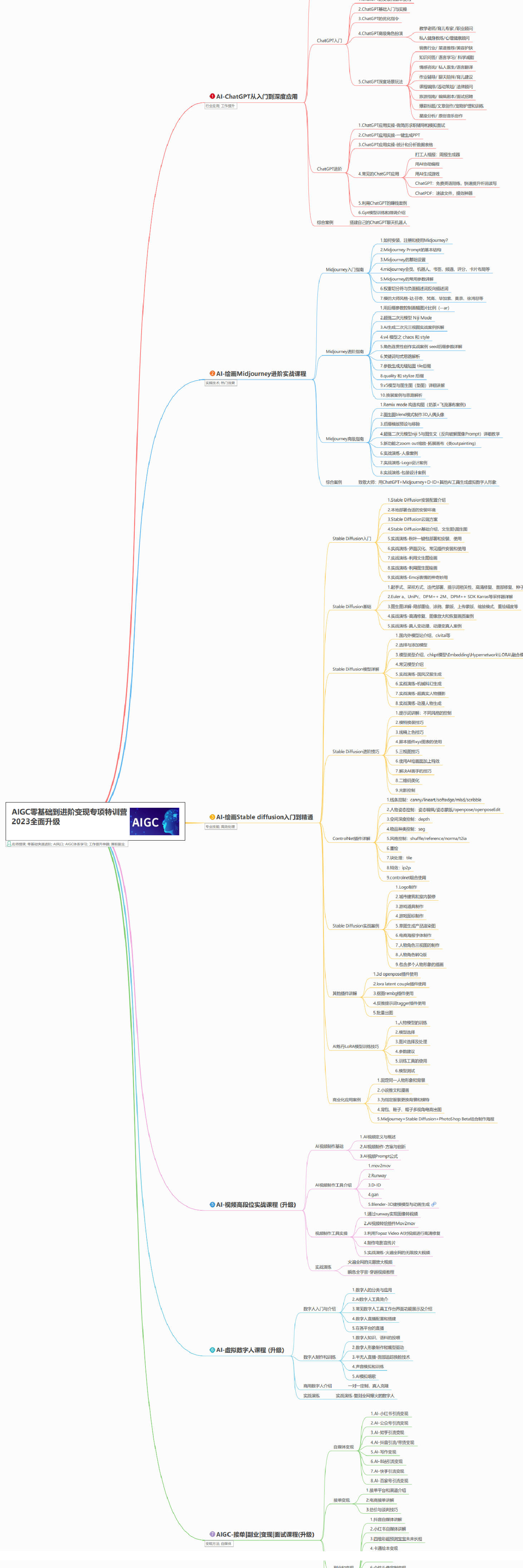

AIGC所有方向的学习路线思维导图

这里为大家提供了总的路线图。它的用处就在于,你可以按照上面的知识点去找对应的学习资源,保证自己学得较为全面。如果下面这个学习路线能帮助大家将AI利用到自身工作上去,那么我的使命也就完成了:

AIGC工具库

AIGC工具库是一个利用人工智能技术来生成应用程序的代码和内容的工具集合,通过使用AIGC工具库,能更加快速,准确的辅助我们学习AIGC

有需要的朋友,可以点击下方卡片免费领取!

精品AIGC学习书籍手册

书籍阅读永不过时,阅读AIGC经典书籍可以帮助读者提高技术水平,开拓视野,掌握核心技术,提高解决问题的能力,同时也可以借鉴他人的经验,结合自身案例融会贯通。

AI绘画视频合集

我们在学习的时候,往往书籍源码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,科学有趣才能更方便的学习下去。

有需要的朋友,可以长按下方二维码,免费领取!

5499

5499

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?