活动地址:CSDN21天学习挑战赛

1、前言

在拿数据进行模型训练的时候经常会遇到三个参数,分别为Epoch、Batch、Iteration,对于他们的概念理解的比较模糊,今天写博客记录一下,方便以后查询。

2、关系

这三个参数的关系图如下:

举例解释以上关系:

对于一个有 2000 个训练样本的数据集。将 2000 个样本分成大小为 500 的 batch,那么完成一个 epoch 需要 4 个 iteration。

3、名词解释

- Epoch:使用训练集的全部数据对模型进行一次完整的训练;

- Batch:使用训练集中的一小部分样本对模型权重进行一次反向传播的参数更新;

- iteration: 使用一个Batch数据对模型进行一次参数更新的过程,被称之为“一次训练”

3.1 通俗解释:

(1)batchsize:批大小。在深度学习中,一般采用SGD训练,即每次训练在训练集中取batchsize个样本训练;

(2)iteration:1个iteration等于使用batchsize个样本训练一次;

(3)epoch:1个epoch等于使用训练集中的全部样本训练一次,

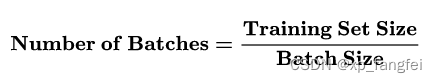

4、换算关系

n

u

m

b

e

r

o

f

i

t

e

r

a

t

i

o

n

=

T

r

a

i

n

i

n

g

S

e

t

S

i

z

e

/

N

u

m

b

e

r

o

f

B

a

t

c

h

e

s

number of iteration = Training Set Size / Number of Batches

numberofiteration=TrainingSetSize/NumberofBatches

其中: T r a i n i n g S e t S i z e Training Set Size TrainingSetSize表示一个数据集中样本数据的个数;

5、示例

假设:CIFAR10 数据集有 50000 张训练图片,10000 张测试图片。现在选择 Batch Size = 256 对模型进行训练。

- 每个 Epoch 要训练的图片数量:50000

- 训练集具有的 Batch 的个数:50000/256 = 195+1 =196

- 每个 Epoch 具有的 Batch 个数:196

- 每个 Epoch 具有的 Iteration 个数:196

- 每个 Epoch 中发生模型权重更新的次数:196

- 训练 10 代后(即Epoch 为10),模型权重更新的次数:196*10=1960

不同代的训练,其实用的是同一个训练集的数据。第 1 代和第 10 代虽然用的都是训练集的五万张图片,但是对模型的权重更新值却是完全不同的。因为不同代的模型处于代价函数空间上的不同位置,模型的训练代越靠后,越接近谷底,其代价越小。

1208

1208

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?