其中relu跟sigmoid主要的解释博文:

深度学习常用激活函数之— Sigmoid & ReLU & Softmax

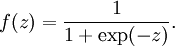

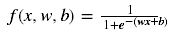

sigmoid函数(也叫逻辑斯谛函数):

引用wiki百科的定义:

A logistic function or logistic curve is a common “S” shape (sigmoid curve).

其实逻辑斯谛函数也就是经常说的sigmoid函数,它的几何形状也就是一条sigmoid曲线。

sigmoid激活函数(也叫logistic_activate)其作为激活函数的时候为:

sigmoid中激活函数a=

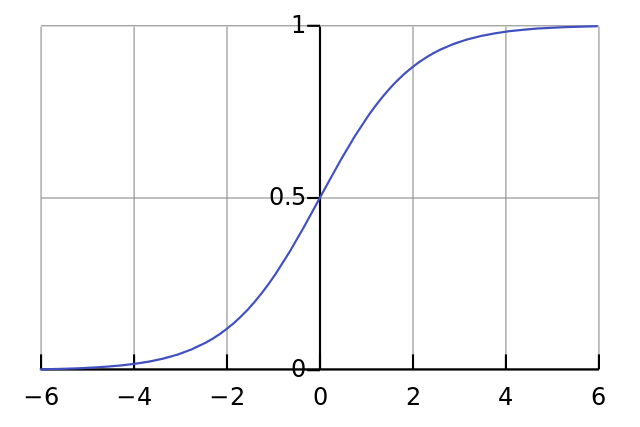

logistic曲线如下:

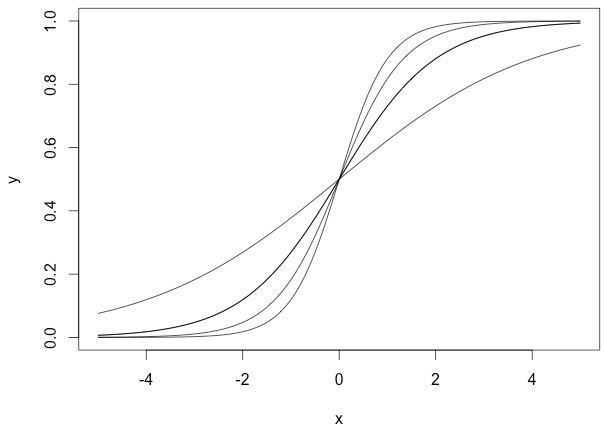

其中sigmoid结合卷积的w,b后变成:

此时的sigmoid的激活图就个w,b有关系,不同的w,b就有不同的激活曲线,从而产生非线性。

不同w,相同x,b产生的曲线图:

上面的曲线是由下面这几组参数产生的(x,w,b):

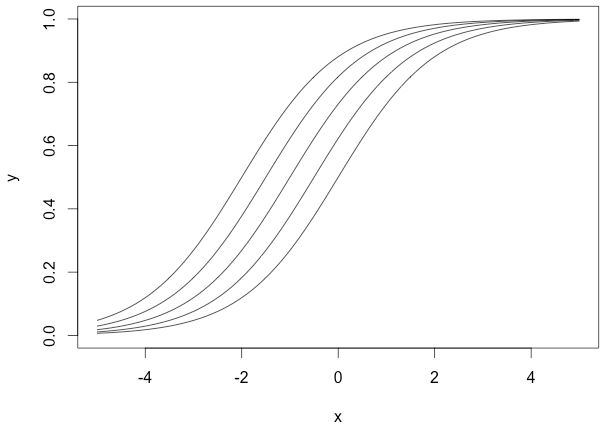

不同b,相同x,w产生的曲线图:

上面几个sigmoid曲线对应的参数组为:

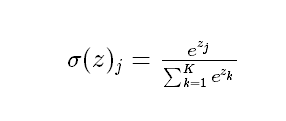

同样,我们贴一下wiki百科对softmax函数的定义:

softmax is a generalization of logistic function that “squashes”(maps) a K-dimensional vector z of arbitrary real values to a K-dimensional vector σ(z) of real values in the range (0, 1) that add up to 1.

这句话既表明了softmax函数与logistic函数的关系,也同时阐述了softmax函数的本质就是将一个K

维的任意实数向量压缩(映射)成另一个K

维的实数向量,其中向量中的每个元素取值都介于(0,1)之间。

softmax函数形式如下:

总结:sigmoid将一个real value映射到(0,1)的区间(当然也可以是(-1,1)),这样可以用来做二分类。

而softmax把一个k维的real value向量(a1,a2,a3,a4….)映射成一个(b1,b2,b3,b4….)其中bi是一个0-1的常数,然后可以根据bi的大小来进行多分类的任务,如取权重最大的一维。 其每个输出的值都是>0,而其输出总和为1,这个跟sigmoid函数不同。

参考博客:

最好的博文:深度学习常用激活函数之— Sigmoid & ReLU & Softmax

神经网络三:浅析神经网络backpropagation算法中的代价函数

参考后的小总结点:

1、Softmax 是神经网络中另一种输出层函数,计算输出层的值。主要用于神经网络最后一层,作为输出层进行多分类,是Logistic(sigmoid)二分类的推广。

2、要知道Softmax是否存在学习慢的问题,首先先定义Softmax的cost:

是否小

是否小

3070

3070

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?