在当前的技术环境下,大型语言模型(LLMs)已经成为人工智能领域的一个重要里程碑。这些模型能够在各种任务上展现出人类水平的性能,包括但不限于文本生成、语言理解和问题解答。随着开源项目的发展,个人开发者现在有机会在本地部署这些强大的模型,以探索和利用它们的潜力。本文将详细介绍如何使用Ollama,一个开源项目,在Mac上本地运行大型模型(Win同理)。通过遵循以下步骤,即使是配备了几年前硬件的电脑,也能够顺利完成部署和运行。

开源项目ollama:github链接

第一步:下载和安装Ollama

- 以 mac 为例,访问Ollama的Mac下载页面,您会看到如下所示的下载页面:下载网页地址

- 下载完成后,双击解压软件,您将看到应用安装界面,如下图所示::

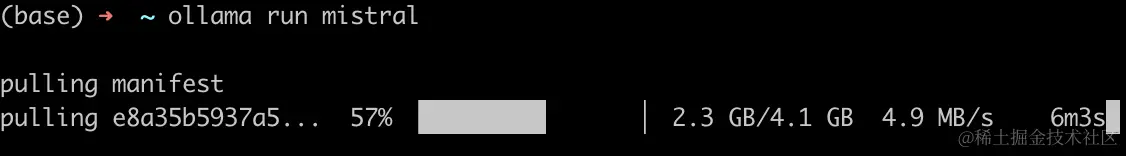

第二步:下载模型并运行 mistral-7b 大模型

- 打开终端,输入命令

ollama run mistral以启动Ollama并下载所需的大型模型,下图显示了mistral-7b模型的下载过程,

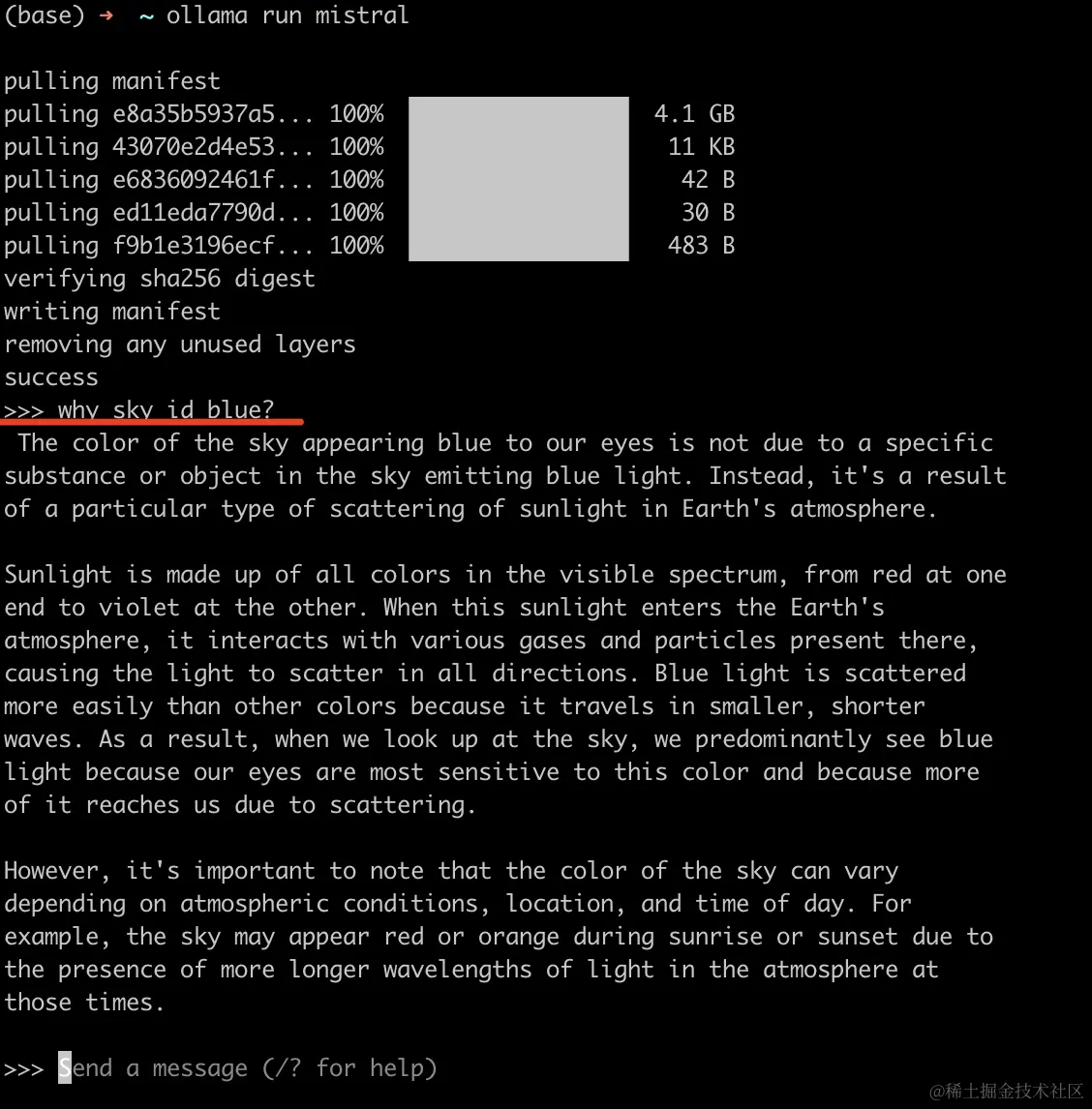

- 下载完成后,您可以像下图所示运行Ollama,并询问例如“why sky id blue?”的问题,以测试模型的响应:

第三步:设置前端界面和Docker环境

- 下载前端页面。在终端中运行以下命令,克隆open-webui前端项目:

git clone https://github.com/open-webui/open-webui.git

- 使用以下命令下载并运行Docker镜像,为Ollama设置一个前端界面:

cd open-webui

docker run -d -p 3000:8080 --add-host=host.docker.internal:host-gateway -v open-webui:/backend/data --name open-webui --restart always ghcr.io/open-webui/open-webui:main

- 打开浏览器,输入网址http://localhost:3000/,选择您刚下载的模型

mistral:latest (3.8GB),即可开始探索大型模型的强大功能。

此外,对于那些关注电脑配置的用户,以下是一个配置示例,表明即使是老旧的电脑也能够运行这些大型模型,本指南使用的电脑配置如图

此外,对于那些关注电脑配置的用户,以下是一个配置示例,表明即使是老旧的电脑也能够运行这些大型模型,本指南使用的电脑配置如图

通过遵循这个指南,任何拥有基本计算机技能的用户都可以在本地部署和运行大型模型,进一步探索人工智能的前沿技术。这不仅为开发者提供了一个实验和学习的平台,也为研究人员和爱好者提供了一个探索AI模型潜力的机会。

大模型岗位需求

大模型时代,企业对人才的需求变了,AIGC相关岗位人才难求,薪资持续走高,AI运营薪资平均值约18457元,AI工程师薪资平均值约37336元,大模型算法薪资平均值约39607元。

掌握大模型技术你还能拥有更多可能性:

• 成为一名全栈大模型工程师,包括Prompt,LangChain,LoRA等技术开发、运营、产品等方向全栈工程;

• 能够拥有模型二次训练和微调能力,带领大家完成智能对话、文生图等热门应用;

• 薪资上浮10%-20%,覆盖更多高薪岗位,这是一个高需求、高待遇的热门方向和领域;

• 更优质的项目可以为未来创新创业提供基石。

可能大家都想学习AI大模型技术,也想通过这项技能真正达到升职加薪,就业或是副业的目的,但是不知道该如何开始学习,因为网上的资料太多太杂乱了,如果不能系统的学习就相当于是白学。为了让大家少走弯路,少碰壁,这里我直接把全套AI技术和大模型入门资料、操作变现玩法都打包整理好,希望能够真正帮助到大家。

-END-

👉AI大模型学习路线汇总👈

大模型学习路线图,整体分为7个大的阶段:(全套教程文末领取哈)

第一阶段: 从大模型系统设计入手,讲解大模型的主要方法;

第二阶段: 在通过大模型提示词工程从Prompts角度入手更好发挥模型的作用;

第三阶段: 大模型平台应用开发借助阿里云PAI平台构建电商领域虚拟试衣系统;

第四阶段: 大模型知识库应用开发以LangChain框架为例,构建物流行业咨询智能问答系统;

第五阶段: 大模型微调开发借助以大健康、新零售、新媒体领域构建适合当前领域大模型;

第六阶段: 以SD多模态大模型为主,搭建了文生图小程序案例;

第七阶段: 以大模型平台应用与开发为主,通过星火大模型,文心大模型等成熟大模型构建大模型行业应用。

👉大模型实战案例👈

光学理论是没用的,要学会跟着一起做,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

👉大模型视频和PDF合集👈

观看零基础学习书籍和视频,看书籍和视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

👉学会后的收获:👈

• 基于大模型全栈工程实现(前端、后端、产品经理、设计、数据分析等),通过这门课可获得不同能力;

• 能够利用大模型解决相关实际项目需求: 大数据时代,越来越多的企业和机构需要处理海量数据,利用大模型技术可以更好地处理这些数据,提高数据分析和决策的准确性。因此,掌握大模型应用开发技能,可以让程序员更好地应对实际项目需求;

• 基于大模型和企业数据AI应用开发,实现大模型理论、掌握GPU算力、硬件、LangChain开发框架和项目实战技能, 学会Fine-tuning垂直训练大模型(数据准备、数据蒸馏、大模型部署)一站式掌握;

• 能够完成时下热门大模型垂直领域模型训练能力,提高程序员的编码能力: 大模型应用开发需要掌握机器学习算法、深度学习框架等技术,这些技术的掌握可以提高程序员的编码能力和分析能力,让程序员更加熟练地编写高质量的代码。

👉获取方式:

😝有需要的小伙伴,可以保存图片到wx扫描二v码免费领取【保证100%免费】🆓

5193

5193

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?