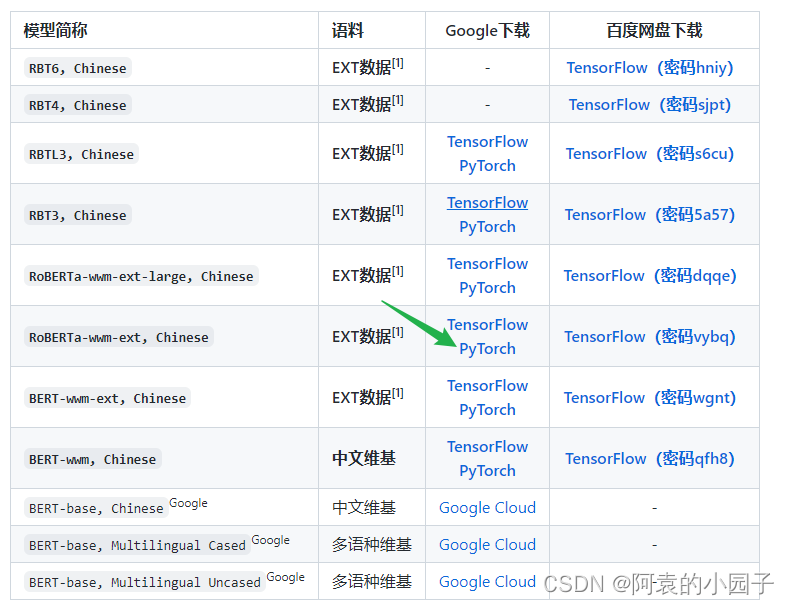

首先要从https://github.com/ymcui/Chinese-BERT-wwm中下载相应的模型解压到相应目录,比如我下载的是Chinese-Roberta-wwm-ext-pytorch:

import torch

from transformers import BertTokenizer,BertModel

MODELNAME="chinese_roberta_wwm_ext_pytorch"

# 加载分词器和模型

tokenizer=BertTokenizer.from_pretrained(MODELNAME)

model=BertModel.from_pretrained(MODELNAME)

input_ids=torch.tensor(tokenizer.encode("姚明出生地")).unsqueeze(0)

outputs=model(input_ids)

# 返回字向量

sequence_output=outputs[0]

# 返回句向量

pool_sequence=outputs[1]

print(sequence_output.shape)

print(pool_sequence.shape)

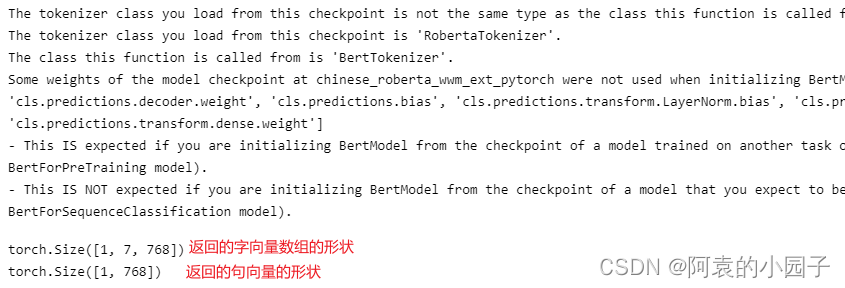

运行结果如下:

比如这句“姚明出生地”,这句话有5个字,加上Bert给它加的句首token和句末token,一共7个字,每个字向量的维度为768,所以返回的字向量的数组形状为1×7×768

4万+

4万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?