代码原理

双向门控循环单元(BI-GRU)是一种强大的深度学习模型,常用于时间序列预测和数据回归任务。以下是关于基于BI-GRU进行数据回归预测的简要介绍和步骤:

1. 模型概述

BI-GRU结合了双向和门控机制,使得模型能够更好地捕捉序列数据中的上下文信息。与传统的RNN相比,GRU在处理长序列时更具优势,因为它采用了门控机制来控制信息的流动。

2. 数据准备

- 数据收集:收集相关的时间序列数据,确保数据具有代表性。

- 数据预处理:①缺失值处理②特征选择③标准化

3. 模型构建

- 输入层:根据输入数据的特征维度设计输入层。

- 双向GRU层:使用双向GRU来提取特征,可以通过设置多个GRU层来增加模型复杂度。

- 全连接层:将GRU层的输出传递给全连接层,以进行回归任务。

- 输出层:通常为单个神经元,用于输出预测结果。

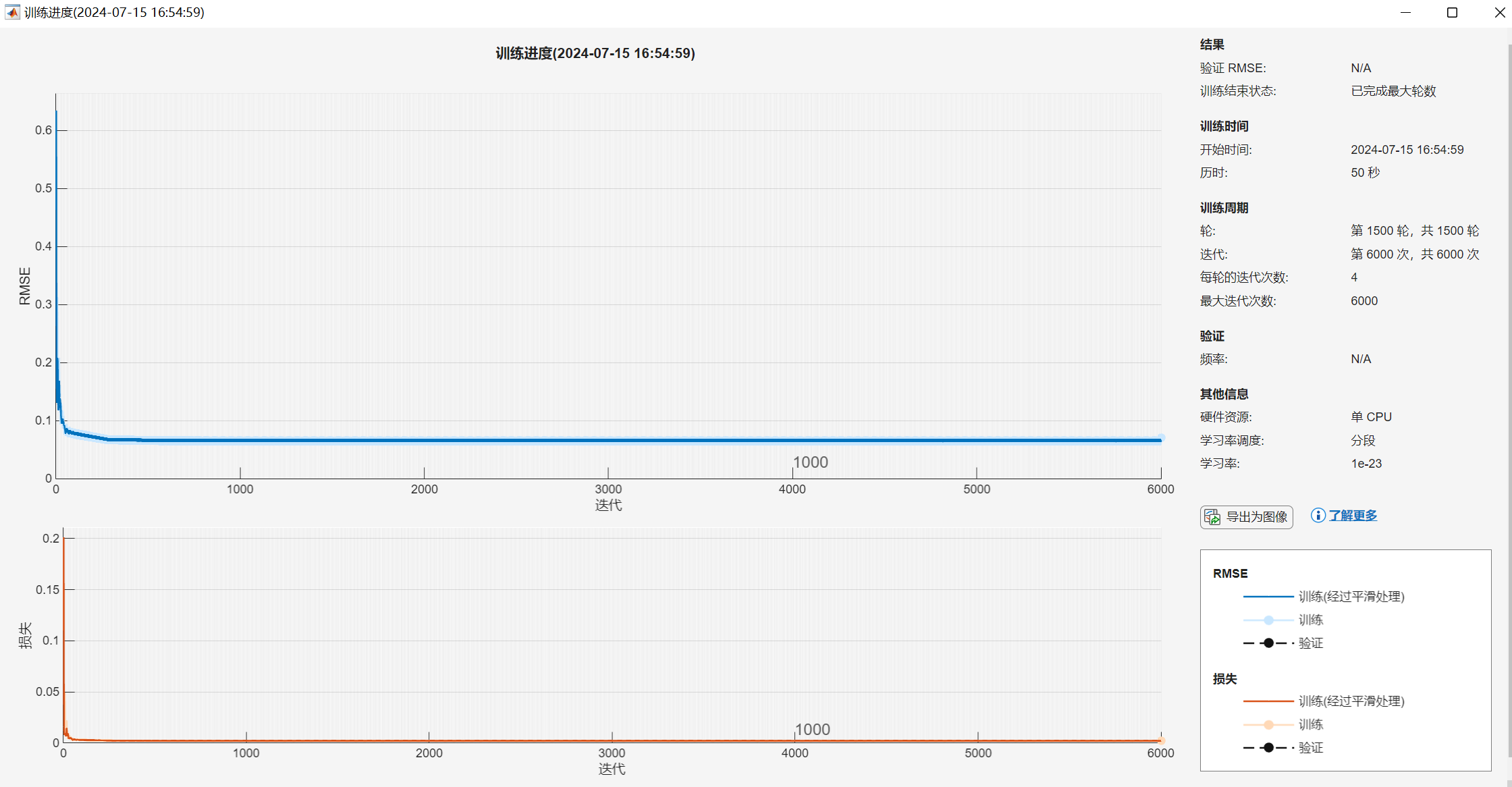

4. 模型训练

- 损失函数:常用均方误差(MSE)来评估回归模型的性能。

- 优化器:可以选择Adam或SGD等优化器来训练模型。

- 超参数调整:根据验证集的表现调整超参数,如学习率、批大小等。

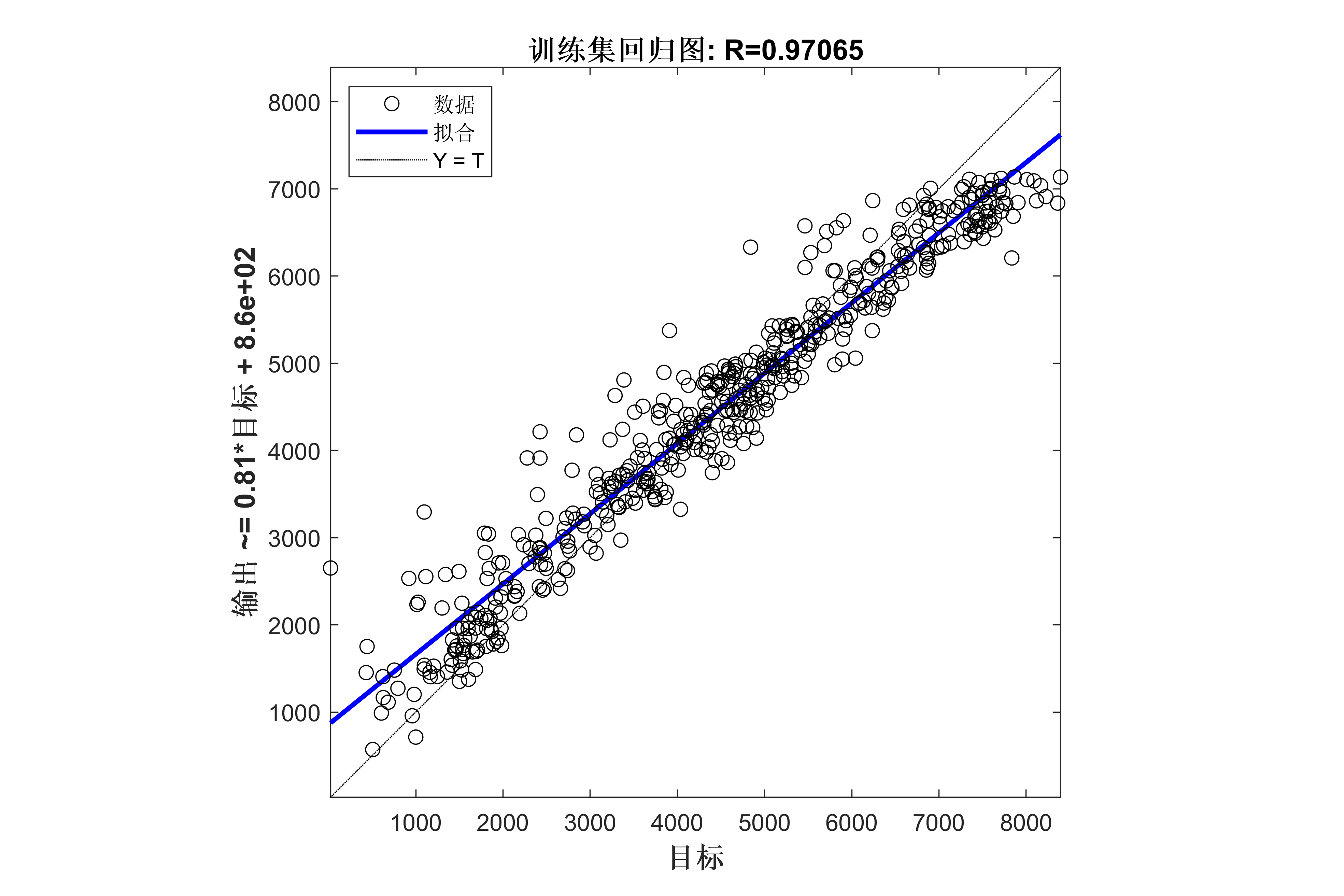

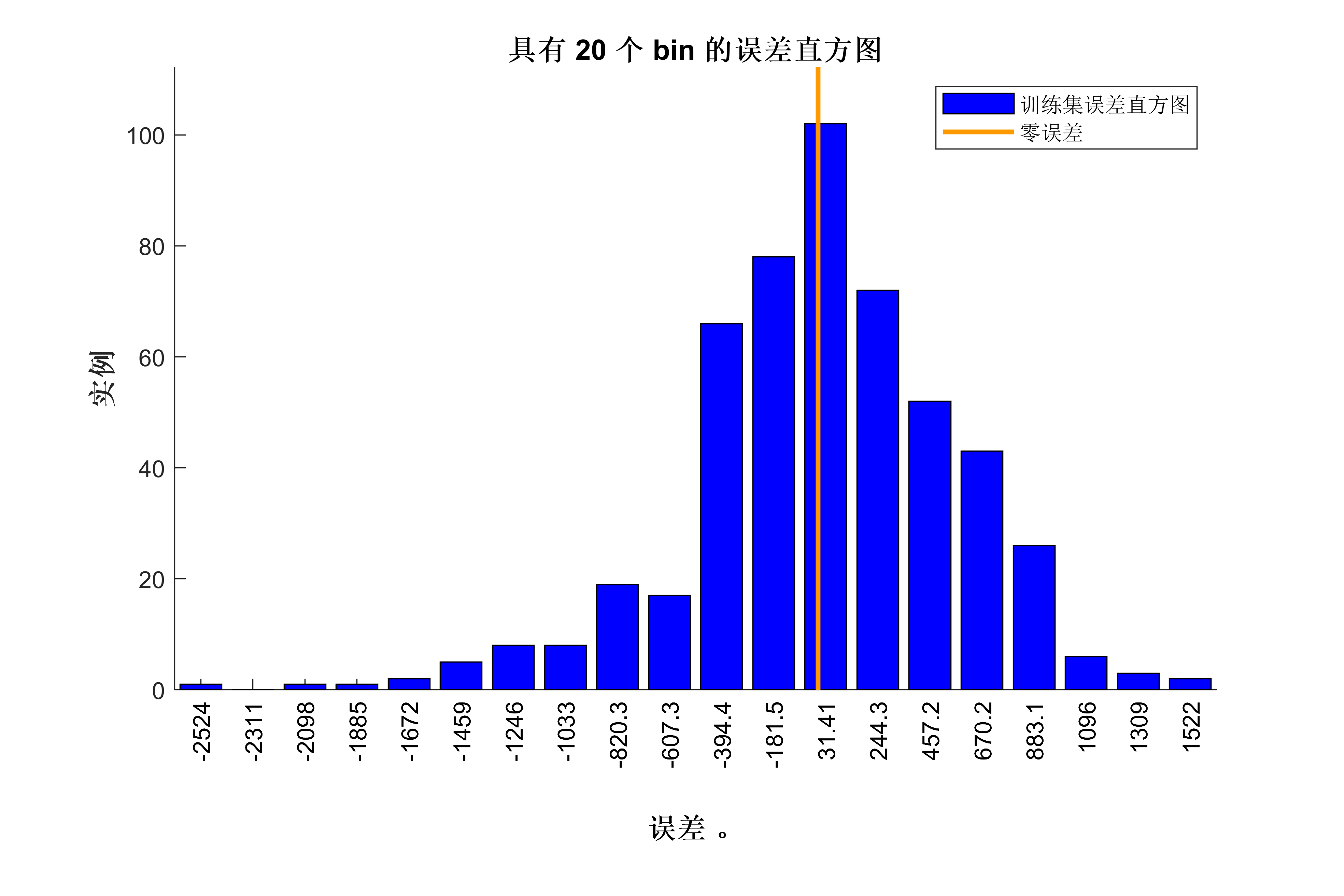

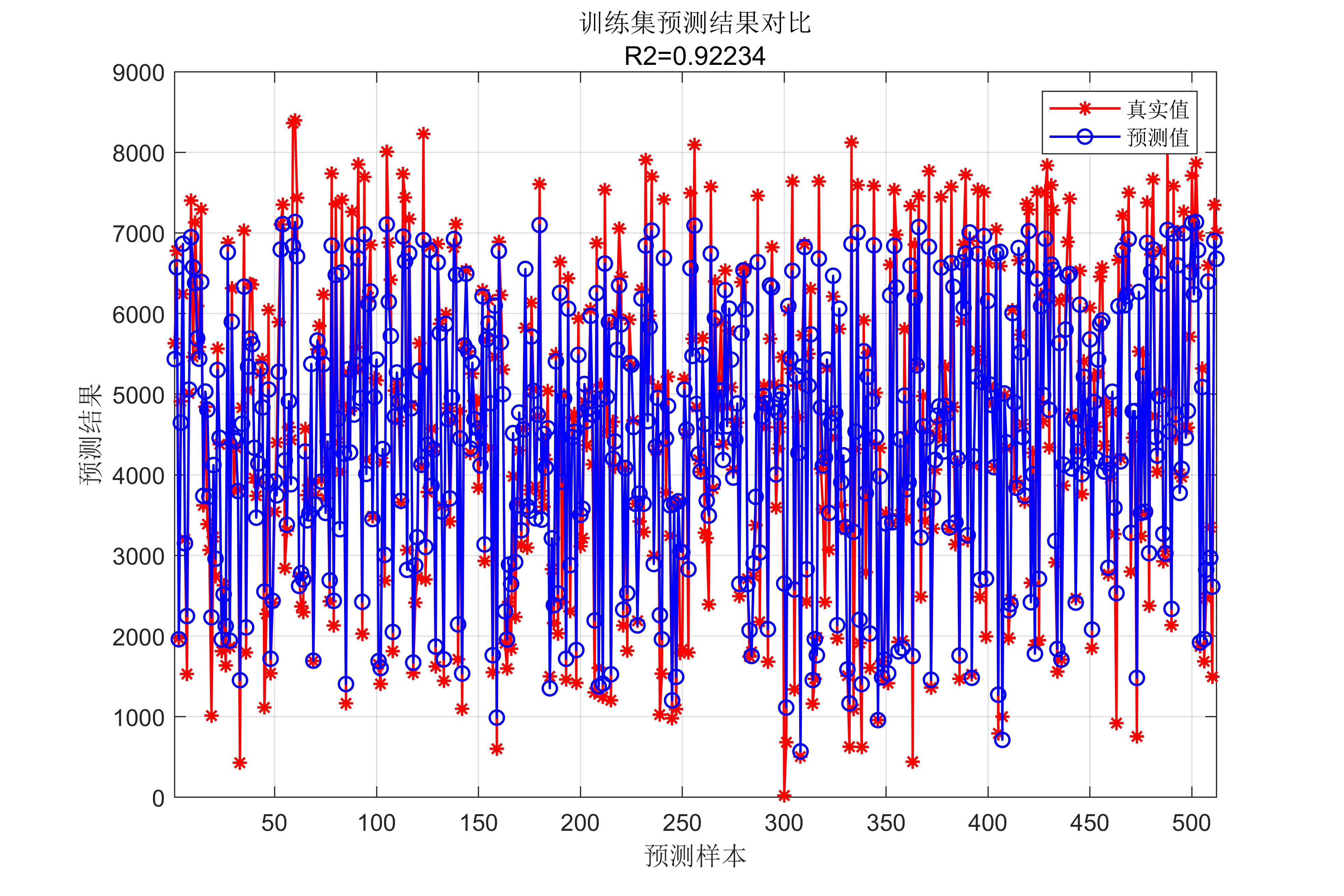

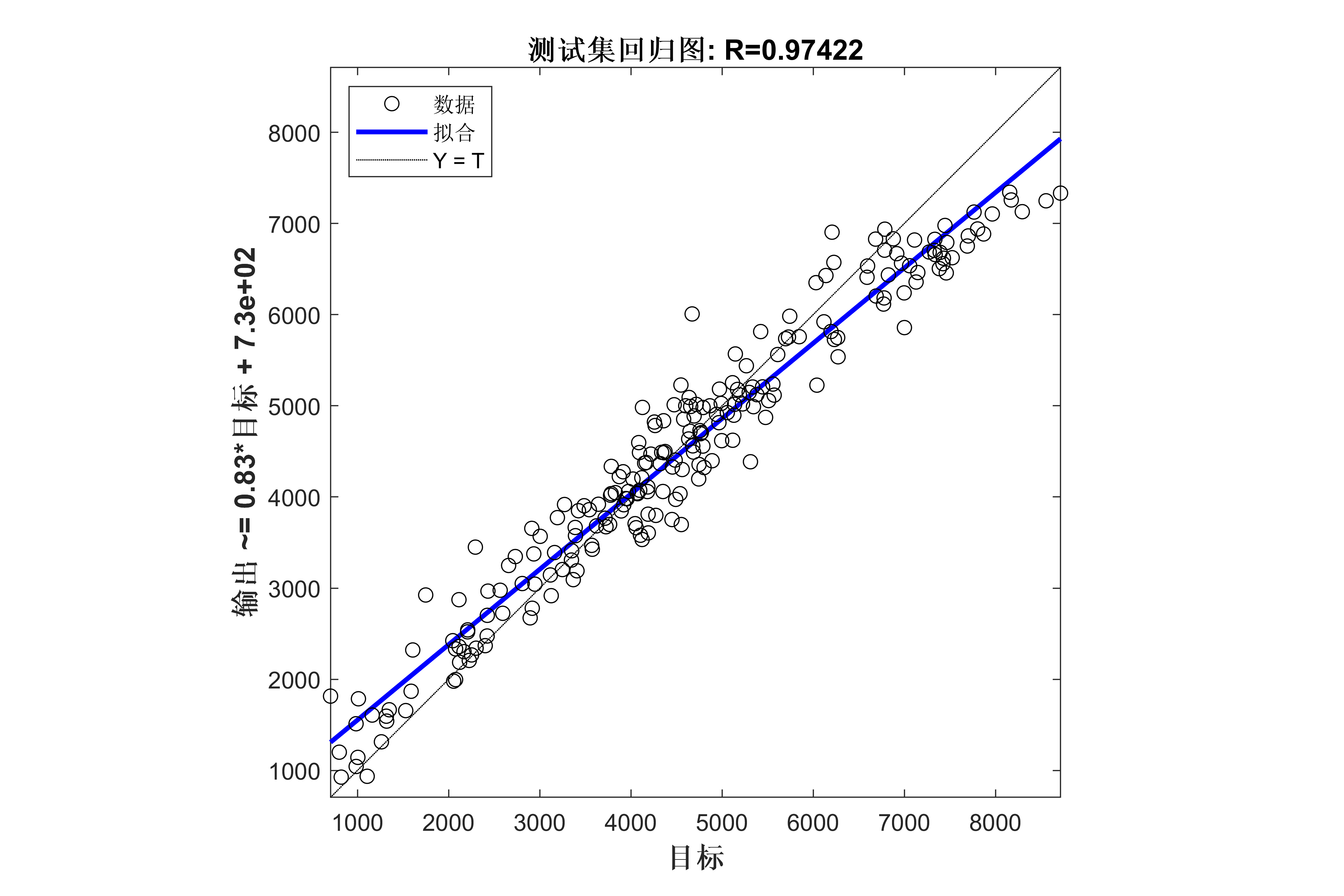

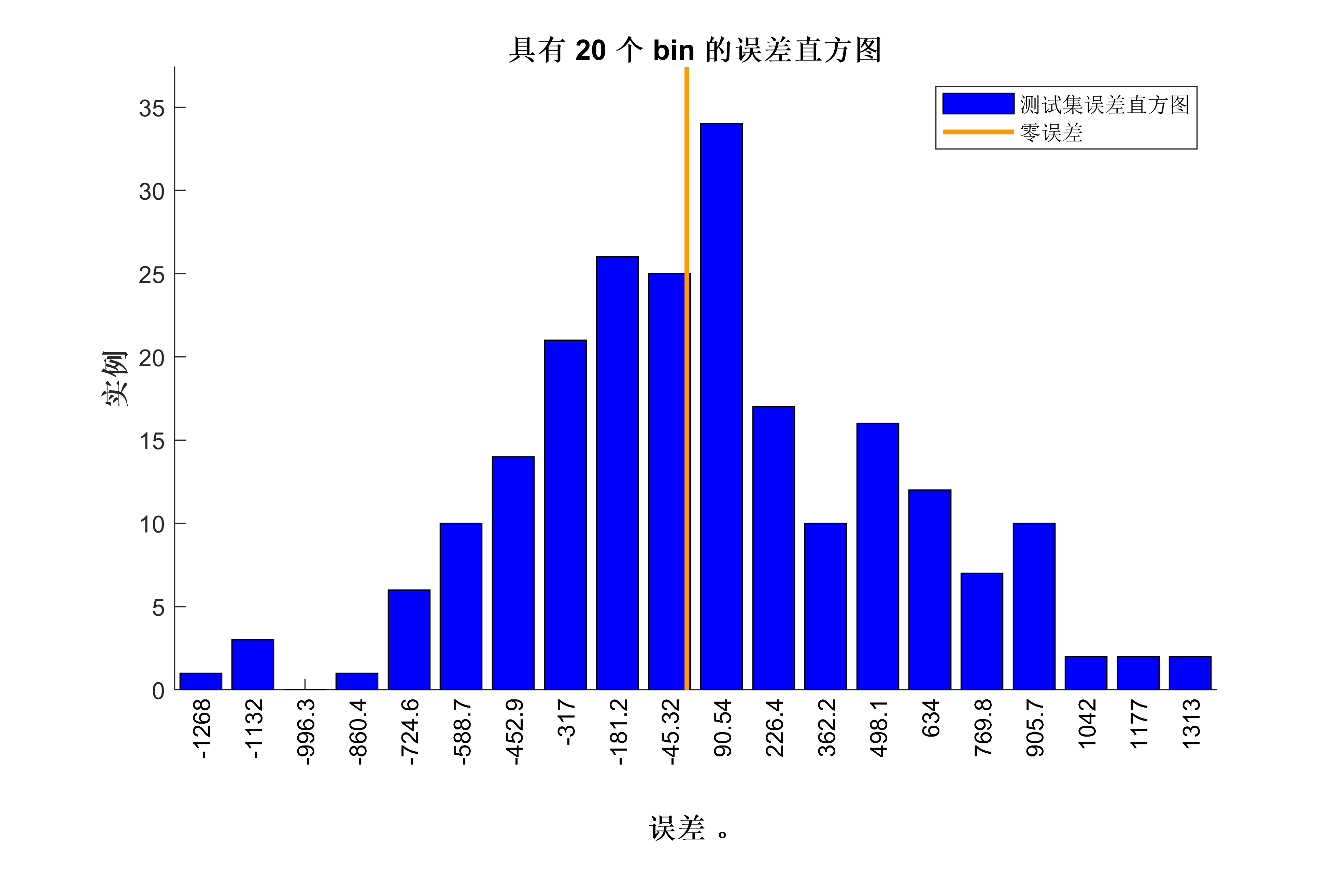

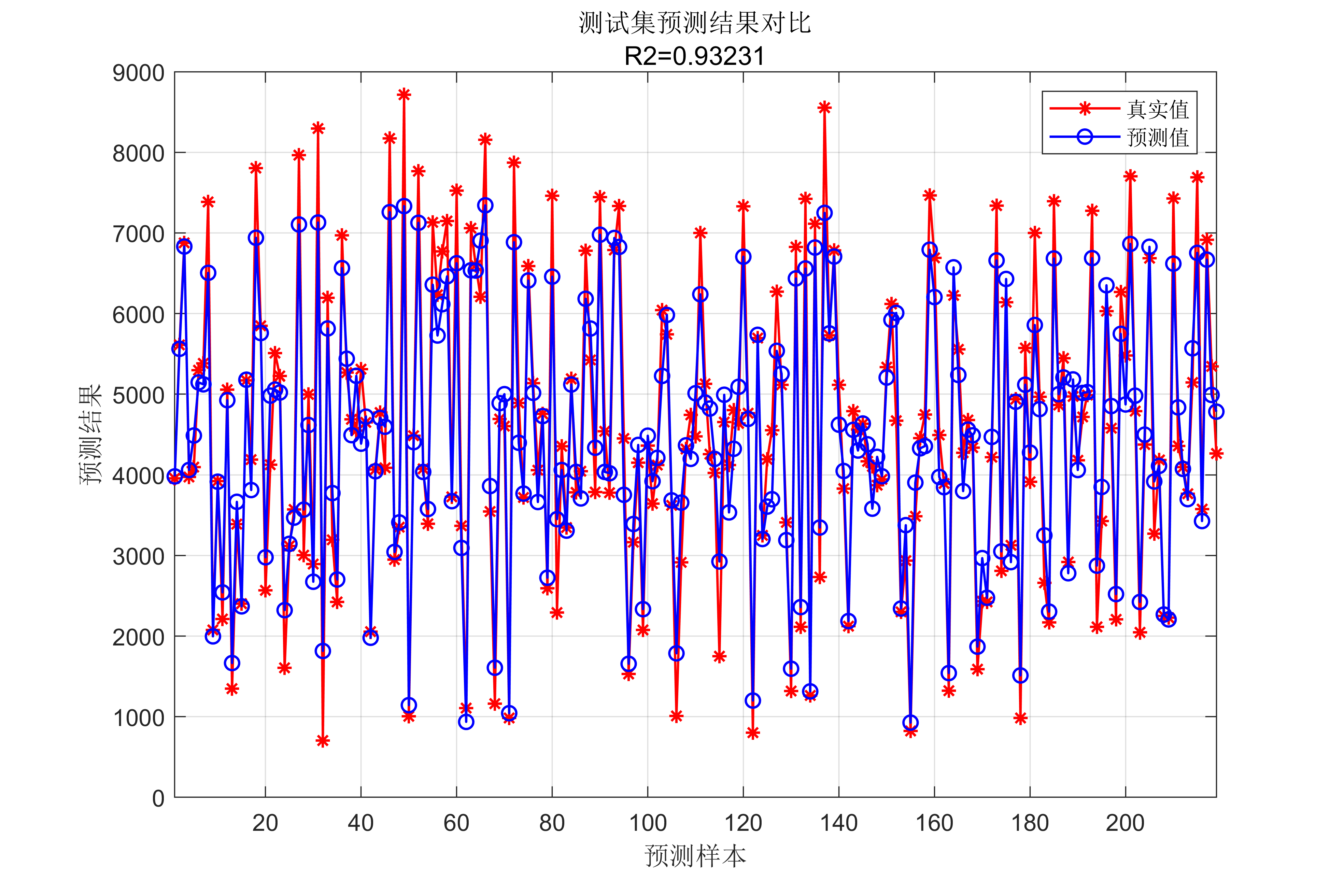

5. 模型评估

- 使用测试集评估模型性能,计算常用指标如MSE、MAE等。

- 可视化预测结果与真实值的对比,分析模型表现。

6. 预测与应用

- 训练完成后,可以使用模型对新数据进行预测。

- 在实际应用中,模型可以部署到生产环境中进行实时预测。

部分代码

%% 清空环境变量

warning off % 关闭报警信息

close all % 关闭开启的图窗

clear % 清空变量

clc

%% 导入数据

data = readmatrix('回归数据集.xlsx');

data = data(:,1:14);

res=data(randperm(size(data,1)),:); %此行代码用于打乱原始样本,使训练集测试集随机被抽取,有助于更新预测结果。

num_samples = size(res,1); %样本个数

% 训练集和测试集划分

outdim = 1; % 最后一列为输出

num_size = 0.7; % 训练集占数据集比例

num_train_s = round(num_size * num_samples); % 训练集样本个数

f_ = size(res, 2) - outdim; % 输入特征维度

P_train = res(1: num_train_s, 1: f_)';

T_train = res(1: num_train_s, f_ + 1: end)';

M = size(P_train, 2);

P_test = res(num_train_s + 1: end, 1: f_)';

T_test = res(num_train_s + 1: end, f_ + 1: end)';

N = size(P_test, 2);

% 数据归一化

[p_train, ps_input] = mapminmax(P_train, 0, 1);

p_test = mapminmax('apply', P_test, ps_input);

[t_train, ps_output] = mapminmax(T_train, 0, 1);

t_test = mapminmax('apply', T_test, ps_output);

% 格式转换

for i = 1 : M

vp_train{i, 1} = p_train(:, i);

vt_train{i, 1} = t_train(:, i);

end

for i = 1 : N

vp_test{i, 1} = p_test(:, i);

vt_test{i, 1} = t_test(:, i);

end

%% 网络搭建

lgraph = layerGraph();

% 添加层分支

% 将网络分支添加到层次图中。每个分支均为一个线性层组。

tempLayers = sequenceInputLayer(f_,"Name","sequence");

lgraph = addLayers(lgraph,tempLayers);

tempLayers = flattenLayer("Name","flatten");

lgraph = addLayers(lgraph,tempLayers);

tempLayers = gruLayer(15,"Name","gru1");

lgraph = addLayers(lgraph,tempLayers);

tempLayers = [

FlipLayer("flip3")

gruLayer(15,"Name","gru2")];

lgraph = addLayers(lgraph,tempLayers);

tempLayers = [

concatenationLayer(1,2,"Name","concat")

fullyConnectedLayer(outdim,"Name","fc")

regressionLayer("Name","regressionoutput")];

lgraph = addLayers(lgraph,tempLayers);

% 清理辅助变量

clear tempLayers;

% 连接层分支

% 连接网络的所有分支以创建网络图。

lgraph = connectLayers(lgraph,"sequence","flatten");

lgraph = connectLayers(lgraph,"flatten","gru1");

lgraph = connectLayers(lgraph,"flatten","flip3");

lgraph = connectLayers(lgraph,"gru1","concat/in1");

lgraph = connectLayers(lgraph,"gru2","concat/in2");代码效果图

获取代码请关注MATLAB科研小白的个人公众号(即文章下方二维码),并回复数据回归预测本公众号致力于解决找代码难,写代码怵。各位有什么急需的代码,欢迎后台留言~不定时更新科研技巧类推文,可以一起探讨科研,写作,文献,代码等诸多学术问题,我们一起进步。

742

742

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?