在YOLO系列算法的分布式训练中,"rank"、"local-rank" 和 "world_size" 是三个相关的概念,它们在协调和管理分布式训练过程中起着关键作用。

1. 名词解释

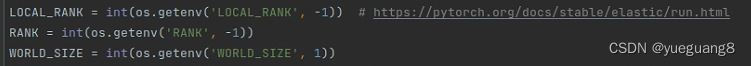

Rank(排名):在分布式训练中,"rank" 用于标识每个计算设备的唯一身份或标识符。每个设备都被分配一个 rank 值,用于区分不同的设备。这些 rank 值通常是从 0 开始递增的整数,例如,0、1、2、3 等。每个设备可以通过其 rank 值来确定其在整个分布式系统中的角色和任务。

Local Rank(本地排名):在分布式训练中,"local-rank" 是指在单个计算设备上的排名。当一个计算设备上有多个计算单元(例如,多个GPU)时,每个计算单元也可以被分配一个 local-rank 值。这样可以在设备内部进行并行计算和通信操作。local-rank 值通常是从 0 开始递增的整数。

World_size(全局规模):world_size 是指分布式训练中使用的设备总数,即参与训练的设备数量。它是所有设备的 rank 值的范围,通常与实际使用的设备数量相对应。

2.作用

2.1 Rank(排名):每个计算设备(例如,GPU或计算机节点)被分配一个唯一的 rank 值,用于标识设备在分布式系统中的身份。每个设备的 rank 值可以用于确定其在整个训练任务中的角色和任务分配。主要作用包括:

数据分发:训练数据通常被划分为多个子集,在分布式训练中,不同设备的 rank 值可以用于确定每个设备负责处理哪个数据子集。

参数同步:分布式训练中的目标是通过协同计算设备上的模型参数来提高训练效果。rank 值用于确定参数在不同设备之间的同步方式,例如,全局同步、局部同步或异步。

梯度聚合:在分布式训练中,每个设备上的模型进行前向传播和反向传播计算后,需要将梯度聚合到一个全局梯度中,rank 值用于确定梯度的聚合方式和参与聚合的设备。

2.2 Local Rank(本地排名):当一个计算设备上有多个计算单元(例如,多个GPU)时,每个计算单元可以被分配一个 local-rank 值,用于在设备内部进行并行计算和通信操作。主要作用包括:

并行计算:在设备内部,不同的计算单元可以并行执行模型的前向传播和反向传播计算,提高计算效率。

通信操作:在设备内部,不同的计算单元可以通过 local-rank 值进行通信和交换计算结果,例如梯度的传递和聚合。

通过 rank 和 local-rank 值,分布式训练系统可以实现数据的分发、参数的同步和梯度的聚合等操作,从而有效地利用多个计算设备进行模型训练,提高训练速度和模型性能。

2.3 World_size(全局规模):world_size 的作用包括:

系统配置:world_size 可用于配置分布式训练系统,确保所有设备都能够正确地参与到训练过程中。

任务划分:根据 world_size,可以将训练任务合理地划分到不同的设备上,实现数据的分发、参数的同步和梯度的聚合。

通过 rank、local-rank 和 world_size 的配合使用,分布式训练系统可以有效地进行数据分发、参数同步和梯度聚合等操作,以实现高效的模型训练和加速。具体的使用方式和实现细节可能因不同的分布式训练框架而有所差异,因此在具体的环境中,可能需要参考相关文档或代码来了解其具体用法。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?