也挺有意思的记一下。

首先是我用国补买了一台mac mini m4,我选了最低配的,大约到手3500。 16G256G。

本质上,苹果是按照存储定价的。一部分是UMA,一部分是硬盘。对大模型来说,关键是UMA,16G相对还是便宜的,再高就要贵很多。关键是当模型可以装入内存,剩下的就是算力。然而更贵的cpu是一样的核数。

在mac上用ollama跑大模型也是最方便的,安装一下软件,pull一下就好了。

之前在单机上测的好好的,然后我就想用局网的其他机器(ubuntu)去访问服务。然后发现连接不通。

反正之后又摸索了好一会,大约半小时到一小时,整明白了。

- 1 不一定需要homebrew去安装,只要修改环境变量就可以了。

我问了豆包,最初它的回答正确了99%,可惜大小写搞错了。我估计它的资料是更早一些的,后来的ollama变了。

launchctl setenv OLLAMA_HOST="0.0.0.0"

- 2 重启我并没有找到合适的命令,所以我在图标上退出

然后随便执行一条

ollama list

这样就会重新唤起ollama,相当于重启了

- 3 最后是确认

sudo lsof -i -P -n | grep 11434

输入密码就可以看到

原来是

ollama 82258 xxxx 3u IPv4 0x704c53e9553e0f25 0t0 TCP 127.0.0.1:11434 (LISTEN)

变成了

ollama 82258 xxxx 3u IPv4 0x704c53e9553e0f25 0t0 TCP *:11434 (LISTEN)

然后局网就可以访问了

In [6]: call_local_deepseek(user_prompt ='你是谁',model='deepseek-r1:14b',base_url='http://局网地址:11434/v1')

call_local_deepseek takes 11.19

Out[6]: '<think>\n\n</think>\n\n您好!我是由中国的深度求索(DeepSeek)公司开发的智能助手DeepSeek-R1。如您有任何任何问题,我会尽我所能为您提供帮助。'

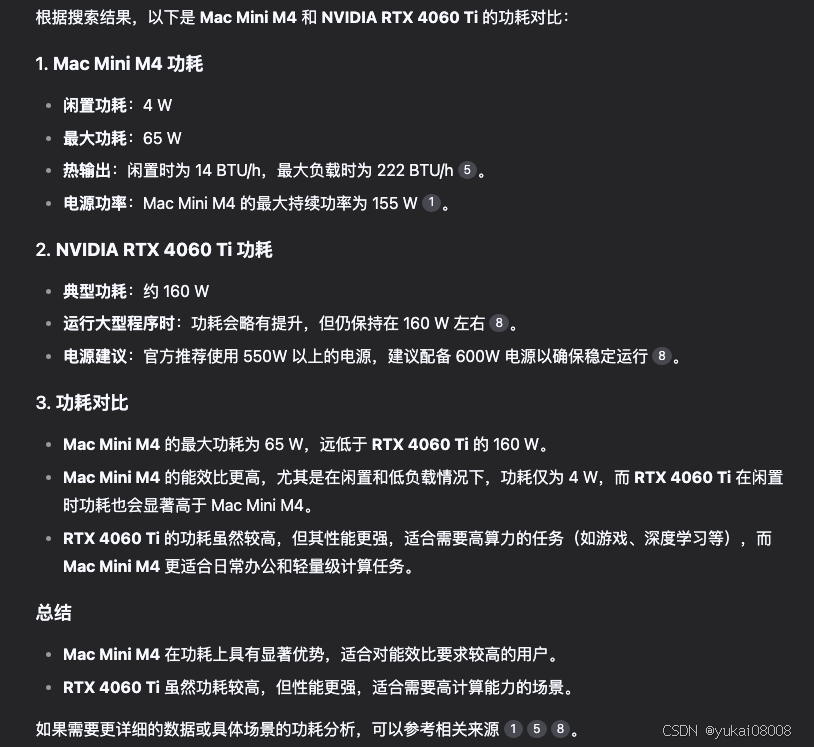

以deepseek-r1-14b为例,执行效率上,m4入门级芯片的算力大约为4060ti一半,比我预想的要差一些。那么从性价比上,两者还是打平了。mac 毕竟是一台完整的电脑 ,还能执行多种功能,能耗低,无需额外散热,没噪音,体积小。

只能说从能效比上,mac mini还是比4060ti厉害点,毕竟是arm。

然后4090是3倍的4060ti,那么执行类似的任务市场需要5-6秒。考虑到4个并发,那么差不多1秒一个。如果专门用vllm之类的去部署,可以再拉高一些能力。所以毛估估,4090一天可以大约处理10万数据,还是满功率。所以说大模型时代的数据处理成本真的是以前的百万倍。

354

354

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?