参考:

https://easyai.tech/ai-definition/word2vec/

https://jalammar.github.io/illustrated-word2vec/

Word2vec 是 Word Embedding 词嵌入的方法之一。

Word Embedding 就是将「不可计算」「非结构化」的词转化为「可计算」「结构化」的向量。

Word2vec 有 2 种训练模式。

CBOW(Continuous Bag-of-Words Model)

通过上下文来预测当前值。相当于一句话中扣掉一个词,让你猜这个词是什么。

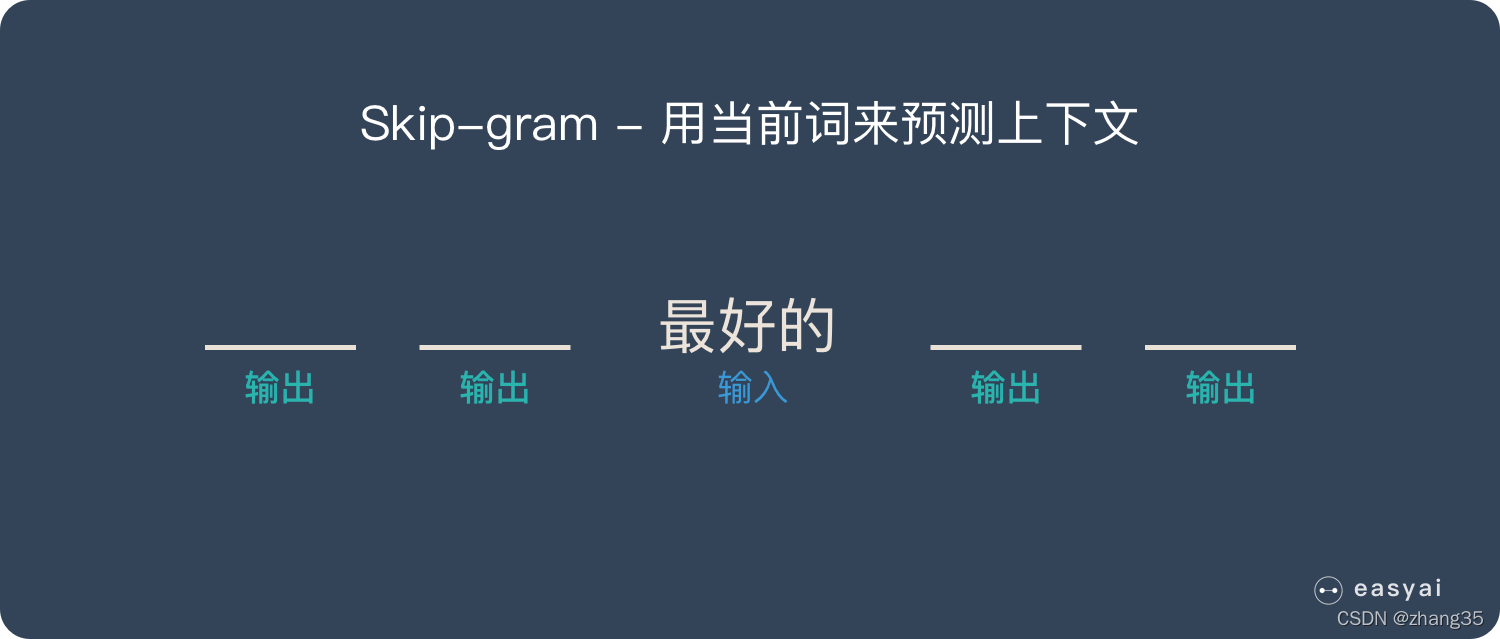

Skip-gram (Continuous Skip-gram Model)

用当前词来预测上下文。相当于给你一个词,让你猜前面和后面可能出现什么词。

训练过程如下。

滑动窗口,产生训练集:

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

3596

3596

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?