ZHU C, CHEN M, FAN C, et al. Learning from history: Modeling temporal knowledge graphs with sequential copy-generation networks; proceedings of the Proceedings of the AAAI Conference on Artificial Intelligence, F, 2021 [C].

目录

创新点

作者观察到许多事实沿着时间线显示出重复的模式(例如经济和外交活动),说明一个模型可以从历史上出现的已知事实学到很多东西。

因此作者提出的CyGNet包括两部分:(1)复制模式(Copy Mode):旨在识别重复出现的事实,从历史中和某(s,p)交互的所有目标(o)实体组成的历史词汇中选择实体,作为预测结果;(2)生成模式(Generation Mode):从整个实体词汇中预测实体。最后将两种预测概率加权组合。

1 Introduction

(1)知识图是广泛用于真实世界事实的知识表示资源。可以用于很多领域…… 目前快速增长的数据往往表现出复杂的时间动态,需要方法可以分配具有时间属性的实体之间的交互来建模这种事实的动态,即TKG。代表性的TKG有GDELT ICEWS。

(2)很多研究工作投入到TKG的表征学习中。通常用时间特定的嵌入对实体关系的时间演变事实进行编码。这提供了一种通用且高效的工具,用于基于过去事实的嵌入表示来完成TKG的未来事实。有利于广泛的下游应用,例如交易推荐、事件过程归纳和社会关系预测。1)几种时间知识图嵌入(TKGE)方法只专注于分别计算每个快照的潜在表示,因此无法捕捉连续时间快照中事实的长期相关性。2)最近的一些其他尝试通过合并以前快照中的过去信息来编码实体关系的时间演变事实,然而,时间事实的复杂演变,包括复发和趋势模式,可能会导致这些方法失败。3)作者在一些数据库中观察到大量的事实在时间上是重复的。这一现象突显了利用已知事实预测未来事实的重要性。然而,大多数现有的方法在建模TKG时都没有考虑到这种进化模式

2 Related work

作者先梳理了以下静态知识图谱的嵌入方法;然后先介绍了一部分TKG嵌入方法,但它们无法在连续时间快照中捕获时间的长期依赖性;之后介绍了一些可以捕捉TKG事实的长期依赖性的模型;最后介绍了文章中用到的来源于抽象摘要的复制机制。

3 Model

3.1 Notations

是TKG在t时间戳上的快照,g=(s,p,o,t)是

中的一个四元组(事实),其中

是主体实体和目标实体,

是谓语,

是时间戳。TKG建立在一组基于它们的时间戳按升序排列的事实四元组上,

。作者定义特定于

的历史词汇表定义为

,是在

时间之前的快照中

和特定的(s,p)作用的目标实体o,

是一个N维(N是

中实体的个数)的multi-hot,历史词汇表中实体的值被标记为1,而其他实体的值为0。

3.2 Model Components

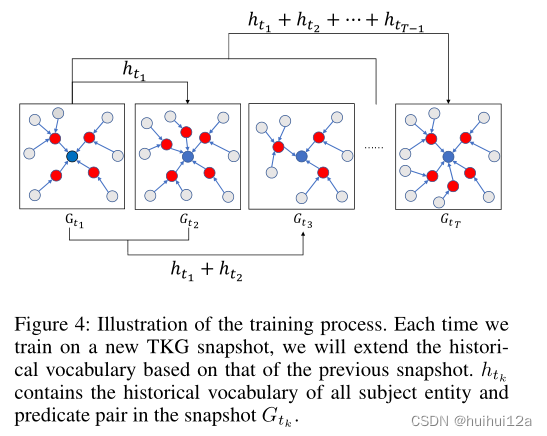

首先处理训练集,以获得每个训练快照t上和(s,p,t)交互作用的历史词汇。

是一个N维(N是

中实体的个数)的multi-hot,tk时刻出现在

中和(s,o)交互的实体的值被标记为1,而其他实体的值为0。

在每个快照上顺序训练模型,类似于递归的思想,通过增量维护所有先前快照的历史词汇表来训练

![]()

3.2.1 Copy Mode

复制模式旨在识别重复出现的事实,并通过复制历史上已知的事实来预测未来的事实。

如果query (s,p,?,),在时间步长tk具有特定于主题实体s和谓词p的历史词汇表

,则CyGNet将增加出现在历史词汇表中的目标实体o的估计概率。

首先复制模式使用MLP生成一个索引向量

其中tu是单位时间步长,tu=t1。是一个N维向量。

的维度为3d✖N,

的维度是N,两者为可训练的参数。

为了最大限度地减少一些实体在历史中没有形成具有s和p的已知事实的概率(即那些复制模式不感兴趣的实体,没有出现在历史中的实体),对进行调整为

,是将

中不感兴趣的实体的索引值更改为一个小负数。CyGNet可以通过添加索引向量vq和改变的多热点指示符向量

来界定候选空间,最小化不感兴趣实体的概率,然后用softmax函数估计历史词汇表中对象实体的概率:

其中cq是N维索引向量,使得与cq中不感兴趣的实体相对应的值被分配为接近于零。p(c)是一个向量,其大小等于整个实体词汇的大小,用于表示历史词汇的预测概率。最终,p(c)的最大维度指示要从历史词汇表中复制的对象实体。

复制模式的优点是,它能够从一个比整个实体词汇表更定界的候选空间中(历史词汇表)学习预测。

3.2.2 Generation Mode

事实也可能新出现在即将发布的快照中。因此,需要一种生成模式来预测这些事实。

给定相同的上述查询(s,p,?,tk),Generation模式负责通过从整个实体词汇表中选择对象实体来预测事实。Generation模式所做的预测将预测的事实视为一个全新的事实,而不参考历史。与复制模式类似,生成模式还生成索引向量gq,其大小等于候选空间

的大小,并使用softmax函数进行归一化以进行预测。

p(g)表示整个实体词汇表上的预测概率。p(g)中的最大值表示我们通过Generation模式在整个实体词汇表中预测的对象实体。

生成模式为复制模式提供了全新事实预测功能。

3.3 Learning Objective

在给定查询(s,p,?,t)时,预测对象实体可以被视为一个多分类任务,其中每个类对应一个对象实体。学习目标是在训练期间存在的TKG快照的所有事实上最小化以下交叉熵损失L:

其中是在快照

中的第i个真实值,

是当第i个真实对象实体为oi时,快照

第k个对象实体的组合概率值。

3.4 Inference

在不失一般性的情况下,将推理过程描述为在时间事实中预测缺失的对象,尽管这个过程也可以很容易地扩展到预测主体和关系。为了对查询(s,p,?,tk)进行预测,复制和生成模式都在其候选空间内以最高概率给出预测的对象实体,其中复制模式可以从比整个实体词汇表小得多的候选空间进行预测。为了确保中所有实体的概率之和等于1,引入系数α来调整复制模式和生成模式之间的权重。CyGNet通过将这两种模式给出的每个实体的概率相加,来组合来自复制模式和生成模式的概率预测。最终预测ot将是接收到最高组合概率的实体,

α在[0,1]之间。

4 Experiments

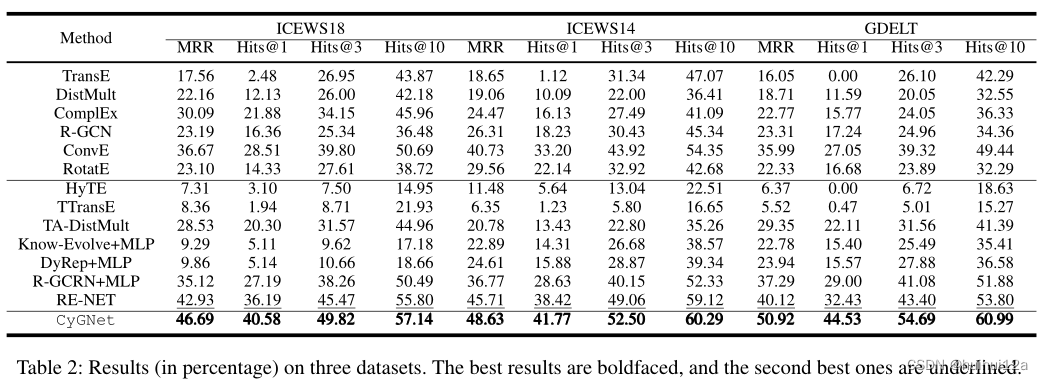

在前三个数据集上,静态KGE方法远远落后于RE-NET或CyGNet,因为它们无法捕捉时间动态。还可以观察到,所有静态KGE方法通常比TTransE和HyTE执行得更好。这是由于TTransE和HyTE只独立学习每个快照的表示,而缺乏捕捉长期依赖性。表2还显示,CyGNet在ICEWS18、ICEWS14和GDELT上显著优于其他基线。

在表3中还观察到,CyGNet在WIKI和Y AGO上并不总是表现最好,尤其是在WIKI上。

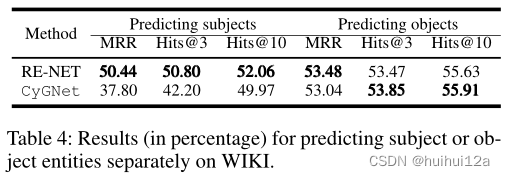

为了进行进一步的分析,将预测主体实体的结果和预测对象实体的结果分开(表4)。

可以观察到CyGNet在WIKI上预测对象实体方面表现得更好。事实上,这是由于主题和对象在参与WIKI上反复出现的事实中所占的比例不平衡。更具体地说,如果我们按主体和关系对事实进行分组,我们观察到多达62.3%的对象在历史上至少重复过一次,而主体实体(按关系和对象分组的事实)的复发率约为23.4%。不平衡的复发率阻碍了CyGNet两个组成部分的联合学习,因此对其整体预测性能造成了恶化的影响。

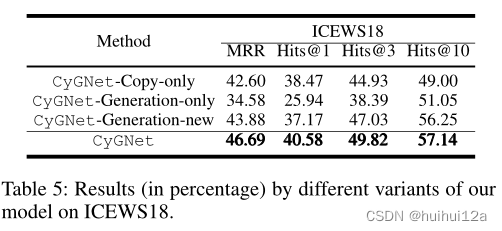

进行消融实验,验证复制模式和生成模式都很重要。删除复制模式会导致MRR下降12.11%,其他指标也会大幅下降,这表明学习通过参考过去已知的事实来预测未来的事实是有帮助的。另一方面,去除生成模式导致MRR下降4.09%,这计入了模型从头事实预测能力的损失。这些结果进一步解释了CyGNet有希望的性能是由于它既有从历史中学习的能力,也有从头开始识别和预测新事实的能力。

5 总结

作者基于这样一个假设,即未来的事实可以从历史上的事实中预测出来。所提出的CyGNet不仅能够预测整个开放世界的事实,而且能够识别重复出现的事实,并根据过去出现的已知事实相应地选择这些未来的事实。

2442

2442

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?