最小二乘意义下的参数最优解

参数的解析式

不可逆或是防止过拟合,增加扰动

半正定

对于任意实数大于0

简便方法记忆结合

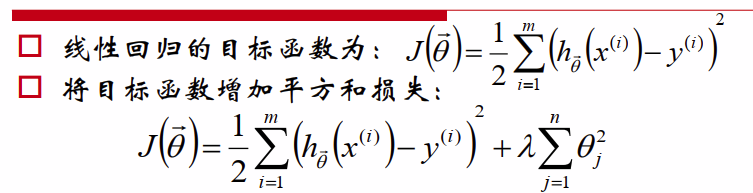

线性回归的复杂度惩罚因子

Ridge:岭回归

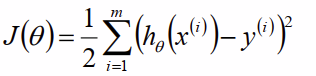

LASSO:

具有特征选择能力

正则项与防止过拟合:

正则化与稀疏:

机器学习与数据使用:

训练数据

训练数据、测试数据(评判模型好坏)

训练数据、验证数据(给定的参数就能找到相对应的值)、测试数据

交叉验证:

十折交叉验证

Moore-Penrose广义逆矩阵(伪逆)

SVD计算矩阵的广义逆

梯度下降算法:

批量梯度下降算法:

没有最优,只有更优(没有必要找全局最优,只要局部最优)

贪心算法,不一定能找到最优的,但是是当前的最好的选择

随机梯度下降算法:

批量梯度下降算法和随机梯度下降算法优先选择后者

折中:mini-batch

随机梯度下降:随着不断学习,损失是不断增加的

线性回归的进一步分析:

线性回归可以得出来曲线方程:完全取决于特征的选择

炮制虽繁必不敢省人工,品味虽贵必不敢减物力

1131

1131

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?