Graph Stochastic Neural Networks for Semi-supervised Learning

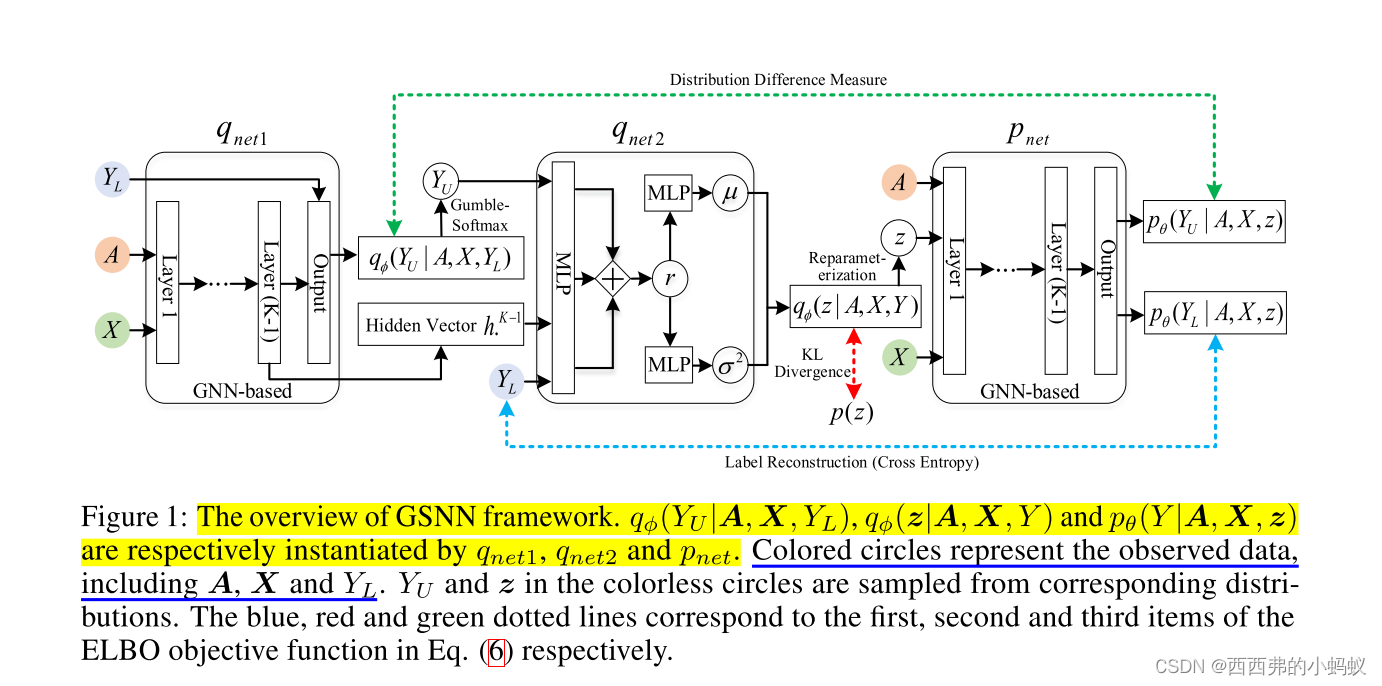

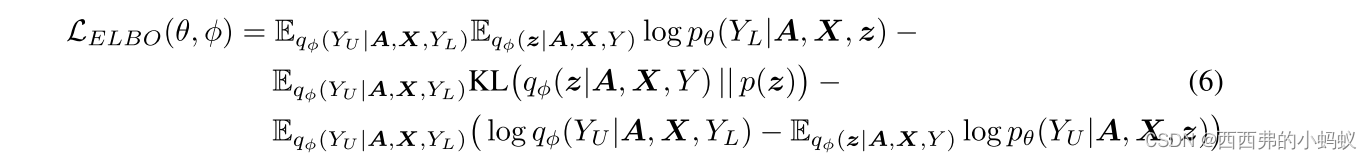

图神经网络(GNNs)在半监督节点分类任务中取得了显著的性能。然而,大多数现有模型学习的是确定的分类函数,缺乏足够的灵活性,无法在存在各种不完美的观察数据(如标记节点稀少和噪声图结构)时探索更好的选择。为了改善确定性分类函数的刚性和不灵活性,提出了一种新的框架——图随机神经网络(Graph Stochastic Neural Networks, GSNN),旨在通过同时学习一组函数(即随机函数)来建模分类函数的不确定性。引入一个耦合高维隐变量的可学习图神经网络来对分类函数的分布进行建模,并进一步采用平摊变分推理来逼近难以解决的标签缺失和隐变量的联合后验。通过最大化观测节点标签的似然下界,可以有效地以端到端的方式训练实例化模型。在三个真实数据集上的大量实验表明,与最先进的基线相比,GSNN在不同场景下取得了显著的性能提升。

总结:解决两个问题:1)半监督分类中数据不完美,存在噪音情况。

2)分类函数不灵活问题。现有的GNN模型大多以学习确定性分类函数为目标,缺乏足够的灵活性来适应各种不完美的观测数据

目标:学习一个函数族来模拟分类函数的不确定性。

采用方法:本文提出了一个耦合高维随机潜向量的可学习图神经网络,并进一步采用平摊变分推理来近似缺失标签和潜变量的棘手联合后验。

2252

2252

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?