SCALEFORMER: ITERATIVE MULTI-SCALE REFINING TRANSFORMERS FOR TIME SERIES FORECASTING

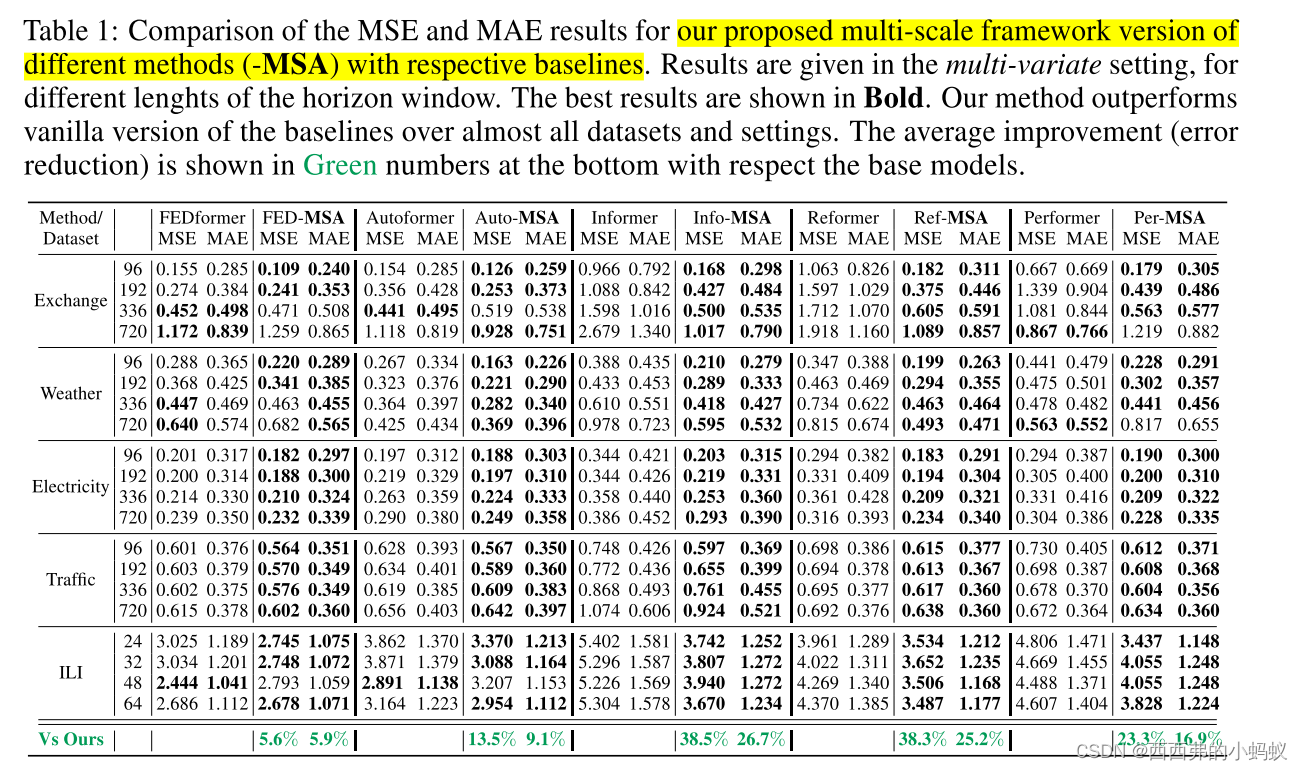

最近,由于transformer的引入,时间序列预测的性能得到了极大的提高。本文提出一种通用的多尺度框架,可应用于最先进的基于transformer的时间序列预测模型(FEDformer, Autoformer等)。通过在多个尺度上迭代优化具有共享权重的预测时间序列,引入架构自适应和特殊设计的规范化方案,能够实现显著的性能提升,在数据集和transformer架构上从5.5%到38.5%,而额外的计算开销最小。通过详细的消融研究,证明了在架构和方法上的每个贡献的有效性。此外,在各种公开数据集上的实验表明,所提出的改进优于相应的基线。

一解决的问题

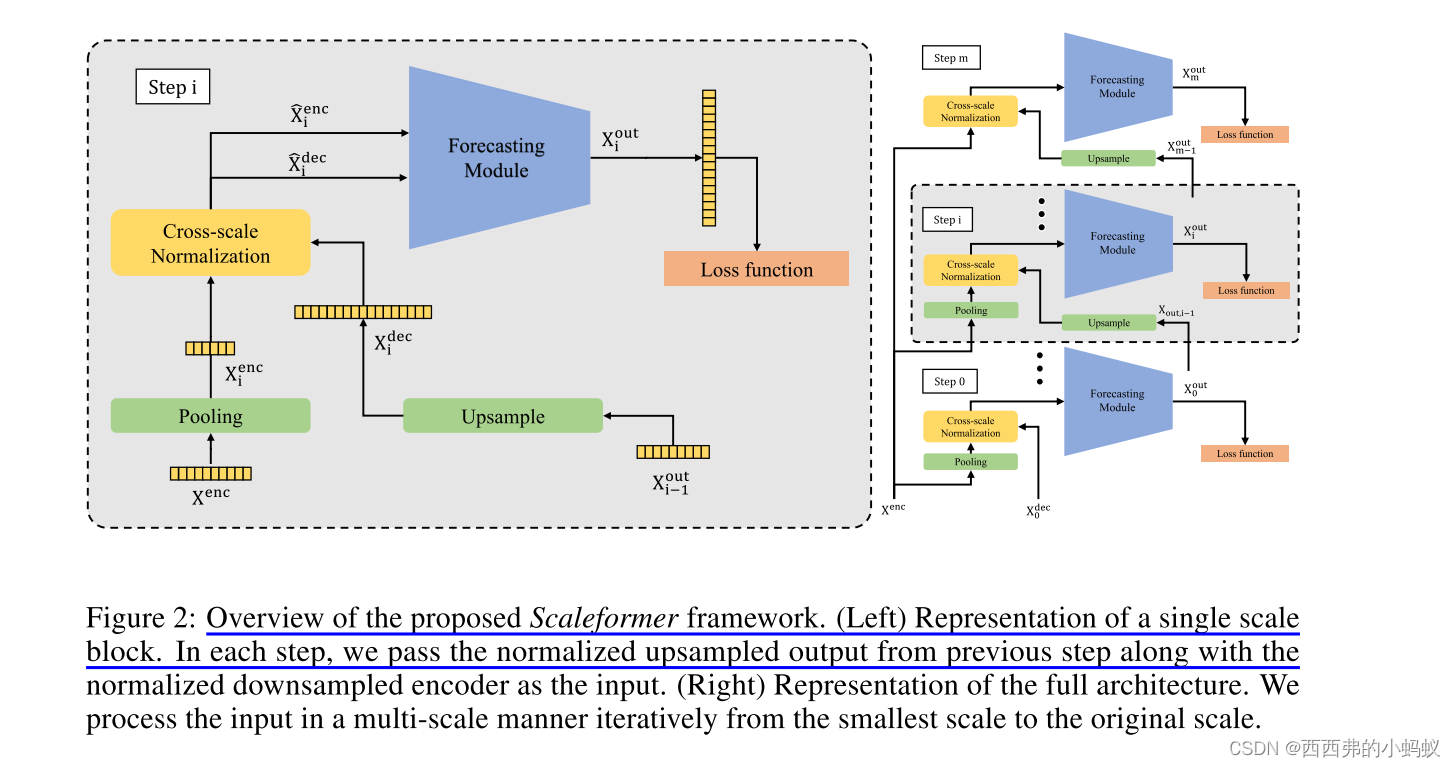

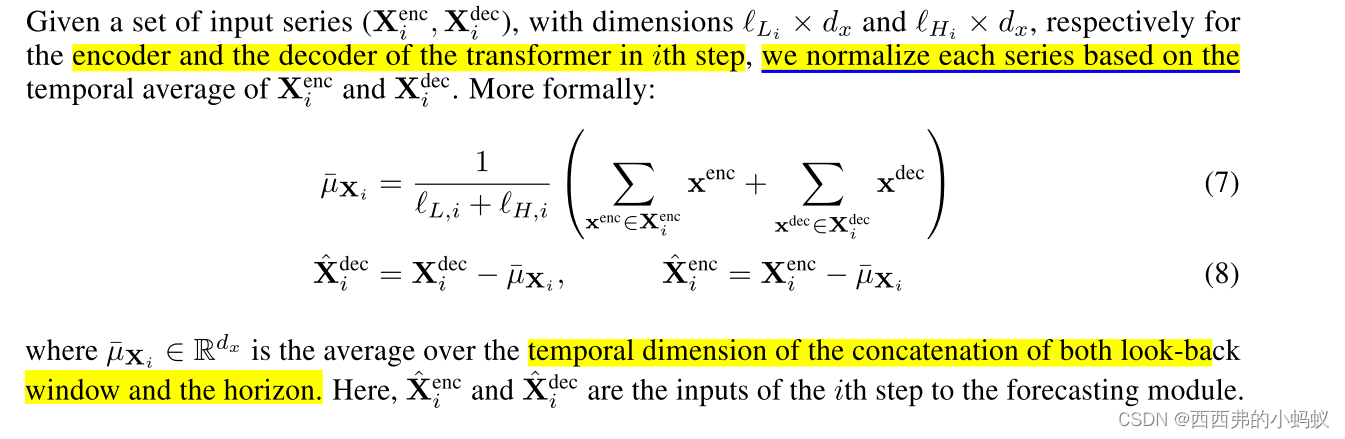

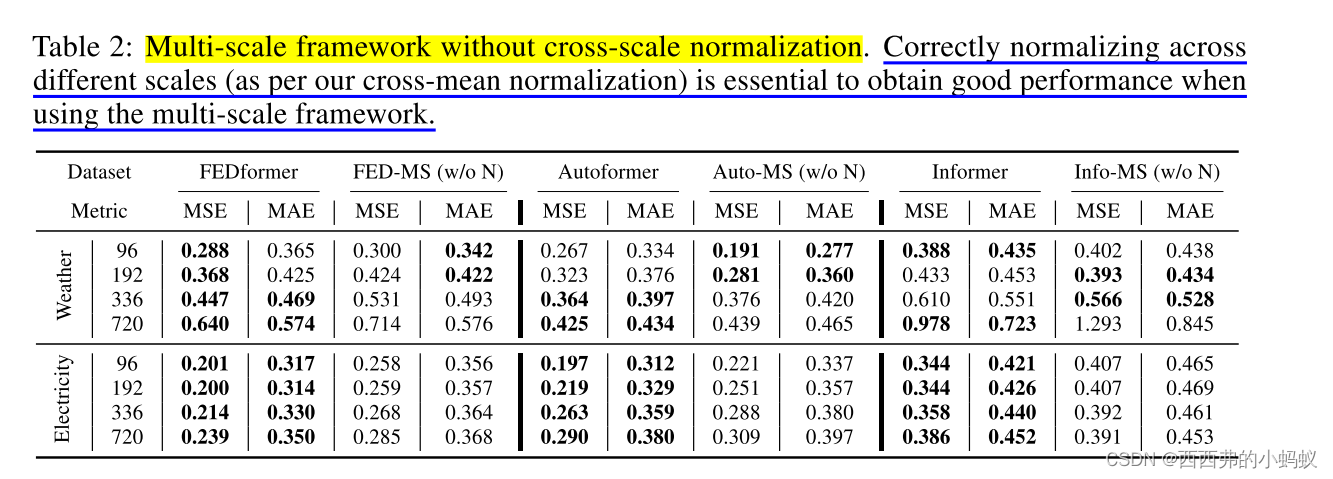

考虑到transformer对预测的重要性,我们能否让transformer更具规模感知能力?我们通过Scaleformer实现了这种缩放感知。然而,scale本身是不够的。不同尺度的迭代精化会导致中间预测之间的分布发生显著变化,从而导致错误传播失控。为缓解这个问题,在每个步骤引入跨尺度归一化。

模型

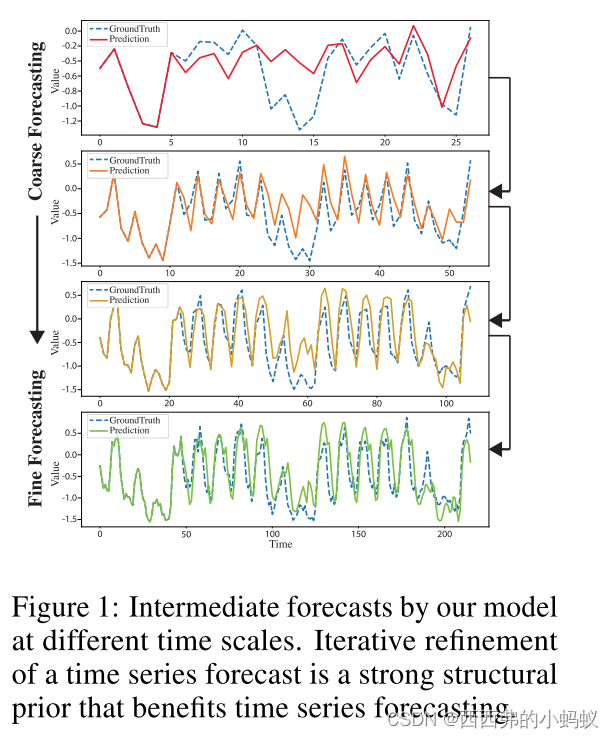

所提出的框架应用连续的transformer模块,在不同的时间尺度上迭代完善时间序列预测。

CROSS-SCALE NORMALIZATION

实验结果

956

956

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?