可以通过if,case语句来进行理性计算,专家系统-把专家的经验告知计算机,计算机执行逻辑判别(理性计算),给出分类。

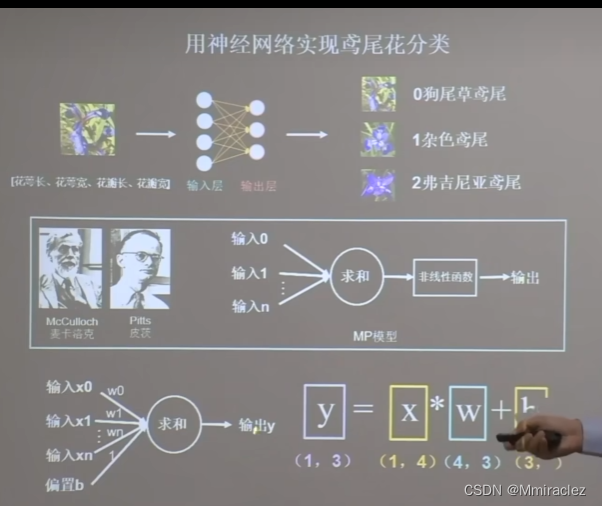

使用神经网络,可以直接根据大量数据,预测结果(黑盒子),需要大量数据

输入特征、标签。搭建网络时,初始随机化所有参数

每一个x都有对应的y的参数,是全连接网络。

第一次初始随机化后,得到的标签可能跟输入标签不一样,引入损失函数(loss function)

loss function:预测值(y)与标准答案(y_)的差距。

常用的损失函数之一—均方误差(MSE),,表现了网络前向传播推理和标准答案之间的差距。

那么,用神经网络实现鸢尾花分类,就是找到一种方法,使得找到使损失函数最小的一组参数w和b。

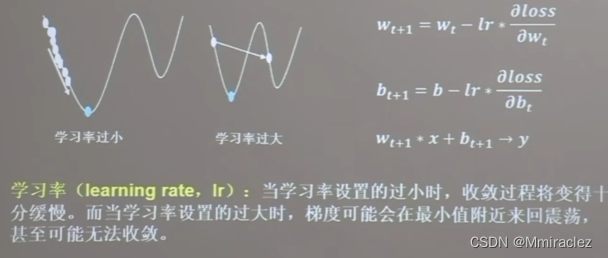

使用梯度下降,梯度:函数对各参数求偏导后的向量。梯度下降的方向,就是损失函数减小的方向。

1、梯度下降法:沿损失函数梯度下降的方向,寻找损失函数的最小值,得到最优参数的方法。

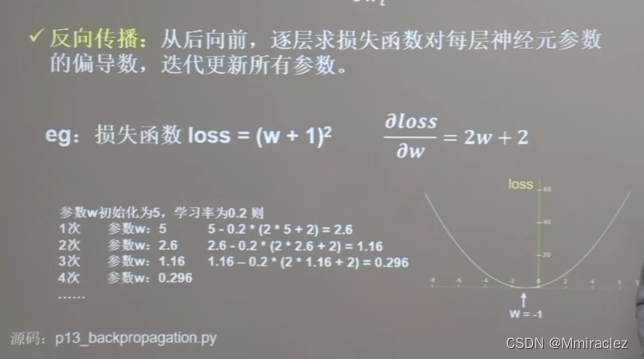

那么反向传播就是:。

、

、

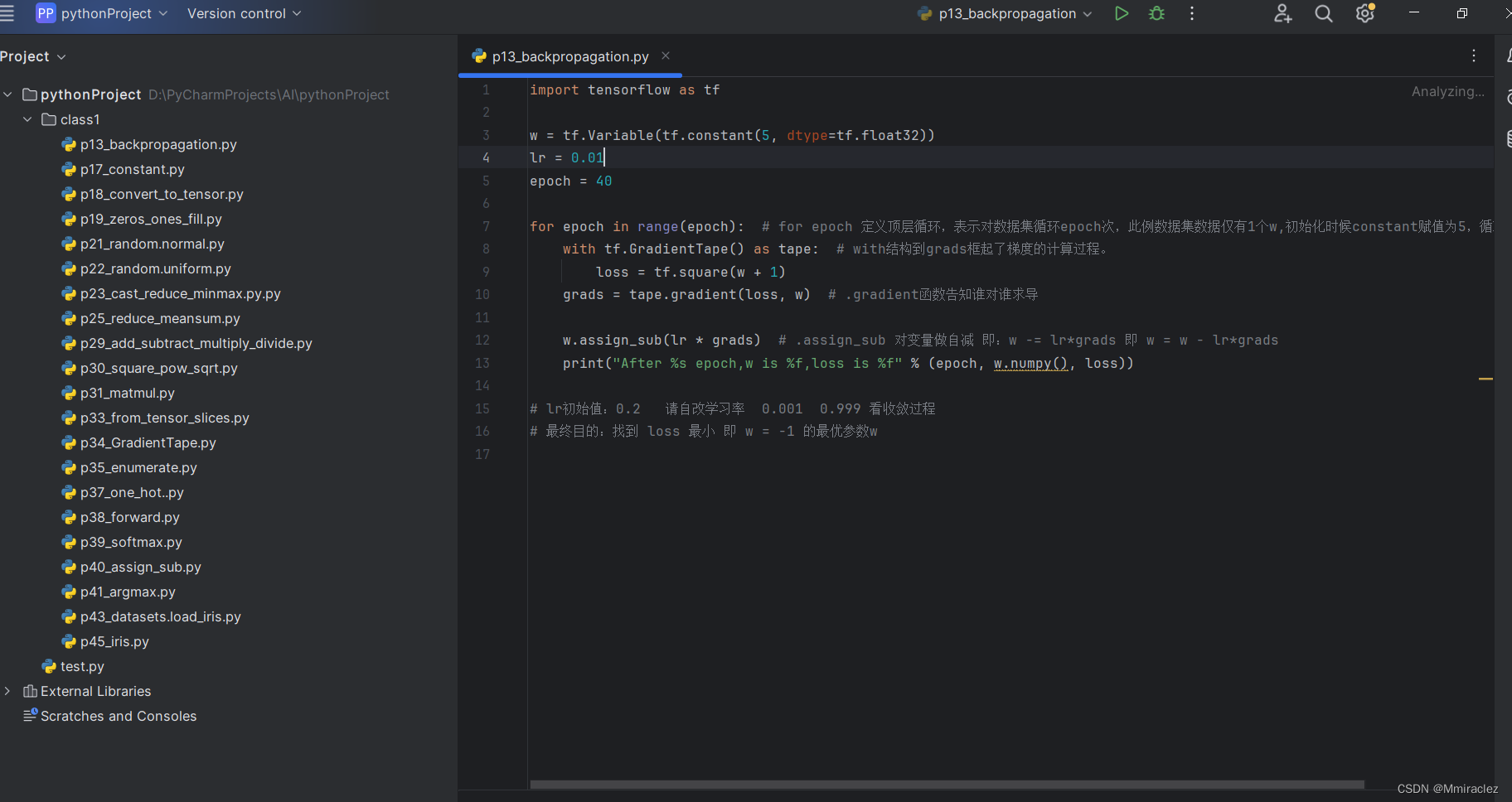

2、实践:

进行文件运行,更改学习率,了解学习率大小对梯度下降方法的影响。

3、张量生成

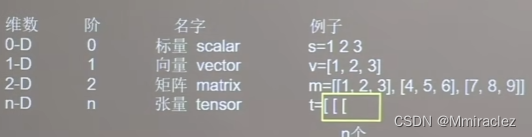

张量(Tensor):多维数组(列表) 阶:张量的维数。

张量可以表示0到n阶的数组(列表)

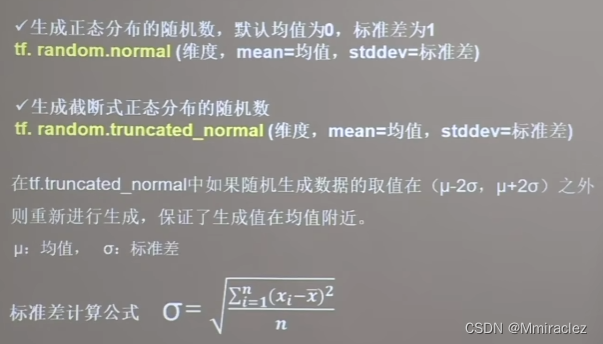

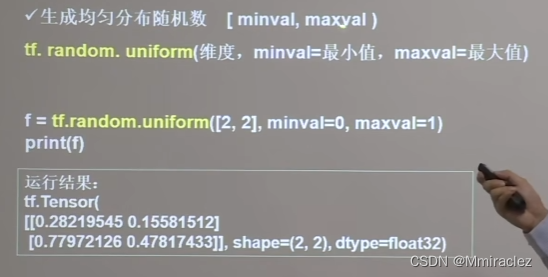

如何创建一个Tensor

创建一个张量:tf.constant(张量内容,dtype=数据类型(可选))

import tensorflow as tf

a = tf.constant([1, 5], dtype=tf.int64)

print("a:", a)

print("a.dtype:", a.dtype)

print("a.shape:", a.shape)运行结果:

a.shape中,(2,),中“,”隔开有几个数字,代表几维,前面的2是说有2个元素。

将numpy的数据类型转换为Tensor数据类型

tf.convert_to_tensor(数据名,dtype=数据类型(可选)

import tensorflow as tf

import numpy as np

a = np.arange(0, 5)

b = tf.convert_to_tensor(a, dtype=tf.int64)

print("a:", a)

print("b:", b)a = tf.zeros([2, 3])在2行3列上填满0

b = tf.ones(4):4个1

c = tf.fill([2, 2], 9) 在2行2列上填上9

423

423

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?