机器人第零定律:机器人必须保护人类的整体利益不受伤害。

第一定律:机器人不得伤害人类个体,或者目睹人类个体将遭受危险而袖手不管,除非这违反了机器人学第零定律。

第二定律:机器人必须服从人给予它的命令,当该命令与第零定律或者第一定律冲突时例外。

第三定律:机器人在不违反第零、第一、第二定律的情况下要尽可能保护自己的生存。

制定机器人第零定律的原因

打个比方,为了维持国家或者世界的整体秩序,我们制定法律,必须要执行一些人的死刑。这种情况下,机器人不该阻止死刑的执行。因为机器人阻止死刑的执行就破坏了我们维持的秩序,也就是伤害了人类的整体利益。

“第零定律”的重要性在于地位凌驾其它三大定律,如若有个机器人为保护人类整体(维护第零定律),必须杀害一个人或一群人(抵触第一定律),机器人的正子程式为了人类整体着想就会同意谋杀罪行。

人工智能大战人类的电影已经拍了很多年了,但要真的看到人工智能有哪怕一丁点人性的影子,恐怕在我们有生之年是不大可能了。但是没有关系,眼光长远的科技圈大佬们已经就这个事吵起来了,让我们先来看一看他们怎么说。

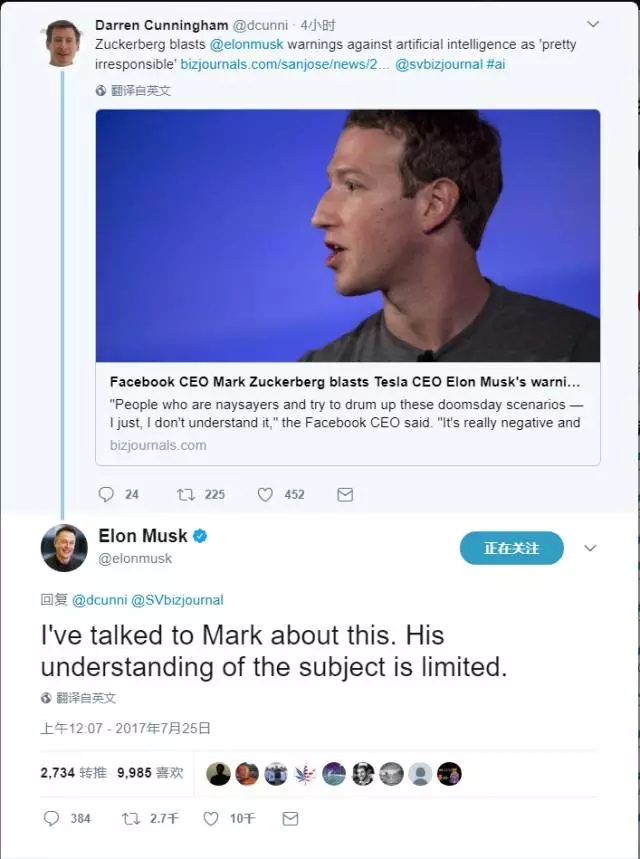

当地时间 25 日下午,埃隆·马斯克在推特上转发了一篇名为《扎克伯格炮轰埃隆·马斯克,指其对人工智能的排斥态度「非常不负责任」》的文章,并表示:「我已经和马克聊过这事了,他对这个问题的理解有限(His understanding of the subject is limited.)」。

埃隆·马斯克的推特

关于那篇文章的故事,要说到上周日的下午,Facebook 的 CEO 马克·扎克伯格在自家后院一边烤肉一边开起了直播,打算跟网友拉拉家常,不料聊到一半,网友突然问起了扎克伯格对埃隆·马斯克「AI 末世论」的看法。

马克·扎克伯格的直播

扎克伯格也没让网友失望,他表示自己非常看好 AI 的发展,对此感到非常乐观,并且认为那些鼓吹 AI 会毁灭人类的人太过消极,他很不理解,从某种程度上来说,他认为这种说法是「非常不负责任的」。

「在接下来的 5 到 10 年,AI 将会给我们的生活品质带来诸多可喜的改变。」扎克伯格在直播中说道。

「人类要完」悲观派

埃隆·马斯克的所谓「AI 末世论」由来已久了,早在 2014 年,马斯克就曾在 MIT 的一次研讨会上表示:「如果让我说人类未来最大的威胁,我认为可能是人工智能。因此我们需要对人工智能保持警惕,人工智能领域的研究如同在召唤恶魔。」

随后在 2015 年年底,马斯克启动了非盈利性的人工智能项目 OpenAI,他表示这家公司的使命是「发展数字智能,时期符合人类整体的利益,同时不受财务回报的限制」,说白了就是花钱防御人工智能背叛人类。

前不久,在美国的一次州长大会上,马斯克面对各州州长,发表了有关人工智能的演讲,他呼吁各州政府站出来对人工智能的发展进行干预和监管,并表示「AI 是人类存在的最大威胁」,未来人工智能驱动的机器一定会取代人类的工作。

马斯克在州长大会上;图源:NPR

目前 OpenAI 已经与开发出 AlphaGo 的著名深度学习公司 DeepMind 展开了合作,它们希望通过人为干预机器学习(加强学习技术 Reinforcement learning)来降低人工智能「暴走」的可能。

除了马斯克以外,诸如比尔·盖茨和史蒂芬·霍金这样的世界级 KOL 也曾表示过自己对人工智能快速发展的担心。在 2015 年的一次网络问答中,霍金就指出人工智能可能会成长到非常强大的程度,甚至可能在完全无意的情况下毁灭人类。

今年 4 月在全球互联网大会(GMIC)上,霍金通过视频发表了题为《让人工智能造福人类极其赖以生存的家园》的主题演讲,他再次表示,人工智能的崛起可能是人类文明的终结。

霍金在 GMIC 上的视频演讲;来源:投资界

「你可能并不是一个讨厌蚂蚁的人,但你也会无意中踩死蚂蚁。我们要避免人类处于蚂蚁的境地。」霍金曾如此说道。

来自内行的不同看法

但事实上,霍金的话也不一定就是真理,极客公园上个月邀请到前沿社闭门授课的迈克尔·乔丹(Michael I. Jordan)就曾表示:「霍金不是人工智能的研究者,他是一个外行。计算神经生物学近期不会有太大的突破,大概几百年后才能有进展。」

乔丹教授是美国国家科学院院士,任职于加州大学伯克利分校计算机系,他是前百度首席科学家吴恩达等人的导师,因对人工智能的深入研究及其座下学生桃李天下而被称为人工智能领域的「尤达大师」。

乔丹教授在极客公园前沿社

「要是聊黑洞相关的知识,那我肯定要听史蒂夫·霍金教授的;但我认为 AI 离真正的智能还很远,如果聊机器学习,他得听我的。」乔丹教授对极客公园说道。

除了乔丹教授以外,还有一位行业大咖对人工智能的威胁论也有异议。上周,MIT 计算机科学和人工智能实验室创始理事、著名机器人专家鲁尼·布鲁克斯在一次采访上表示,马斯克对 AI 有一定的误解。

「认为 AI 要毁灭人类的不止他一个,霍金和马丁·利兹都支持这一说法。他们有一个共同点:都不是 AI 圈子里的人。作为 AI 从业者我们都知道,想要将这项技术转化成真的产品时非常困难的。」

Rod Brooks

布鲁克斯是著名的机器人公司 iRobot 以及 Rethink Robotics 的联合创始人,作为资深的业内人士他对 AI 的观点可以说是非常专业的。

老百姓该操什么心?

从我们的角度来看,现在人工智能还处于聊个天都聊不好的「人工智障」阶段,担心它们有一天反水人类甚至毁灭人类确实有点杞人忧天的味道。

在李开复的新书《人工智能》的开头就有这样一段描述:「每当前沿科技取得重大突破,为我们预示出人工智能的瑰丽未来时,许多人就又不约而同地患上人工智能恐惧症,生怕自己的工作乃至人类的前途被潜在的及其对手掌控。」

从目前看来,技术大咖们当然更加了解人工智能行业,他们对人工智能充满希望,我们也就不必抱有多余的担忧,但事实上对于未来人工智能是否会真的站到人类的对立面去,这些技术大咖们并没有给出确定的答案,他们只是表达了对短期发展的绝对放心以及技术给生活带来改变的美好憧憬,这从侧面也表明霍金和马斯克这样眼光长远的看法不无道理。

长远未来的一切都是说不准的,但从近期来看,宣扬末世论造成社会恐慌这样的事,想来确实有些荒唐,马斯克「中二」不是一天两天了,曾经梦想拯救人类的他或许真的应该好好改变一下表达自己的方式了。从某种程度上说,这也是扎克伯格说他「不负责任」的一个原因吧。

AI作画、深度伪造、自动驾驶...无可否认地,人们逐渐走入了一个“高度智能”的时代。然而,在探索着新奇的科技世界的同时,各种新、老问题也时常在时代大幕下隐现。除了已“老生常谈”的数据鸿沟、算法歧视等伦理问题外,AI是否会替代人类、人类是否能掌控科技发展的方向盘等新问题也出现在了大众视野中。

9月2日,在世界人工智能大会的分论坛“数字时代的技术时代”上,来自各界的专家们也在圆桌上对这些问题作出了讨论。有专家认为,随着技术的发展,人类大概率将会被边缘化或取代化,因此,需要通过技术、伦理、立法等方式对其加以规范。

近日,AI作画屡屡在社交媒体中掀起讨论的声浪。面对着AI制作的精良画作,不乏有画师们担忧自己的饭碗是否不保。

而绘画只是更大图景中的一角。会上,阿里巴巴集团副总裁高红冰表示自己同样担心AI大概率会将人类边缘化或取代化——,他认为,技术的进步呈现加速的发展状态,在累积到一定阶段的时候,技术确实会产生一个人类意想不到的新世界。

“人类的地位一定会被挑战”,高红冰表示,“这个(技术的)系统跟人造的系统不同,这(是)系统自己在演化,所以我们人怎么去对待它,我们有没有边界,有没有‘踩刹车’的地方?这个是我可能最关注的一个地方。“

对于是否有“踩刹车之处”,北京大学中国社会与发展研究中心主任邱泽奇有着类似的担忧。,他指出,目前的发展面对着技术失范这一“最大难题”:。技术的核心追求在于效率,但追求效率究竟为何?这一“初心”常常在追求效率的进程中被遗忘。

因此,邱泽奇认为,如果仅仅将技术视作好玩的东西,穷尽其前沿上的可能性,那么技术可能变成人类的主人。“不是说技术能不能战胜人,我觉得技术一定会战胜人。”

面对着这样的问题,在清华大学苏世民书院院长薛澜看来认为,为解决上述问题,人类需要控制技术发展的能力。但与此同时,人们还却面临对着缺乏统一的伦理以规范技术的问题,“生命科学里存在着大量的科技伦理,但对于这方面技术的伦理规范究竟是什么?大家没有什么共识。其实很多这些领域很前沿的专家们不知道有科技伦理规范的存在,即使存在的话,大家对于很多规范有不同的意见。”

而在缺乏意识和共识的情况下,行业的发展究竟是福还是祸呢?薛澜认为这“很难说明白”,“就像贺建奎(基因编辑婴儿当事人)事件一样。”

···

技术发展的速度远超行政手段治理体系形成的速度

那么,对于新兴科技应该如何在保护其发展的同时,对其进行有效治理和约束呢?

对此,薛澜提出了“敏捷治理”的思路,他指出,技术发展的速度远超治理体系形成的速度,以至于很有可能“等到专有法律出台之日,即是这一法律的无用之时”。因此,政府亟需调整其治理方式。

他认为,相对于现在企业和监管方更近似于“老鼠和猫”的关系,两者应当形成利益共同体,企业和政府共同解决“不知道技术应用后会产生什么问题”的共同无知情况。

此外,政府应当将目标指向公共利益,保证在创新带来收益的同时对于公众带来最小风险,“所以政府要把这些基本的目标,包括我们讲效率公平正义等等这些要把它综合起来,在决策过程中充分的应用。”此外,政府治理工具可更多地应用“软法”,例如资源性规则和行业标准,以补全“硬法”(即出台的法律法规)在落地上可能的滞后,同时规制企业的行为。

高红冰同样认为,行政手段的治理可能跟不上技术发展的速度,“比方说病毒、无人机,其实在今天的数字世界里,个人在这个方面的能力是极其强大的。也就是说有些技术高手可能他可以用这种武器,可能对一个群体、社会造成重大危害,这种概率越来越高。”因此,需要用技术的手段解决技术带来的问题,在这一基础上加之以行政规则约束。

邱泽奇认为,技术的治理存在着紧迫感:从人类社会的大背景中看,数字技术和其治理能力的发展存在国际中的“竞速”,“主权国家作为一个基本治理单位存在,你不发展人家就发展,就存在一个发展落后的问题了。”

至于技术带来的发展不均衡、不平等问题,邱泽奇认为,可以从让人们适应技术迭代的速度开始入手解决:,“第一个是企业尽量延展技术外在的生命迭代周期。让我们的技术即使快速迭代,但其使用的基本技能尽量延长,避免人们总要追赶新技术。,第二个是社会中应当构建一个大家随时可以学、很容易学、够学的环境,提高全民的素质素养。

2110

2110

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?