【多元回归分析的前提条件】

(1)因变量与自变量的关系是“一次”,即“线性”。现实中这种关系本质上往往是非线性的。

(2)残差相互独立

(3)方差齐性,残差的方差为常数或因变量的方差为常数。

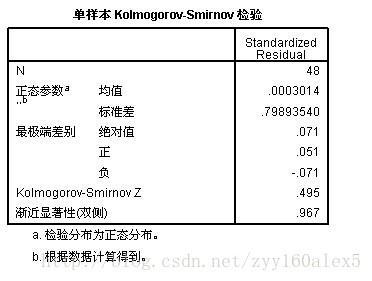

(4)残差服从正态分布,或因变量围绕其均值服从正态分布。

【操作步骤】

(1)处理数据,做序列图。

(2)因变量的自相关和偏相关检验观察趋势,通过Correlations表对因自变量的相关性有大致的了解。

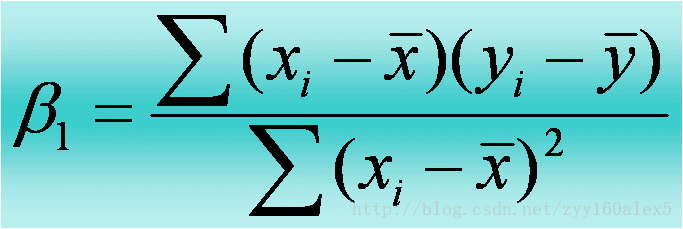

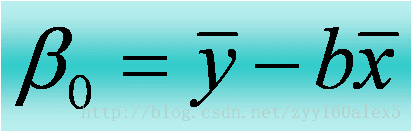

(3)建立回归分析模型。一般采用进入法,进行最小二乘估计。

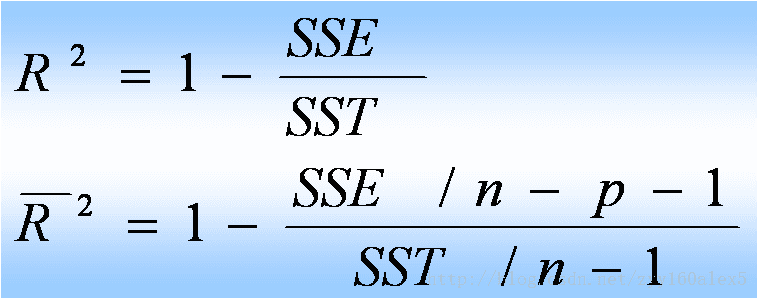

主要的分析指标:①R方、调整后的R方:判断模型的解释程度;

②DW值:是否在2附近,判断是否存在自相关,残差散点图也可以看自相关;

③ANOVA:未解释的残差;

④F检验:显著性系数是否在要求的显著性水平之下,小于就不拒绝自变量对因变量有显著影响的原假设;

⑤相关系数,看常数项、自变量的系数估计值、标准差;

⑥t检验,小于0.05,则不决绝原假设,自变量显著;

⑦VIF,容差大于10,存在严重的共线性。

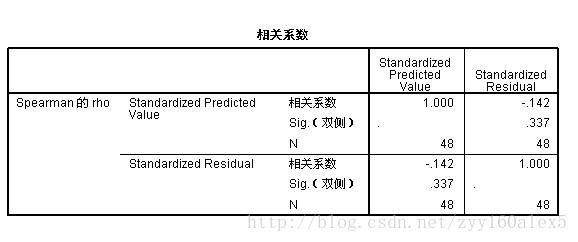

(4)异方差检验。通过残差散点图检验。保存模型的残差值,计算残差绝对值,对自变量和残差绝对值进行双变量相关分析,检验是否存在异方差。p值大于0.05,认为0.05水平下,不存在异方差。

(5)处理可能存在的问题。

①序列相关。可以采用Cochrane-Orcutt iterative least squares(COILS)方法进行自回归运算。也可同过ARIMA解决自相关的问题。

②共线性。如果回归分析的目的仅仅是用于预测或估计因变量的数值,则共线性不会对预测值的精度造成影响;如果回归分析的目的是找出变量之间的因果关系,则不允许有多重共线性,因为这时的回归方程的系数是不准确的,甚至系数的符号与实际分析都会相反;高阶模型或自变量有关联的模型通常都会存在共线性问题,减低的方法是采用数据变换的方式对原始数据进行处理。或者逐个删除存在共线性的自变量。

③异方差。解决异方差性最简便的方法是对变量进行变换,如取对数。如果通过函数变换的方式还不能解决问题,则只有通过所谓加权最小二乘法(Weighted least squares)的方法。

17万+

17万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?