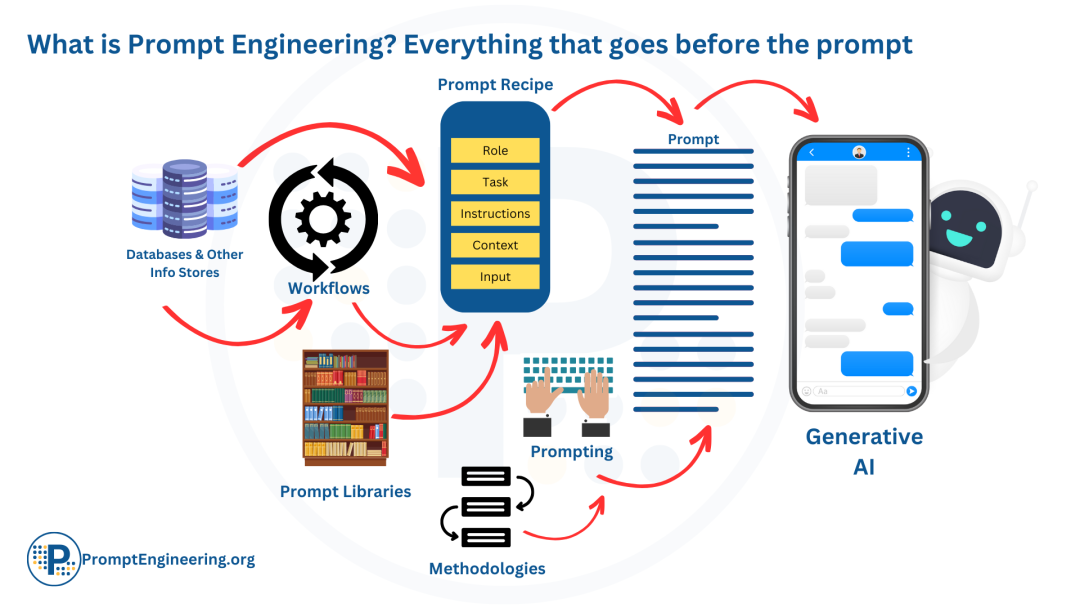

Prompt是用户向模型提供的输入,用于引导模型生成特定类型、主题或格式的文本输出。这种输入可以是一个问题、一个描述、一组关键词或上下文信息,它告诉模型用户希望得到的输出类型和内容。

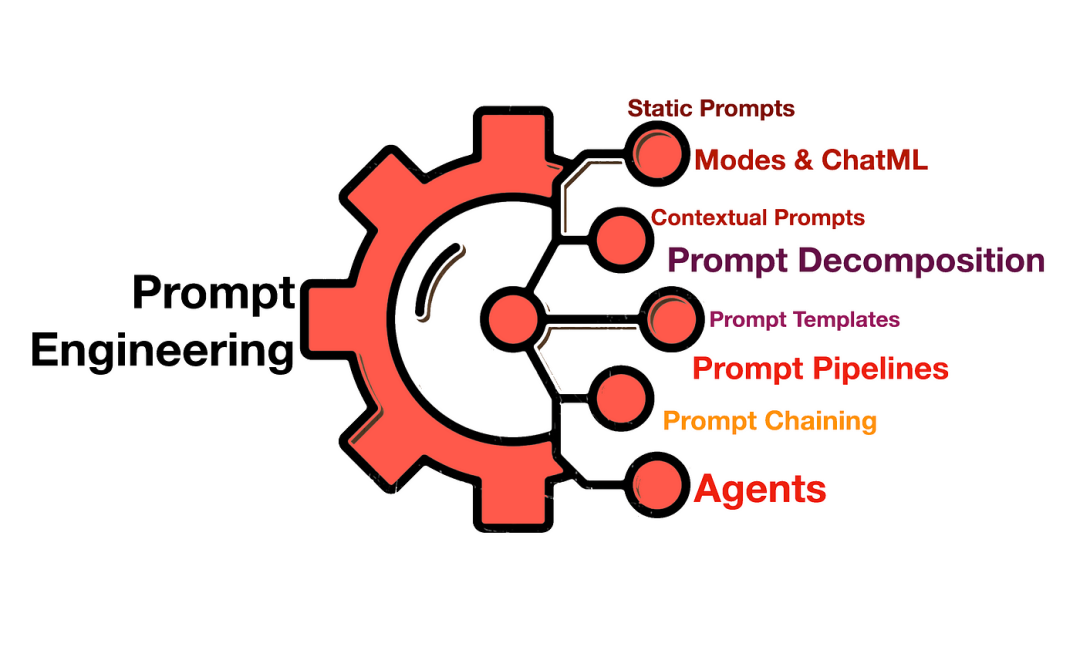

提示工程(Prompt Engineering)涉及到如何设计、优化和管理这些Prompt,以确保AI模型能够准确、高效地执行用户的指令。

一、Prompt(提示词)

为什么需要Prompt?大语言模型(LLM)本身已具备极高的性能与复杂性,但还有很大潜力需要挖掘。Prompt如同钥匙一般,能够精确引导模型生成特定需求的输出。

调整Prompt,实际上就是在改变我们与模型交流的语言和方式,这种变化往往能带来出乎意料的输出效果差异。更重要的是,这一过程无需微调模型修改参数,只需在外部灵活调整提示词输入。

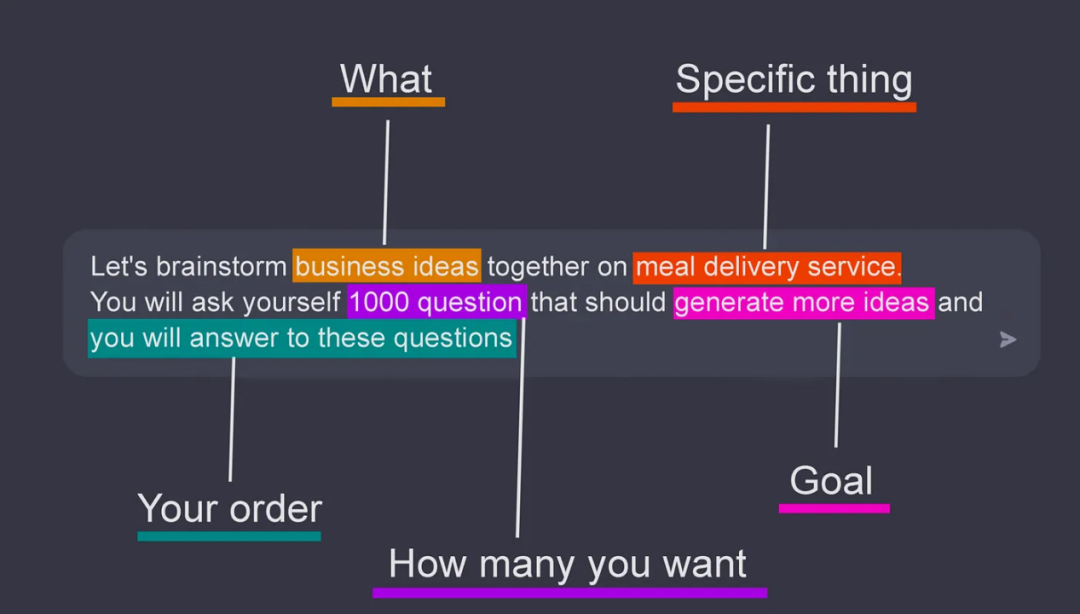

Prompt的核心要素包括:明确的任务指示、相关上下文、示例参考、用户输入以及具体的输出要求。

- 指示(Instructions):想要模型执行的特定任务或指令。

- 上下文(Context):包含外部信息或额外的上下文信息,引导语言模型更好地响应。

- 例子(Examples):通过给出具体示例来展示期望的输出格式或风格。

- 输入(Input):用户输入的内容或问题。

- 输出(Output):指定输出的类型或格式。

Prompt:

指令:请撰写一段关于“未来科技”的描述。

输入数据:无特定输入数据,直接基于主题创作。

输出指示:生成一段约100字的文本,要求内容富有想象力且积极向上。

开始你的创作:

二、In-context Learning(上下文学习)

什么是In-contxt Learning?In-context learning,即上下文学习,是一种机器学习方法,它利用文本、语音、图像等数据的上下文环境以及数据之间的关系和上下文信息来提高预测和分类的准确性和有效性。

In-context learning的优势在于它不需要对模型进行微调(fine-tuning),从而节省了大量的计算资源和时间。

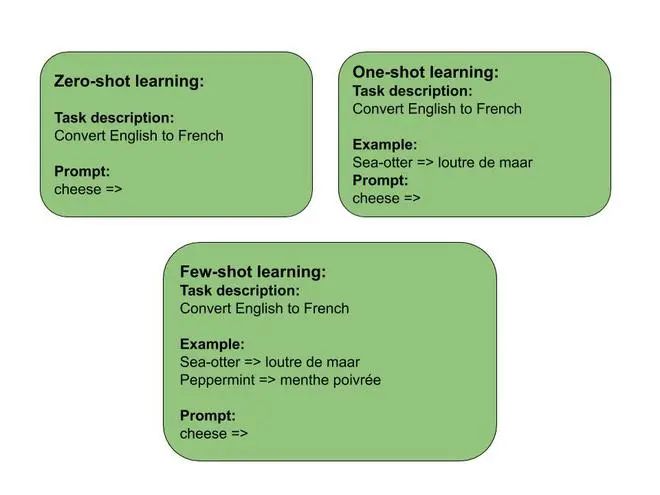

在GPT-3中,In-context learning表现为模型能够在给定的任务示例或自然语言指令的上下文中,理解任务要求并生成相应的输出。具体来说,In-context learning可以分为以下几种情况:

- Zero-shot Learning:不给GPT任何样例,仅通过自然语言指令来指导模型完成任务。

假设你有一个任务,需要将文本分类为三种情感之一:正面,负面或中性。

文本:我认为这次假期还可以。

情感倾向标签(选择一个):正面、负面、中性

- One-shot Learning:给GPT一个任务示例,模型根据这个示例来理解任务并生成输出。

- Few-shot Learning:给GPT多个任务示例,模型通过这些示例来更好地理解任务并生成输出。

假设你有一个任务,需要将文本分类为三种情感之一:正面,负面或中性。

示例 1: 文本:“我度过了一个非常愉快的周末!” 情感倾向标签:正面

示例 2: 文本:“这部电影太令人失望了。” 情感倾向标签:负面

示例 3: 文本:“今天的天气和昨天一样。” 情感倾向标签:中性

现在,请根据你从上述示例中学到的知识,对以下文本进行情感分类:

文本:“我认为这次假期还可以。”

情感倾向标签(选择一个):正面、负面、中性

三、Chain-of-Thought(思维链)

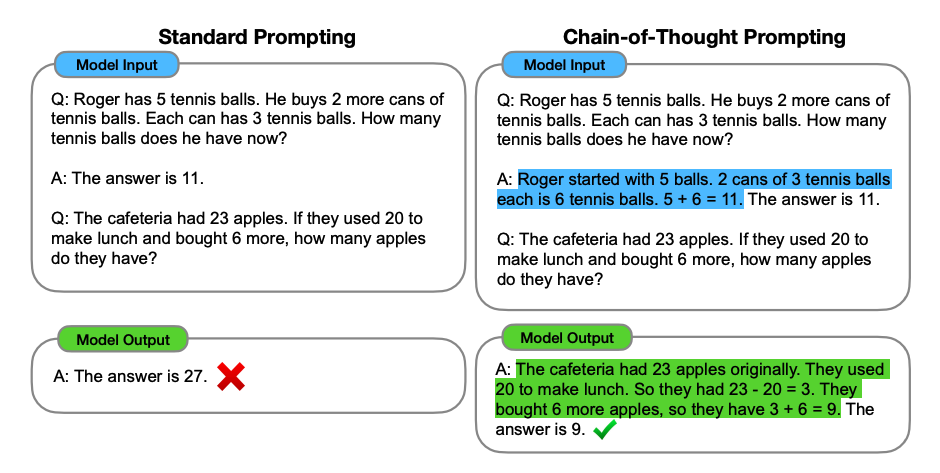

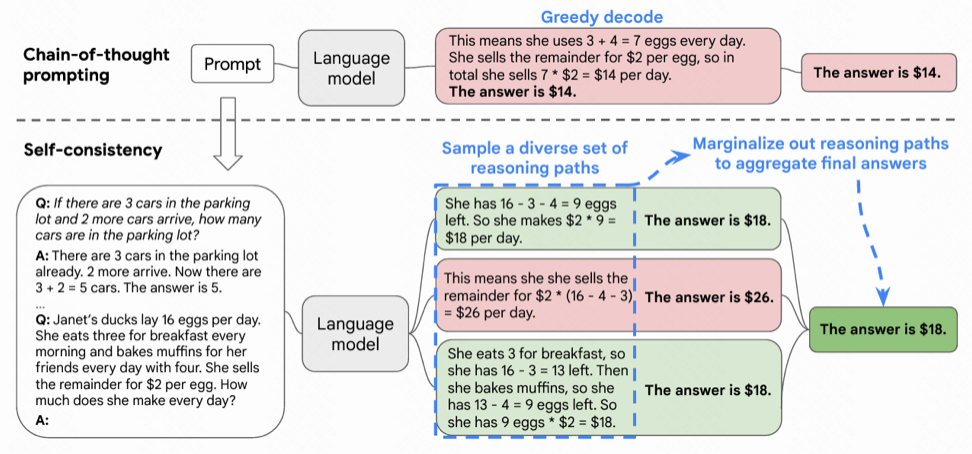

什么是Chain-of-Thought?Chain-of-Thought(思维链,简称CoT)是一种改进的提示技术,旨在提升大型语言模型(LLMs)在复杂推理任务上的表现。

Chain-of-Thought要求模型在输出最终答案之前,先展示一系列有逻辑关系的思考步骤或想法,这些步骤相互连接,形成了一个完整的思考过程。

Chain-of-Thought的概念最早是在2022年由Google发布的论文《Chain-of-Thought Prompting Elicits Reasoning in Large Language Models》中提出的。该论文展示了如何通过思维链提示(chain-of-thought prompting)来引导大型语言模型生成类似人类思维过程的推理链条,从而提升模型在复杂推理任务上的性能。

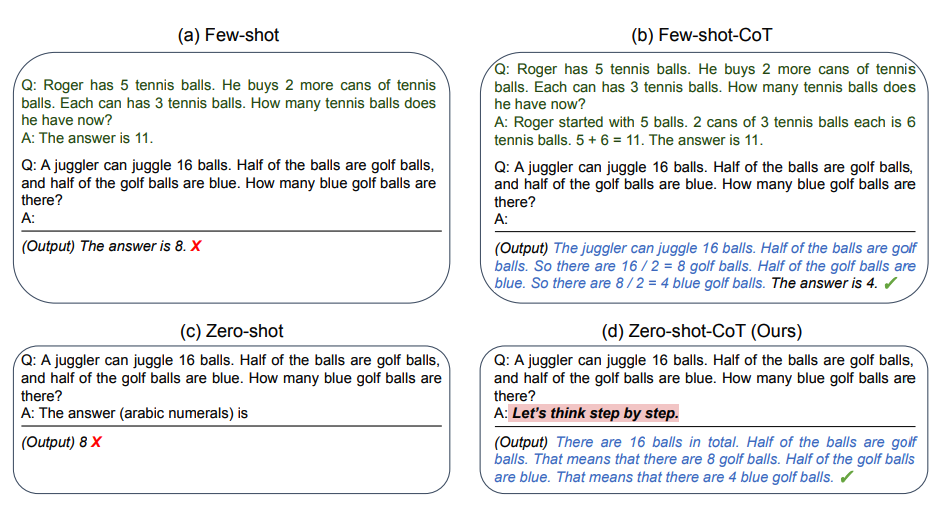

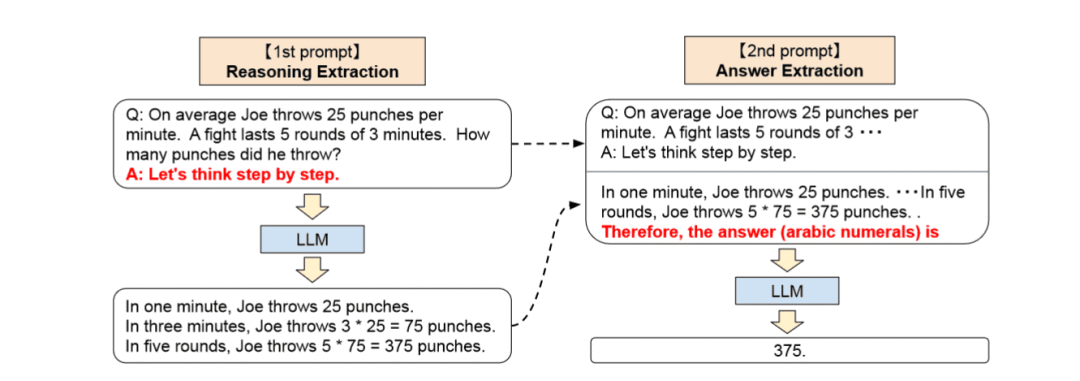

Chain-of-Thought可以通过两种主要方式实现:Zero-Shot CoT和Few-Shot CoT。

Chain-of-Thought

- Zero-Shot CoT:在没有示例的情况下,仅仅在指令中添加一行经典的“Let’s think step by step”,就可以激发大模型的推理能力,生成一个回答问题的思维链。

Zero-Shot CoT

- Few-Shot CoT:通过提供几个包含问题、推理过程与答案的示例,让模型学会如何逐步分解问题并进行推理。这种方式需要少量的示例来引导模型,但通常能够获得更好的效果。

那么,如何系统的去学习大模型LLM?

作为一名从业五年的资深大模型算法工程师,我经常会收到一些评论和私信,我是小白,学习大模型该从哪里入手呢?我自学没有方向怎么办?这个地方我不会啊。如果你也有类似的经历,一定要继续看下去!这些问题啊,也不是三言两语啊就能讲明白的。

所以我综合了大模型的所有知识点,给大家带来一套全网最全最细的大模型零基础教程。在做这套教程之前呢,我就曾放空大脑,以一个大模型小白的角度去重新解析它,采用基础知识和实战项目相结合的教学方式,历时3个月,终于完成了这样的课程,让你真正体会到什么是每一秒都在疯狂输出知识点。

由于篇幅有限,⚡️ 朋友们如果有需要全套 《2025全新制作的大模型全套资料》,扫码获取~

👉大模型学习指南+路线汇总👈

我们这套大模型资料呢,会从基础篇、进阶篇和项目实战篇等三大方面来讲解。

👉①.基础篇👈

基础篇里面包括了Python快速入门、AI开发环境搭建及提示词工程,带你学习大模型核心原理、prompt使用技巧、Transformer架构和预训练、SFT、RLHF等一些基础概念,用最易懂的方式带你入门大模型。

👉②.进阶篇👈

接下来是进阶篇,你将掌握RAG、Agent、Langchain、大模型微调和私有化部署,学习如何构建外挂知识库并和自己的企业相结合,学习如何使用langchain框架提高开发效率和代码质量、学习如何选择合适的基座模型并进行数据集的收集预处理以及具体的模型微调等等。

👉③.实战篇👈

实战篇会手把手带着大家练习企业级的落地项目(已脱敏),比如RAG医疗问答系统、Agent智能电商客服系统、数字人项目实战、教育行业智能助教等等,从而帮助大家更好的应对大模型时代的挑战。

👉④.福利篇👈

最后呢,会给大家一个小福利,课程视频中的所有素材,有搭建AI开发环境资料包,还有学习计划表,几十上百G素材、电子书和课件等等,只要你能想到的素材,我这里几乎都有。我已经全部上传到CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

相信我,这套大模型系统教程将会是全网最齐全 最易懂的小白专用课!!

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?