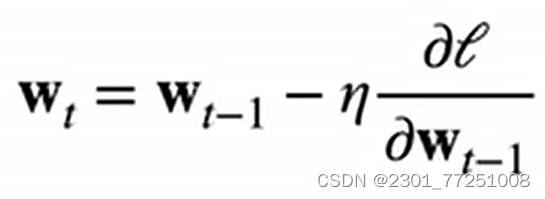

优化方法 - 最常见的是梯度下降 (Gradient descent)

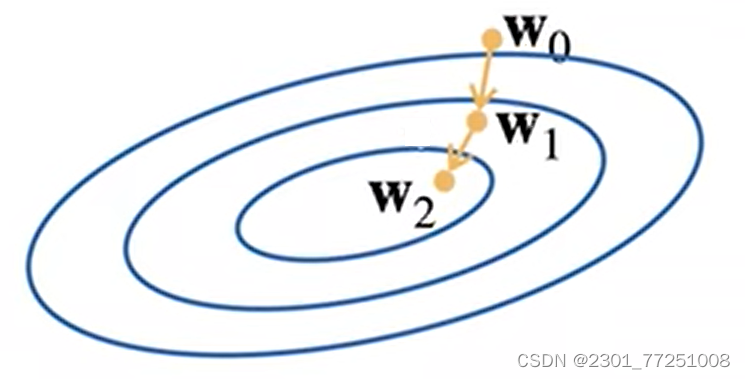

1. 自行选一个初始值w_0

2. 重复迭代参数, 比如1, 2, 3

- 沿着梯度方向可以增加捐失函数值

- 自行定learning rate (选值不能太小, 也不能太大)

小批量随机随机梯度下降

- 这是在deep learning中最常见的是优化方法

- 随机用一些样本去计算近似的损失

- 批量大小b (不能太大, 也不能太少)

总结

- Gradient descent是通过不断沿反梯度方向更新参数求解

- 小批量随机随机梯度下降是deep learning默认的求解算法

- hyperparameter: 批量大小 (b), learning rate

-

参考:

1. 李沐 - 动手学深度学习v2

2. 线下机器学习与深度学习课程

586

586

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?