目录

4.1使用该框架时调整过哪些超参数,不同超参数对模型效果的影响

一、项目背景

本项目旨在构建一个高级的 YOLOv8 目标追踪系统,可应用于目标检测领域。通过该系统,能够实时准确地追踪视频中的目标,为相关研究和应用提供有力支持,在计算机视觉和目标追踪领域,需要高效、准确的工具来实现对视频中目标的追踪。随着深度学习技术的发展,YOLO 模型系列因其出色的性能而受到广泛关注。

二、项目目的

该项目旨在创建一个具有图形用户界面(GUI)的高级 YOLOv8 目标追踪系统。通过这个系统,用户可以方便地选择视频文件,然后利用预训练的 YOLO 模型对视频中的目标进行追踪。系统提供了多种模型可供选择,以适应不同的应用场景和需求。用户可以在界面中进行一系列操作,如打开视频、查看追踪结果等。同时,系统还设置了状态显示区域和一些高级设置选项,如模型选择和追踪参数设置,让用户能够更灵活地配置和使用目标追踪功能,为用户提供直观、便捷、可定制化的目标追踪体验。

三、数据相关

数据来源主要是通过自己在网上下载视频。在数据预处理方面,进行了常规的格式转换和裁剪等操作。标注工具使用了专业的标注软件,标签格式符合 YOLOv8 的要求。

四、框架使用

我们主要使用了 tkinter 框架框架,选择 tkinter 的原因包括它的易用性、广泛的文档和社区支持,以及它是 Python 内置的,无需额外安装。在其他框架方面,可能尝试过如 PyQt 等,与其他框架相比,tkinter 的突出优点有:简单易学,对于小型和中型项目足够强大,并且与 Python 紧密集成。

tkinter 是 Python 自带的标准 GUI 库,它具有以下基础架构和用途:

-

基础架构:提供了各种图形界面元素如窗口、按钮、标签、列表框等的创建和管理方法。

-

用途:用于创建简单到复杂的图形用户界面,方便用户与程序进行交互

项目源码:CSDN

代码

import cv2

from ultralytics import YOLO

import tkinter as tk

from tkinter import filedialog

from tkinter import ttk

from tkinter import messagebox

# 初始化模型为 None

model = None

# 定义打开视频文件的函数

def open_video():

"""

打开视频文件的函数

1. 使用 filedialog.askopenfilename() 打开文件选择对话框,获取用户选择的视频文件路径。

2. 如果用户选择了视频文件,则尝试使用 cv2.VideoCapture 打开视频。

3. 如果打开视频时发生异常,则显示详细的错误消息框。

4. 否则,调用 track_video 函数进行视频追踪。

"""

video_path = filedialog.askopenfilename() # 获取用户选择的视频文件路径

if video_path:

try:

cap = cv2.VideoCapture(video_path) # 尝试打开视频

track_video(cap) # 调用追踪视频函数

except Exception as e:

messagebox.showerror("错误", f"打开视频时出错:{e}") # 显示错误消息框

# 定义追踪视频的函数

def track_video(cap):

"""

追踪视频的函数

1. 当视频捕获对象 cap 打开时,进入循环。

2. 在循环中,读取视频的下一帧。

3. 如果读取帧时发生异常,则显示详细的错误消息框并退出循环。

4. 如果读取到帧,则先进行图像预处理,如高斯模糊等。

5. 使用 model.track 进行目标追踪,并获取追踪结果 results。

6. 对追踪结果进行进一步筛选和处理,如根据目标大小、形状等特征进行筛选。

7. 使用 results[0].plot() 绘制追踪结果。

8. 在图像窗口中显示绘制后的追踪结果。

9. 如果用户按下 'q' 键,则退出循环。

10. 释放视频捕获对象 cap,并销毁所有窗口。

"""

while cap.isOpened(): # 当视频捕获对象打开时

try:

ret, frame = cap.read() # 读取下一帧

except Exception as e:

messagebox.showerror("错误", f"读取视频帧时出错:{e}") # 显示读取帧错误消息框

break

if ret:

# 图像预处理,例如高斯模糊

blurred_frame = cv2.GaussianBlur(frame, (5, 5), 0)

if model: # 确保有模型被选择

try:

# 可以在这里添加更多针对追踪结果的筛选和处理逻辑

# 比如根据目标大小、形状等特征进行筛选

#...

results = model.track(blurred_frame, persist=True) # 进行目标追踪

# 增加对追踪结果的筛选,只保留置信度较高的检测结果

filtered_results = [box for box in results[0].boxes if box.conf > 0.8]

annotated_frame = results[0].plot(filtered_results) # 获取绘制后的追踪结果

cv2.imshow("YOLOv8 Tracking", annotated_frame) # 显示追踪结果

except Exception as ex:

messagebox.showerror("模型错误", f"模型应用时出错:{ex}") # 显示模型应用错误消息框

key = cv2.waitKey(1) # 等待按键

if key == ord('q'): # 如果按下 'q' 键

break

cap.release() # 释放视频捕获对象

cv2.destroyAllWindows() # 销毁所有窗口

def create_ui():

root = tk.Tk()

root.geometry("800x800") # 设置更大的窗口尺寸

# 创建顶部栏

top_bar = ttk.Frame(root, relief=tk.RAISED, borderwidth=2)

top_bar.pack(fill=tk.X)

# 创建标题标签

title_label = ttk.Label(top_bar, text="高级 YOLOv8 目标追踪系统", font=("Helvetica", 32, "bold"))

title_label.pack(side=tk.LEFT, padx=50, pady=20)

# 创建中间容器

mid_container = ttk.PanedWindow(root, orient=tk.VERTICAL)

mid_container.pack(fill=tk.BOTH, expand=True)

# 上半部分框架

upper_frame = ttk.Frame(mid_container)

mid_container.add(upper_frame)

# 创建说明标签

instruction_label = ttk.Label(upper_frame, text="在此处精心选择要追踪的视频文件", font=("Helvetica", 20), wraplength=500)

instruction_label.pack(pady=20)

# 创建视频列表框

video_listbox = tk.Listbox(upper_frame, height=5, width=40)

video_listbox.pack(pady=15)

# 创建打开视频文件的按钮

open_button = ttk.Button(upper_frame, text="智能打开视频", command=open_video)

open_button.pack(pady=25)

# 下半部分框架

lower_frame = ttk.Frame(mid_container)

mid_container.add(lower_frame)

# 创建状态区域

status_area = ttk.Frame(lower_frame)

status_area.pack(fill=tk.X)

# 创建状态标签

status_label = ttk.Label(status_area, text="当前状态:准备就绪,期待你的选择", font=("Helvetica", 18))

status_label.pack(side=tk.LEFT, padx=30)

# 创建进度条(示例,可根据需要使用)

progress_bar = ttk.Progressbar(lower_frame, length=500)

progress_bar.pack(pady=15)

# 创建高级设置区域

advanced_settings_frame = ttk.Frame(lower_frame)

advanced_settings_frame.pack(fill=tk.X)

# 创建模型选择下拉框

model_combobox = ttk.Combobox(advanced_settings_frame, values=["yolov8n.pt", "yolov8n-cls.pt", "yolov8n-pose.pt", "yolov8n-seg.pt"])

model_combobox.pack(side=tk.LEFT, padx=15)

# 为模型选择下拉框添加事件处理

model_combobox.bind("<<ComboboxSelected>>", lambda event: set_model(model_combobox.get()))

# 创建追踪参数设置框

tracking_params_frame = ttk.LabelFrame(advanced_settings_frame, text="追踪参数")

tracking_params_frame.pack(side=tk.LEFT, padx=15)

# 定义设置模型的函数

def set_model(selected_model):

"""

设置模型的函数

1. 全局变量 model 存储当前选择的模型。

2. 根据用户选择的模型,使用 YOLO 加载相应的模型。

3. 如果加载模型时发生异常,则显示详细的错误消息框。

4. 如果模型加载成功,则更新状态标签。

"""

global model

try:

if selected_model == "yolov8n.pt":

#yolov8n.pt是一个预训练的YOLOv8模型,它可以用于目标检测任务

model = YOLO(selected_model)

elif selected_model == "yolov8n-cls.pt":

#yolov8n-cls.pt是一个预训练的图像分类模型,它可以用于对图像进行分类。

model = YOLO(selected_model)

elif selected_model == "yolov8n-pose.pt":

#yolov8n-pose.pt是一个预训练的姿态检测模型,它可以用于检测图像或视频中的人体姿态

model = YOLO(selected_model)

elif selected_model == "yolov8n-seg.pt":

#yolov8n-seg.pt是一个预训练的YOLOv8模型,用于对象分割任务

model = YOLO(selected_model)

status_label.config(text=f"当前模型:{selected_model}")

except Exception as e:

messagebox.showerror("模型设置错误", f"设置模型时出错:{e}")

# 运行主事件循环

root.mainloop()

create_ui()

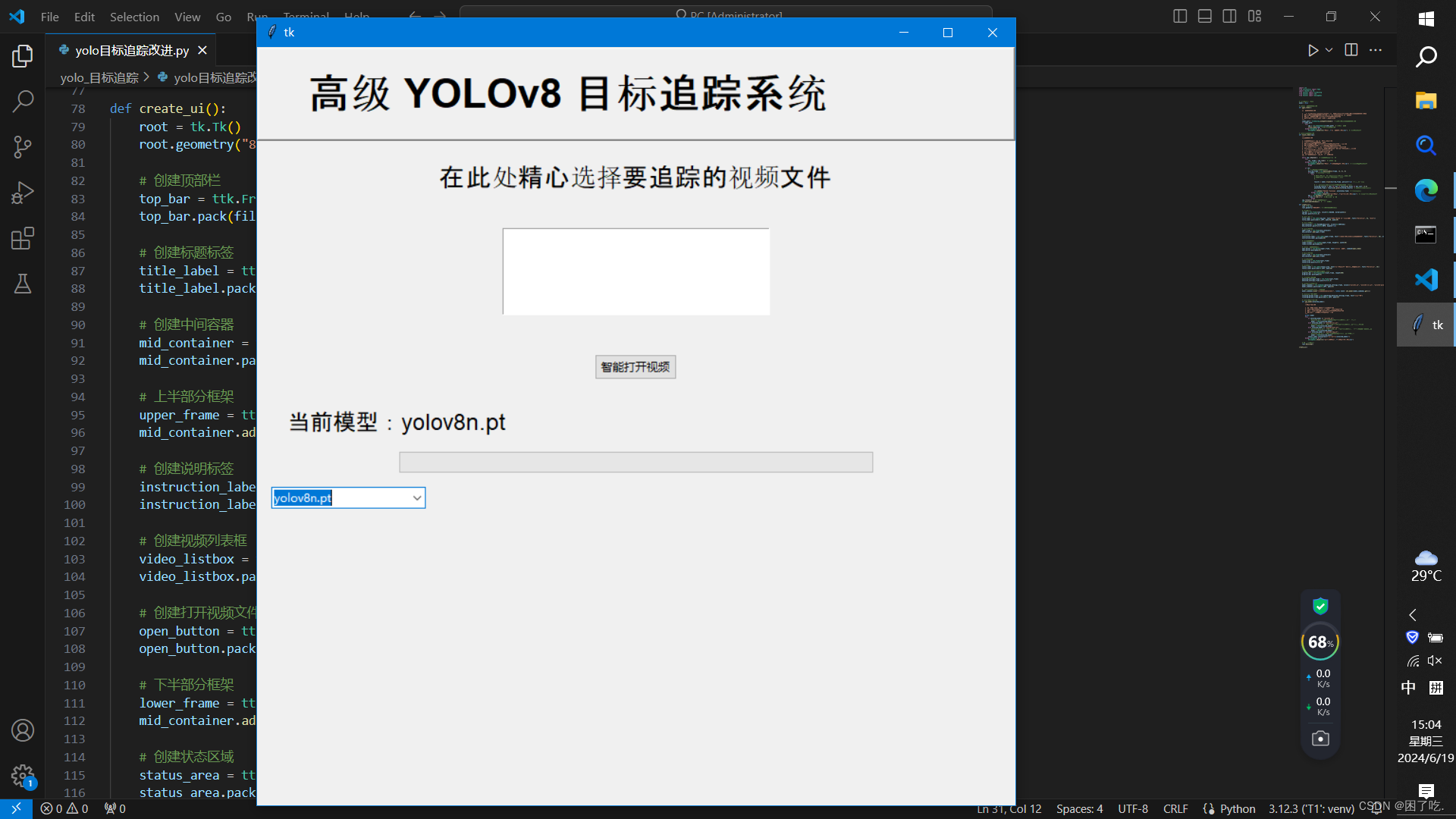

前端:

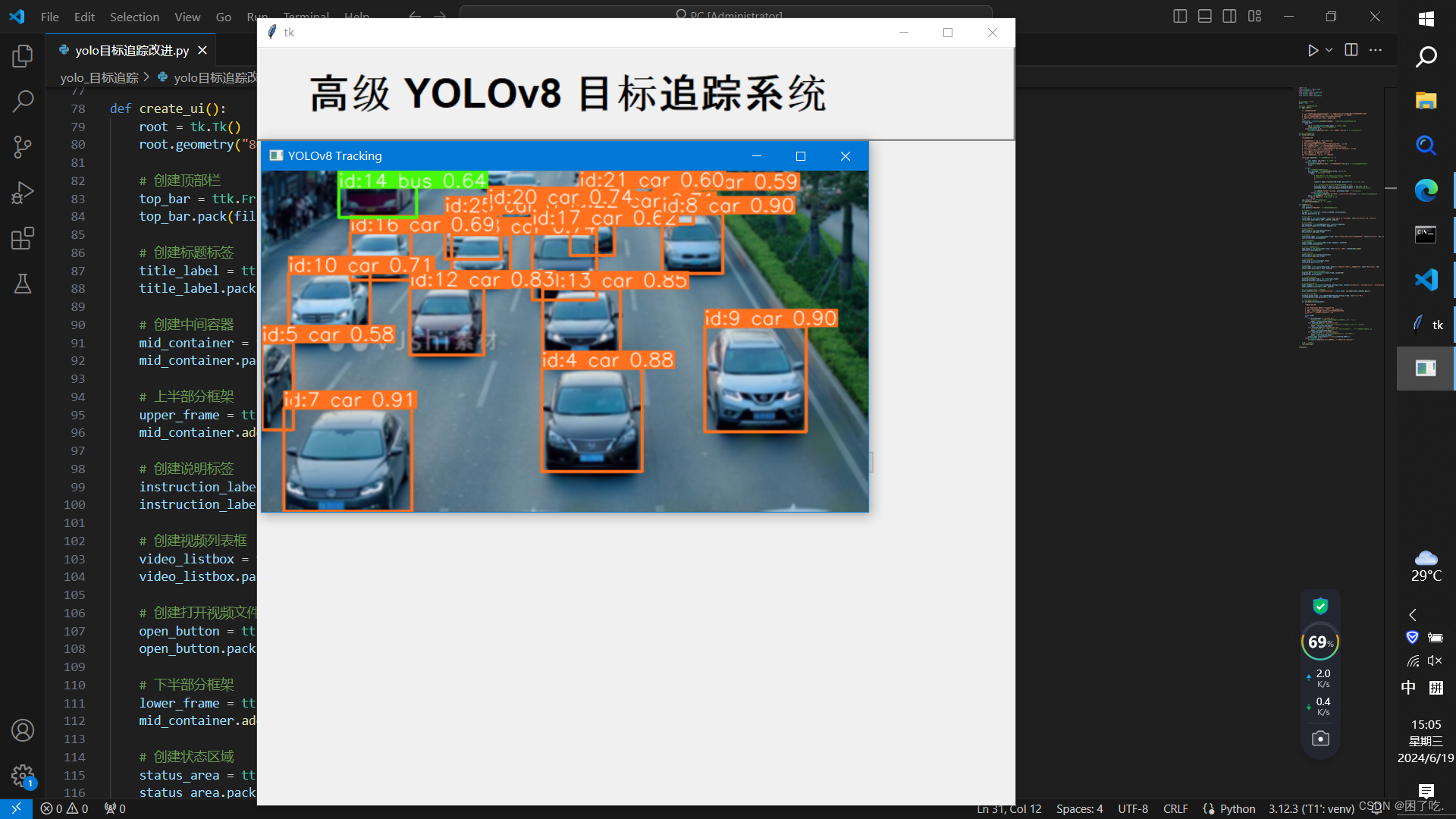

运行:

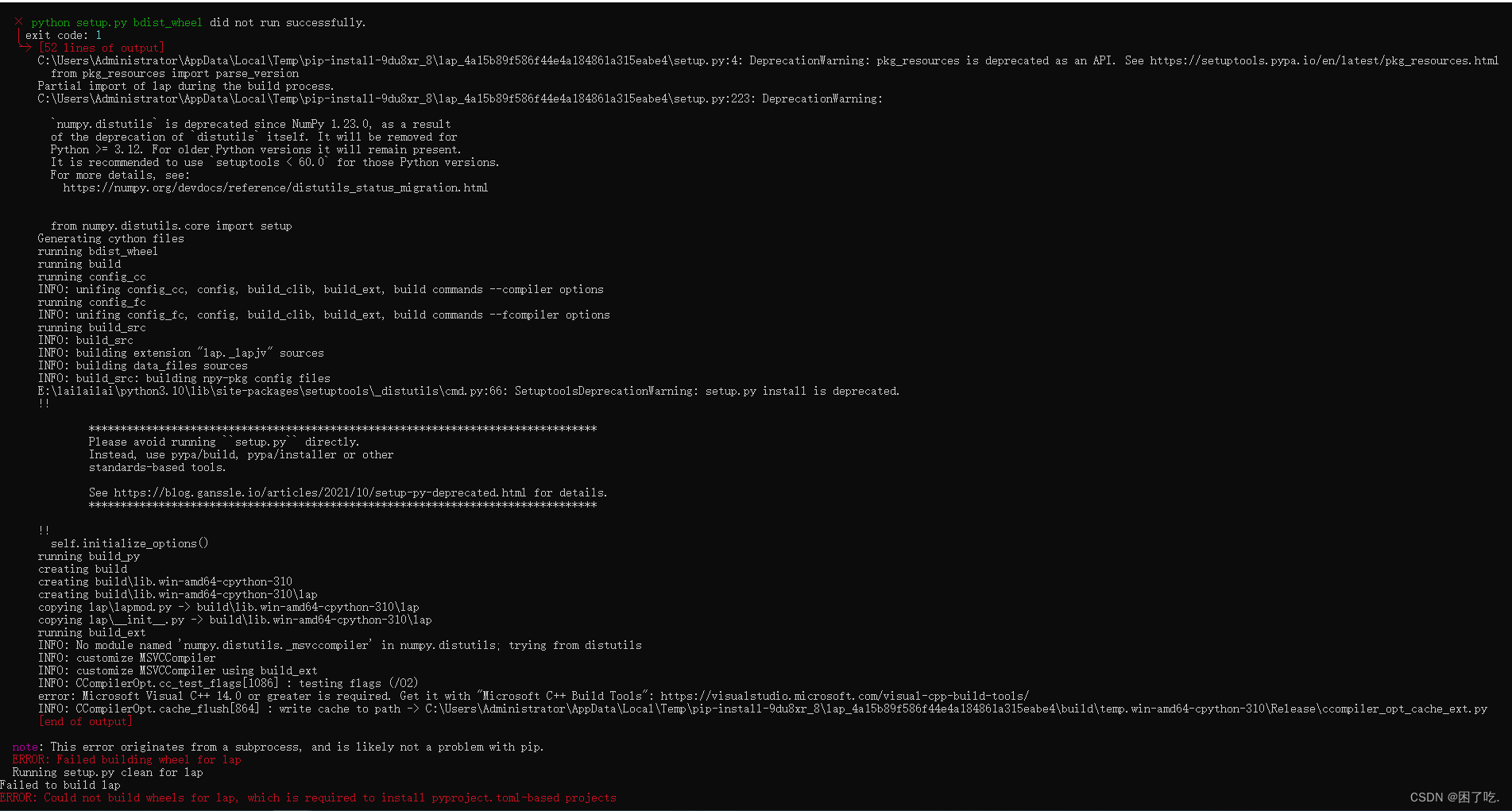

***安装lap报错解决***

原因是缺少C++的编译工具

解决步骤:

1、下载BuildTools

下载地址:https://visualstudio.microsoft.com/zh-hans/visual-cpp-build-tools/

2、安装选择C++

4.1使用该框架时调整过哪些超参数,不同超参数对模型效果的影响

代码中可能并未明确涉及对特定超参数的调整,因为这主要取决于所使用的模型(如 YOLO 模型)及其相关配置。不同的超参数如学习率、训练轮数等会对模型的性能产生显著影响,例如较高的学习率可能导致训练不稳定,而合适的训练轮数可以确保模型充分学习。

4.2 前端部分实现过程的详细介绍:

-

创建主窗口:使用 tk.Tk() 创建了一个主窗口 root,并设置了较大的尺寸。

-

顶部栏:创建了一个顶部栏框架 top_bar,在其中添加了标题标签 title_label,用于显示系统名称。

-

中间容器:创建了一个垂直方向的分窗格 mid_container,用于划分上下两个部分。

-

上半部分框架:

-

说明标签 instruction_label:提示用户选择视频文件。

-

视频列表框 video_listbox:可用于显示已选视频列表(这里可能未完全使用到)。

-

打开视频文件按钮 open_button:点击触发打开视频文件的操作。

-

-

下半部分框架:

-

状态区域:包含状态标签 status_label,用于显示当前状态。

-

进度条:示例,可能用于后续显示某些进度(当前未实际使用)。

-

-

高级设置区域:

-

模型选择下拉框 model_combobox:列出了一些模型选项,用户可选择。

-

为下拉框添加了事件处理,当选择改变时调用 set_model 函数来设置模型。

-

追踪参数设置框 tracking_params_frame:这里可能用于后续添加具体的追踪参数设置界面。

-

五、相关算法/框架介绍

1. YOLO(You Only Look Once):

-

优点:检测速度快,能够实时处理;可以端到端训练。

-

缺点:对于小目标的检测效果相对较弱;定位精度可能不如一些两阶段算法。

-

适用情况:适用于对实时性要求较高的场景,如自动驾驶等。

2. OpenCV:

-

优点:功能强大,提供了丰富的图像处理和计算机视觉功能;广泛应用且有大量的文档和资源。

-

缺点:某些复杂算法可能需要较高的学习成本。

-

适用情况:各种图像处理和视觉任务,包括图像读取、处理、分析等。

3. Tkinter:

-

优点:简单易用,适合构建简单的图形用户界面;Python 内置,无需额外安装。

-

缺点:界面美观和交互性相对有限。

-

适用情况:小型应用程序的界面开发,对界面要求不高的场景。

3651

3651

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?