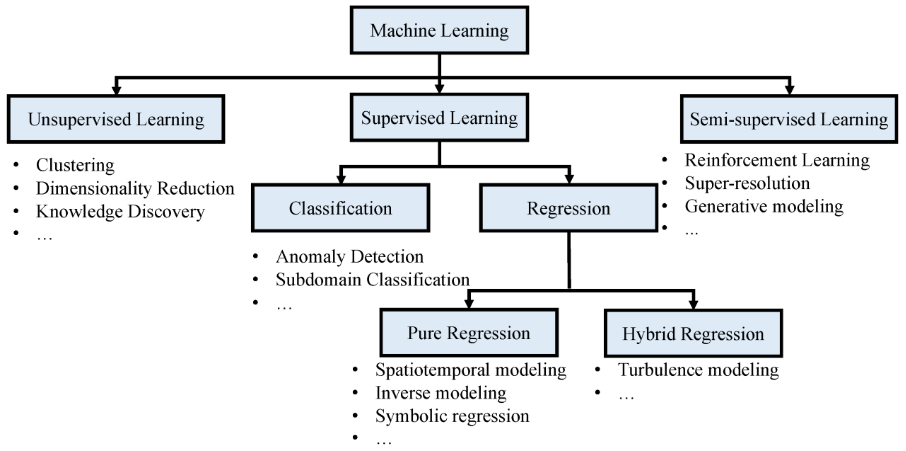

深度学习与流体力学的学科交叉正不断扩展科研的边界。在工业领域,例如航天航空、海洋船舶和能源动力等行业,存在许多亟待解决的流体控制与优化设计难题。流体力学问题的主要特点包括高维度、强非线性和数据量大。近年来,深度学习技术因其数据驱动的特性和处理高维复杂问题的能力,已在流体力学领域取得了一定的应用,而且获了主流期刊比如《Nature》和《Science》杂志的认可。

传统的流体力学模拟方法在应对高耦合度和非线性问题时面临诸多限制,而深度学习技术为流体力学提供了新的思路和方法。这主要集中在:基于流体力学控制方程的辅助求解,流场重构等正问题;控制方程系数等特征量提取等逆问题。通过结构化的神经网络支起完备的解空间,这一技术可以根据外部实验测量数据、物理控制方程、初边界条件等辅助信息寻找问题准确的解函数。同时,不同的神经网络结构提供了更为广阔的灵活性以及功能性,为解决复杂流动问题提供了创新的解决方案,提升了流体动力学仿真的精度与效率,推动了流场优化和控制,以及对复杂流动现象的深入理解。

课程概述

从流体力学基础,流体力学仿真基础以及流体力学&深度学习基础,层层递进,深入浅出,最终从代码层级一站式打通从流体力学理论到问题解决的整个流程。本课程注重学科基础和数值建模框架,不仅提供代码上的实操支持,而且从物理层面给出仿真结果的物理解释,适合初学者进阶。课程结合前沿论文,讲解论文论述框架,瞄准当下热点难点。最后,依托所课程内容,提供该主题下论文结构性和系统性撰写方式。

目标

培养流体力学和深度学习的建模能力

●课程注重学科基础和科学建模方案,涵盖多物理场耦合问题和控制方程构建,以及问题简化的物理依据。结合控制方程,将问题从复杂到简单,最终在CAE训练中感受如何抓住主要矛盾,精简问题结论;

l课程注重深度学习基础理论,培养从0到1的神经网络建模过程,从原理上理解神经网络,从代码上实现神经网络;

●学习深度学习在流体力学中的应用,比较经典解法和深度学习解法。培养精通流体力学与深度学习的复合型人才,为解决流体力学问题提供另一种范式。

理论与实践并重

●从工程师培养的角度,培养简化问题的能力;

●简化软件上手难度,定位软件或代码为服务于问题的工具;

●手把手教学CFD建模,使用如COMSOL Multiphysics,Ansys Fluent,OpenFOAM 等建模软件,并同步展示控制方程,理解操作的底层逻辑。

追踪前沿动态

●分析国际团队最新研究成果,以探索深度学习在流体力学中的发展趋势;

●拓展学员拥有国际视野,加强与国际同行的交流合作;

●积极鼓励学员在流体力学与深度学习间寻找创新交叉点,跟踪前沿研究。

内容

第一天:流体力学复习

张量基础

拉格朗日描述和欧拉描述

基于连续介质力学的运动学描述

雷诺输运方程

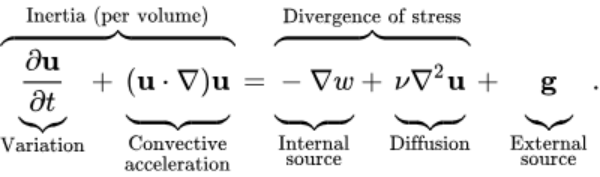

欧拉描述下的主守恒方程:质量、动量、角动量守恒

几类简化流体问题举例 (Navi-Stocks方程简化)

●不可压/可压流体问题

●定常流体问题

●无黏流体问题

●二维流体问题

能量守恒定律与热力学基础

●能量守恒定律

●热力学第二定律及自由能

量纲分析简介

第二天:流体力学仿真

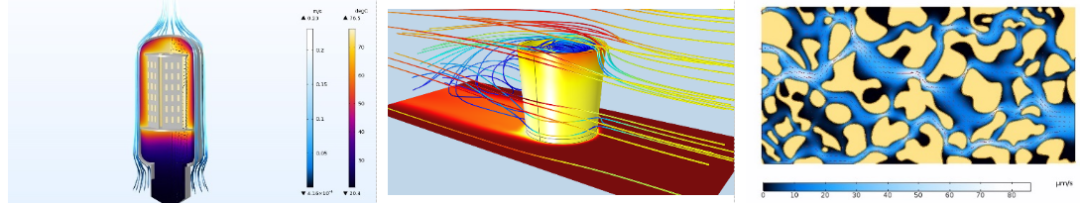

案例解析

●流体耦合问题

●热流耦合问题

●物质输运

●离子输运问题

●多孔材料的流固耦合

流体力学计算方法

●有限体积法

●时间差分算法

●有限元法

■对流问题中的稳定性方法举例

第三天:流体力学实操

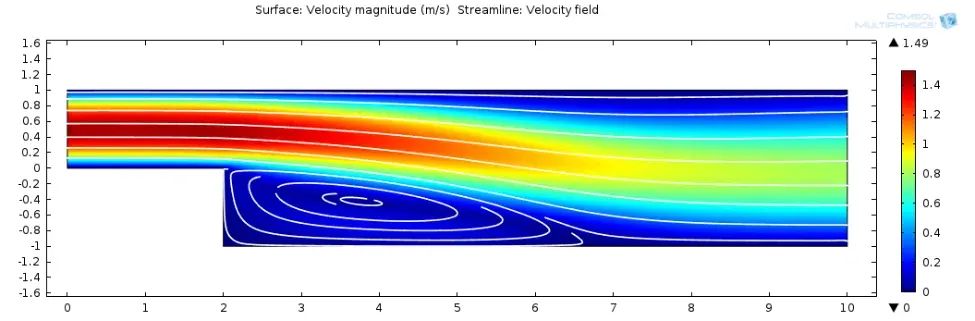

COMSOL Multiphysics, OpenFOAM, Ansys Fluent流体力学实操

●单相流

●非等热流以及共轭传热

●稀物质输运

●基于相场法的二相流问题

●多孔材料的流固耦合

●流固耦合-动网格法

●离子输运问题

图表 2 速度大小剖面云图以及流线图

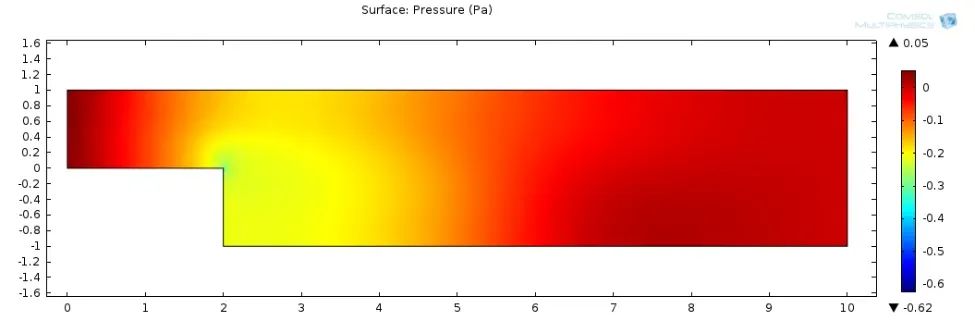

图表 3 压力场

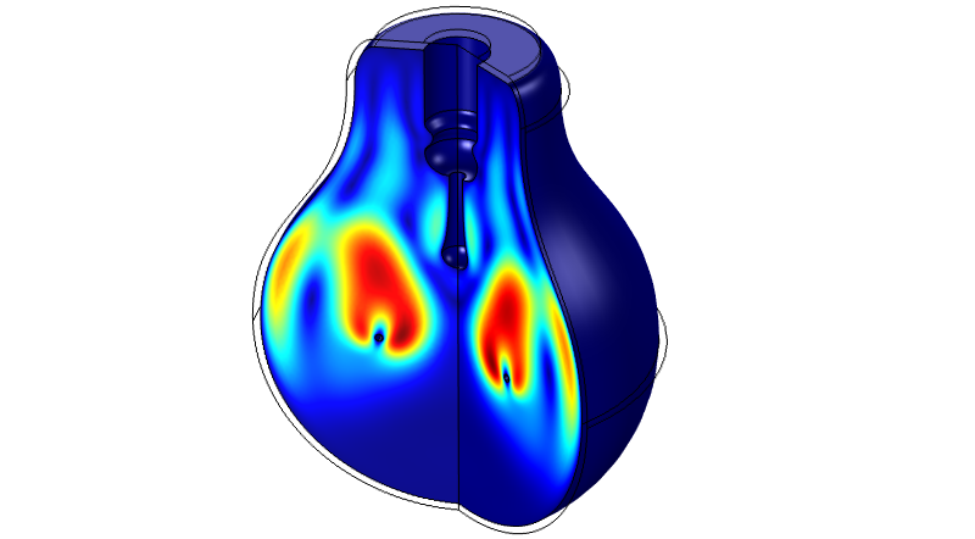

图表 4 灯丝热作用下灯泡内气体的运动

第四天

神经网络基础回顾:感知机、多层感知机

神经网络基本结构:激活函数、损失函数、优化算法

神经网络训练技巧:mini-batch,正则化,dropout

结构化神经网络

●卷积神经网络

●循环神经网络

●物理信息神经网络

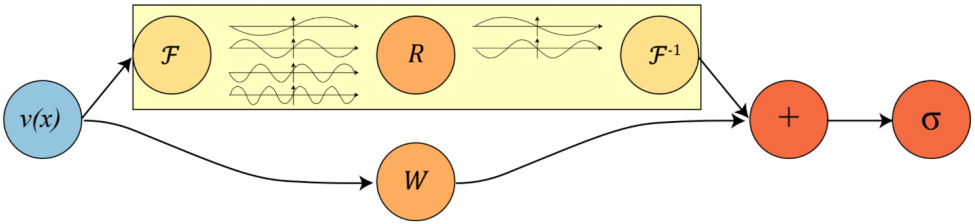

●傅里叶神经网络

实操:

●神经网络的代码实现 (Matlab, Python)

●训练技巧演示 (Matlab)

●参数更新算法演示 (Matlab)

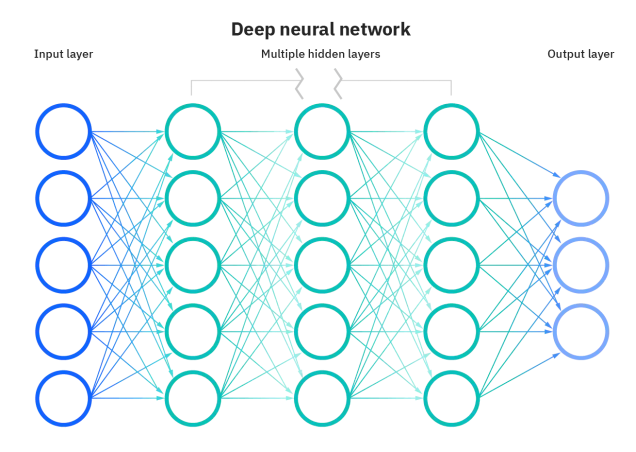

●图表 5 神经网络结构示意图

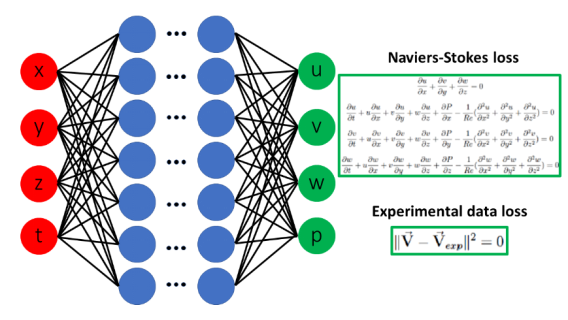

●图表 6 物理信息神经网络处理NS方程

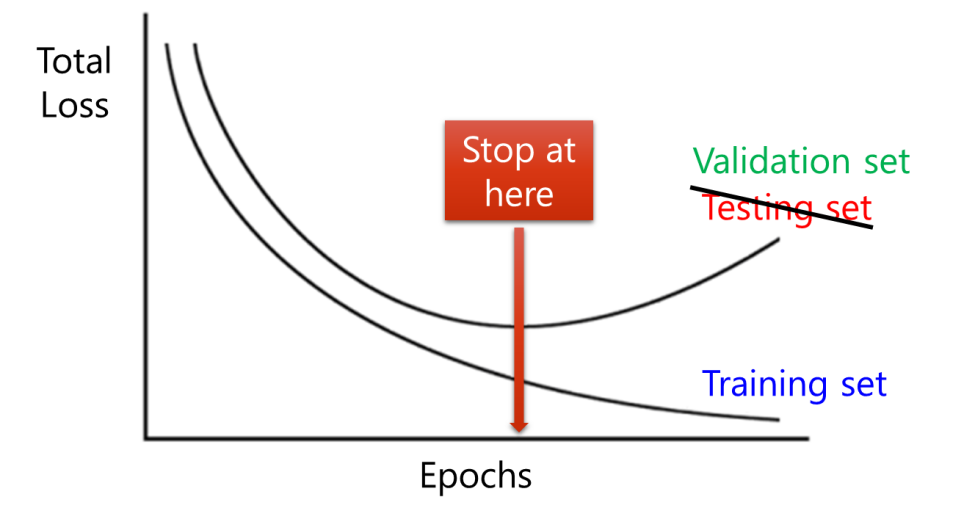

图表 7 神经网络训练早停技巧

第五天

流体力学&深度学习实战:

●CNN在流场预测中的应用 (Python实操)

●CNN提取流场出流速、压力、涡旋等特征 (Python实操)

●LSTM 模型在流场时间序列预测中的应用 (Python实操)

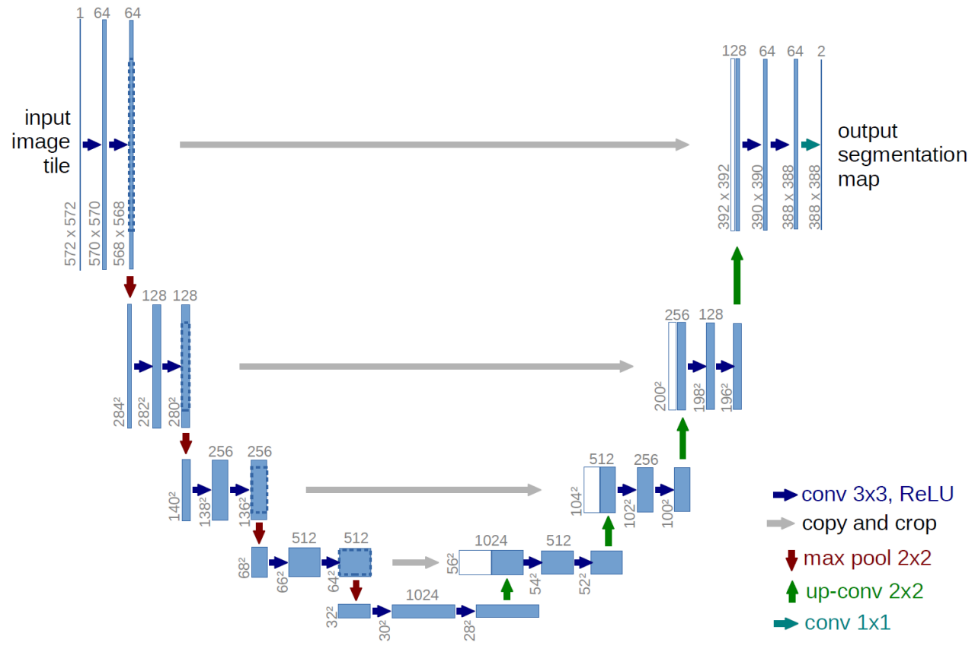

●U-Net结构应用于流场预测、重构、优化 (Python实操)

图表 8 有限差分方法和PINN方法对热场分布预测效果对比

图表 9 傅里叶神经网络算子

●图表 10 U-Net 卷积神经网络架构

●PINN实操 (Python):

■PINN预测常微分方程的响应

■2D热传导

■Burger方程

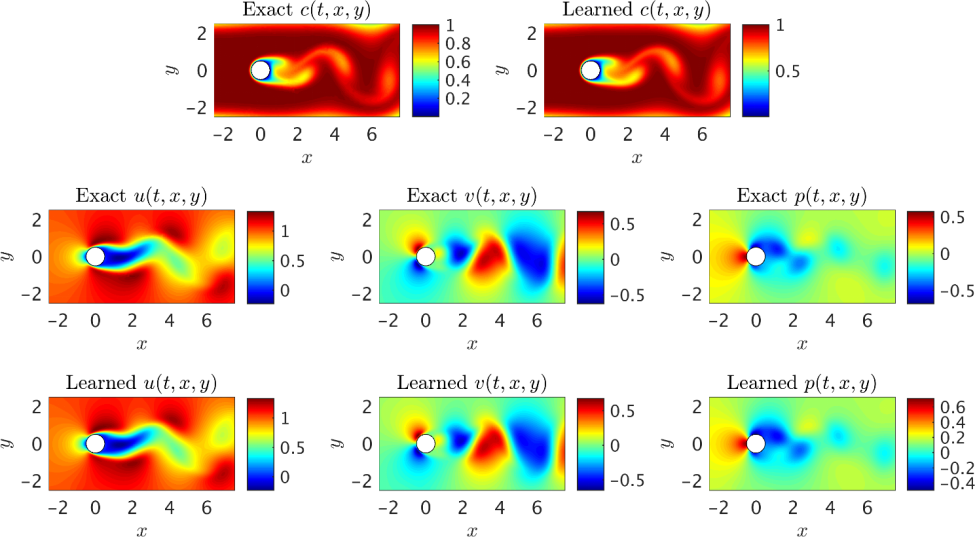

■圆柱绕流问题

■使用PINN模型求解稳态和非稳态流动问题

●iPINN实操案例:

■数据驱动的iPINN常微分方程逆问题求解

■数据驱动的iPINN偏微分方程逆向问题求解

●论文导读

nLino M, Fotiadis S, Bharath A A, et al. Current and emerging deep-learning methods for the simulation of fluid dynamics[J]. Proceedings of the Royal Society A, 2023, 479(2275): 20230058.

nPeng W, Qin S, Yang S, et al. Fourier neural operator for real-time simulation of 3D dynamic urban microclimate[J]. Building and Environment, 2024, 248: 111063.

●图表 11 2D圆柱绕流中重构流场和精确解对比

图表 12 Physics-Informed Machine Learning in Fluid Mechanics

时间:

2024.12.28-----2024.12.29 全天(上午9:00-11:30下午13:30-17:00)

2025.1.02-----2025.1.03晚上(晚上19:00-22:00)

2025.1.04-----2025.1.05全天(上午9:00-11:30下午13:30-17:00)

腾讯会议 线上授课(共五天时间 提供全程回放视频)

946

946

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?