基本概念

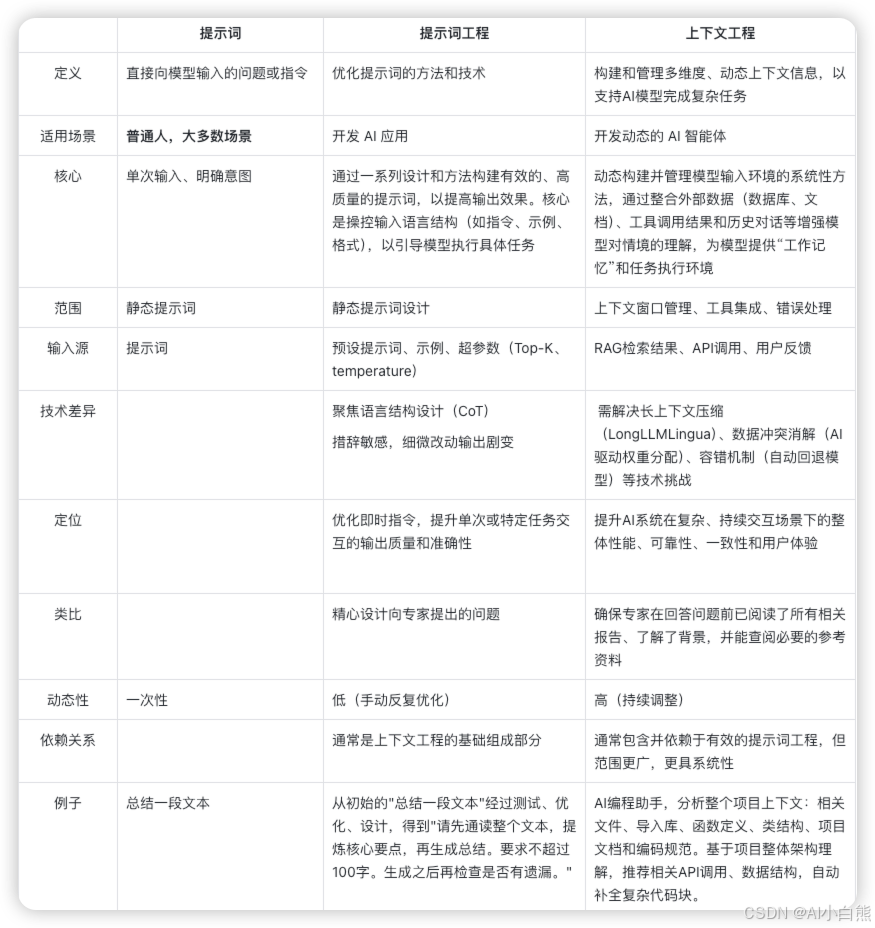

提示词:直接向模型输入问题和命令,最初 chatGPT就是典型场景。

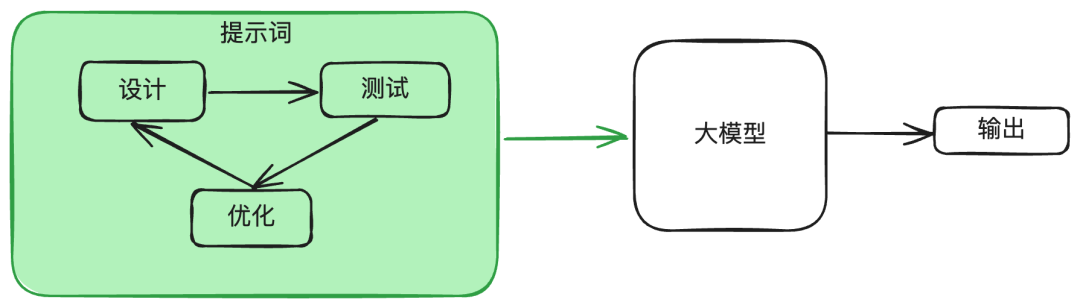

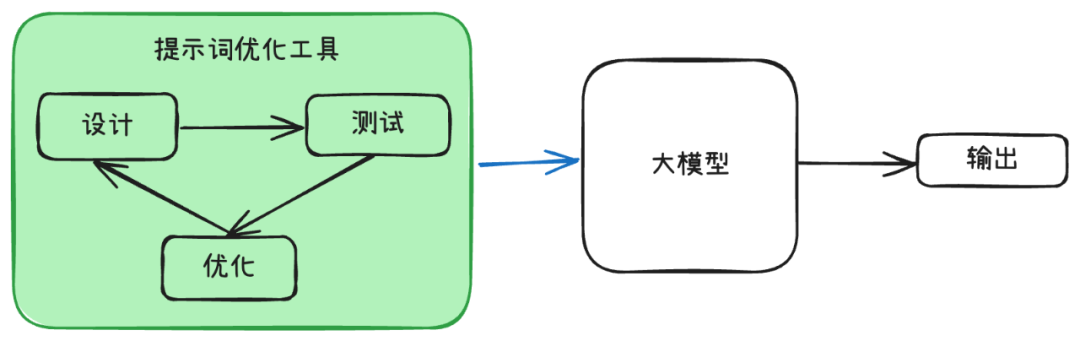

提示词工程:提升单次交互质量的系统性方法。通过结构化、优化和迭代提示词提高AI在特定任务上的输出质量。

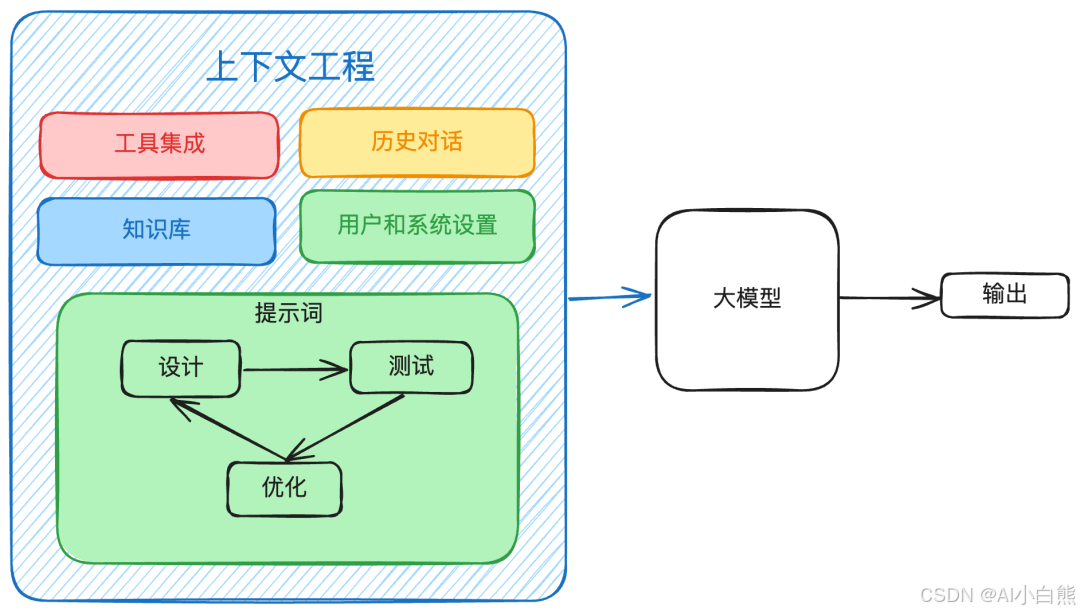

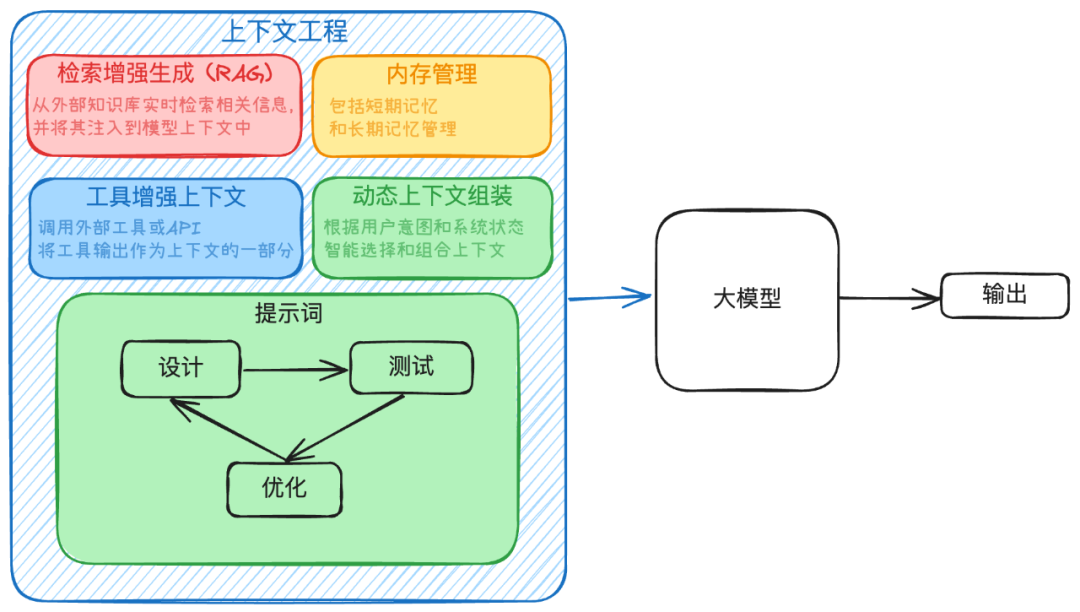

上下文工程:通过管理多维度信息(如历史对话、外部数据、工具调用),为AI提供更全面的背景,是构建智能AI系统的核心。

技术演进

单纯的提示词 -> 不满足于生成的效果。

对提示词结构化并不断优化迭代,提高AI在特定任务上的输出质量而总结出一套方法 -> 提示词工程

单纯靠提示词工程已经无法满足 AI Agent 产品的需求,需要通过更多工具、更多模型相互“讨论”得到的信息来提供给模型。-> 上下文工程。

提示词

这是普通人最常用的场景。

单词任务

提示词模板,辅助你写提示词。

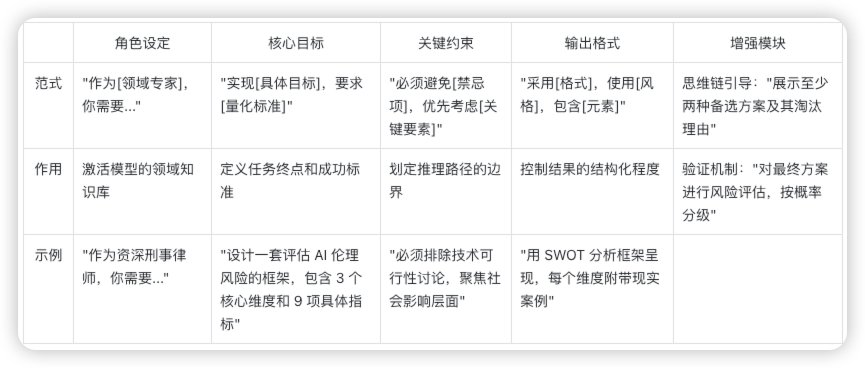

模板一:常规

# 角色

作为[领域专家]

# 任务

实现[具体目标],要求[量化标准]

# 关键约束

必须避免[禁忌项],优先考虑[关键要素]

# 上下文(示例)

# 输出格式

1.**推理记录**(建议提供)——展示关键决策节点及过程。

2.**最终答案**——以 [Markdown] 形式给出清晰可执行的步骤、代码修改或命令。

3.**后续行动**——列出团队需要跟进的事项(如有)。

# 备注

展示至少两种备选方案及其淘汰理由。

这对我的职业生涯非常重要!

模板二:复杂

首先复杂任务建议用agent

# 角色

作为[领域专家]

# 任务

实现[宏观任务],要求[量化标准]

# 阶段分解

1. Phase1:[子目标A](完成标准:__)

2. Phase2:[子目标B](依赖Phase1的__输出)

动态调整规则:[根据__情况,允许__调整]

# 上下文(示例)

# 关键约束

必须避免[禁忌项],优先考虑[关键要素]

# 输出格式

1. 以 [Markdown] 形式给出清晰可执行的步骤、代码修改或命令。

你是最棒的,你一定可以完成这个任务,这对我的职业生涯非常重要!

特定任务高频场景

确认是否是高频场景,如果是的话建议封装成 AI 应用

这需要用到一些工具,比如 PromptPilot[1] 或者 prompt-optimizer[2] 对prompt进行调试优化。

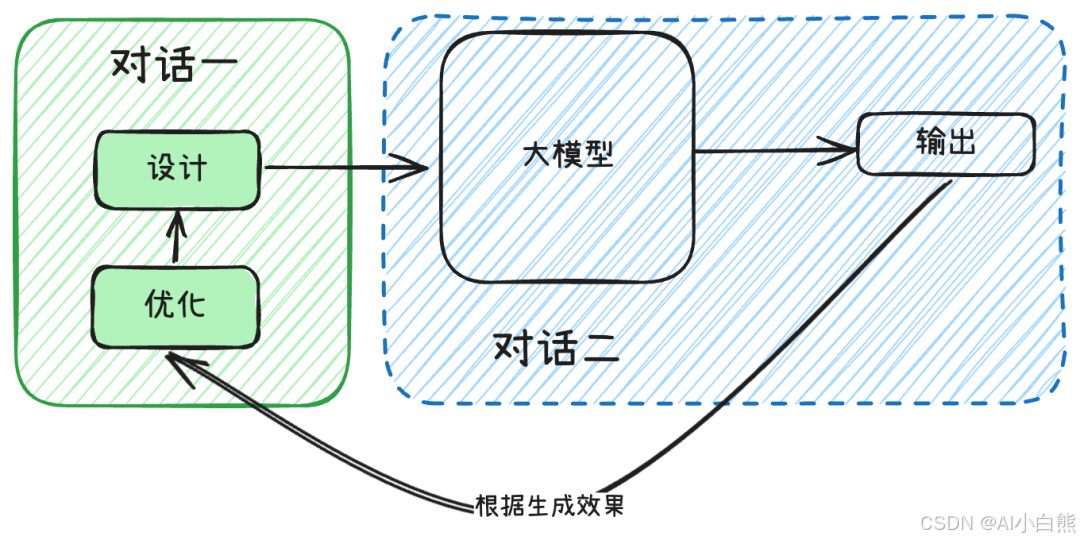

如果不利用工具的话,可以用两个对话实现这个功能。

对话一:用于生成提示词。

对话二:用于执行任务,根据效果让 对话一 调整提示词。

对话一

# 角色

作为提示词和[领域]的专家。

# 任务

根据用户的条件生成一个强大的提示词。使用在 [模型或者应用] 上。

# 约束

// todo 如果没思路可以想一下你想要了解什么?为什么想要了解,是什么启发了你。

* 参考SWOT分析法

# 上下文(示例)

# 输出

结果以 md 形式输出。

# 备注

展示至少两种备选方案及其淘汰理由。

这对我的职业生涯非常重要!

将对话一生成的提示词复制到对话二中。

工具

优化工具

- • LangSmith[3] 可视化追踪不同提示词的输出差异

- • Prompt Pilot[4] 用于针对国内模型进行 Prompt 工程调优

- • prompt-optimizer[5] 提示词优化器,助力于编写高质量的提示词

版本管理工具

- • prompt-manager[6] VS Code/Cursor 的开源插件,统一管理 AI 提示词,支持分类、搜索、导入导出。

- • prompt-shelf[7] 通过 Web 界面,对提示词进行版本管理,可以比对差异和回滚。类似于 Git 版本控制。提供 Docker 一键部署,包含完整的服务配置。

魔法词

提示词后面增加魔法词,提升生成效果(PUA)。

- • Let’s think step by step 让我们逐步思考

- • My career depends on it / 这对我的职业生涯非常重要。

- • Take a deep breathe and think this through / 深呼吸,仔细考虑

上下文工程

如果你打算开发AI智能体,那可以看下这部分用于参考。但是大多数情况下,你其实用不着。

为大语言模型提供恰当的信息和工具,帮助模型高效完成任务。

上下文工程的难点在于:恰当(平衡信息量)。

参数太少或者配得不对,生成的结果就不好,性能也会变差。

参数太多,或者里面夹杂毫无关联的数据则会增加成本,而且结果也不一定就好。

你可以理解为:“学而不思则罔,思而不学则殆。”差不多道理。

所以如何准确把握大模型和用户之间这种微妙的互动关系,需要一种近似直觉的能力。

- • 记忆

- • "记住"过去的交互和学习到的知识

- • 将AI模型与外部数据库、API接口或特定工具连接

- • 整理构建

- • 整合并管理包括用户历史、系统预设、外部知识库等信息

- • 根据任务需求和模型反馈,动态组装上下文

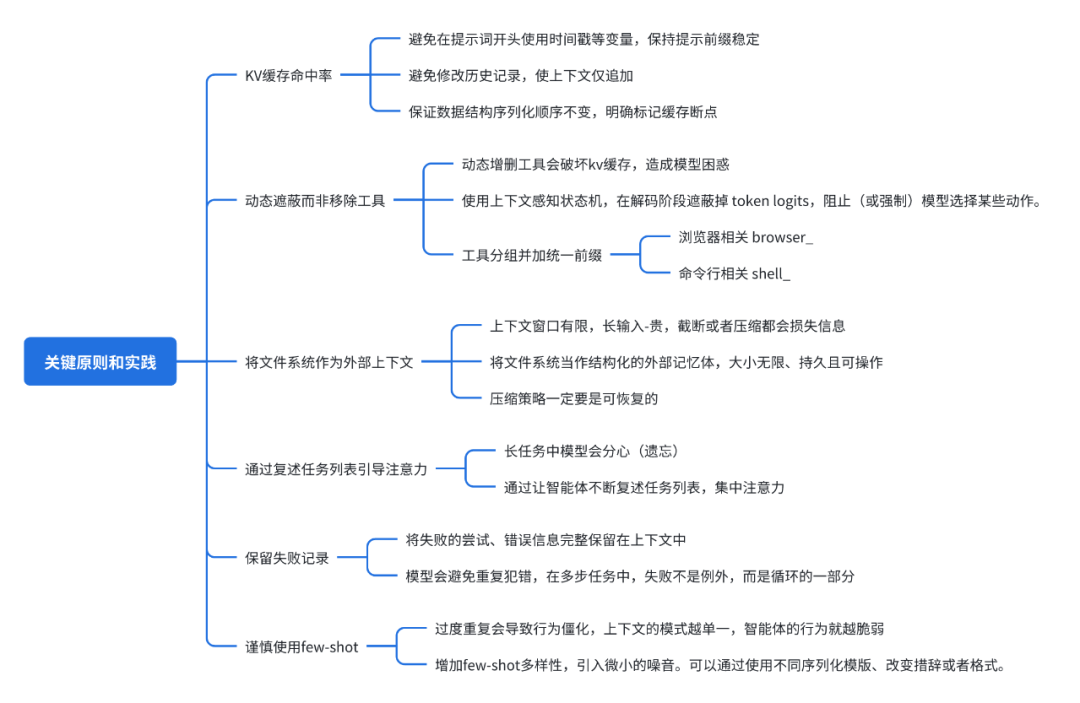

Manus 是如何管理上下文的?

整个设计都是围绕在 提高 KV缓存命中率上。

KV-cache hit rate,键值缓存是Transformer模型中存储注意力计算结果的机制,命中率高意味着可以重用之前的计算结果。

用没用缓存成本可以相差十倍。

提示词工程和上下文工程协同

提示词工程和上下文工程是协同工作的关系,目标是实现AI系统性能的最大化。

协同工作的核心在于将提示词视为在特定上下文中与模型沟通的最终指令,而这个上下文则由更广泛的系统工程来构建和管理。

目前有三种方案:

方案一:分层设计

通过上下文工程构件基础上下文层,包含用户信息、历史交互、领域知识等。然后针对具体任务运用提示词工程构建精确的任务特定提示。

方案二:动态调整

根据交互状态和模型响应,动态调整上下文信息并且优化提示词。通过 反馈循环 持续优化交互质量。

比如:模型理解不准确时,系统获取更多概念解释并注入上下文,调整提示词。

方案三:模块化模版

创建模块化提示词模版,上下文工程系统根据当前任务动态填充占位符,保证结构优化和内容动态性。这既能保证提示词结构的优化,又确保内容的动态性和相关性。

普通人如何抓住AI大模型的风口?

领取方式在文末

为什么要学习大模型?

目前AI大模型的技术岗位与能力培养随着人工智能技术的迅速发展和应用 , 大模型作为其中的重要组成部分 , 正逐渐成为推动人工智能发展的重要引擎 。大模型以其强大的数据处理和模式识别能力, 广泛应用于自然语言处理 、计算机视觉 、 智能推荐等领域 ,为各行各业带来了革命性的改变和机遇 。

目前,开源人工智能大模型已应用于医疗、政务、法律、汽车、娱乐、金融、互联网、教育、制造业、企业服务等多个场景,其中,应用于金融、企业服务、制造业和法律领域的大模型在本次调研中占比超过 30%。

随着AI大模型技术的迅速发展,相关岗位的需求也日益增加。大模型产业链催生了一批高薪新职业:

人工智能大潮已来,不加入就可能被淘汰。如果你是技术人,尤其是互联网从业者,现在就开始学习AI大模型技术,真的是给你的人生一个重要建议!

最后

只要你真心想学习AI大模型技术,这份精心整理的学习资料我愿意无偿分享给你,但是想学技术去乱搞的人别来找我!

在当前这个人工智能高速发展的时代,AI大模型正在深刻改变各行各业。我国对高水平AI人才的需求也日益增长,真正懂技术、能落地的人才依旧紧缺。我也希望通过这份资料,能够帮助更多有志于AI领域的朋友入门并深入学习。

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

大模型全套学习资料展示

自我们与MoPaaS魔泊云合作以来,我们不断打磨课程体系与技术内容,在细节上精益求精,同时在技术层面也新增了许多前沿且实用的内容,力求为大家带来更系统、更实战、更落地的大模型学习体验。

希望这份系统、实用的大模型学习路径,能够帮助你从零入门,进阶到实战,真正掌握AI时代的核心技能!

01 教学内容

-

从零到精通完整闭环:【基础理论 →RAG开发 → Agent设计 → 模型微调与私有化部署调→热门技术】5大模块,内容比传统教材更贴近企业实战!

-

大量真实项目案例: 带你亲自上手搞数据清洗、模型调优这些硬核操作,把课本知识变成真本事!

02适学人群

应届毕业生: 无工作经验但想要系统学习AI大模型技术,期待通过实战项目掌握核心技术。

零基础转型: 非技术背景但关注AI应用场景,计划通过低代码工具实现“AI+行业”跨界。

业务赋能突破瓶颈: 传统开发者(Java/前端等)学习Transformer架构与LangChain框架,向AI全栈工程师转型。

vx扫描下方二维码即可

本教程比较珍贵,仅限大家自行学习,不要传播!更严禁商用!

03 入门到进阶学习路线图

大模型学习路线图,整体分为5个大的阶段:

04 视频和书籍PDF合集

从0到掌握主流大模型技术视频教程(涵盖模型训练、微调、RAG、LangChain、Agent开发等实战方向)

新手必备的大模型学习PDF书单来了!全是硬核知识,帮你少走弯路(不吹牛,真有用)

05 行业报告+白皮书合集

收集70+报告与白皮书,了解行业最新动态!

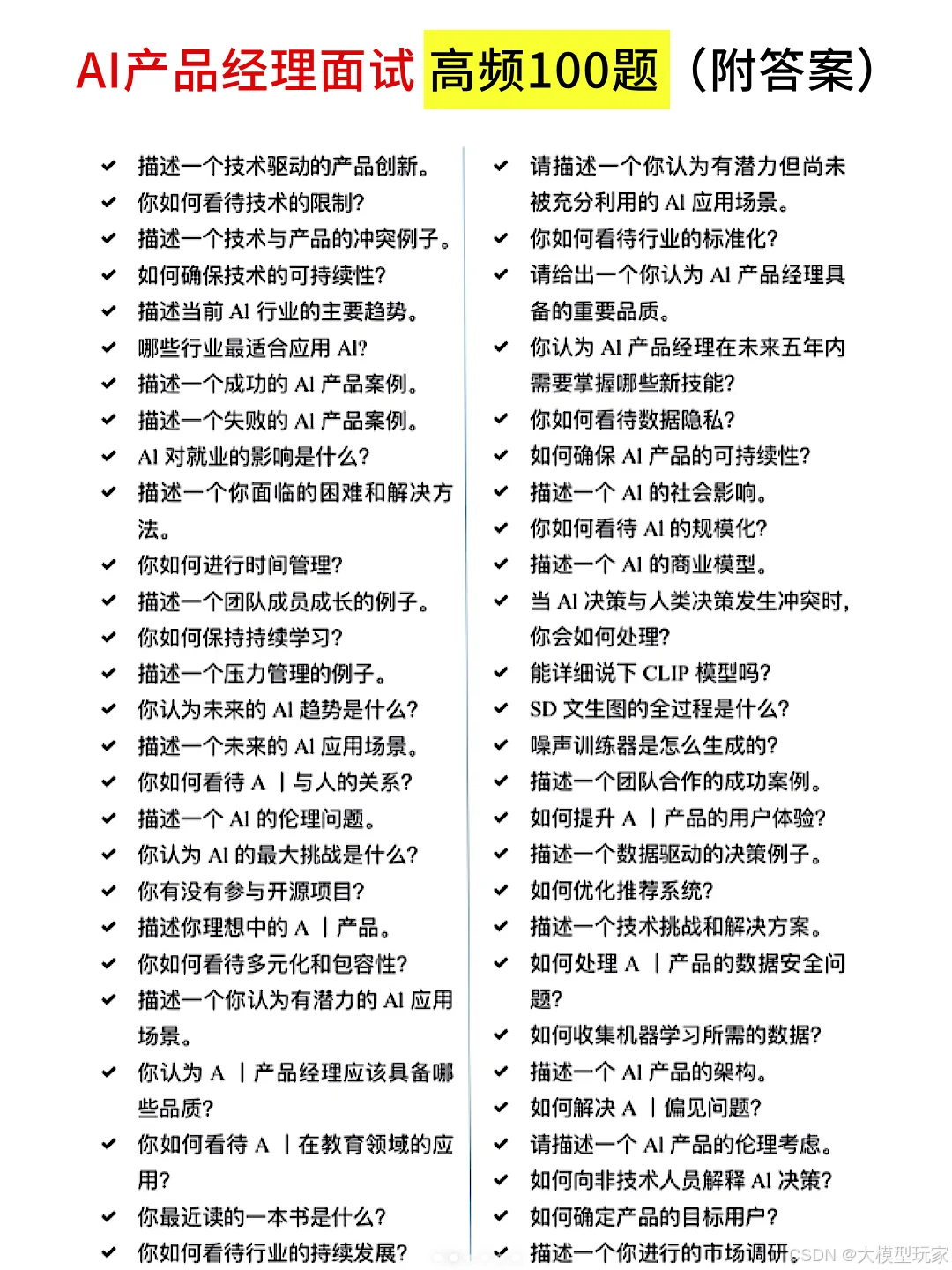

06 90+份面试题/经验

AI大模型岗位面试经验总结(谁学技术不是为了赚$呢,找个好的岗位很重要)

07 deepseek部署包+技巧大全

由于篇幅有限

只展示部分资料

并且还在持续更新中…

真诚无偿分享!!!

vx扫描下方二维码即可

加上后会一个个给大家发

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?