Punica项目简介

Punica是一个开源项目,其目标是为多个使用LoRA(Low-Rank Adaptation)技术微调的大语言模型提供统一的服务接口。该项目的主要特点和优势包括:

- 可以同时加载和服务多个LoRA微调模型

- 提供统一的API接口,简化了模型调用

- 优化了推理性能,提高了模型服务效率

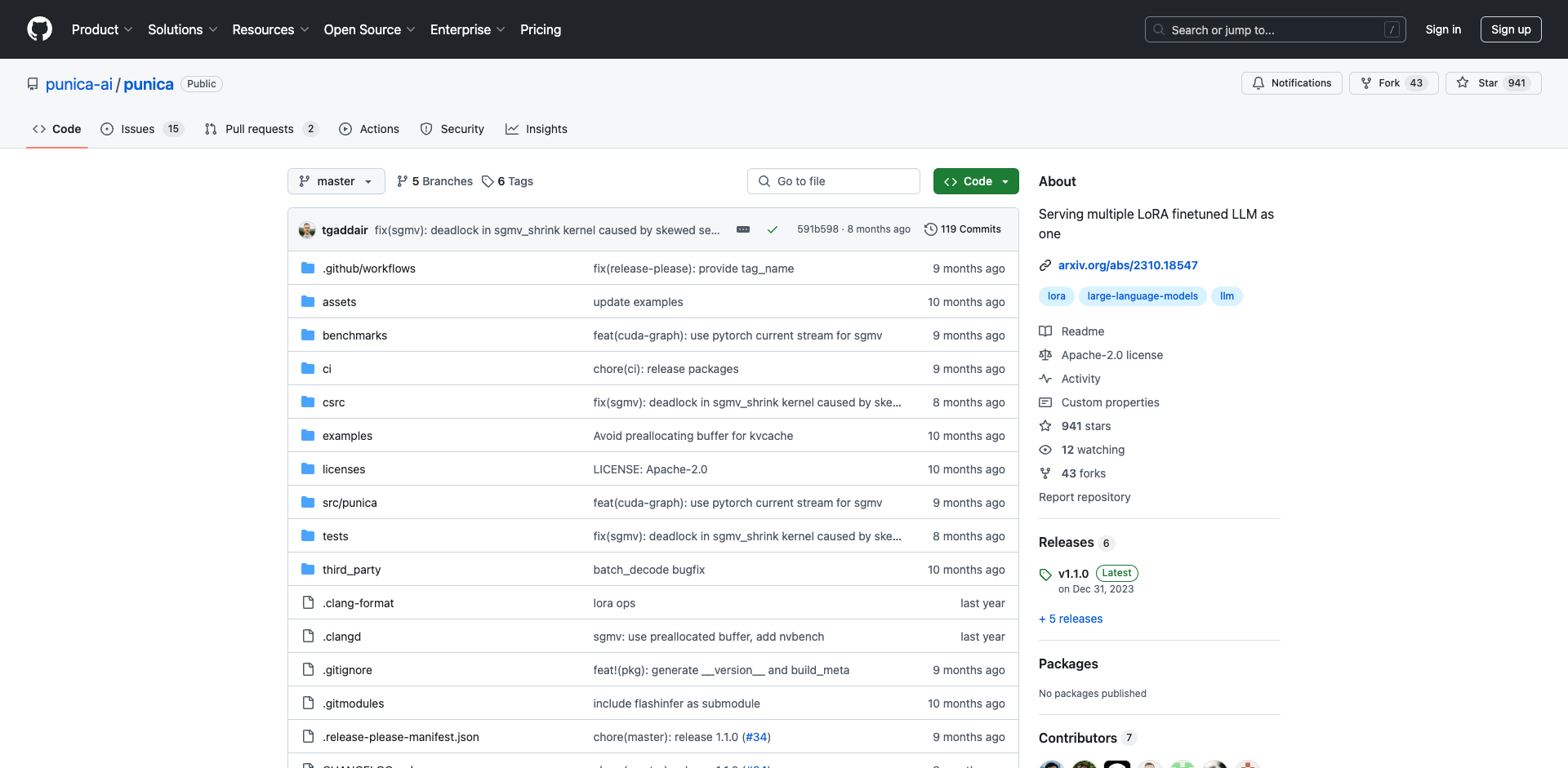

项目地址:GitHub - punica-ai/punica: Serving multiple LoRA finetuned LLM as one

核心资源

-

项目论文: Punica: Serving multiple LoRA finetuned LLM as one

这篇论文详细介绍了Punica的技术原理和实现方法。

-

GitHub仓库: GitHub - punica-ai/punica: Serving multiple LoRA finetuned LLM as one

包含完整的源代码、安装说明和使用示例。

-

文档: 项目的README文件提供了基本的使用说明和入门指南。

快速上手

-

安装Punica:

pip install punica -

使用示例: 在项目的

examples目录下有多个使用示例,可以参考学习。 -

API文档: 详细的API文档可以在项目源码中找到。

社区资源

-

Issues: Issues · punica-ai/punica · GitHub

可以在这里提出问题或查看已解决的问题。

-

Pull Requests: Pull requests · punica-ai/punica · GitHub

可以查看正在进行的开发工作或贡献代码。

延伸阅读

-

LoRA技术介绍: LoRA: Low-Rank Adaptation of Large Language Models

-

大语言模型微调: A Survey of Large Language Models

通过以上资源,读者可以全面了解Punica项目,并快速上手使用。随着项目的不断发展,建议定期关注GitHub仓库以获取最新更新和信息。

文章链接:www.dongaigc.com/a/punica-lora-finetuning-guide

https://www.dongaigc.com/a/punica-lora-finetuning-guide

1465

1465

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?