2024深度学习发论文&模型涨点之——交叉注意力机制+特征融合

交叉注意力(Cross-Attention)

交叉注意力机制允许模型在一个模态的特征上关注另一个模态的特征,从而实现不同模态之间的信息交互。这种机制特别适用于多模态数据,因为它可以帮助模型识别和利用不同数据源之间的相关性。

特征融合(Feature Fusion)

特征融合是指将来自不同模态或不同层次的特征组合起来,以获得更丰富、更全面的表征。这可以通过多种方式实现,包括早期融合(在特征提取之前合并数据)、中期融合(在特征提取之后、决策之前合并特征)和晚期融合(在决策层面合并结果)。

Attention和多模态在深度学习领域依旧是神一般的存在,而交叉注意力融合作为交汇点,显然具有巨大的发展潜力。

我整理了一些交叉注意力融合【论文+代码】合集,需要的同学公人人人号【AI创新工场】自取。

论文精选

论文1:

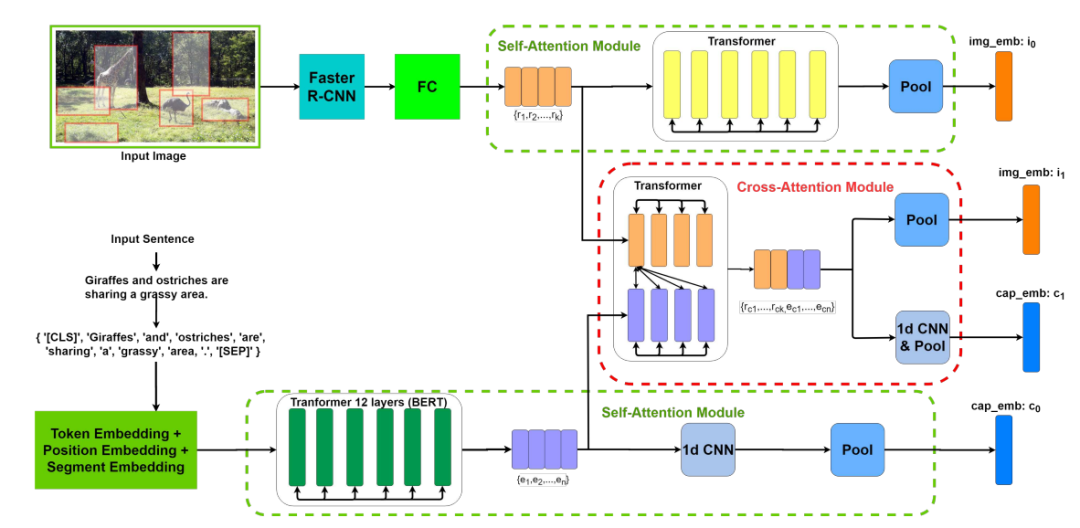

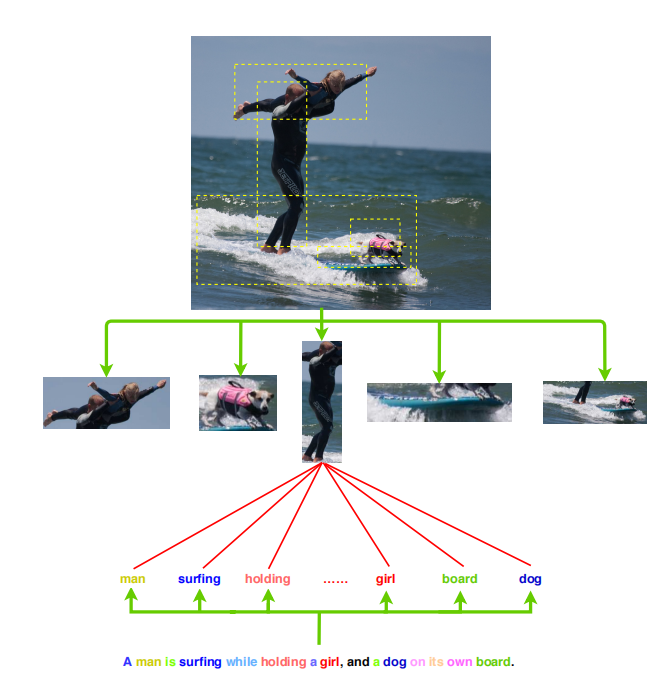

[CVPR] Multi-Modality Cross Attention Network for Image and Sentence Matching

用于图像和句子匹配的多模态交叉注意力网络

方法

-

交叉注意力机制:提出了一种新颖的交叉注意力机制,不仅能够利用每种模态内部的内模态关系,还能够利用图像区域和句子单词之间的外模态关系,以互补和增强图像和句子匹配。

-

自注意力模块:设计了一个自注意力模块,使用Transformer单元提取图像区域和单词令牌的特征,并独立地输入到Transformer单元和BERT模型中,以发现内模态关系。

-

交叉注意力模块:在交叉注意力模块中,将图像区域和句子单词的表示堆叠并通过另一个Transformer单元传递,然后通过1D-CNN和池化操作融合内模态和外模态信息。

-

双向三元组损失:在训练阶段,构建了带有硬负例挖掘的双向三元组损失,以优化模型中的参数。

创新点

-

统一的深度模型:提出了一种新颖的多模态交叉注意力网络,通过在统一的深度模型中联合建模图像区域和句子单词的内模态和外模态关系,用于图像和句子匹配。

-

交叉注意力模块:提出了一种新颖的交叉注意力模块,能够不仅利用每种模态内部的内模态关系,还能够利用图像区域和句子单词之间的外模态关系,以互补和增强图像和句子匹配。

-

性能提升:在Flickr30K和MS-COCO两个标准基准测试中,所提出的模型显示出与最先进的图像和句子匹配方法相比具有更好的性能。

-

细粒度表示:通过自注意力模块和交叉注意力模块联合建模内模态和外模态关系,能够获得更适合测量视觉和文本数据相关性的嵌入表示,从而更好地完成检索任务。

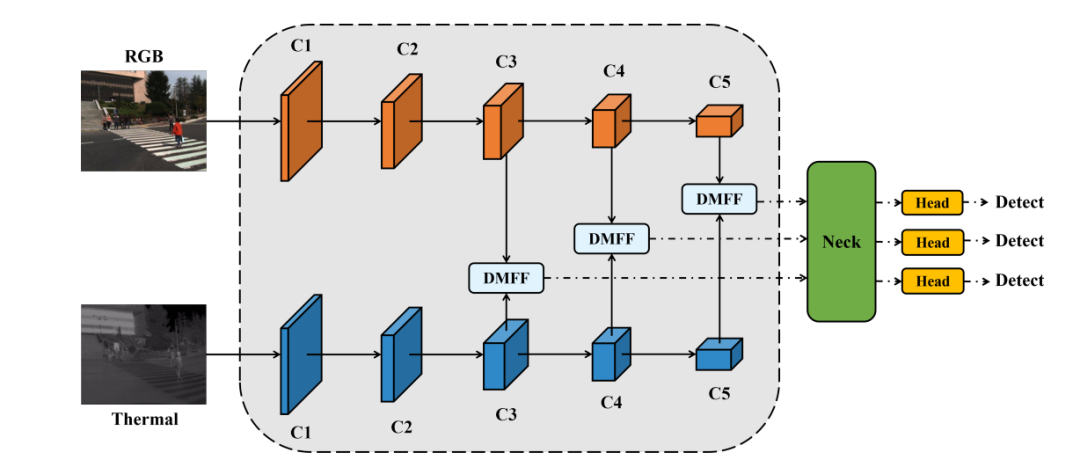

论文2:

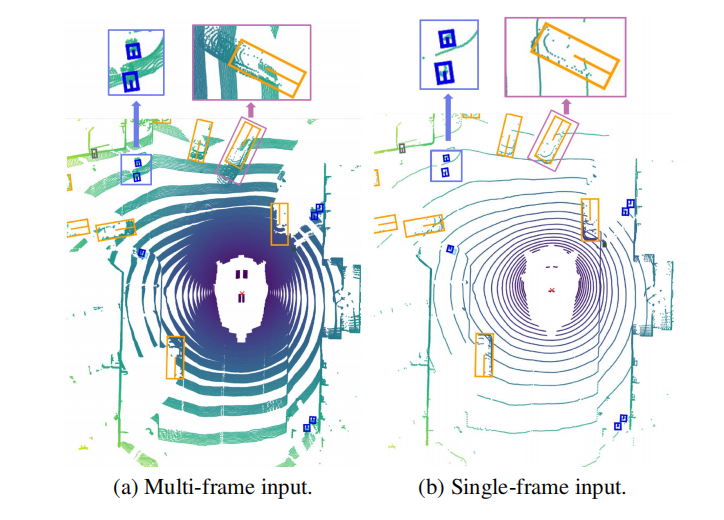

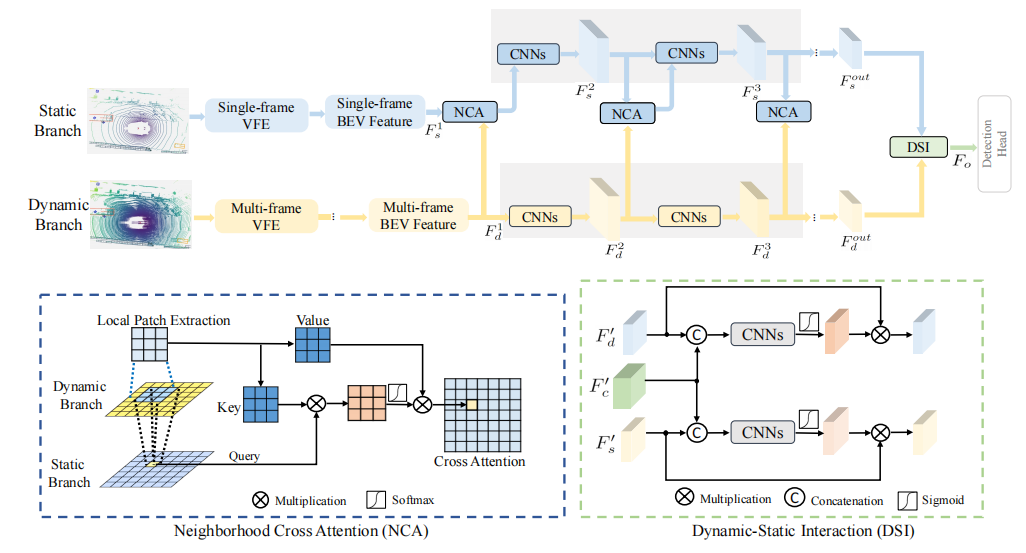

[CVPR] DynStatF: An Efficient Feature Fusion Strategy for LiDAR 3D Object Detection

DynStatF:一种高效的激光雷达3D目标检测特征融合策略

方法

-

双路径架构:DynStatF采用双路径架构,分别处理多帧(动态分支)和单帧(静态分支)的激光雷达输入。

-

邻域交叉注意力(NCA)模块:将静态分支的特征作为查询,动态分支的特征作为键(值)进行注意力计算,仅考虑邻域位置。

-

动态-静态交互(DSI)模块:在特征图变得密集的阶段,使用基于CNN的DSI模块在每个像素位置进行综合交互。

创新点

-

动态-静态融合(DynStaF):首次尝试部署双流架构,从多帧和单帧激光雷达输入中提取和融合特征。

-

邻域交叉注意力(NCA):针对稀疏的BEV特征图设计,通过局部交叉注意力机制有效融合不同尺度的特征图。

-

动态-静态交互(DSI):针对密集特征图设计,通过CNN模块增强特征之间的交互,提升检测精度。

-

性能提升:在nuScenes数据集上,DynStatF显著提升了PointPillars和CenterPoint模型的性能,达到了最先进的性能水平。

论文3:

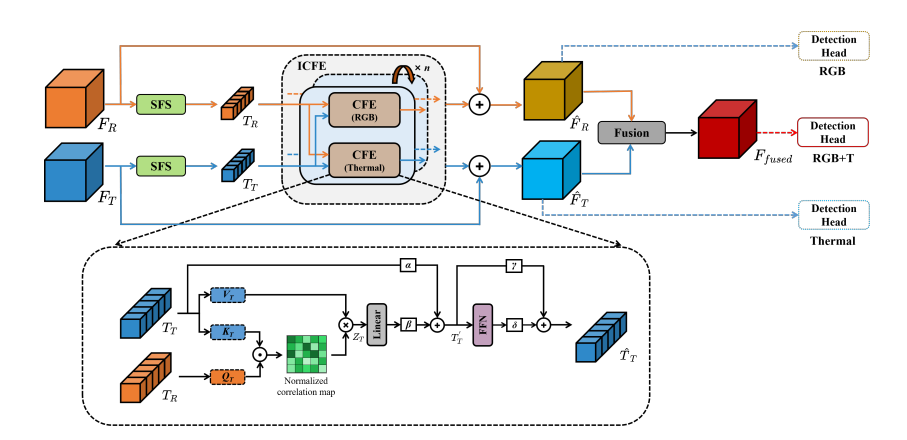

ICAFusion: Iterative Cross-Attention Guided Feature Fusion for Multispectral Object Detection

ICAFusion:迭代交叉注意力引导的多光谱目标检测特征融合

方法

-

双交叉注意力变换器框架:提出一种新的特征融合框架,用于同时建模全局特征交互和捕获跨模态的互补信息。

-

查询引导的交叉注意力机制:通过查询引导的交叉注意力机制增强对象特征的可区分性。

-

迭代交互机制:灵感来自人类复习知识的过程,提出一种迭代交互机制,在块间多模变换器之间共享参数,降低模型复杂度和计算成本。

创新点

-

双交叉注意力特征融合方法:提出一种新的方法,同时聚合RGB和热图像的互补信息。

-

迭代学习策略:为高效的多光谱特征融合量身定制,进一步提高模型性能,而不增加可学习参数。

-

通用性和有效性:提出的特征融合方法可以集成到不同的检测框架中,并与不同的主干网络一起使用。

-

快速推理速度:在KAIST、FLIR和VEDAI数据集上实现优越性能的同时,也获得了非常快的推理速度。

论文4:

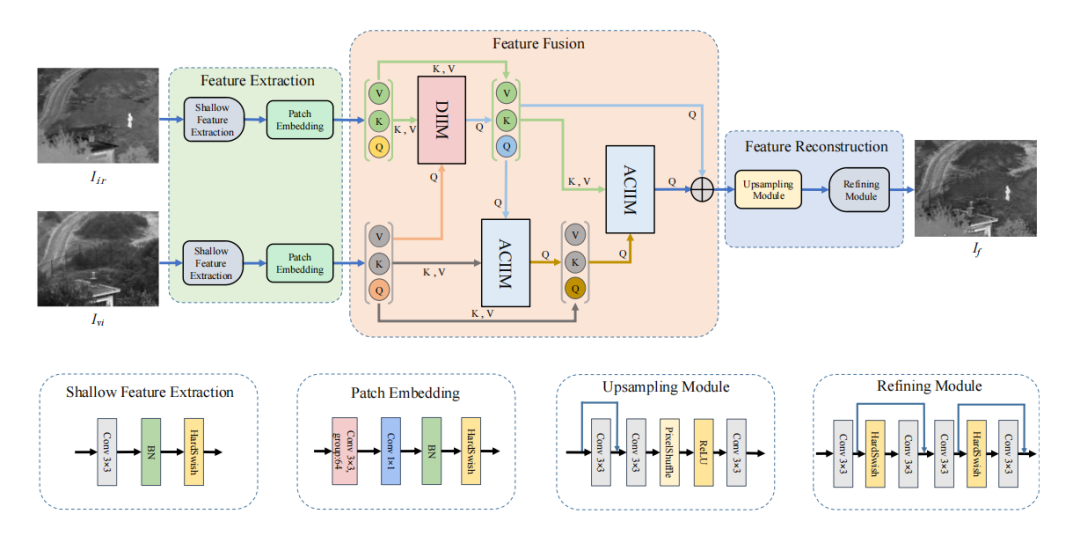

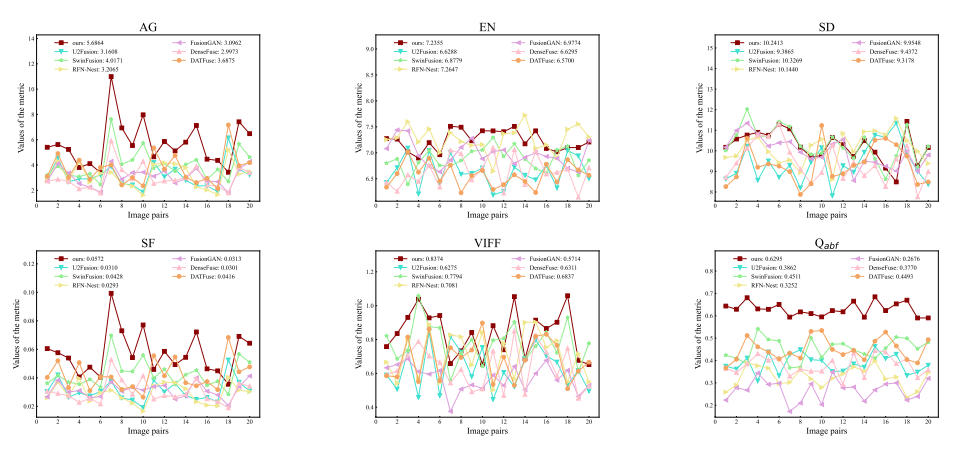

Rethinking Cross-Attention for Infrared and Visible Image Fusion

重新思考红外和可见光图像融合的交叉注意力

方法

-

改进的交叉注意力机制:通过修改传统的交叉注意力机制,提出一种新的机制,可以促进源图像差异信息的提取。

-

差异信息注入模块(DIIM):设计用于修改的交叉注意力机制,可以提升源图像差异信息的提取。

-

交替公共信息注入模块(ACIIM):通过交替使用传统的交叉注意力机制,可以充分挖掘公共信息并整合长期依赖性。

创新点

-

端到端ATFuse网络:提出了一种新的网络,用于红外和可见光图像的融合,具有很好的效果和泛化能力。

-

差异信息注入模块(DIIM):基于交叉注意力机制提出,可以分别探索源图像的独特特征。

-

交替公共信息注入模块(ACIIM):应用在提出的框架中,可以充分保留最终结果中的公共信息。

-

分段像素损失函数:设计了一种由不同像素强度约束组成的损失函数,用于训练ATFuse,以便在融合结果中实现纹理细节和亮度信息的良好平衡。

6609

6609

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?