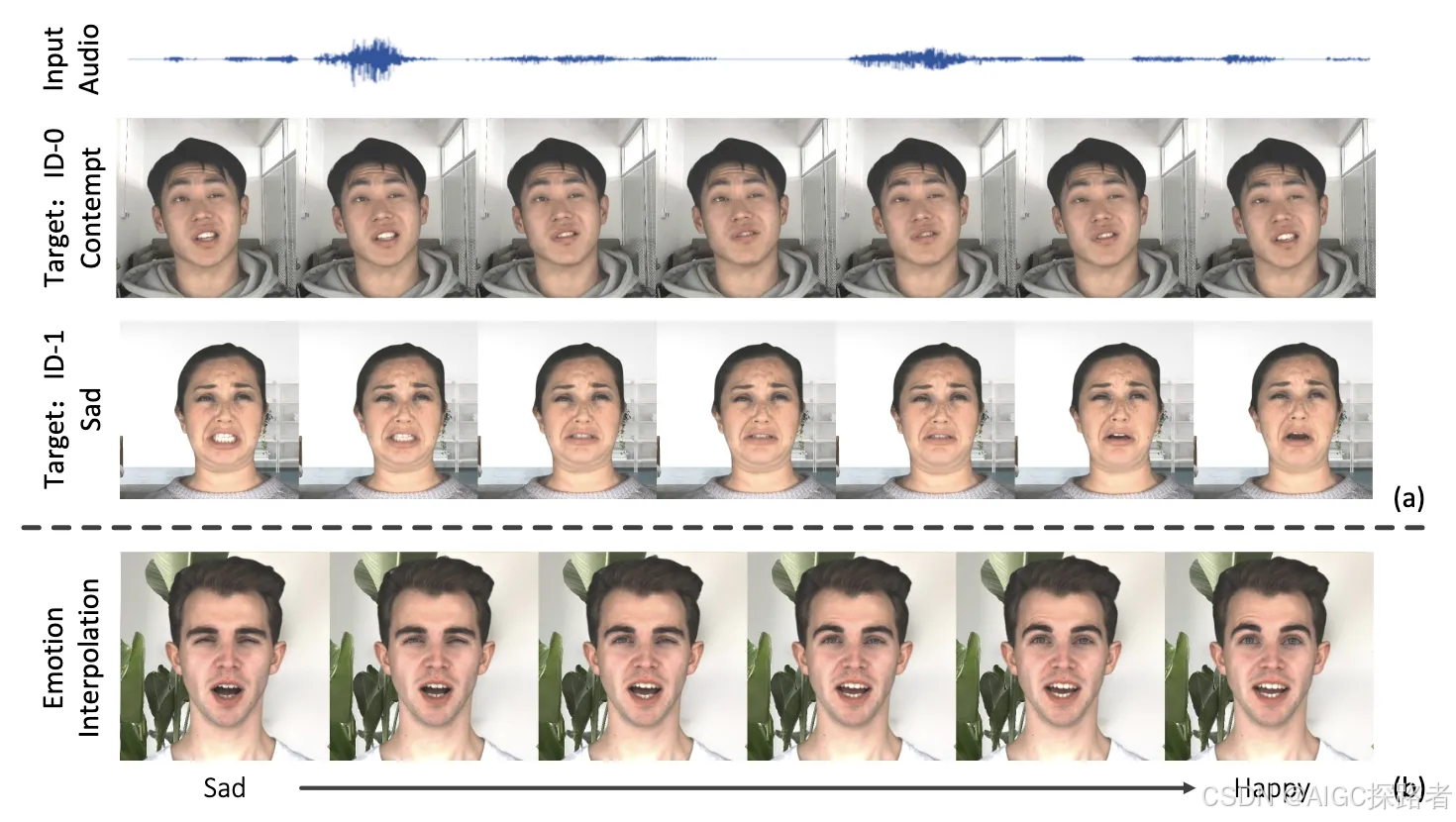

尽管在生成音频驱动的说唱头像方面取得了先前成功,但大多数先前的研究都集中在语音内容与口型之间的相关性上。在他们的大多数方法中,总是忽略自然人类面部最重要的特征之一——面部表情。在这项工作中,我们提出了情感视频肖像(EVP),一种由音频驱动合成具有生动情感动态的高质量视频肖像的系统。具体来说,我们提出交叉重构的情感解耦技术,将语音分解为两个解耦的空间,即与持续时间无关的情绪空间和与持续时间相关的内容空间。有了这些解耦的特征,就可以推导出动态的二维情感面部标志点。然后我们提出目标自适应的面部合成技术,通过桥接推导出的标志点和目标视频的自然头部姿势之间的差距来生成最终的高质量视频肖像。广泛的实验证明了我们的方法在质量和数量上的有效性。

论文题目:Audio-Driven Emotional Video Portraits

论文链接:https://arxiv.org/abs/2104.07452

研究方法

这篇论文提出了情感视频肖像(Emotional Video Portraits, EVP)系统,用于解决基于音频的情感视频生成问题。具体来说,

跨重构情感解耦技术:首先&#x

订阅专栏 解锁全文

订阅专栏 解锁全文

4627

4627

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?