前言:

刚进实验室,被叫去看CNN。看了一些博客和论文,消化了很久,同时觉得一些博客存在一些谬误。我在这里便尽量更正,并加入自己的思考。如果觉得本文有哪里不妥或疑惑,请在下面发表评论,大家一起探讨。

ps: 本篇博文原本来自我在cnblogs的博客,但是在那里好像没什么人讨论这个,所以干脆连博客也迁回了csdn,还是这里朋友多。

卷积神经网络(CNN)是deep learning的基础。传统的全连接神经网络(fully connected networks) 以数值作为输入。如果要处理图像相关的信息的话,要另外从图像中提取特征并采样。而CNN把提特征、下采样和传统的神经网络整合起来,形成一个新的网络。本文假设你已经有了简单神经网络的概念,如“层(layers)”、“神经元(neurons)”。

一. 理论基础

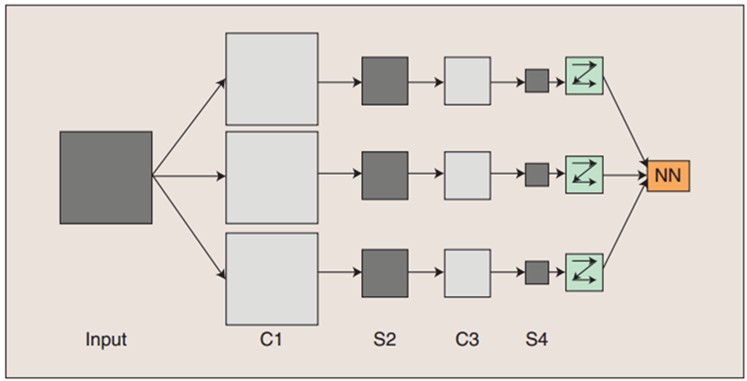

图1

Α. 简单网络拓扑:

如图1所示,这是一个简单的卷积神经网络 CNN。其中C层代表对输入图像进行滤波后得到的所有组成的层,也称“卷积层”。S层代表对输入图像进行下采样(subsampling)得到的层。其中C1和C3是卷积层 ,S2和S4则是下采样层。C、S层中的每一层都由多个二维平面组成,每一个二维平面是一个特征图 (feature map)。

以图1所示的CNN为例,讲讲图像的处理流程:

图像输入网络后,通过三个滤波器(filter) 进行卷积,得到C1层的三个特征图(feature map)。C1层的三个特征图分别通过下采样得到S2层的三个特征图。这三个特征图通过一个滤波器卷积得到C3层的三个特征图,然后和前面类似,下采样得到S4层的三个特征图。最后,S4层的特征图光柵化后,变成向量。这个向量输入到传统的全连接神经网络(fully connected networks)中进行进一步的分类。

图中的C1、S2 、C3、S4层中的所有特征图都可以用 “像素 x 像素” 定义图像大小。你会说,图像的大小不就是用像素x像素定义的么? 没错,但这里有点特殊,由于这些特征图组成了神经网络的卷积层和下采样层,而在神经网络(neural networks)中,每一层都有“神经元” (neurons) 的概念。这些特征图中的每一个像素恰恰旧就代表了一个神经元。每一层所有特征图的像素个数,就是当层网络的神经元个数,这是可以算出来的,怎么算? 再往后面看一看。

Β. 隐层(hidden layer):

提到了神经元的概念之后,就可以讲述 a) CNN中C-S部分的隐层(NN部分的隐层就不在这里讲了) 还有 b) 层与层之间,神经元的连接情况的概念了。隐层就是一块黑色的面纱,它隐藏了真相,但种种蛛丝马迹(如滤波器的大小、步长,下采样的范围,偏置数等等)告诉你,你已经很逼近真相了。嗯,不扯了,就是说有了那些东西,你就可以算出神经元的数目、可学习的参数个数、神经元的连接数了。分为两种:别的层和卷积层之间的隐层、卷积层和下采样层之间的隐层。

1. 别的层和卷积层之间的隐层:

滤波器(卷积核)定义:

filter_width、filter_height → 滤波范围的宽、高;

filter_channels → 过滤图像的通道数;

filter_types → 滤波器的种类。

例: 5x5x3 → 20: 滤波器宽高

本文深入探讨卷积神经网络(CNN)的理论基础和计算实践,包括网络拓扑、卷积层与下采样层的结构和连接方式,以及参数计算。通过实例解析LeNet-5的参数数量,阐述CNN在图像处理中的作用,如特征提取、下采样和全连接层的使用。

本文深入探讨卷积神经网络(CNN)的理论基础和计算实践,包括网络拓扑、卷积层与下采样层的结构和连接方式,以及参数计算。通过实例解析LeNet-5的参数数量,阐述CNN在图像处理中的作用,如特征提取、下采样和全连接层的使用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1056

1056

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?