Transferable Attention for Domain Adaptation笔记

现有的对抗领域自适应方法主要是将从整个图像中提取的特征跨域对齐,而没有考虑不同区域的复杂分布。图像的不同区域具有不同的可转移性,为实现特征的细粒度对齐,这篇文章提出了TADA。由多个区域级鉴别器产生的局部注意力来突出可迁移的区域和由单个图像级域鉴别器产生的全局注意力来突出可迁移的图像。

TADA结构:

Transferable Local Attention

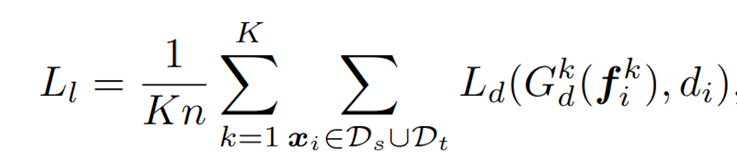

为了在图像的不同区域匹配源域和目标域,用K个区域鉴别器来负责匹配对应于区域K的源域和目标域数据。

表示图像i在第k个区域上的特征。区域级判别器的输出是 图像i中区域k属于源域的概率(1表示源域;0表示目标域)

原文中说为了关注更多可转移的区域,应该在这些区域上产生更大的局部关注值。用熵来衡量不确定性。

局部关注值:![]()

以我的认知,前面的意思是说,如果源域和目标域在某块区域上比较接近的话,那么就认为这块区域是可迁移的,应给较大的局部关注值,这时也就意味这判别器的输出接近0.5,熵值较大,w会是一个较小的值,这跟文章中的描述是比较矛盾的。

我看了这篇论文的源代码,代码中的确用的是减号。关于这一点也咨询了一下原作者和师姐,解释如下:

TADA(local)主要关注的是前景图像而不是背景,如果某一区域能够把源域和目标域区分开(熵小),说明这一区域是源域和目标域前景图像的代表性特征,我们应该将这一区域给较大的关注值来进行源域和目标域的适配。

这一步就可以理解为对于w的预测值可能不是准确的,为了缓解这种影响,增加了一个残留机制。

这一步就可以理解为对于w的预测值可能不是准确的,为了缓解这种影响,增加了一个残留机制。

Transferable Global Attention

在全局注意力上,同样使用了熵机制,源域图像和目标域图像越接近(熵大),就容易迁移,这是给图像赋予一个较大的注意力。

1595

1595

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?