写在前面

学习成绩,不管是是保研、考研、出国留学,还是找实习找工作,都是你极为重要的支撑。为了帮助同学们更好地学习专业课、斩获高绩点,岛主将持续推出CS相关的专业教材资料!希望同学们能够在接下来的学习生活中取得良好的成绩!

今天为大家带来的是

↓↓↓

机器学习-周志华

电子版 教材+答案

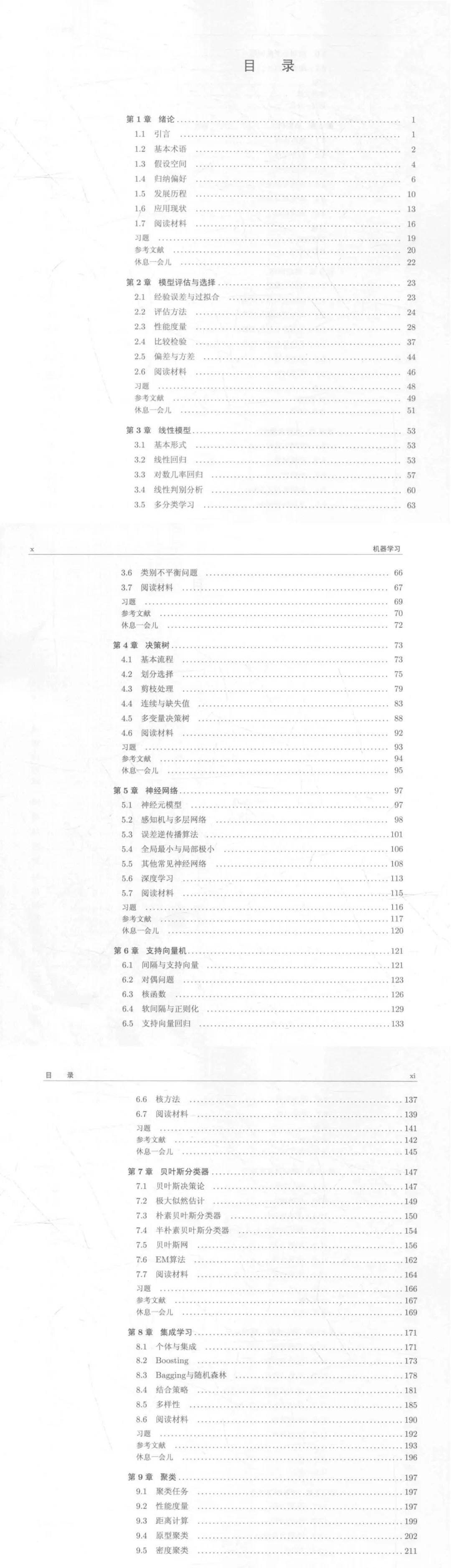

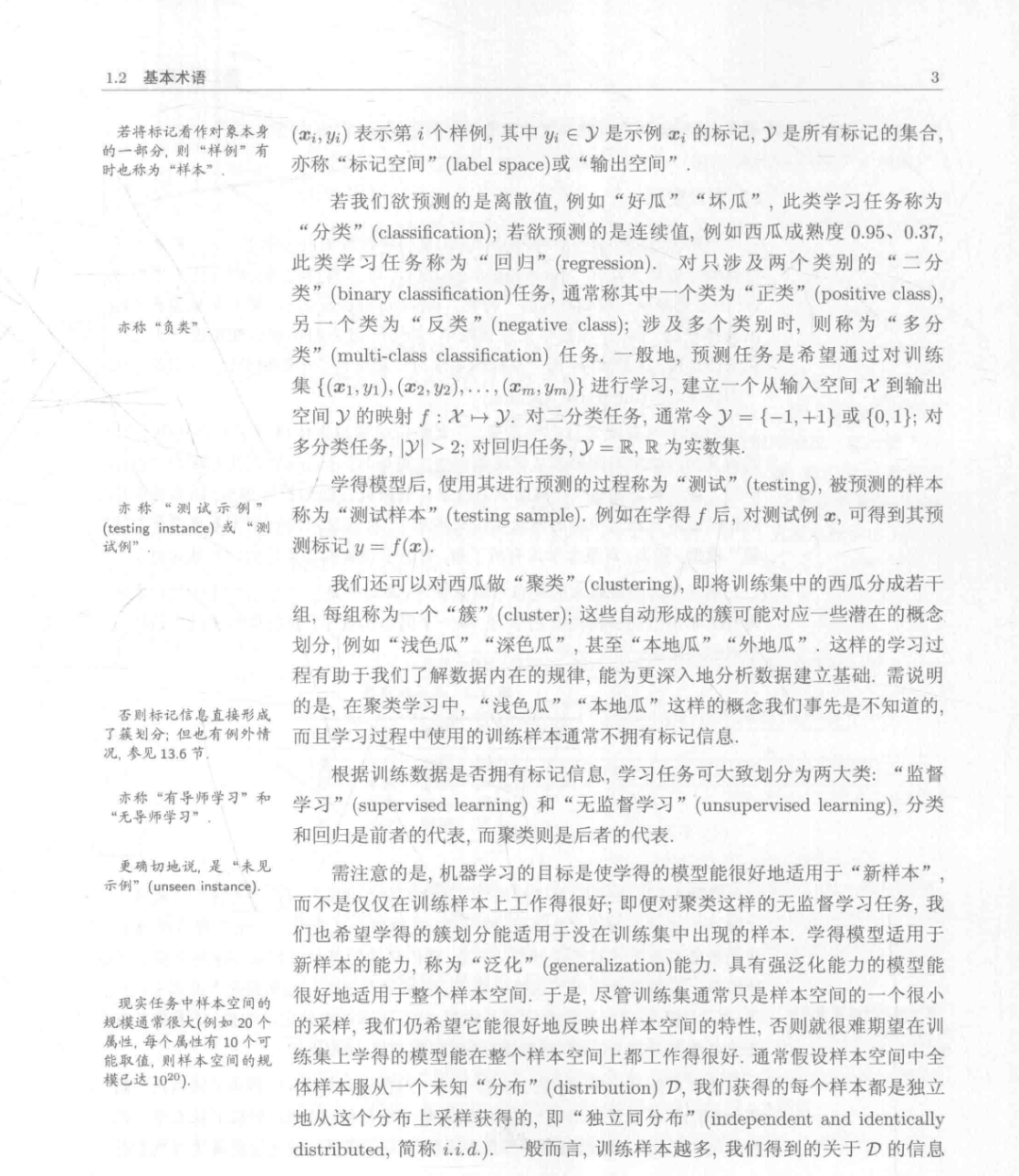

机器学习是计算机科学的重要分支领域。本书作为该领域的入门教材,在内容上尽可能涵盖机器学习基础知识的各方面。全书共16章,大致分为3个部分:第1部分(第1~3章)介绍机器学习的基础知识;第2部分(第4~10章)讨论一些经典而常用的机器学习方法(决策树、神经网络、支持向量机、贝叶斯分类器、集成学习、聚类、降维与度量学习);第3部分(第11~16章)为进阶知识,内容涉及特征选择与稀疏学习、计算学习理论、半监督学习、概率图模型、规则学习以及强化学习等。每章都附有习题并介绍了相关阅读材料,以便有兴趣的读者进一步钻研探索。

向下滑动查看所有内容

教材展示

左右滑动查看更多

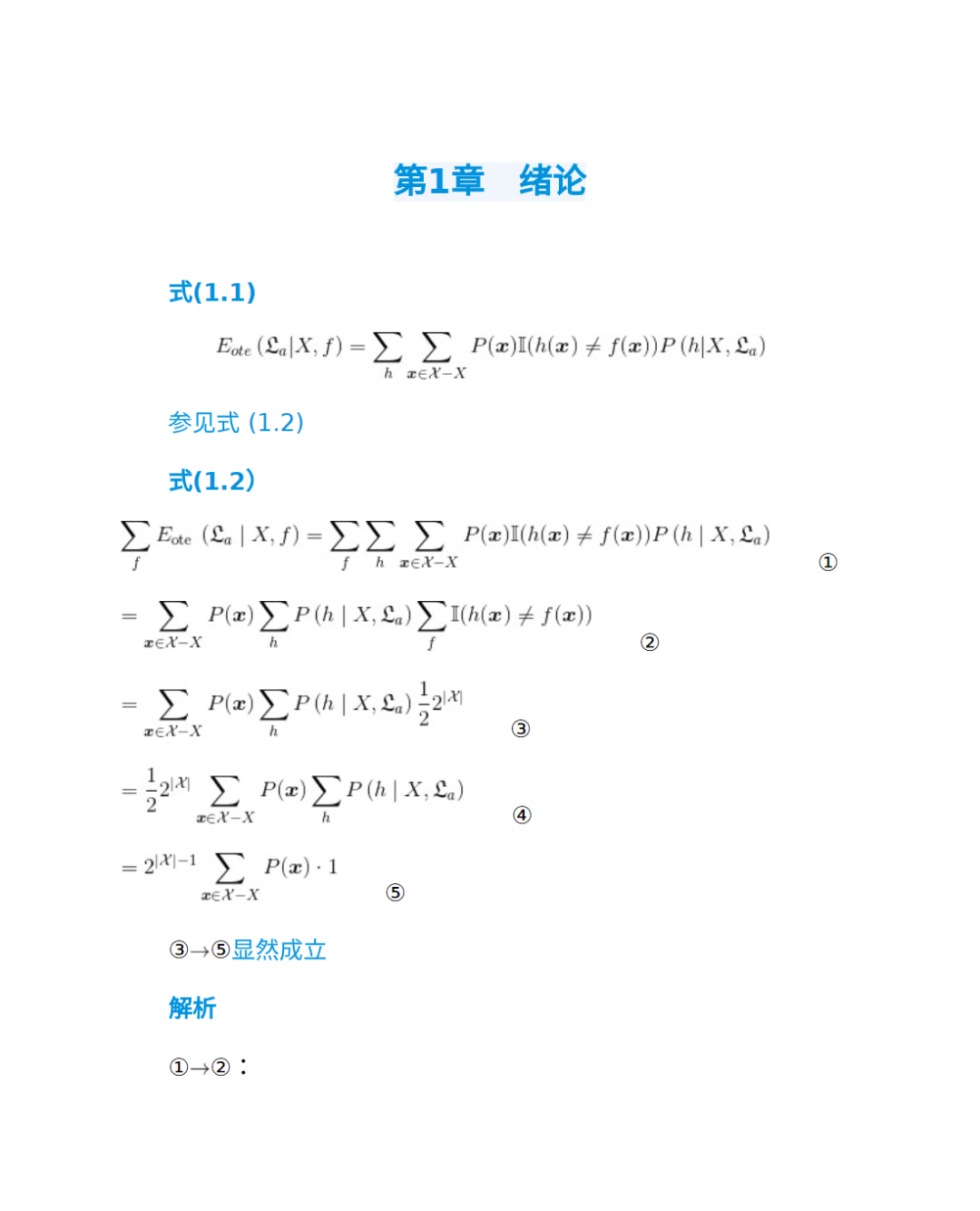

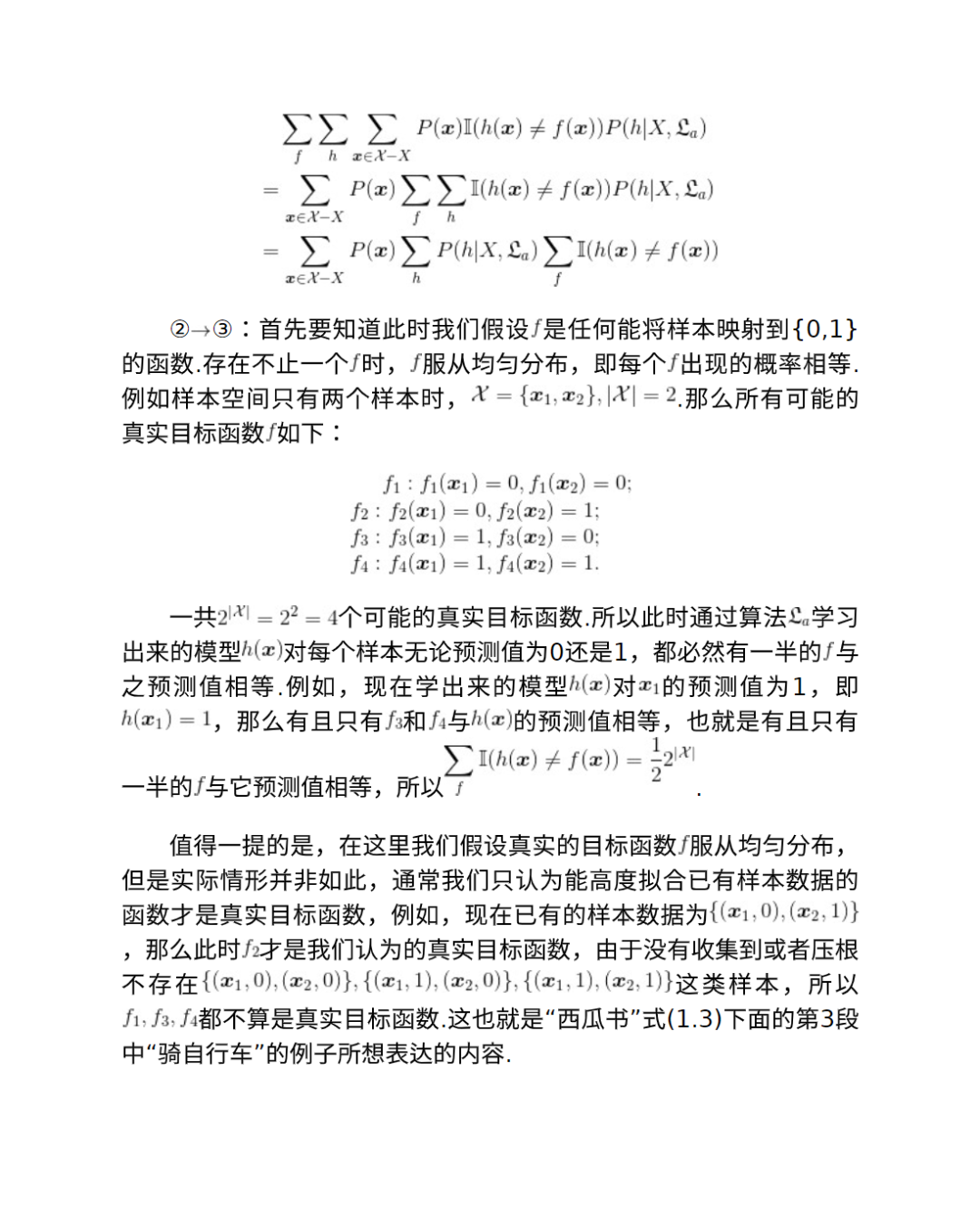

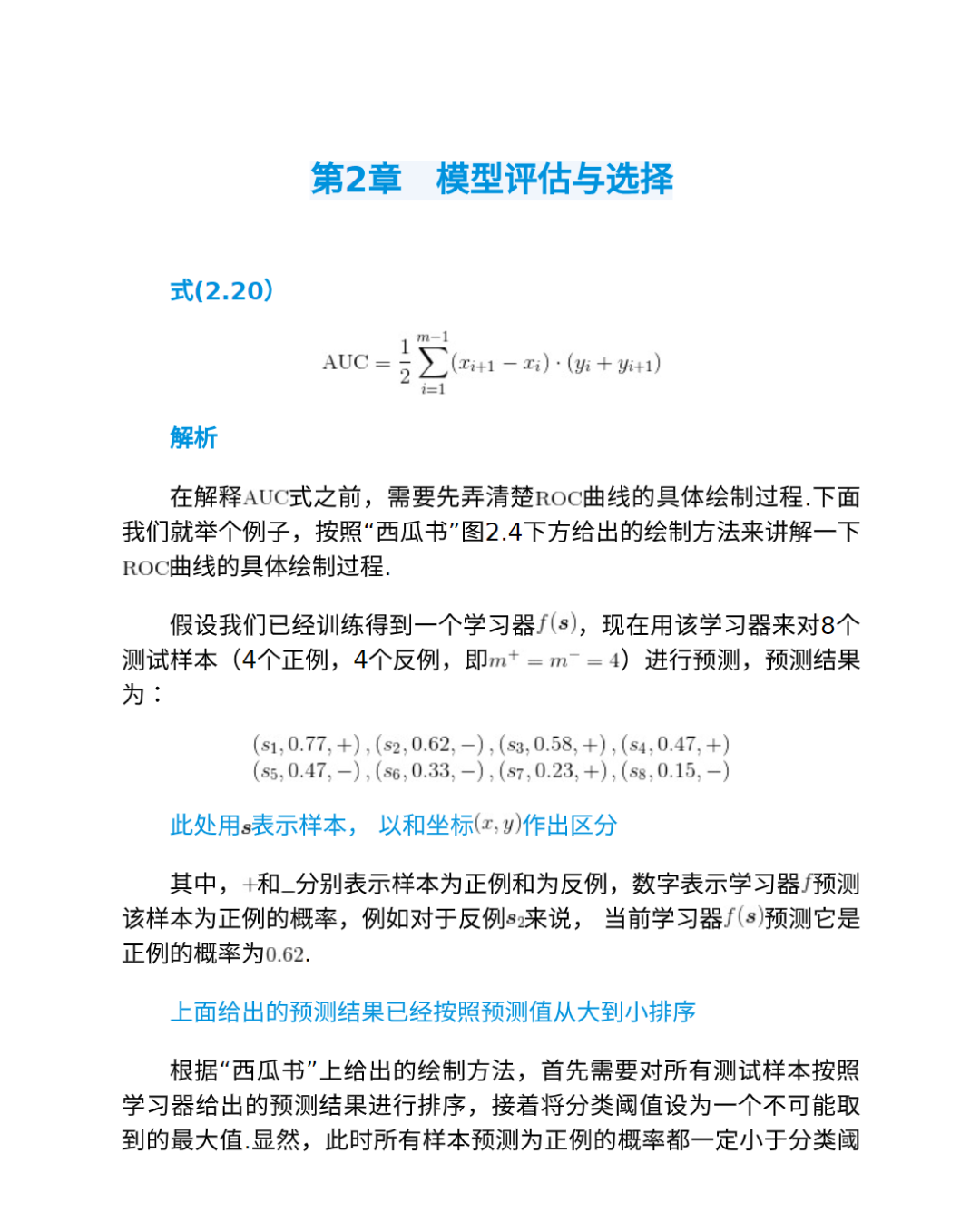

课后答案展示

左右滑动查看更多

178

178

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?