点击下方卡片,关注“自动驾驶之心”公众号

戳我-> 领取自动驾驶近15个方向学习路线

论文作者 | 上海交通大学&上海AI Lab

编辑 | 自动驾驶之心

车路协同辅助的自动驾驶V2X-AD(Vehicle-to-everything-aided autonomous driving)在提供更安全的驾驶策略方面具有巨大潜力。研究者们在V2X-AD的交通和通信层面进行了大量的研究,但是这些基础设施和通信资源在提高驾驶性能方面的效果仍未得到充分探索。这突显了研究协同自动驾驶的必要性,即如何设计面向驾驶规划的高效信息共享策略,从而提高每辆汽车驾驶性能。这需要两个关键的基础条件:一个能够为V2X-AD提供数据环境的平台,以及一个具有驾驶相关完整功能以及信息共享机制的端到端驾驶系统。

为此,来自上海交通大学和上海人工智能实验室的研究者们在最新研究文章《Towards Collaborative Autonomous Driving: Simulation Platform and End-to-End System》提出了CoDriving: 一种端到端协同驾驶系统,该系统利用一种面向驾驶规划的信息共享策略实现了通信高效的协作。同时,本文研究者们搭建了仿真平台V2Xverse,该平台为协同驾驶提供了完整的训练测试环境,包含车路协同驾驶数据集的生成、全栈协同驾驶系统的部署、以及可定制场景下的闭环驾驶性能评估和驾驶子任务评估。

同时,仿真平台V2Xverse集成了多个现有协同感知方法的训练和部署测试代码,用多种测试任务检验综合的驾驶功能:3D目标检测,路径规划,闭环自动驾驶。V2Xverse突破了现有协同感知方法只能“看”不能“控制”的局限性,支持将现有的协同感知方法嵌入到完整的驾驶系统,并在仿真环境中测试驾驶性能。本文的研究者们相信这将为自动驾驶中基于视觉的车路协同研究带来更好的功能延展和更贴合实际驾驶场景的测试基准。

论文链接:https://arxiv.org/pdf/2404.09496

代码链接:https://github.com/CollaborativePerception/V2Xverse

研究背景和意义

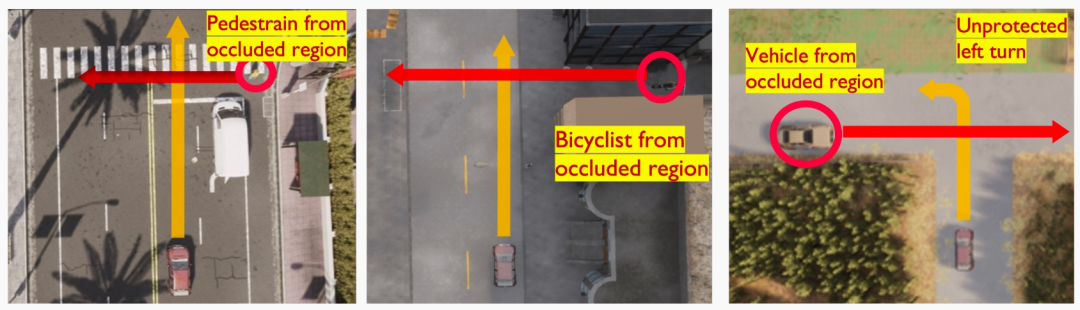

本文的研究关注基于V2X(Vehicle-to-everything)通信的协同自动驾驶。相比于单车自动驾驶,协同自动驾驶通过车辆与周围环境(如路边单元、智能设备装备的行人等)之间的信息交换提升车辆感知能力与驾驶性能,这将有利于视野受限的复杂场景(如图 1)下的安全驾驶。

然而,目前基于V2X的车路协同工作大多专注于优化模块级感知能力,如何将协作感知能力用于提升集成系统中的最终驾驶性能仍然缺乏足够的探索。

为了解决这一问题,本文旨在将协同感知能力扩展为涵盖全面驾驶能力的协同驾驶系统,包含感知,预测、规划和控制等关键模块。实现协同自动驾驶需要两个关键基础:一个能够为V2X-AD提供数据环境的平台;二是集成了完整驾驶相关功能和信息共享机制的端到端驾驶系统。从平台的角度,本工作搭建了V2Xverse,这是一个综合的协同自动驾驶仿真平台,提供了从车路协同驾驶数据集生成到全栈协作驾驶系统的部署和闭环驾驶性能评估的完整流程。从驾驶系统的角度,本文介绍了CoDriving,一种新的端到端协作驾驶系统,该系统在完整的自动驾驶框架中设计并嵌入了基于V2X通信的协作模块,通过共享感知信息提升协同驾驶性能。CoDriving的核心思想是一种新的面向驾驶规划的信息共享策略,使用在空间上稀疏但对驾驶重要的视觉特征信息作为通信内容,在优化通信效率的同时提高驾驶性能。

V2Xverse: 车路协同驾驶仿真平台

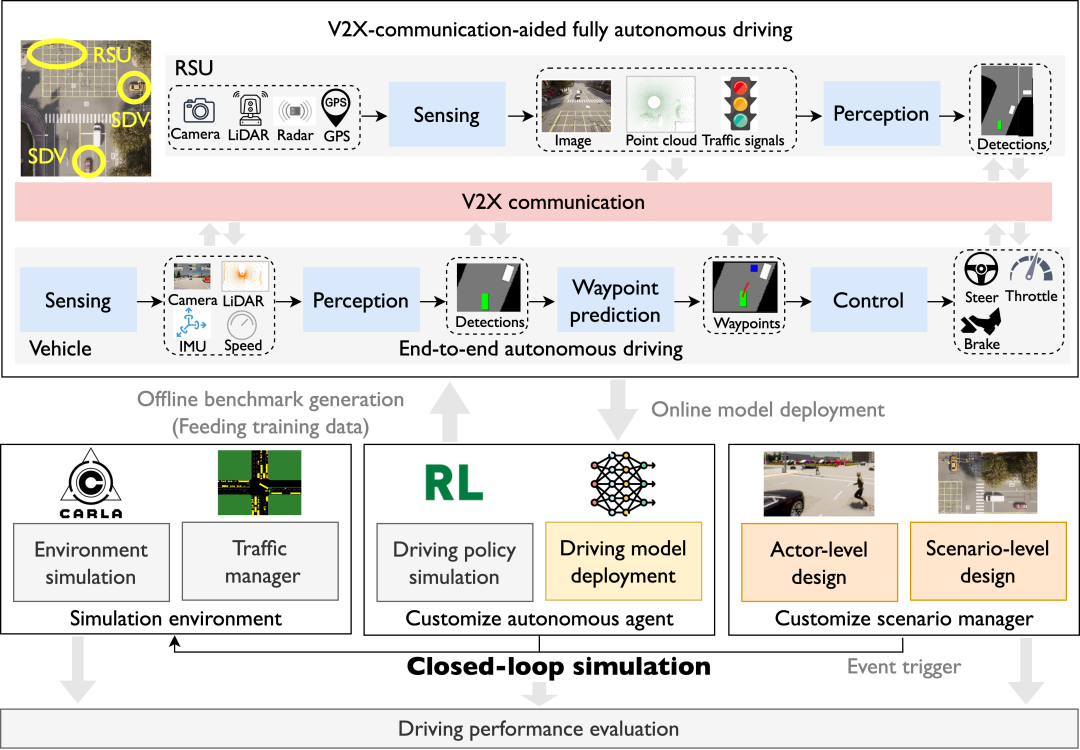

本文提出的V2Xverse的关键特征是能够实现与驾驶相关的子任务的离线基准生成和不同场景下驾驶性能的在线闭环评估,全面支持协同自动驾驶系统的开发。为了创建V2X-AD场景,V2Xverse在场景中设置了多辆配备了完整的驾驶能力的智能车,并通过一定策略在道路两旁放置路边单元,从而为智能车提供补充视野。为了支持协同自动驾驶方法的开发,V2Xverse首先提供了(车辆-车辆)以及(车辆-路边单元)的通信模块,并且为系统训练提供了完整的驾驶信号和专家标注,还为闭环驾驶评估提供了多种危险场景。仿真平台框架见图 2。

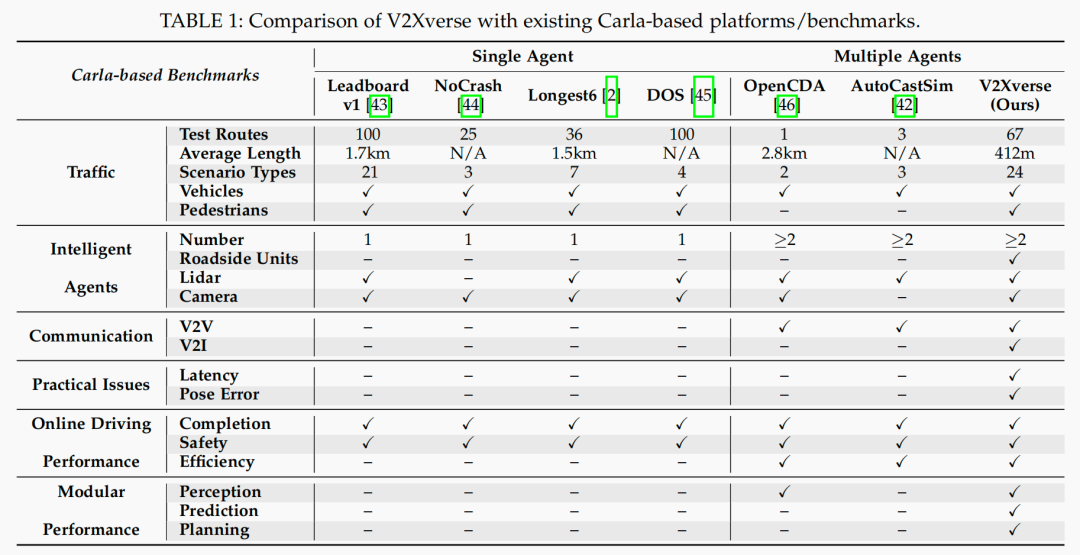

与现有基于Carla的自动驾驶仿真平台相比,V2Xverse具有三个优势。首先,V2Xverse支持多车驾驶模拟,而主流的carla-leaderboard及其衍生平台仅支持单车驾驶模拟。第二,V2Xverse支持全驾驶功能模拟,而现有的协同感知仿真平台只支持与感知模块相关的功能。第三,V2Xverse支持全面的V2X-AD场景,包括多样化的传感器设备、模型集成和灵活的场景定制;见表 1。

CoDriving: 面向高效协作的端到端自驾模型

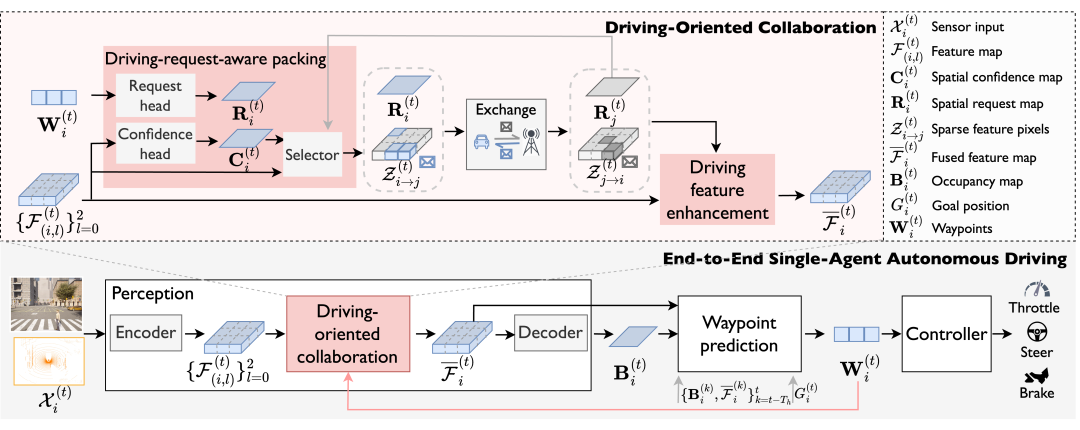

CoDriving包括两个组成部分(见图 3):1)端到端的单车自动驾驶网络,将传感器输入转换为驾驶控制信号;2)面向驾驶的协作,协作者通过共享对驾驶关键的感知特征来实现高效通信,并通过特征聚合来增强单车BEV感知特征,增强后的感知特征将有利于系统产生更准确的感知识别结果和规划预测结果。

端到端自动驾驶网络

端到端单车自动驾驶网络基于来自不同模态的输入来学习输出路径点预测,并通过一个控制模块将路径点转换为驾驶控制信号。为了实现这一点,CoDriving将驾驶所需的模块化组件集成到一个端到端的系统中,包括3D目标检测器、路径点预测器和控制器。CoDriving使用鸟瞰图(BEV)表示,因为它提供了一个统一的全局坐标系,避免了复杂的坐标转换,更好地支持基于空间信息的协作。

面向驾驶的协作策略

V2X协作通过信息共享解决单车不可避免的可见性受限问题。在这项工作中,本文提出了一种新的面向驾驶的协作策略,以同时优化驾驶性能和通信效率。该方案包括 i)基于驾驶意图的感知通信,CoDriving通过一个驾驶请求模块交换空间稀疏但对驾驶关键的BEV感知特征;以及 ii)BEV特征增强,CoDriving利用接收到的特征信息增强每个协作车辆的BEV感知特征。增强后的BEV特征将有利于系统产生更准确的感知识别结果和规划预测结果。

实验结果

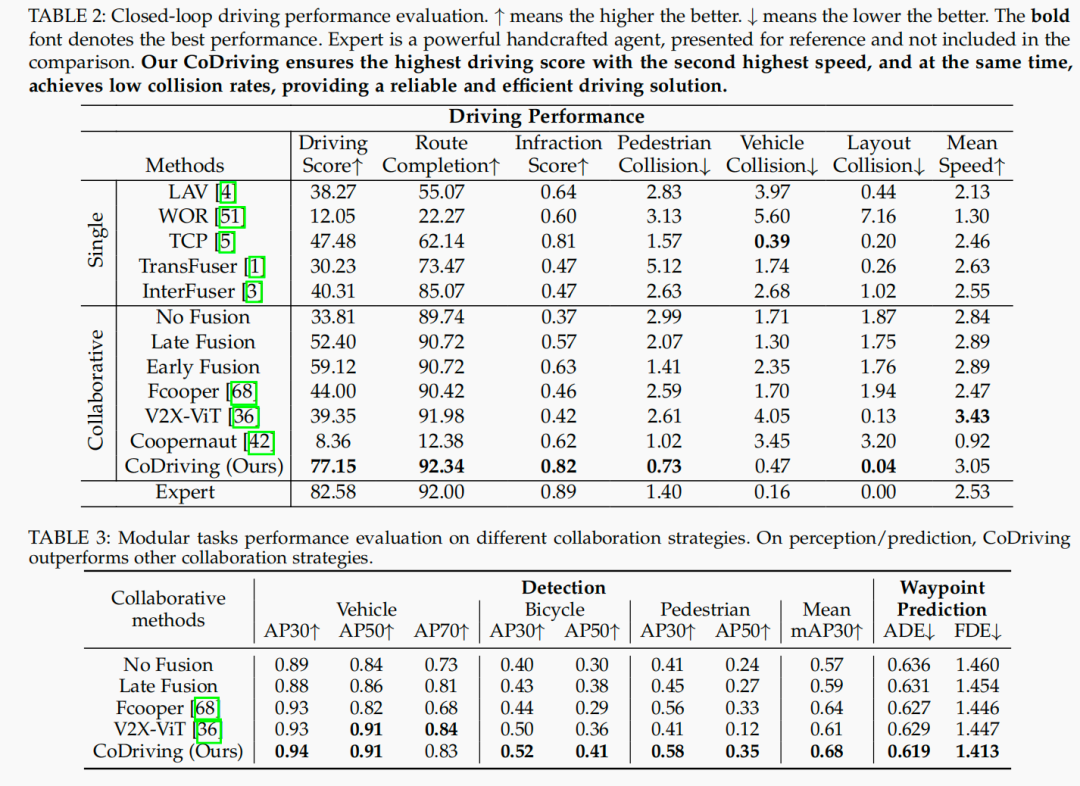

利用V2Xverse仿真平台,本文在闭环驾驶,3D目标检测,路径点预测三个任务上对CoDriving的性能进行了检验。在关键的闭环驾驶测试中,相比于之前的单车端到端自动驾驶的SOTA方法, CoDriving的驾驶分数显著地提升了62.49%,行人碰撞率下降了53.50%。在目标检测与路径点预测任务中,CoDriving相比于其他协同方法表现更好,见表 2。

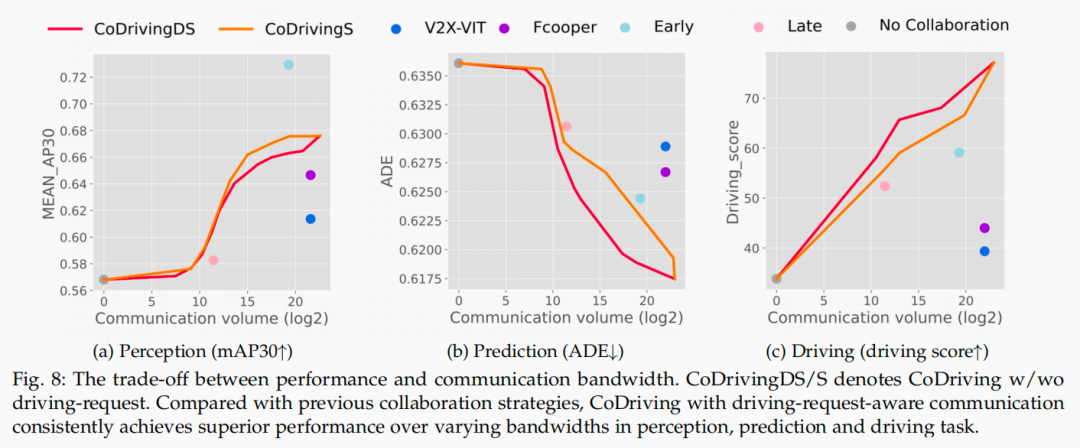

本文同时对CoDriving在不同通信带宽下的协作表现进行了验证,在闭环驾驶,3D目标检测,路径点预测三个任务上,CoDriving在不同的通信带宽限制下优于其他协作方法,见图 4。

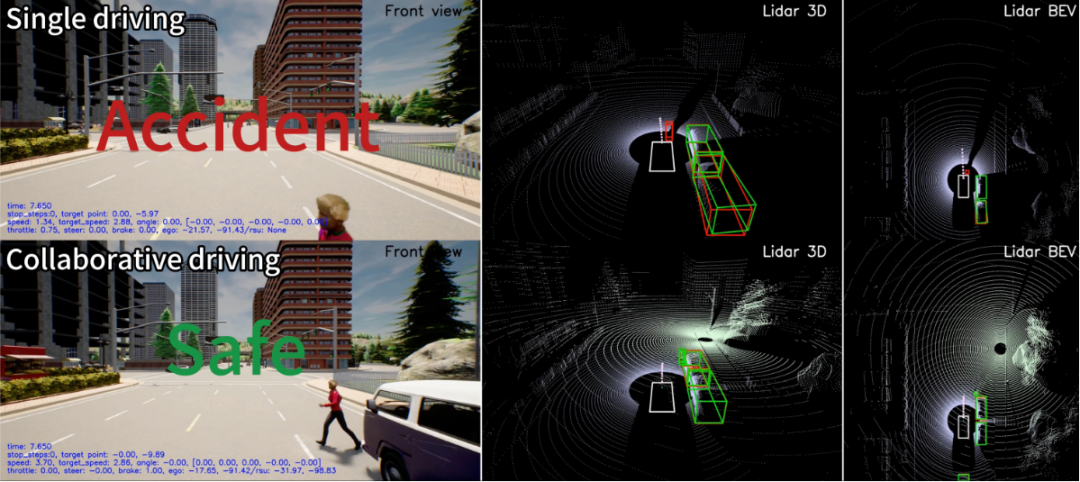

图 5展示了CoDriving在V2Xverse仿真环境中的驾驶案例。在图 5的场景中,一个视野盲区的行人突然冲出马路,可以看到单车自动驾驶视野受限,无法提前规避行人,造成了严重的车祸事故。而CoDriving利用路边单元的共享视野特征提前探测到了行人,从而安全避让。

总结

本工作通过搭建仿真平台V2Xverse来帮助协同自动驾驶方法的开发,并提出了一种新的端到端自驾系统。其中,V2Xverse是一个支持闭环驾驶测试的V2X协同驾驶仿真平台,该平台为开发以提升最终驾驶性能为目标的协同自动驾驶系统提供了完整的开发渠道。值得一提的是,V2Xverse也支持多种现有单车自动驾驶系统的部署,以及多种现有协同感知方法的训练和闭环驾驶测试。同时,本文提出了一种新的端到端协同自动驾驶系统CoDriving,该系统通过共享驾驶关键感知信息来提高驾驶性能并优化通信效率。对整个驾驶系统的综合评估表明,CoDriving在不同的通信带宽上显著优于单车自驾系统。本文的研究者们相信V2Xverse平台和CoDriving系统为更可靠的自动驾驶提供了潜在的解决方案。

投稿作者为『自动驾驶之心知识星球』特邀嘉宾,欢迎加入交流!

① 全网独家视频课程

BEV感知、BEV模型部署、BEV目标跟踪、毫米波雷达视觉融合、多传感器标定、多传感器融合、多模态3D目标检测、车道线检测、轨迹预测、在线高精地图、世界模型、点云3D目标检测、目标跟踪、Occupancy、cuda与TensorRT模型部署、大模型与自动驾驶、Nerf、语义分割、自动驾驶仿真、传感器部署、决策规划、轨迹预测等多个方向学习视频(扫码即可学习)

网页端官网:www.zdjszx.com

网页端官网:www.zdjszx.com

② 国内首个自动驾驶学习社区

国内最大最专业,近3000人的交流社区,已得到大多数自动驾驶公司的认可!涉及30+自动驾驶技术栈学习路线,从0到一带你入门自动驾驶感知(2D/3D检测、语义分割、车道线、BEV感知、Occupancy、多传感器融合、多传感器标定、目标跟踪)、自动驾驶定位建图(SLAM、高精地图、局部在线地图)、自动驾驶规划控制/轨迹预测等领域技术方案、大模型、端到端等,更有行业动态和岗位发布!欢迎扫描下方二维码,加入自动驾驶之心知识星球,这是一个真正有干货的地方,与领域大佬交流入门、学习、工作、跳槽上的各类难题,日常分享论文+代码+视频

③【自动驾驶之心】技术交流群

自动驾驶之心是首个自动驾驶开发者社区,聚焦感知、定位、融合、规控、标定、端到端、仿真、产品经理、自动驾驶开发、自动标注与数据闭环多个方向,目前近60+技术交流群,欢迎加入!扫码添加汽车人助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

④【自动驾驶之心】全平台矩阵

801

801

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?