点击下方卡片,关注“具身智能之心”公众号

作者 | 具身智能之心 编辑 | 具身智能之心

本文只做学术分享,如有侵权,联系删文

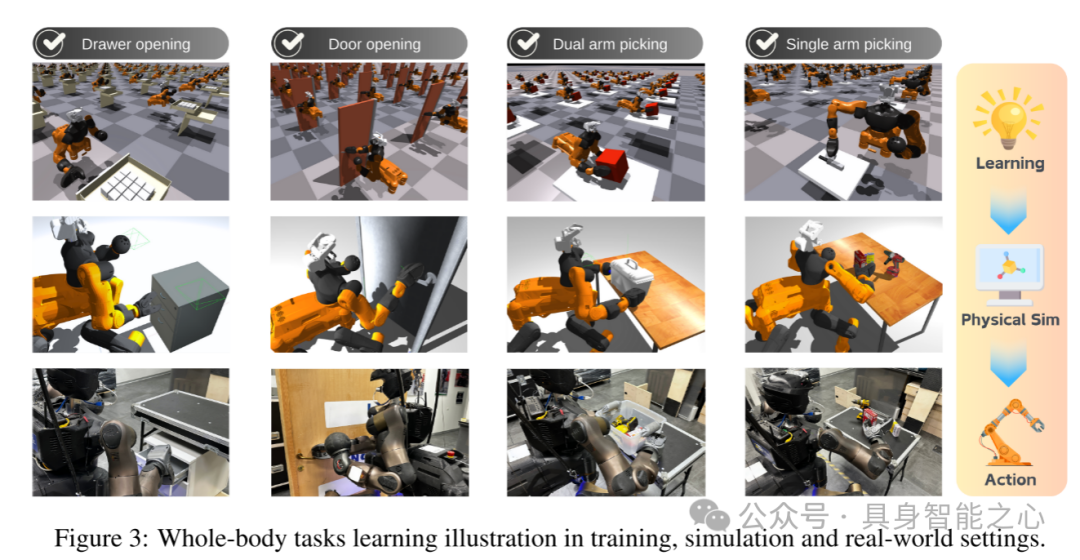

论文标题:HYPERmotion: Learning Hybrid Behavior Planning for Autonomous Loco-manipulation

论文链接:https://arxiv.org/pdf/2406.14655

项目链接:https://hy-motion.github.io/

作者单位:意大利科技研究院 热那亚大学

写在前面&出发点

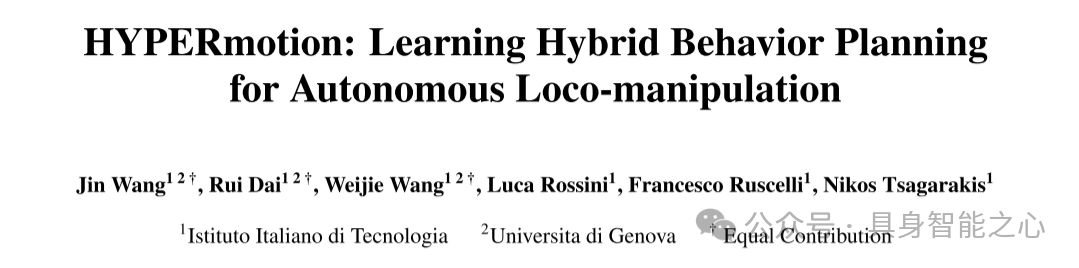

使机器人能够在多样的环境中自主执行混合动作,对于长时间跨度的任务(如物料搬运、家务劳动和工作辅助)具有重要意义。这需要充分利用机器人的内在运动能力,从丰富的环境信息中提取可用性,并规划物理交互行为。尽管近期的进展展示了令人印象深刻的人形机器人全身控制能力,但它们在新任务的多样性和适应性方面仍存在挑战。本研究中提出了 HYPERmotion,一个基于不同场景中任务的学习、选择和行为规划框架。我们将强化学习与全身优化结合,生成38个驱动关节的运动,并创建一个运动库来存储已学习的技能。本文将大型语言模型(LLMs)的规划和推理能力应用于复杂的运动操作任务,构建一个层级任务图,其中包含一系列原始行为,旨在桥接低层执行和高层规划。通过利用提炼的空间几何信息和二维观测与视觉语言模型(VLM)之间的交互,将知识与机器人形态选择器结合,以选择单臂或双臂、步态或轮式运动中的合适动作。在仿真和实际环境中的实验表明,学习到的运动能够高效地适应新任务,并且能够在无结构场景中从自由文本命令中展现出较高的自主性。

内容出自国内首个具身智能全栈学习社区:具身智能之心知识星球,这里包含所有你想要的。

HYPERmotion方法设计

具备行为自主性的类人机器人一直被视为我们日常生活中的理想合作伙伴,并且是具身智能的有力代表。与固定基座的机器人臂相比,由于类人机器人在结构上的特点,它们提供了更大的操作空间,但同时也大大增加了控制和规划的难度。尽管向通用类人机器人发展的进展迅速,大多数研究仍集中在运动学任务上,较少有研究探讨类人机器人的全身协调学习,这导致了简单的控制设计,难以适应新任务和新环境,从而限制了它们在开放式指令下执行长时间跨度任务的潜力。一个主要的挑战是如何探索类人机器人的可执行性,丰富其行为表现,同时学习推断可用性和空间几何约束,从而像人类一样利用已学技能为各种任务进行规划。

近年来,机器人学习领域的蓬勃发展使其成为操控和运动任务中的一个有前景的方向。基于学习的方法,如强化学习(RL),已经成为任务导向的动作生成的有效工具,同时也有助于在多样化场景中的泛化。然而,将学习算法扩展到类人机器人仍然是一个挑战,原因在于自由度(DoF)的大幅增加导致训练成本呈指数增长,并且在动态约束下将这些算法部署到真实机器人上非常困难。与此同时,大型语言模型(LLMs)的兴起及其在机器人规划中的卓越能力使得执行逻辑推理和构建复杂任务的层次化动作序列成为可能。通过整合来自不同模态的观测数据,这些模型可以用于提取物体和环境的特征,以支持机器人感知和决策。然而,LLM在类人机器人中的应用仍然存在一些局限性,特别是在复杂的全身运动控制和身体各部位之间的精确协调方面。

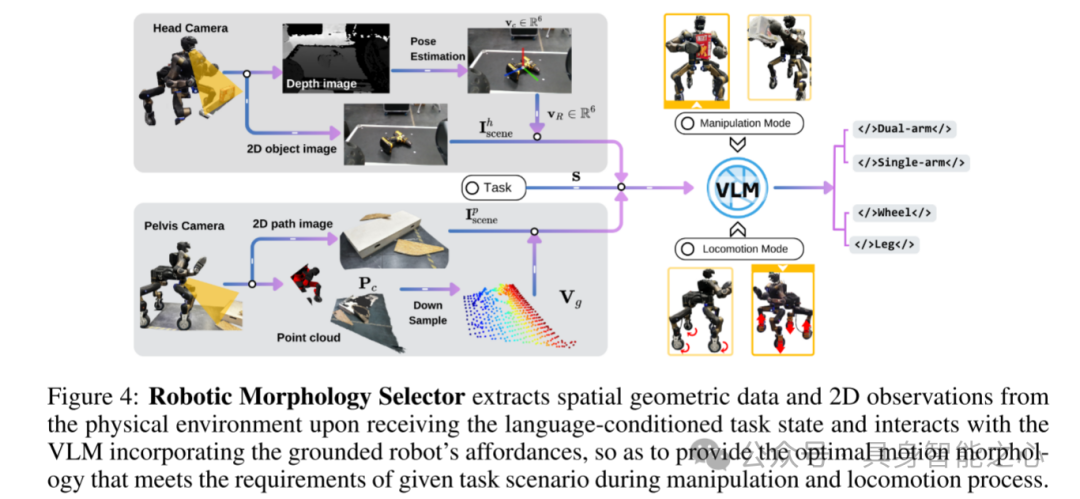

为了解决这些问题,本文首先认识到,直接通过仿真训练输出现实世界多关节系统的全身轨迹是低效且不切实际的。因此,本文采用了一种分解式训练策略,根据给定任务模块化地选择相关的驱动组件,并通过统一的运动生成器将低维空间轨迹投影到全身空间中。训练后的动作作为技能单元存储在运动库中。本文利用大型语言模型(LLM)分解由多个子任务组成的复杂语义指令的能力,并设计了一个模块化的用户界面作为模型输入。LLM从运动库中选择技能并安排一系列动作,这些动作被称为任务图。此外,从捕获的二维图像和深度数据中提取的三维特征可以与视觉语言模型(VLM)和机器人内在特性结合,充当机器人运动形态选择器。

本文将这项研究称为 HYPERmotion,这是一个利用语言模型解决类人机器人自主运动操作行为规划的框架。通过利用提炼的空间几何信息与二维观测数据与视觉语言模型(VLM)之间的交互,它将知识与机器人可用性结合,引导形态选择,并桥接语义空间、机器人感知与动作之间的鸿沟。本文展示了一种基于学习的全身控制方法,生成适应新任务的类人运动,并使用原始技能执行长时间跨度的任务。通过实验,本文进一步说明了 HYPERmotion 如何在高自由度、混合轮式-步态机器人上进行学习和部署,并在人工指令下进行zero-shot在线规划。

图1:HYPERmotion使类人机器人能够学习、规划和选择行为,以完成长时间跨度的任务。步骤1-5展示了机器人如何在基础模型的指导下,解读口头指令后自主执行运动和操作,并独立选择适用于不同场景的运动模式。

图2:HYPERmotion框架概述。本文将该框架分为四个模块:运动生成用于学习和训练全身运动技能,以应对新任务,并将其存储在运动库中;用户输入包括接收到的任务指令和初始化提示集;任务规划通过LLM的推理和规划功能生成任务图,引导机器人行为,并将动作指令传递给真实机器人;形态选择器用于特定子任务中的动作确定,根据基于空间知识和机器人内在特征的知识,选择适合运动和操作的形态。

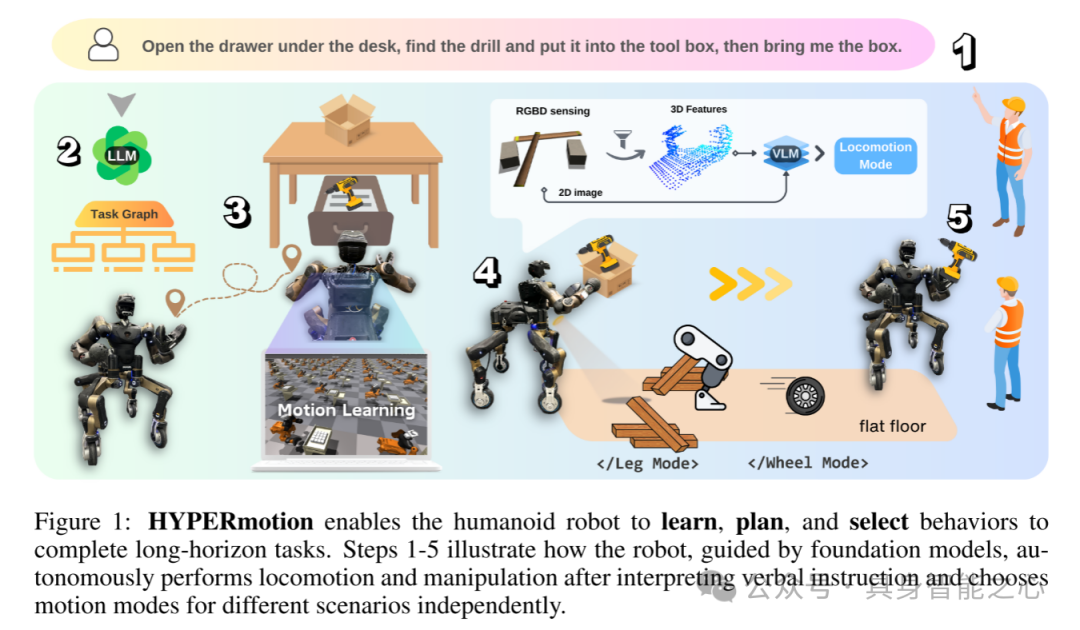

图3:全身任务学习示意图,包括训练、仿真和现实环境中的设置。

图4:机器人形态选择器在接收到语言条件任务状态后,从物理环境中提取空间几何数据和二维观测信息,并与结合了机器人可用性的视觉语言模型(VLM)进行交互,从而提供满足特定任务场景要求的最优运动形态,用于操作和运动过程。

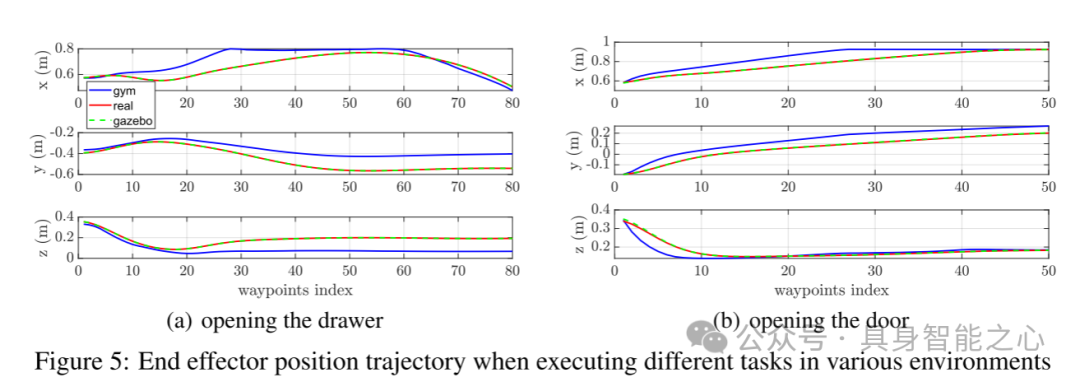

图5:在不同环境中执行不同任务时末端执行器位置轨迹。

实验验证:

图6:形态选择器在不同场景下的成功率。“2D”和“SD”分别表示图像和空间数据输入。

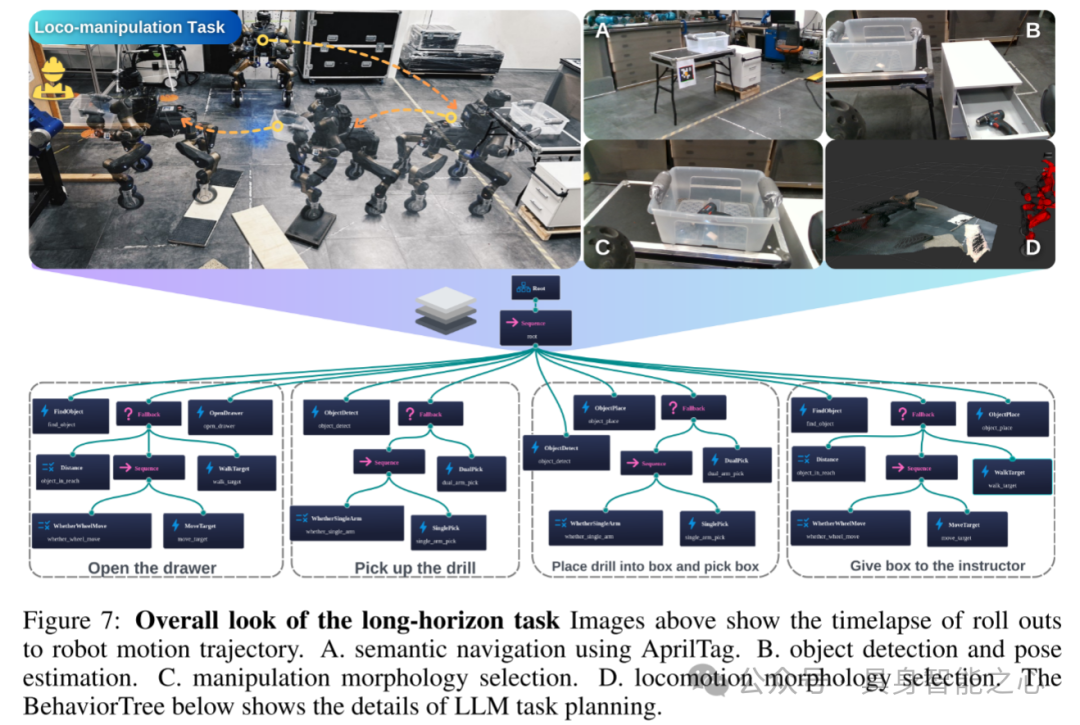

图7:长时间跨度任务的整体视图。上方图像展示了机器人运动轨迹的时间推移。A. 使用AprilTag的语义导航。B. 物体检测和姿态估计。C. 操作形态选择。D. 运动形态选择。下方的行为树展示了LLM任务规划的详细信息。

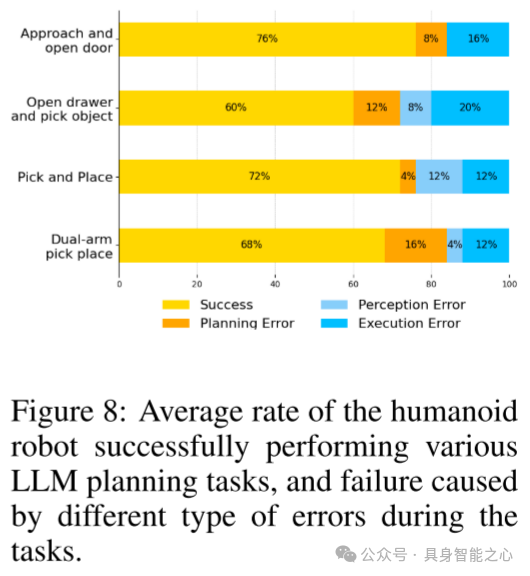

图8:类人机器人成功执行各种LLM规划任务的平均成功率,以及任务过程中由于不同类型错误导致的失败情况。

总结:

本文提出了HYPERmotion,一个使类人机器人能够学习、选择和规划行为的框架,融合知识和机器人可用性来执行具身任务。通过实际环境中的实验和长时间跨度的任务,本文评估了该框架的效率和多样性。尽管取得了预期的结果,但仍存在一些局限性:运动库的规模限制了任务指令的范围,而新技能的学习需要单独的训练优化,阻碍了从现有动作的泛化。此外,系统在处理外部干扰和碰撞时存在困难,任务执行过程中缺乏实时语言交互,且在面对突发任务时缺乏重新规划的能力。未来的工作将集中于丰富机器人的动作技能,增强LLM的动态规划能力,并改善机器人导航和感知,以实现闭环类人运动和安全的人机协作。

引用:

@misc{wang2024hypermotion,

title={HYPERmotion: Learning Hybrid Behavior Planning for Autonomous Loco-manipulation},

author={Jin Wang and Rui Dai and Weijie Wang and Luca Rossini and Francesco Ruscelli and Nikos Tsagarakis},

year={2024},

eprint={2406.14655},

archivePrefix={arXiv},

primaryClass={id='cs.RO' full_name='Robotics' is_active=True alt_name=None in_archive='cs' is_general=False description='Roughly includes material in ACM Subject Class I.2.9.'}

}“具身智能之心”公众号持续推送具身智能领域热点:

【具身智能之心】技术交流群

具身智能之心是首个面向具身智能领域的开发者社区,聚焦大模型、视觉语言导航、机械臂、双足机器人、四足机器人、感知融合、强化学习、模仿学习、规控与端到端、机器人仿真、产品开发、自动标注等多个方向,目前近60+技术交流群,欢迎加入!扫码添加小助理微信邀请入群,备注:学校/公司+方向+昵称(快速入群方式)

【具身智能之心】知识星球

具身智能之心知识星球是国内首个具身智能开发者社区,近600人的社区。主要关注具身智能相关的数据集、开源项目、具身仿真平台、大模型、视觉语言模型、强化学习、具身智能感知定位、机器臂抓取、姿态估计、策略学习、轮式+机械臂、双足机器人、四足机器人、大模型部署、端到端、规划控制等方向。扫码加入星球,享受以下专有服务:

1. 第一时间掌握具身智能相关的学术进展、工业落地应用;

2. 和行业大佬一起交流工作与求职相关的问题;

3. 优良的学习交流环境,能结识更多同行业的伙伴;

4. 具身智能相关工作岗位推荐,第一时间对接企业;

5. 行业机会挖掘,投资与项目对接;

237

237

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?